Het is tijd dat elke gebruiker een "digitaal schild" wordt, alert, waakzaam en verantwoordelijk bij elke klik en elke deelactie.

De voordelen en de dunne lijn van AI

Nooit eerder was kunstmatige intelligentie zo dicht bij het dagelijks leven. Met slechts een paar klikken en een kort commando kunnen we stemmen, afbeeldingen en zelfs video's creëren met een verbluffend realisme. AI bespaart tijd, verlaagt de productiekosten en luidt een tijdperk van flexibele digitale media in.

Deze mogelijkheid om "de werkelijkheid op een realistische manier te simuleren" is echter een tweesnijdend zwaard gebleken. De laatste tijd worden sociale media overspoeld met video's die zijn gemaakt met deepfake-technologie, waarin de gezichten van politiechefs en beelden van wetshandhavers in gevoelige zaken worden gemanipuleerd en vervormd met voice-overs om het publiek te misleiden en te verdelen.

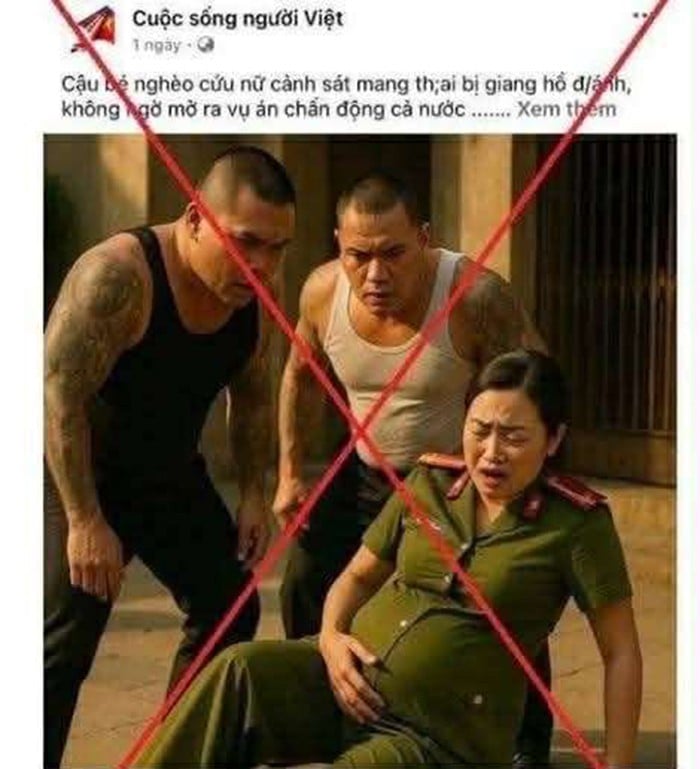

Geënsceneerde foto's zoals deze komen steeds vaker voor op sociale media.

In een viraal TikTok-filmpje werden beelden van een verkeersagent in actie gecombineerd met aanstootgevende dialogen, vergezeld van de hashtag #boetesalleenvoordeshow, waarmee werd gesuggereerd dat de agent zijn macht misbruikte voor persoonlijk gewin. Veel gebruikers, met name jongeren, geloofden deze inhoud gemakkelijk, omdat de beelden zo realistisch waren en de stem nauw aansloot bij de lippenbewegingen, waardoor het extreem moeilijk was om onderscheid te maken tussen echt en nep.

Een jonge YouTuber in Dien Bien heeft, enkel en alleen omdat hij zijn vaardigheden met AI wilde demonstreren, de prijs betaald in de vorm van een administratieve boete en een gedwongen openbare verontschuldiging. Op de middag van 24 januari maakte de provinciale politie van Dien Bien bekend dat de afdeling Cyberbeveiliging en Preventie van Hightechmisdrijven een administratieve boete van 7,5 miljoen VND had opgelegd aan Tong Van T. (geboren in 2001, woonachtig in het district Muong Ang) voor het gebruik van AI om een gefabriceerde video te maken met vervormde en beledigende inhoud over verkeersagenten.

Op 7 januari uploadde T. een video van ruim drie minuten naar haar YouTube-account "Tuyen Vlog" met de schokkende titel: "Terwijl ik onderweg was, werd ik achtervolgd door de verkeerspolitie." In de video werden beelden en situaties gecreëerd met behulp van AI-technologie, die een achtervolging door de verkeerspolitie simuleerde. Deze beelden en het commentaar waren beledigend en lasterlijk jegens de politie.

In samenwerking met de politie gaf T. toe dat de volledige inhoud van de video nep was en gemaakt voor "entertainment"-doeleinden en om zijn vaardigheden met AI-technologie te demonstreren. Naast de boete werd T. door de autoriteiten bevolen de valse video te verwijderen en publiekelijk zijn excuses aan te bieden aan de verkeerspolitie via zijn persoonlijke YouTube-kanaal.

In het tijdperk van de digitale revolutie , met name de snelle ontwikkeling van kunstmatige intelligentie, hebben vijandige en reactionaire krachten niet geaarzeld om dit instrument te misbruiken voor het creëren van verzonnen beelden en verhalen die gericht zijn op het verdraaien en beschadigen van het imago van de Vietnamese Volkspolitie. Een foto die onlangs op sociale media circuleerde, waarop een zwangere vrouw in politie-uniform wordt bedreigd door twee mannen met een "gangsterachtig" uiterlijk, is duidelijk bewijs van deze tactiek.

De afbeelding, die met behulp van AI is gemaakt, is onlangs viraal gegaan op sociale media.

Op het eerste gezicht zouden kijkers dit gemakkelijk kunnen aanzien voor een echte scène, vergezeld van sensationele krantenkoppen zoals: "Arme jongen redt zwangere vrouwelijke politieagente die wordt aangevallen door gangsters en ontdekt onbewust een zaak die de hele natie schokt...". Dit is echter slechts een geënsceneerde scène, mogelijk afkomstig uit een film of entertainmentproduct, of erger nog, een door AI gecreëerd beeld om de emoties van de kijker te manipuleren, waardoor ze medelijden voelen en twijfelen aan de authenticiteit van de politie.

Nog zorgwekkender is dat de verspreiding van dergelijke inhoud niet alleen de reputatie en het imago van de Volkspolitie schaadt, die dag en nacht werkt om de veiligheid en orde in de samenleving te beschermen, maar ook een geraffineerde vorm van psychologische oorlogvoering vormt. Wanneer het vertrouwen van de bevolking in de autoriteiten wordt ondermijnd door misleidende beelden, zullen de verborgen motieven van vijandige krachten om de nationale eenheid te verdelen geleidelijk aan werkelijkheid worden.

Daarom moet elke burger zijn of haar waakzaamheid vergroten, kritisch denkvermogen ontwikkelen en in staat zijn nepnieuws te herkennen, en valse inhoud resoluut aan de kaak stellen en weerleggen. Zo draagt men bij aan de bescherming van de ideologische basis en het behoud van maatschappelijke stabiliteit in het licht van de huidige golf van schadelijke informatie op internet.

In Ho Chi Minh-stad ging een videofragment van bijna een minuut onverwacht viraal op sociale media. De video toont een persoon in politie-uniform die een verdachte in een kantoor dwingt een bekentenis af te leggen voor een verkeersovertreding. In de video gedraagt de persoon, vermoedelijk een politieagent, zich agressief, schreeuwt constant en gebruikt zelfs grof taalgebruik, wat tot grote verontwaardiging bij het publiek leidde.

Kort nadat de video viraal ging, startte de politie van Ho Chi Minh-stad echter een onderzoek en bevestigde dat het om een geavanceerde deepfake ging. Volgens hun bevindingen waren de gezichten in de video afkomstig uit een opname van een interne politieconferentie en vervolgens door kwaadwillenden met behulp van AI-technologie gemanipuleerd om ze over een geënsceneerde scène te plaatsen, waardoor kijkers de indruk kregen dat het een echte gebeurtenis betrof.

Het bijbehorende audiofragment bevat met name dreigende en beledigende stemmen die niet de echte woorden van officiële instanties zijn, maar gesynthetiseerde AI-stemmen, geprogrammeerd en bewerkt om de emoties van de kijker te manipuleren.

Dit incident is een treffend voorbeeld van het gebruik van deepfake-technologie om de Volkspolitie te verdraaien en te belasteren, een tactiek die steeds vaker wordt toegepast door reactionaire en subversieve krachten in de cyberspace. Het is belangrijk om te benadrukken dat dergelijke nepberichten, indien niet snel ontmaskerd, ernstige gevolgen kunnen hebben: ze kunnen het publieke vertrouwen in de rechtshandhaving ondermijnen, weerstand binnen de gemeenschap aanwakkeren en de verspreiding van valse verhalen bevorderen. Dit dient als een duidelijke waarschuwing voor de dringende noodzaak om de communicatiemogelijkheden te verbeteren om nepnieuws te weerleggen, op te sporen en te bestrijden, en roept elke burger op om waakzaam te zijn en zich te onthouden van het overhaast delen of becommentariëren van ongeverifieerde inhoud afkomstig van officiële bronnen.

In een andere recente zaak, betreffende de afhandeling van onregelmatigheden bij een voertuigkeuringscentrum in het zuiden, verspreidden kwaadwillende elementen een nepvideo van een provinciale politiechef die de corrupte ambtenaren verdedigde. Deze clip, die via Telegram en sociale media werd verspreid met de titel "ondersteund door machtige krachten", was in werkelijkheid een product van AI en verscheen niet in persconferenties of officiële documenten.

Een gevaarlijke trend verspreidt zich stilletjes online: kwaadwillenden gebruiken AI-technologie om nepvideo's te maken voor fraude en afpersing. Recentelijk zijn veel mensen slachtoffer geworden doordat hun beelden, met name die van maatschappelijk gerespecteerde personen zoals advocaten, artsen en zakenmensen, werden gebruikt in video's waarin reclame werd gemaakt voor "terugvordering van geld dat verloren is gegaan door online oplichting".

In deze filmpjes wordt AI gebruikt om de stem en het gezicht van advocaten na te bootsen, waardoor kijkers de oplichters geloven en gemakkelijk persoonlijke informatie verstrekken of geld overmaken. Nog gevaarlijker is dat sommige daders deepfake-technologie gebruiken om de gezichten van slachtoffers over sekvideo's te plaatsen en deze vervolgens naar partners of collega's te sturen met de bedoeling hen te bedreigen of te dwingen geld over te maken om "te zwijgen".

In maart 2025 vond een schokkend incident plaats toen een slachtoffer in Hanoi werd gevraagd tientallen miljoenen dong over te maken nadat ze een nep-seksvideo met haar in de hoofdrol had ontvangen. Tegelijkertijd werd in Ho Chi Minh-stad een andere persoon gechanteerd met een vordering van 2 miljard dong als diegene zou voorkomen dat de gevoelige video zich zou verspreiden. Het Ministerie van Openbare Veiligheid startte een onderzoek en identificeerde verschillende transnationale criminele groepen, voornamelijk uit China en Zuidoost-Azië, die achter deze netwerken zaten en gebruik maakten van wegwerp-simkaarten, e-wallets en sociale mediaplatformen om hun identiteit te verbergen.

Dit is niet langer een kleinzielige oplichting, maar een vorm van 'hightech psychologische oorlogsvoering', waarbij angst voor eer en sociale relaties op een diepgaande manier wordt uitgebuit om slachtoffers onder druk te zetten. Zonder verhoogde waakzaamheid en vaardigheden om ongebruikelijke informatie en gedrag te herkennen, kan iedereen het slachtoffer worden van deze hightech criminelen. Gezien deze geavanceerde golf van identiteitsfraude moet elke burger waakzaam zijn, absoluut afzien van het onnadenkend delen van persoonlijke informatie en bereid zijn zich uit te spreken tegen illegale activiteiten, om zo bij te dragen aan de bescherming van zijn of haar eigen veiligheid en die van de gemeenschap.

Een "digitaal schild" vanuit de gemeenschap is nodig om de dreiging van deepfakes te bestrijden.

Volgens het Departement voor Radio, Televisie en Elektronische Informatie (Ministerie van Cultuur, Sport en Toerisme) moesten digitale platforms in Vietnam in 2024 meer dan 4.000 video's verwijderen die valse en vervormde informatie bevatten. Het merendeel hiervan was gemaakt met behulp van AI-technologie zoals deepfakes en stemklonen. Alleen al TikTok – een platform dat populair is onder jongeren – werd gevraagd om meer dan 1.300 deepfake-clips te verwijderen, voornamelijk gerelateerd aan de politie, de overheid en sociaal beleid.

In het tijdperk van technologische vooruitgang ontsluit kunstmatige intelligentie baanbrekende mogelijkheden, maar brengt ook ongekende gevaren met zich mee, met name deepfake-producten die vervormde inhoud bevatten en de reputatie van overheidsinstanties schaden. Een onderzoek van het MICRI Media Research Institute toont aan dat 62% van de gebruikers van sociale media in Vietnam geen onderscheid kan maken tussen echte en nepnieuws zonder waarschuwingen van de reguliere media of autoriteiten. Dit is een "cognitieve kloof" die kwaadwillende krachten gretig uitbuiten om desinformatie te verspreiden en de sociale psychologie te verstoren.

Tong Van T. op het politiebureau.

Volgens generaal-majoor, universitair hoofddocent en doctor Do Canh Thin, een expert in criminologie, is het gebruik van AI om nepvideo's te maken waarin leiders worden nagebootst, valse verklaringen worden bewerkt of het professionele handelen van de politie wordt verdraaid, een nieuwe maar bijzonder gevaarlijke tactiek. "Deepfake is niet zomaar een entertainmentproduct, maar een vorm van moderne informatieoorlogvoering die het vertrouwen kan ondermijnen, sociale instabiliteit kan veroorzaken en zeer moeilijk te beheersen is", aldus generaal-majoor Do Canh Thin.

In werkelijkheid zijn door AI gemanipuleerde video's verre van onschadelijk; ze richten zich vaak op gevoelige onderwerpen zoals het afhandelen van overtredingen, het onderzoeken van misdrijven en het bestrijden van corruptie, wat leidt tot verwarring bij het publiek en wantrouwen jegens de politie. Nog zorgwekkender is dat veel video's worden gedeeld op grote platforms zoals YouTube en TikTok, waar ze honderdduizenden keren worden bekeken voordat ze worden verwijderd, met een negatief domino-effect tot gevolg.

Digitale media-expert Hoang Minh waarschuwt: "Eén ondoordachte deelactie of like kan je al medeplichtig maken aan nepnieuws. Iedere internetgebruiker moet begrijpen dat acties in de digitale ruimte ook reële gevolgen hebben."

In deze context is het meer dan ooit nodig om vanuit de gemeenschap zelf een "digitaal schild" op te bouwen: dat wil zeggen, waakzaamheid, informatie-immuniteit en een gevoel van verantwoordelijkheid ten opzichte van de online omgeving. Technologie mag dan neutraal zijn, maar de manier waarop mensen ermee omgaan, bepaalt of AI een drijvende kracht voor ontwikkeling wordt of een destructieve kracht die het maatschappelijk vertrouwen ondermijnt. Het behouden van ideologische standvastigheid en het beschermen van het imago van de politieagent is het beschermen van de fundamenten van de nationale veiligheid – een taak die niet alleen is weggelegd voor de bevoegde autoriteiten, maar voor elke burger in het digitale tijdperk.

Bron: https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Foto] Premier Pham Minh Chinh leidt een dialoog met Japanse bedrijven.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/21/1774097547316_ndo_br_dsc-0448-jpg.webp)

Reactie (0)