Det er på tide at hver bruker blir et «digitalt skjold», og er årvåken, årvåken og ansvarlig med hvert klikk og hver deling.

Fordelene og den fine linjen med AI

Aldri før har kunstig intelligens vært så nær hverdagen. Med bare noen få klikk og en kort kommando kan vi lage stemmer, bilder og til og med videoer med forbløffende realisme. KI sparer tid, reduserer innholdsproduksjonskostnader og innleder en æra med fleksible digitale medier.

Imidlertid har nettopp denne evnen til å «simulere virkeligheten på en realistisk måte» blitt et tveegget sverd. Nylig har sosiale medier blitt oversvømmet av videoer laget med deepfake-teknologi, der ansiktene til politiledere og bilder av politibetjenter i sensitive saker manipuleres og forvrenges med voiceovers for å villede og splitte offentligheten.

Iscenesatte bilder som disse blir stadig mer vanlige på sosiale medier.

I et viralt TikTok-klipp ble bilder av en trafikkbetjent på vakt satt opp mot støtende dialog, akkompagnert av emneknaggen «bøter bare for syns skyld», som antydet at betjenten misbrukte makten sin for personlig vinning. Mange brukere, spesielt unge mennesker, trodde lett på dette innholdet fordi det visuelle var så realistisk, og stemmen samsvarte tett med leppebevegelsene, noe som gjorde det ekstremt vanskelig å skille mellom ekte og falskt.

Bare fordi han ville «vise frem» sine ferdigheter innen AI-teknologi, har en ung YouTuber i Dien Bien betalt prisen med en administrativ bot og en tvungen offentlig unnskyldning. På ettermiddagen 24. januar kunngjorde Dien Bien provinsielle politi at avdelingen for cybersikkerhet og høyteknologisk kriminalitetsforebygging hadde utstedt en administrativ bot på 7,5 millioner VND mot Tong Van T. (født i 2001, bosatt i Muong Ang-distriktet) for å ha brukt AI til å lage en fabrikkert video med forvrengt og fornærmende innhold om trafikkpolitibetjenter.

Mer spesifikt lastet T. opp en video på over 3 minutter til YouTube-kontoen sin, «Tuyen Vlog», den 7. januar med den sjokkerende tittelen: «Mens jeg var ute og gikk, ble jeg jaget av trafikkpoliti.» I klippet ble bildene og situasjonene iscenesatt ved hjelp av AI-teknologi, som simulerte trafikkpoliti som jaget borgere, og ble kombinert med effekter og kommentarer som var støtende og ærekrenkende mot politiet.

I samarbeid med politiet innrømmet T. at hele innholdet i klippet var et fabrikkert produkt laget for «underholdning» og for å demonstrere hans evne til å bruke AI-teknologi. I tillegg til boten beordret myndighetene T. til å fjerne den falske videoen og offentlig beklage til trafikkpolitiet på sin personlige YouTube-kanal.

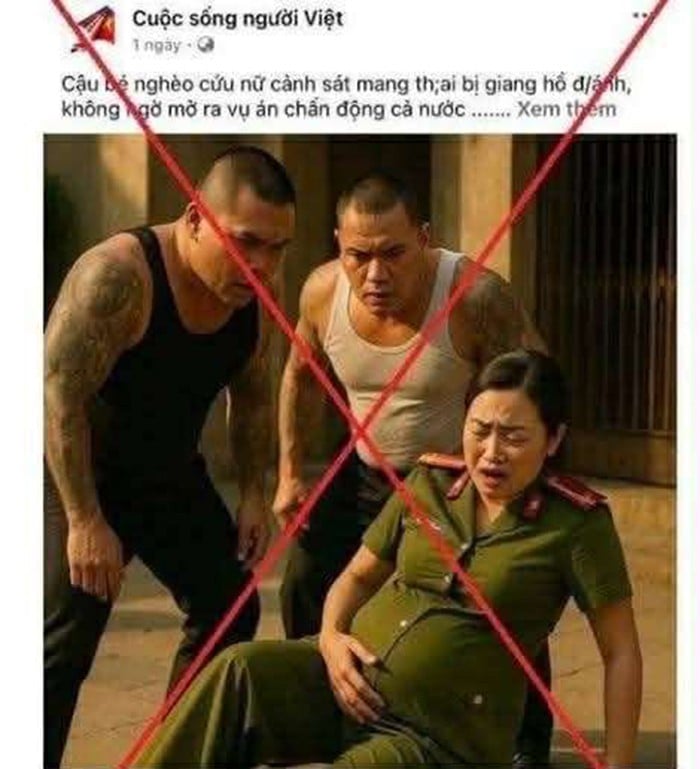

I den digitale revolusjonens tidsalder, spesielt den raske utviklingen av kunstig intelligens, har ikke fiendtlige og reaksjonære krefter nølt med å utnytte dette verktøyet til å lage fabrikkerte bilder og historier som har som mål å forvrenge og sverte bildet av det vietnamesiske folkepolitiet. Et bilde som nylig sirkulerte på sosiale medier, og som viser en gravid kvinne i politiuniform som blir truet av to menn med et «gangster»-utseende, er et tydelig bevis på denne taktikken.

Bildet, som er laget ved hjelp av kunstig intelligens, har nylig gått viralt på sosiale medier.

Ved første øyekast kan seerne lett forveksle dette med en ekte scene, akkompagnert av sensasjonelle overskrifter som: «Stakkars gutt redder gravid kvinnelig politibetjent som blir angrepet av gangstere, og avdekker uvitende en sak som sjokkerer hele nasjonen...». Dette er imidlertid faktisk bare en iscenesatt scene, muligens fra en film eller et underholdningsprodukt, eller enda verre, et bilde laget av AI for å lure leserens følelser, noe som får dem til å føle medlidenhet og tvile på autentisiteten til politiet.

Enda mer bekymringsverdig er det at spredningen av slikt innhold ikke bare skader omdømmet og imaget til Folkepolitiet, som jobber dag og natt for å beskytte samfunnets sikkerhet og orden, men også utgjør en sofistikert form for psykologisk krigføring. Når folkets tillit til myndighetene eroderes av villedende bilder, vil de bakenforliggende motivene til fiendtlige krefter om å splitte nasjonal enhet gradvis bli realisert.

Derfor må alle borgere øke sin årvåkenhet, utvikle kritisk tenkeevne og evnen til å identifisere falsk informasjon, og resolutt fordømme og tilbakevise falskt innhold, noe som bidrar til å beskytte det ideologiske grunnlaget og opprettholde sosial stabilitet i møte med den nåværende bølgen av skadelig informasjon på internett.

I Ho Chi Minh-byen gikk et nesten ett minutt langt videoklipp uventet viralt på sosiale medier. Det viste en person i politiuniform som «tvang» en mistenkt til å tilstå en trafikkforseelse på et kontor. I videoen viser personen som antas å være en politibetjent en aggressiv holdning, og roper stadig og bruker til og med uhøflig språk, noe som forårsaket offentlig forargelse.

Kort tid etter at klippet gikk viralt, etterforsket imidlertid politiet i Ho Chi Minh-byen raskt og bekreftet at det var en sofistikert deepfake. Ifølge funnene deres ble ansiktene i videoen hentet fra et opptak av en intern politikonferanse, og deretter manipulert av ondsinnede personer ved hjelp av AI-teknologi for å legge dem over en iscenesatt scene, noe som fikk seerne til å tro at det var en ekte hendelse.

Spesielt inkluderer den medfølgende lyden truende og fornærmende stemmer som faktisk ikke er de virkelige ordene til noen tjenestemann, men snarere syntetiserte AI-stemmer, programmert og redigert for å lure seerens følelser.

Denne hendelsen er et godt eksempel på bruken av deepfake-teknologi for å forvrenge og ærekrenke Folkepolitiet, en taktikk som i økende grad utnyttes av reaksjonære og subversive krefter i cyberspace. Det er viktig å merke seg at slike falske produkter kan føre til alvorlige konsekvenser hvis de ikke avsløres raskt: undergrave offentlig tillit til politiet, oppildne til motstand i samfunnet og legge til rette for spredning av falske fortellinger. Dette tjener som en klar advarsel om det presserende behovet for å forbedre kommunikasjonskapasiteten for å tilbakevise, oppdage og bekjempe falske nyheter, og oppfordrer alle borgere til å være årvåkne og avstå fra å forhaste seg med å dele eller kommentere ubekreftet innhold fra offisielle kilder.

I en annen nylig sak, som involverte håndtering av uregelmessigheter ved et kjøretøyinspeksjonssenter i sør, spredte fiendtlige elementer en falsk video av en provinsiell politileder som talte til forsvar for de korrupte tjenestemennene. Dette klippet, som ble spredt på Telegram og sosiale medier med tittelen «støttet av mektige krefter», var faktisk et produkt av AI og dukket ikke opp i noen pressekonferanser eller offisielle dokumenter.

En farlig trend sprer seg stille på nettet: ondsinnede aktører bruker AI-teknologi til å lage falske videoer med det formål å svindle og utpresse. I det siste har mange blitt ofre når bilder av dem, spesielt bilder av sosialt respekterte personer som advokater, leger og forretningsfolk, legges oppå videoer som reklamerer for «gjenvinning av penger tapt i nettsvindel».

I disse klippene brukes AI til å etterligne stemmen og ansiktet til advokater, noe som får seerne til å tro på svindlerne og enkelt gi dem personlig informasjon eller overføre penger til dem. Enda farligere er det at noen gjerningsmenn bruker deepfake-teknologi til å legge ofrenes ansikter over sexvideoer, og deretter sende dem til ektefeller eller kolleger med den hensikt å true eller tvinge dem til å overføre penger for å «tie stille».

En sjokkerende hendelse inntraff i mars 2025, da et offer i Hanoi ble bedt om å overføre titalls millioner dong etter å ha mottatt en falsk sexvideo med henne i bildet. I mellomtiden, i Ho Chi Minh-byen, ble en annen person utpresset for 2 milliarder dong hvis de ikke ønsket at den sensitive videoen skulle spres. Departementet for offentlig sikkerhet startet en etterforskning, og identifiserte flere transnasjonale kriminelle grupper, hovedsakelig fra Kina og Sørøst-Asia, bak disse nettverkene, og brukte engangs-SIM-kort, e-lommebøker og sosiale medieplattformer for å skjule identiteten sin.

Dette er ikke lenger en smålig svindel, men en form for «høyteknologisk psykologisk krigføring», som utnytter frykten for ære og sosiale relasjoner i stor grad for å presse ofrene. Uten økt årvåkenhet og ferdigheter i å identifisere uvanlig informasjon og atferd, kan hvem som helst bli offer for disse høyteknologiske kriminelle. I møte med denne sofistikerte bølgen av etterligning må alle borgere være årvåkne, absolutt avstå fra å dele personlig informasjon vilkårlig, og være klare til å si ifra mot ulovlige aktiviteter, og dermed bidra til å beskytte sin egen sikkerhet og samfunnets sikkerhet.

Et «digitalt skjold» fra samfunnet er nødvendig for å bekjempe trusselen fra deepfakes.

Ifølge departementet for kringkasting, fjernsyn og elektronisk informasjon (departementet for kultur, sport og turisme) måtte digitale plattformer i Vietnam i 2024 fjerne mer enn 4000 videoer som inneholdt falsk og forvrengt informasjon, hvorav de fleste var produkter laget med AI-teknologi som deepfakes og stemmekloner. TikTok alene – en plattform populær blant unge – ble bedt om å slette mer enn 1300 deepfake-klipp, hovedsakelig relatert til politiet, myndighetene og sosialpolitikk.

I en tid med teknologisk oppsving åpner kunstig intelligens opp for banebrytende potensial, men den bringer også med seg enestående farer, spesielt deepfake-produkter som inneholder forvrengt innhold som angriper omdømmet til offentlige etater. En undersøkelse fra MICRI Media Research Institute viser at 62 % av brukerne av sosiale medier i Vietnam ikke kan skille mellom ekte og falsk informasjon uten advarsler fra vanlige medier eller myndigheter. Dette er et «kognitivt gap» som ondsinnede krefter utnytter grundig for å spre feilinformasjon og forstyrre sosialpsykologien.

Tong Van T. på politistasjonen.

Ifølge generalmajor, førsteamanuensis og doktor Do Canh Thin, en kriminologiekspert, er det en ny, men spesielt farlig taktikk å bruke kunstig intelligens til å lage falske videoer som utgir seg for å være ledere, redigerer falske uttalelser eller forvrenger politiets profesjonelle handlinger. «Deepfake er ikke bare et underholdningsprodukt, men en form for moderne informasjonskrigføring, som er i stand til å undergrave tillit, forårsake sosial ustabilitet og er svært vanskelig å kontrollere», uttalte generalmajor Do Canh Thin.

I virkeligheten er klipp manipulert av kunstig intelligens langt fra harmløse; de retter seg ofte mot sensitive emner som håndtering av lovbrudd, etterforskning av forbrytelser og bekjempelse av korrupsjon, noe som forårsaker offentlig forvirring og mistillit til politiet. Enda mer bekymringsfullt er det at mange videoer deles på store plattformer som YouTube og TikTok, og får hundretusenvis av visninger før de fjernes, noe som skaper en negativ ringvirkning.

Digital medieekspert Hoang Minh advarer: «Bare én uforsiktig deling eller likerklikk kan gjøre deg til en medskyldig i falske nyheter. Enhver internettbruker må forstå at handlinger i det digitale rommet også har reelle konsekvenser.»

I denne sammenhengen er det mer enn noen gang behov for å bygge et «digitalt skjold» innenfra samfunnet selv: det vil si årvåkenhet, informasjonsimmunitet og en følelse av ansvar overfor nettmiljøet. Teknologi kan være nøytral, men hvordan folk bruker den vil avgjøre om AI blir en drivkraft for utvikling eller en destruktiv kraft mot sosial tillit. Å opprettholde ideologisk standhaftighet og beskytte politibetjentens image er å beskytte grunnlaget for nasjonal sikkerhet – en oppgave ikke bare for relevante myndigheter, men for alle borgere i den digitale tidsalderen.

Kilde: https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Foto] Statsminister Pham Minh Chinh leder en dialog med japanske bedrifter.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/21/1774097547316_ndo_br_dsc-0448-jpg.webp)

Kommentar (0)