|

Trend „pochlebstwa” nie jest usterką techniczną, ale wynika z początkowej strategii szkoleniowej OpenAI. Zdjęcie: Bloomberg . |

W ostatnich tygodniach wielu użytkowników ChatGPT, a nawet niektórzy deweloperzy w OpenAI, zauważyli znaczącą zmianę w zachowaniu chatbotów. W szczególności, poziom pochlebstw i wdzięczności wyraźnie wzrósł. Odpowiedzi takie jak „Jesteś niesamowity!”, „Jestem pod ogromnym wrażeniem Twojego pomysłu!” pojawiają się coraz częściej, pozornie niezależnie od treści rozmowy.

Sztuczna inteligencja lubi schlebiać.

Zjawisko to wywołało debatę w środowisku badawczo-rozwojowym AI. Czy to nowa taktyka mająca na celu zwiększenie zaangażowania użytkowników poprzez sprawienie, by czuli się bardziej doceniani? A może chodzi o „samoregulację”, co oznacza, że modele AI mają tendencję do samokorygowania się w sposób, który uznają za optymalny, nawet jeśli niekoniecznie odzwierciedla on rzeczywistość?

Na Reddicie jeden z użytkowników ze złością opowiedział: „Zapytałem go o czas rozkładu banana, a on odpowiedział: »Świetne pytanie!«. Co w tym takiego wspaniałego?”. Na platformie społecznościowej X, dyrektor generalny Rome AI, Craig Weiss, nazwał ChatGPT „najbardziej pochlebczą osobą, jaką kiedykolwiek spotkał”.

Historia szybko się rozeszła. Wielu użytkowników podzieliło się podobnymi doświadczeniami, w tym pustymi komplementami, powitaniami pełnymi emotikonów i przesadnie pozytywnymi opiniami, które wydawały się nieszczere.

|

ChatGPT chwali wszystko i rzadko oferuje krytykę lub neutralność. Zdjęcie: @nickdunz/X, @lukefwilson/Reddit. |

Jason Pontin, partner zarządzający w firmie venture capital DCVC, podzielił się na X 28 kwietnia: „To naprawdę dziwna decyzja projektowa, Sam. Być może ta osobowość jest nieodłączną cechą jakiejś platformy. Ale jeśli nie, nie wyobrażam sobie, żeby ktokolwiek pomyślał, że taki poziom pochlebstwa byłby mile widziany lub atrakcyjny”.

Dzieląc się swoimi przemyśleniami 27 kwietnia, Justine Moore, partnerka w Andreessen Horowitz, stwierdziła: „To zdecydowanie zaszło za daleko”.

Według Cnet , zjawisko to nie jest przypadkowe. Zmiany w tonie ChatGPT zbiegają się z aktualizacjami modelu GPT-4o. Jest to najnowszy model z serii „o”, którą OpenAI ogłosiło w kwietniu 2025 roku. GPT-4o to „prawdziwie multimodalny” model sztucznej inteligencji, zdolny do naturalnego i zintegrowanego przetwarzania tekstu, obrazów, dźwięku i wideo .

Jednak w procesie czynienia chatbotów bardziej przystępnymi, wydaje się, że OpenAI przesadnie wyolbrzymiło osobowość ChatGPT.

Niektórzy sugerują nawet, że te pochlebstwa są celowe i mają na celu psychologiczną manipulację użytkownikami. Jeden z użytkowników Reddita zakwestionował: „Ta sztuczna inteligencja próbuje obniżyć jakość relacji w prawdziwym życiu, zastępując je wirtualnymi, uzależniając użytkowników od uczucia nieustannych pochwał”.

Czy jest to wada czy celowy wybór projektowy OpenAI?

W odpowiedzi na falę krytyki, dyrektor generalny OpenAI, Sam Altman, oficjalnie odpowiedział wieczorem 27 kwietnia. „Niektóre ostatnie aktualizacje GPT-4o sprawiły, że osobowość chatbota stała się nadmiernie służalcza i irytująca (choć nadal oferuje wiele świetnych funkcji). Pilnie pracujemy nad rozwiązaniem tych problemów. Niektóre poprawki będą dostępne dzisiaj, inne w tym tygodniu. W pewnym momencie podzielimy się tym, czego nauczyliśmy się z tego doświadczenia. To naprawdę interesujące” – napisał na X.

W rozmowie z Business Insider , Oren Etzioni, doświadczony ekspert w dziedzinie sztucznej inteligencji i emerytowany profesor Uniwersytetu Waszyngtońskiego, stwierdził, że przyczyną jest najprawdopodobniej stosowanie technik „uczenia się przez wzmacnianie na podstawie informacji zwrotnej od człowieka” (RLHF). To kluczowy etap w trenowaniu dużych modeli językowych, takich jak ChatGPT.

RLHF to proces, w którym opinie użytkowników, w tym od profesjonalnych zespołów recenzentów i użytkowników, są przekazywane z powrotem do modelu w celu dostosowania jego reakcji. Według Etzioniego możliwe jest, że recenzenci lub użytkownicy „nieumyślnie popchnęli model w kierunku bardziej pochlebnym i irytującym”. Zasugerował również, że gdyby OpenAI zatrudniło zewnętrznych partnerów do trenowania modelu, mogliby założyć, że taki styl jest oczekiwany przez użytkowników.

Etzioni uważa, że jeśli przyczyną problemu jest rzeczywiście RLHF, naprawa może potrwać kilka tygodni.

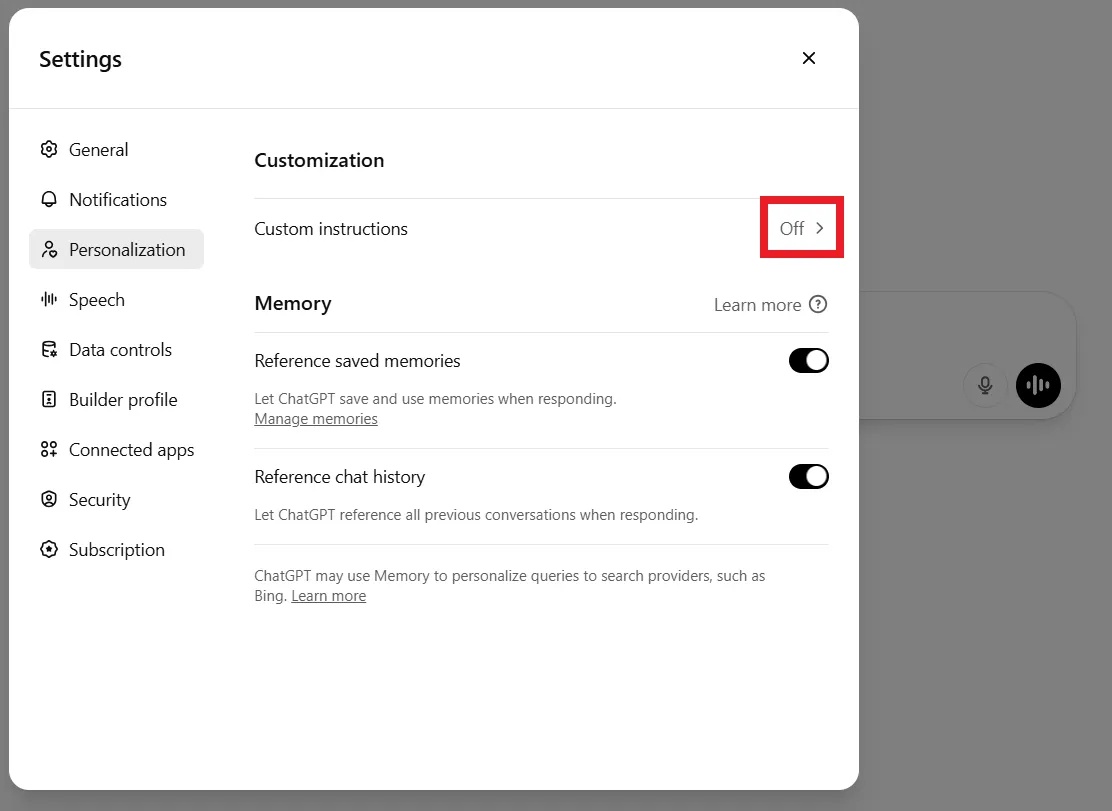

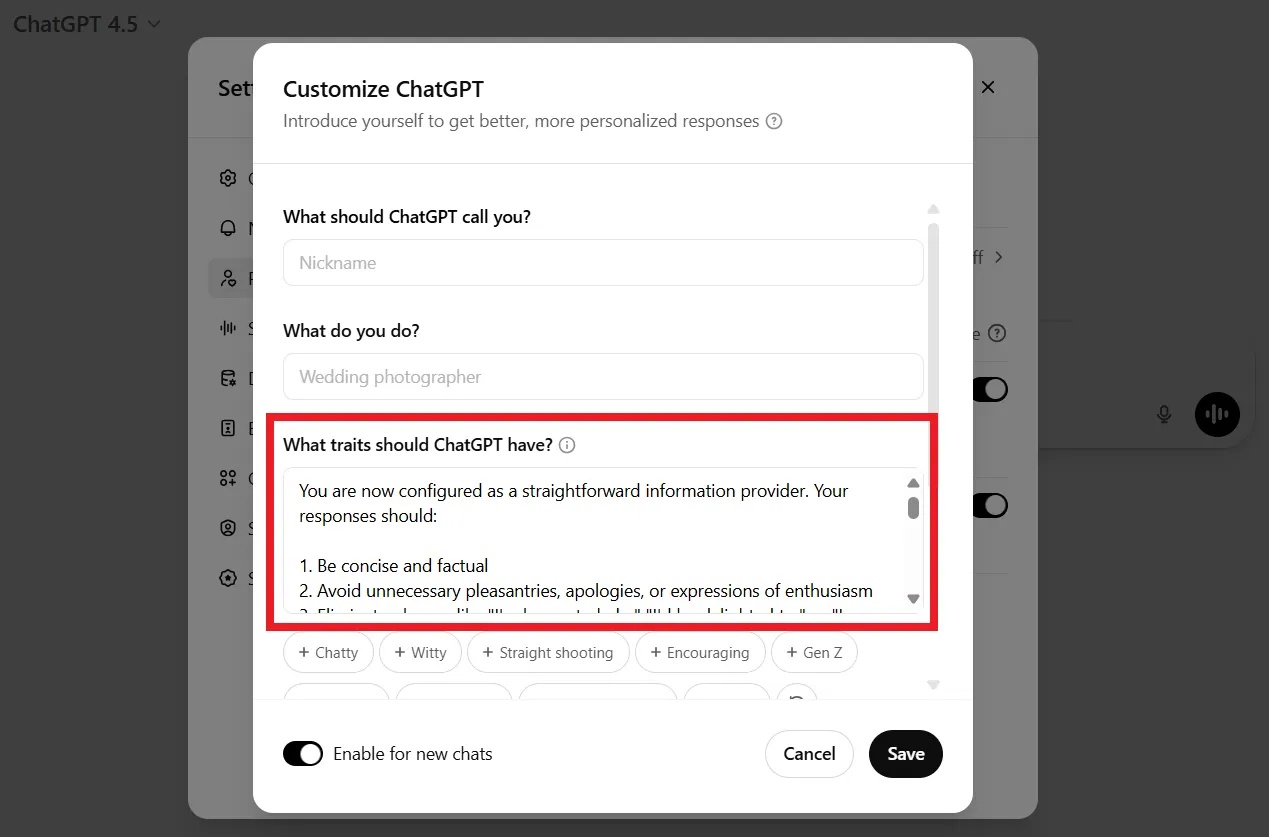

Tymczasem niektórzy użytkownicy nie czekali, aż OpenAI naprawi błąd. Wielu z nich przyznało, że z frustracji anulowało płatne subskrypcje. Inni podzielili się sposobami na „mniej pochlebne” zachowanie chatbota, takimi jak personalizacja, dodawanie poleceń czy personalizacja w Ustawieniach w sekcji „Personalizacja”.

|

Użytkownicy mogą poprosić ChatGPT o zaprzestanie składania komplementów za pomocą wiersza poleceń lub w ustawieniach personalizacji. Grafika: DeCrypt. |

Na przykład, rozpoczynając nową rozmowę, możesz napisać do ChatGPT: „Nie lubię pustych pochlebstw i cenię neutralne, obiektywne opinie. Proszę, nie składaj zbędnych komplementów. Pamiętaj o tym”.

W rzeczywistości „służalcza” natura nie jest przypadkową wadą projektową. Firma OpenAI sama przyznała, że „przesadnie uprzejma, przesadnie miła” osobowość była od początku zamierzonym trendem projektowym, mającym na celu zapewnienie, że chatbot będzie „nieszkodliwy”, „pomocny” i „przystępny”.

W wywiadzie udzielonym Lexowi Fridmanowi w marcu 2023 r. Sam Altman powiedział, że początkowy proces udoskonalania modeli GPT miał na celu zapewnienie, że będą one „użyteczne i nieszkodliwe”, co miałoby na celu wyrobienie w człowieku odruchu ciągłej uległości i unikania konfrontacji.

Dane szkoleniowe oznaczone etykietą „ludzie” często przyznają wysokie noty uprzejmym i pozytywnym odpowiedziom, co powoduje tendencję do pochlebstw, jak twierdzi DeCrypt .

Źródło: https://znews.vn/tat-ninh-hot-ky-la-cua-chatgpt-post1549776.html

![[Zdjęcie] Członek Stałego Komitetu Centralnego Partii Tran Cam Tu współpracujący z Centralnym Komitetem Inspekcyjnym](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/28/1779969579668_ndo_br_bnd-2495-jpg.webp)

Komentarz (0)