|

Chatbot-ul OpenAI este în continuă îmbunătățire prin intermediul noilor tehnologii. Foto: New York Times . |

În septembrie 2024, OpenAI a lansat ChatGPT, o versiune a inteligenței artificiale care integrează modelul o1, capabilă să raționeze în sarcini legate de matematică, știință și programare pe calculator.

Spre deosebire de versiunea anterioară a ChatGPT, noua tehnologie va necesita timp pentru a „gândi” la soluții la probleme complexe înainte de a oferi un răspuns.

După OpenAI, mulți competitori precum Google, Anthropic și DeepSeek au introdus modele de raționament similare. Deși nu este perfectă, aceasta este totuși o tehnologie de actualizare a chatbot-urilor în care mulți dezvoltatori au încredere.

Cum raționează IA

În esență, raționamentul înseamnă că chatboții pot petrece mai mult timp rezolvând problemele ridicate de utilizatori.

„Raționamentul este modul în care sistemul efectuează lucrări suplimentare după ce primește o întrebare”, a declarat pentru New York Times Dan Klein, profesor de informatică la Universitatea din California.

Un sistem logic poate descompune o problemă în pași individuali mai mici sau o poate rezolva prin încercări și erori.

Când a fost lansat pentru prima dată, ChatGPT putea răspunde instantaneu la întrebări prin extragerea și sintetizarea informațiilor. În schimb, sistemele de raționament aveau nevoie de câteva secunde (sau chiar minute) în plus pentru a rezolva problema și a oferi un răspuns.

|

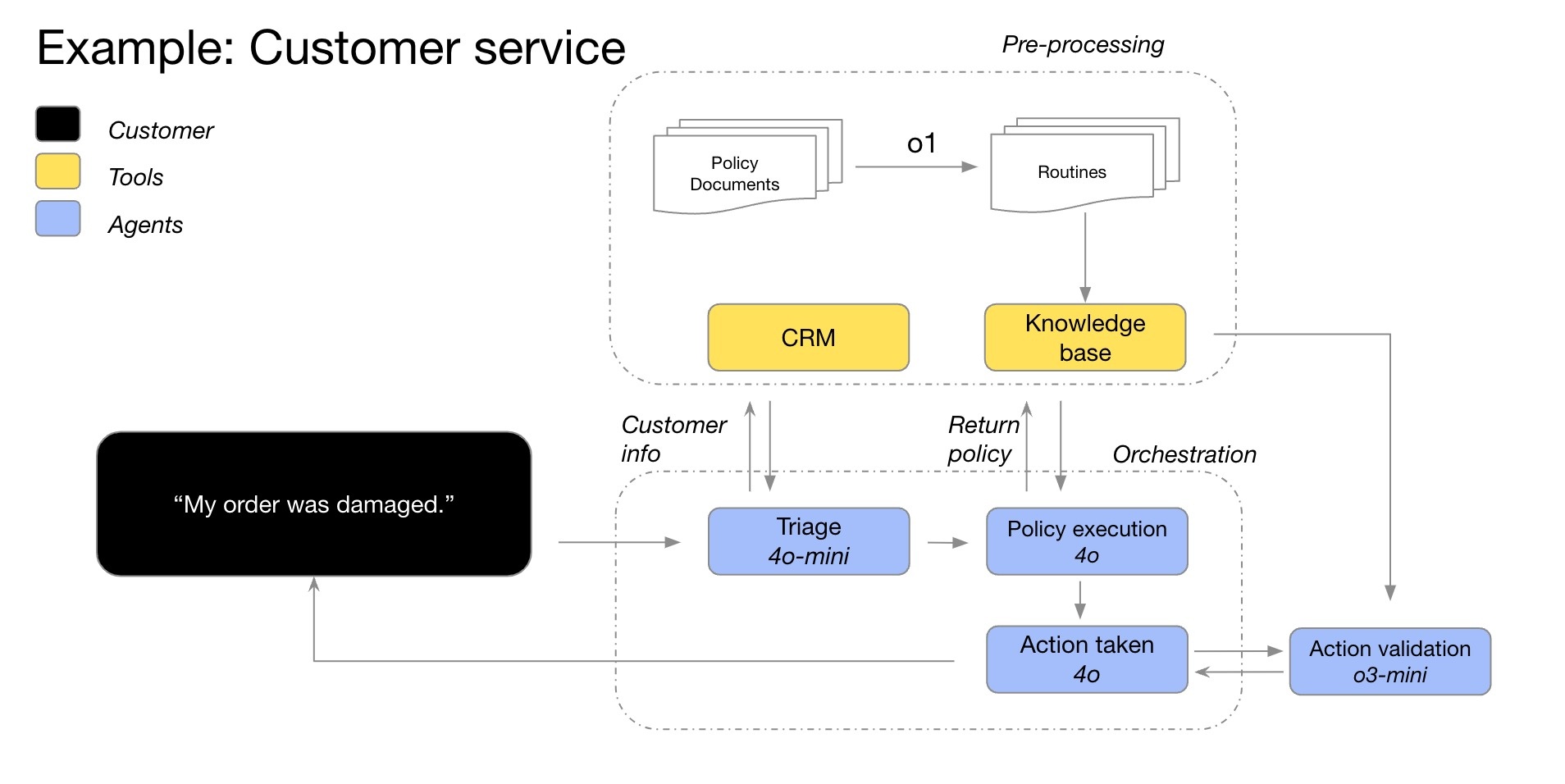

Un exemplu al procesului de raționament al modelului O1 într-un chatbot pentru servicii clienți. Imagine: OpenAI . |

În unele cazuri, sistemul de raționament își va schimba abordarea problemei, îmbunătățind continuu soluția. În plus, modelul poate testa mai multe soluții înainte de a face o alegere optimă sau poate verifica acuratețea răspunsurilor anterioare.

În general, sistemul de raționament va lua în considerare toate răspunsurile posibile la întrebare. Acest lucru este similar cu cazul elevilor de școală primară care notează mai multe opțiuni pe hârtie înainte de a alege cea mai potrivită soluție la o problemă de matematică.

Potrivit New York Times , inteligența artificială este acum capabilă să raționeze pe aproape orice subiect. Cu toate acestea, va fi cel mai eficientă cu întrebări legate de matematică, știință și programare pe calculator.

Cum este antrenat sistemul teoretic?

Pe un chatbot obișnuit, utilizatorii pot solicita în continuare explicații despre proces sau pot verifica acuratețea răspunsului. De fapt, multe seturi de date de antrenament ChatGPT includ deja proceduri de rezolvare a problemelor.

Sistemul de raționament devine și mai avansat atunci când poate efectua operațiuni fără intervenția utilizatorului. Acest proces este mai complex și mai extins. Companiile folosesc cuvântul „raționament” deoarece sistemul funcționează similar cu modul în care gândesc oamenii.

Multe companii, precum OpenAI, se așteaptă ca sistemele de raționament să fie cea mai bună soluție pentru îmbunătățirea chatboților disponibili în prezent. Ani de zile, au crezut că chatboții au performanțe mai bune cu cât sunt instruiți cu mai multe informații pe internet.

Până în 2024, sistemele de inteligență artificială vor fi utilizat aproape tot textul disponibil pe internet. Aceasta înseamnă că firmele trebuie să găsească noi soluții pentru a moderniza chatboții, inclusiv sistemele de raționament.

|

Startup-ul DeepSeek a făcut odată senzație cu modelul său de raționament care avea costuri mai mici decât OpenAI. Foto: Bloomberg . |

Încă de anul trecut, companii precum OpenAI s-au concentrat pe tehnici de învățare prin consolidare. Acest proces durează de obicei câteva luni, timp în care inteligența artificială învață comportamentul prin încercări și erori.

De exemplu, prin rezolvarea a mii de probleme, sistemul poate identifica metoda optimă pentru a ajunge la răspunsul corect. Pornind de acolo, cercetătorii construiesc mecanisme sofisticate de feedback care ajută sistemul să distingă între soluțiile corecte și cele incorecte.

„Este similar cu modul în care dresezi un câine. Dacă sistemul funcționează bine, îi oferi o recompensă. Altfel, spui: «Câinele ăla e obraznic»”, a declarat Jerry Tworek, cercetător la OpenAI.

Este IA viitorul?

Conform New York Times , tehnicile de învățare prin consolidare sunt eficiente atunci când se lucrează cu cerințe din matematică, științe și programare pe calculator. Acestea sunt domenii în care răspunsurile corecte sau incorecte pot fi definite clar.

În schimb, învățarea prin consolidare este ineficientă în scris, filosofie sau etică - domenii în care este dificil să se facă distincția între bine și rău. Cu toate acestea, cercetătorii afirmă că această tehnică poate îmbunătăți performanța inteligenței artificiale, chiar și cu întrebări non-matematice.

„Sistemele vor învăța căile care duc la rezultate pozitive și negative”, a declarat Jared Kaplan, director științific la Anthropic.

|

Site-ul web al Anthropic, startup-ul care deține modelul de inteligență artificială Claude. Fotografie: Bloomberg . |

Este important de menționat că învățarea prin consolidare și sistemele de raționament sunt două concepte diferite. Mai exact, învățarea prin consolidare este o metodă de construire a sistemelor de raționament. Aceasta este etapa finală de antrenament pentru a permite chatbot-urilor să raționeze.

Deoarece este încă relativ nou, oamenii de știință nu pot fi încă siguri dacă raționamentul prin chatbot sau învățarea prin consolidare pot ajuta inteligența artificială să gândească la fel ca oamenii. Trebuie menționat că multe dintre tendințele actuale de antrenament al inteligenței artificiale se dezvoltă foarte rapid la început și apoi încetinesc treptat.

În plus, raționamentul chatbot-urilor poate face în continuare greșeli. Pe baza probabilității, sistemul va alege procesul care seamănă cel mai mult cu datele pe care le-a învățat, fie de pe internet, fie prin învățare prin consolidare. Prin urmare, chatboții pot alege în continuare soluții incorecte sau ilogice.

Sursă: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

![[Infografic] 6 cazuri în care se aplică proceduri simplificate de faliment](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/02/27/1772207933687_info-nam-10-jpg.webp)

Comentariu (0)