DeepSeek, самый популярный китайский стартап последних дней, выразил сомнения по поводу своего заявления о создании искусственного интеллекта, сопоставимого с OpenAI, всего за 5 миллионов долларов.

В начале года Змеи компания DeepSeek получила широкое освещение в СМИ и социальных сетях, что вызвало значительные потрясения на мировых фондовых рынках.

Однако в недавнем отчете финансовой консалтинговой фирмы Bernstein содержится предупреждение о том, что, несмотря на впечатляющие достижения, утверждение о создании системы искусственного интеллекта, сравнимой с системой OpenAI, всего за 5 миллионов долларов, не соответствует действительности.

По словам Бернштейна, заявление DeepSeek вводит в заблуждение и не отражает общей картины.

«Мы считаем, что DeepSeek не „создала OpenAI за 5 миллионов долларов“; модели великолепны, но мы не считаем их чудом; и паника, разразившаяся в выходные, похоже, была преувеличена», — говорится в отчете.

Компания DeepSeek разрабатывает две основные модели искусственного интеллекта: DeepSeek-V3 и DeepSeek R1. Крупномасштабная языковая модель V3 использует архитектуру MOE, объединяя более мелкие модели для достижения высокой производительности при использовании меньших вычислительных ресурсов, чем традиционные модели.

С другой стороны, модель V3 имеет 671 миллиард параметров, при этом в любой момент времени активны 37 миллиардов параметров, и включает в себя такие инновации, как MHLA для сокращения использования памяти и использование FP8 для повышения эффективности.

Для обучения модели V3 потребовался кластер из 2048 графических процессоров Nvidia H800 в течение двух месяцев, что эквивалентно 5,5 миллионам часов работы графических процессоров. Хотя по некоторым оценкам стоимость обучения составляет приблизительно 5 миллионов долларов, в отчете Bernstein подчеркивается, что эта цифра покрывает только вычислительные ресурсы и не учитывает значительные затраты, связанные с исследованиями, тестированием и другими расходами на разработку.

Модель DeepSeek R1 основана на модели V3 и использует обучение с подкреплением (RL) и другие методы для обеспечения возможности вывода результатов.

Модель R1 может конкурировать с моделями OpenAI в задачах логического мышления. Однако Бернштейн отмечает, что разработка R1 требует значительных ресурсов, хотя в отчете DeepSeek эти данные не приводятся подробно.

Комментируя DeepSeek, Бернштейн высоко оценил модели, назвав их впечатляющими. Например, модель V3 показывает результаты не хуже, а то и лучше, чем другие основные языковые модели в лингвистике, программировании и математике, при этом требуя меньше ресурсов.

Для процесса предварительного обучения модели V3 потребовалось всего 2,7 миллиона часов работы графического процессора, что составляет 9% вычислительных ресурсов некоторых других моделей высшего уровня.

Бернштейн пришел к выводу, что, хотя достижения DeepSeek заслуживают внимания, следует остерегаться преувеличенных заявлений. Идея создания конкурента OpenAI всего за 5 миллионов долларов кажется ошибочной.

(По данным газеты Times of India)

Источник: https://vietnamnet.vn/deepseek-khong-the-lam-ai-tuong-duong-openai-voi-5-trieu-usd-2367340.html

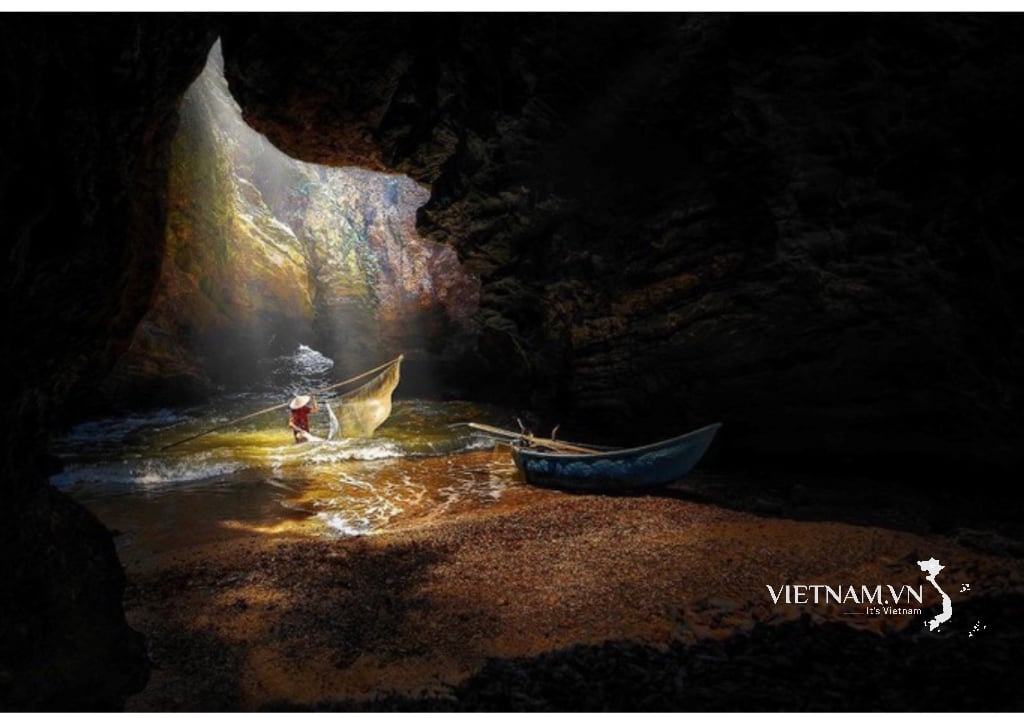

![[Фото] Премьер-министр Фам Минь Чинь принимает участие в конференции по реализации задач промышленного и торгового сектора на 2026 год.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

Комментарий (0)