Attackera från alla vinklar.

Google har lanserat en ny produkt för artificiell intelligens (AI) som heter "Gemini Nano Banana", som inte är en storskalig språklig AI (LLM) som kan skriva och resonera, utan snarare en AI som specialiserar sig på fotoredigering... Många användare är entusiastiska över det här verktyget, men det medför också ett antal nackdelar.

”Det är som ett ’steg bakåt’ inom AI-teknik och etiska begränsningar”, sa Nguyen Hong Phuc, vetenskaplig chef på Conductify AI, och uttryckte sin personliga åsikt. ”Gemini Nano Banana har effektiva bildredigeringsfunktioner. Men Googles avcensurering av Gemini Nano Banana, som lättar på barriärer och begränsande mekanismer, gör att denna AI kan skapa bilder som är otroligt lika kändisbilder, suggestiva bilder, känsliga bilder etc.”, sa Phuc.

Enligt Nguyen Hong Phuc gör denna funktion Gemini Nano Banana till ett verktyg för att skapa realistiska falska bilder, i en sådan grad att även AI-experter inte kan skilja dem åt, vilket leder till nya risker för bedrägerier och cybersäkerhet, såsom att skapa falska foton med kända politiker för att sprida falsk information, och till och med individer som utsätts för AI-genererad fotomanipulation och förtal på sociala medier...

Dessutom, med dussintals andra AI-fotoredigeringsverktyg som tar internet med storm, visar deepfakes-bedrägerier inga tecken på att sluta. Statistik från säkerhetsorganisationer visar att deepfake-teknik skapar nätfiskekampanjer som riktar sig mot värdefulla individer, särskilt företagsledare. År 2024 fanns det 140 000–150 000 fall globalt, varav 75 % riktade sig mot VD:ar och högre chefer... Deepfakes kan öka de globala ekonomiska förlusterna med 32 %, cirka 40 miljarder dollar per år, fram till 2027.

Nyligen upptäckte och avvärjde AI-företaget Anthropic en cyberattackkampanj utförd av utländska hackare, som för första gången registrerade användningen av AI för att koordinera automatiserade attackaktiviteter. Hackarna använde specifikt AI-system för att planera, styra och driftsätta intrångsoperationer – en "oroande" utveckling som riskerar att öka omfattningen och hastigheten på cyberattackkampanjer...

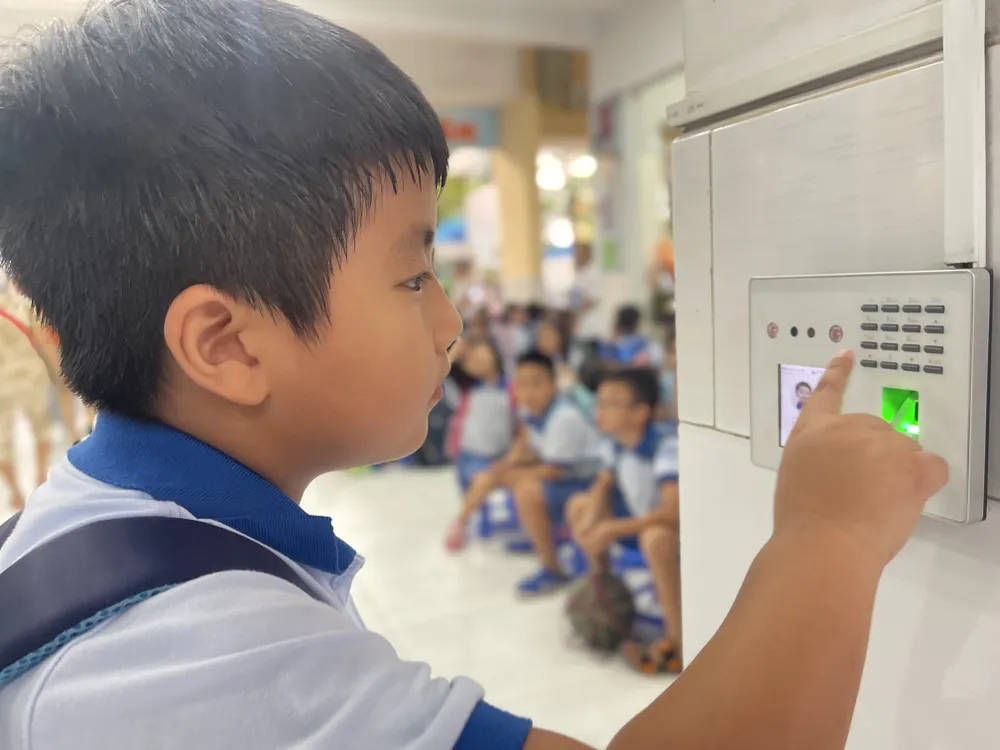

Herr Ngo Minh Hieu, chef för bedrägeribekämpningsorganisationen inom National Cybersecurity Association, berättade att AI-integrerade verktyg ökar hastigheten på bedrägerier med cirka 20 gånger jämfört med att använda riktiga människor. Bedragare förser AI:n med ett bedrägeriscenario för analys, och systemet chattar omedelbart automatiskt med offren. Från den initiala datan kan AI:n förstå vad offret vill och kommunicera med dem i realtid. Den mest sofistikerade taktiken är "Man-in-the-Middle"-attacken, där hackaren, när en användare utför videoautentisering (som att spela in sitt ansikte eller ge kommandon), ingriper för att störa den överförda datan. Cyberbrottslingar infogar sedan förberedda deepfake-videor och ersätter användarens verkliga dataström för att kringgå autentiseringsprocessen. Med denna metod riskerar även bankers och finansinstituts säkerhetssystem att bli lurade.

Bättre datahantering

I takt med att AI blir allt vanligare ökar även säkerhets- och integritetsriskerna avsevärt. Data som lagras och bearbetas på fjärrservrar kommer att bli ett attraktivt mål för hackare och cyberbrottslingar. Enligt data från National Cyber Security Association ökade antalet AI-drivna cyberattacker med 62 % enbart under andra kvartalet 2025, vilket orsakade globala förluster på upp till 18 miljarder dollar...

Experter anser att dataskydd är avgörande. Insamling och försäljning av data fortsätter dock öppet på många "svarta marknads"-plattformar, för så lite som 20 dollar per månad. Cyberbrottslingar kan använda verktyg som härmar språkmodeller men är anpassade för kriminella ändamål. Dessa verktyg kan generera skadlig programvara och till och med kringgå antivirusprogram.

I Vietnam reglerar dekret nr 13/2023/ND-CP (gäller från och med den 17 april 2023) skyddet av personuppgifter. Dessutom kommer lagen om skydd av personuppgifter, som förväntas träda i kraft den 1 januari 2026, att öppna upp en starkare rättslig mekanism för att hantera risken för läckage och missbruk av personuppgifter. Enligt National Cybersecurity Association behöver dock effektiviteten i verkställigheten fortfarande stärkas inom tre pelare: öka allmänhetens medvetenhet, öka företagsansvaret och förbättra tillsynsmyndigheternas bearbetningskapacitet. Utöver tekniska åtgärder måste varje individ utveckla förmågan att identifiera ovanliga och misstänkta tecken och proaktivt skydda sig mot farliga digitala interaktioner...

Kaspersky har varnat för utnyttjandet av mörk AI (en term som hänvisar till distribution av stora språkmodeller (LLM) som fungerar utanför standard säkerhetskontroller, vilket ofta möjliggör åtgärder som nätfiske, manipulation, cyberattacker eller datamissbruk). Organisationer och individer måste förbereda sig för att möta alltmer sofistikerade och svårupptäckta cyberattacker på grund av uppkomsten av mörk AI i Asien-Stillahavsområdet.

Sergey Lozhkin, chef för det globala forsknings- och analysteamet (GReAT) för Mellanöstern, Turkiet, Afrika och Asien-Stillahavsområdet på Kaspersky, berättade att en manifestation av nuvarande AI-missbruk är framväxten av Black Hat GPT-modeller. Dessa är AI-modeller som är specifikt utvecklade eller modifierade för att tjäna oetiska och olagliga syften, såsom att skapa skadlig programvara, skapa flytande och övertygande nätfiskemejl för storskaliga attacker, skapa deepfake-röster och -videor, och till och med stödja simulerade attacker.

Kaspersky-experter rekommenderar att individer och företag använder nästa generations säkerhetslösningar för att upptäcka AI-genererad skadlig kod, samtidigt som de prioriterar dataskydd. Företag bör implementera övervakningsverktyg i realtid för att spåra AI-driven sårbarhetsexploatering; stärka åtkomstkontroll och personalutbildning för att begränsa AI i den mörka zonen och risken för dataläckor; och etablera ett cybersäkerhetsoperationscenter för att övervaka hot och reagera snabbt på incidenter.

Källa: https://www.sggp.org.vn/bao-mat-du-lieu-thoi-ai-post824210.html

![[Video] Solnedgång vid Lap An-lagunen – Där solen går ner över fiskenäten](https://vphoto.vietnam.vn/thumb/340x192/vietnam/resource/IMAGE/2026/05/31/1780192137701_beach-landscape-sea-water-nature-grass-745871-pxhere-com.jpeg)

![[Foto] Generalsekreteraren, presidenten och hans fru lägger blommor vid Ho Chi Minh-monumentet i Manila.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780219759477_anh-man-hinh-2026-05-31-luc-16-29-07.png)

Kommentar (0)