Auf der jüngsten Google I/O-Veranstaltung hat Google Gemini 1.5 vorgestellt – ein Modell für künstliche Intelligenz (KI) mit vielen neuen Funktionen, darunter die Möglichkeit, Code, Text, Audioaufnahmen und Videos mit längerer Dauer als die vorherige Version zu analysieren.

Erkennen verdächtiger Wörter

Insbesondere wird erwartet, dass Gemini 1.5 Pro in naher Zukunft in Gmail, Google Docs usw. integriert wird und als Multifunktionstool in Workspace Nutzern hilft, Informationen aus Drive zu sammeln. Ein weiteres KI-Modell ist Gemini Live, das Nutzern die Interaktion mit Smartphones mit natürlicher Stimme ermöglicht. Auf dieser Veranstaltung sorgte Google mit der Einführung eines KI-Modells namens Gemini Nano für Android-Smartphones. Es erkennt verdächtige Wörter in Gesprächen und hilft Nutzern, betrügerische Anrufe zu erkennen. Gemini Nano ist bereits in Pixel 8 Pro und der Galaxy S24-Serie integriert.

Nutzer teilen ihre Meinung in sozialen Netzwerken und erwarten, dass Gemini Nano auf Android-Geräten zunehmend an Popularität gewinnt. Einige Nutzer äußerten jedoch Bedenken, dass Anrufdaten offengelegt werden könnten, wenn Google entsprechende Berechtigungen erteilt. Google erklärte hierzu, dass Anrufdaten geschützt und nur auf dem Telefon des Nutzers gespeichert seien. Nutzer können die Funktion anpassen, um die Warnung vor betrügerischen Anrufen zu aktivieren/deaktivieren. Gemini Nano arbeitet unabhängig, stellt keine Internetverbindung her und kann weder von Google noch von Dritten abgerufen werden.

OpenAI kündigte zuvor ein neues KI-Modell namens GPT-4o an, das die Leistung von ChatGPT um das Fünffache steigert. Durch optimierte Algorithmen und Trainingsmethoden liefert GPT-4o präzisere Antworten und gewährleistet eine hohe Konsistenz auch bei langen Gesprächen. Häufige Fehler werden minimiert und das Kontextverständnis verbessert, wodurch das Modell präziser auf komplexe Fragen reagieren kann. Laut OpenAI gewährleistet die GPT-4o-Schnittstelle die sichere Verarbeitung von Interaktionen und persönlichen Daten zwischen Nutzern und KI. Meta, die Muttergesellschaft von Facebook und Instagram, kündigte an, die Entwicklung der Business-Plattform Workplace einzustellen und sich stattdessen auf die Entwicklung von KI-Produkten und des virtuellen Universums Metaverse zu konzentrieren. Laut der Technologiewelt werden Metas kommende KI-Projekte Nutzern ein besseres Erlebnis mit einer personalisierten Werbeplattform, passenden Inhaltsempfehlungen, Live-Übersetzung in viele Sprachen usw. bieten. Gleichzeitig werden Datenschutzrichtlinien zum Schutz von Nutzerdaten entwickelt.

Microsoft stellte kürzlich eine neue Funktion namens „Recall“ vor – den AI Explorer. Dieses KI-Tool ist in den Copilot Plus integriert und hilft Nutzern, alle Aktivitäten auf dem Computer zu verfolgen, vom Surfen im Internet bis zum Voice-Chat. Es speichert einen Verlauf auf dem Computer, den Nutzer durchsuchen können, wenn sie sich an vorherige Aktivitäten erinnern müssen. Darüber hinaus stellt Recall Daten in einer visuellen Zeitleiste dar, sodass Nutzer alle Aktivitäten auf dem Computer bequem durchsuchen underkunden können. Die zugehörige Funktion „Live Captions“ unterstützt Nutzer bei der Suche nach Online-Meetings und Videos sowie bei der bequemen Transkription und Übersetzung von Sprache. Microsoft verspricht, dass Recall privat auf dem Gerät läuft, sodass Nutzerdaten geschützt sind. Nutzer können aufgezeichnete Inhalte pausieren, stoppen oder löschen oder bestimmte Anwendungen oder Websites ausschließen.

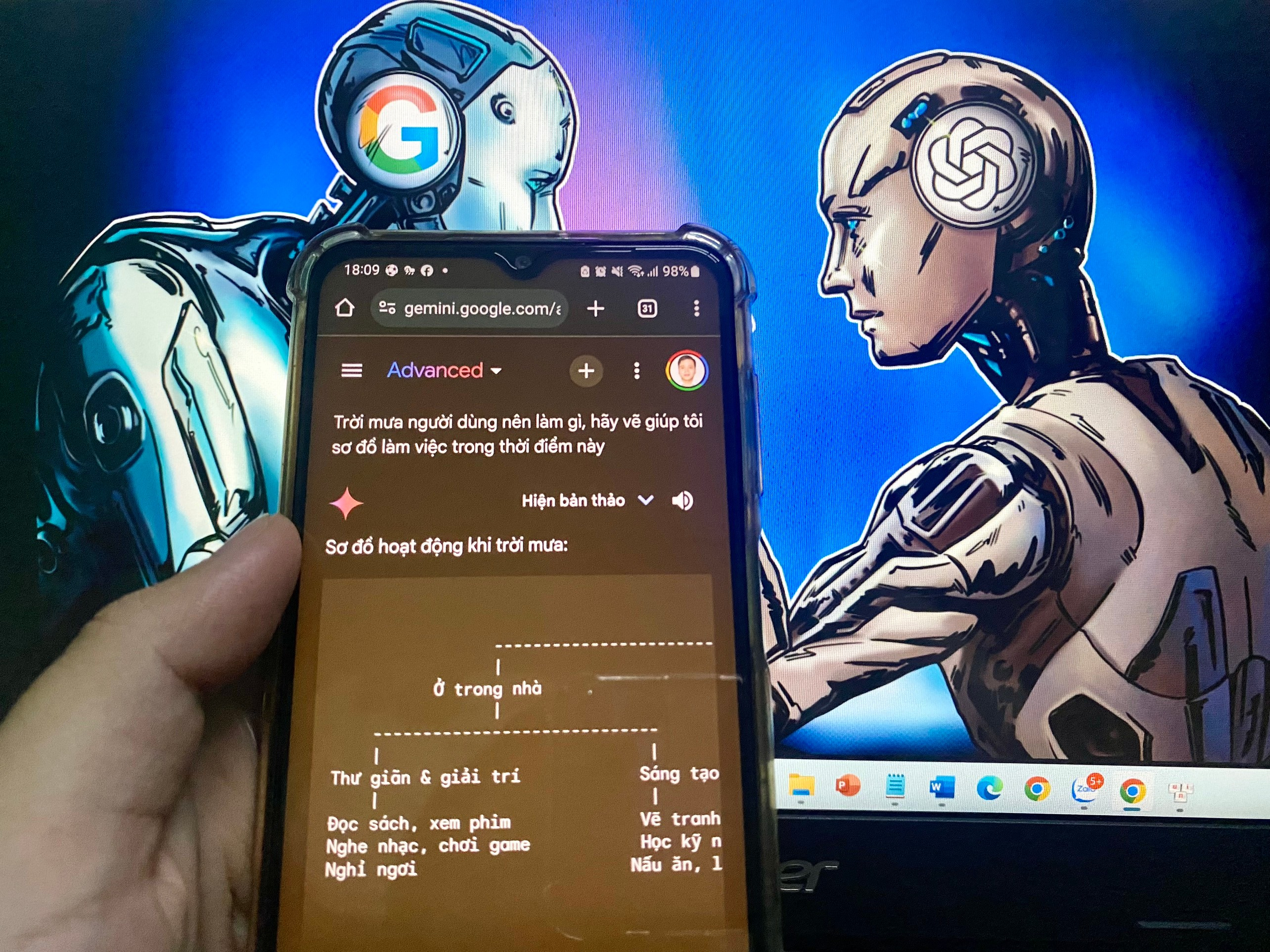

Gemini 1.5pro beantwortet Benutzerfragen in Form von Diagrammen in nur wenigen Sekunden. Foto AI: Le Tinh

Erinnern, warnen Sie Benutzer

Laut Sicherheitsexperte Pham Dinh Thang hat die Interaktion mit Nutzern die Intelligenz der KI erhöht. Daher wird sich das KI-Modell kontinuierlich stark verändern und rationalisieren, was jedoch auch das Risiko für Nutzer erhöht, beispielsweise durch Gesichtsfälschung (Deepfake), und die Stimme wird aufgrund ihrer hohen Authentizität schwieriger zu erkennen sein.

Daher müssen sich Technologieunternehmen wie Google oder ChatGPT auf den Schutz der Daten ihrer Nutzer konzentrieren. „Sie können den Datenschutzverpflichtungen von Technologieunternehmen nicht uneingeschränkt vertrauen. Nutzer müssen sich selbst schützen. Besuchen Sie keine fremden KI-Websites unbekannter Herkunft, da die Malware-Rate sehr hoch ist. Greifen Sie nicht auf Informationen zu, die Sie nicht betreffen. Informieren Sie sich regelmäßig über KI-Betrugstricks“, empfiehlt Herr Thang. Huynh Trong Thua, Experte für Informationssicherheit, erklärte, dass sich Nutzer bei der Nutzung von KI-Produkten nicht allzu viele Sorgen um ihre Daten machen sollten, da die personenbezogenen Daten der Unternehmen zu Analysezwecken erhoben werden, um Warnungen und geeignete Schlüsselwörter bereitzustellen und so das Erlebnis zu personalisieren. „Die Betrugsrate wird deutlich sinken, sobald Google und OpenAI neue Modelle anwenden. Die Betrugswarnung ist eine eindringliche Mahnung, die Nutzer vor Betrügern innehalten lässt“, so Herr Thua.

Laut Technologieexperten setzen Technologieunternehmen tendenziell modernere Verschlüsselungen zum Schutz von Nutzerdaten ein. Gleichzeitig haben Nutzer mit aktualisierten Versionen mehr Kontrolle über ihre persönlichen Daten. Sie können sie verwalten, bearbeiten und löschen, indem sie der Plattform die Nutzung erlauben.

Experten zufolge müssen Regulierungsbehörden angesichts der Bedenken hinsichtlich des Einsatzes von KI-Tools für Betrugsfälle sorgfältig über die Entwicklung von Richtlinien sowie flexiblen Kontroll- und Managementmechanismen für den Einsatz von KI-Tools nachdenken. Dies schafft die Voraussetzungen für eine nachhaltige und verantwortungsvolle Entwicklung von KI-Anwendungen.

[Anzeige_2]

Quelle: https://nld.com.vn/ai-nang-cap-giup-phat-hien-bat-thuong-196240521203710228.htm

![[Foto] Panorama der Eröffnungszeremonie des Nationalen Pressefestivals 2025](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/20/6b835ee92c2c4df587af73cb2d1f4f5f)

![[Foto] Generalsekretär To Lam leitet die 14. Konferenz der Zentralen Militärkommission](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/20/a9d25fc6dd664fb9a3757502f32e5db0)

![[Maritime News] Wan Hai Lines investiert 150 Millionen US-Dollar in den Kauf von 48.000 Containern](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/20/c945a62aff624b4bb5c25e67e9bcc1cb)

Kommentar (0)