Μετά την κυκλοφορία της πρώτης εφαρμογής τεχνητής νοημοσύνης από την νεοσύστατη εταιρεία OpenAI, ChatGPT, στα τέλη του 2022, πυροδοτήθηκε ένα κύμα ανάπτυξης εφαρμογών τεχνητής νοημοσύνης, ιδίως της παραγωγικής τεχνητής νοημοσύνης, που έφερε πολλά οφέλη σε όλες τις πτυχές της ζωής. Ωστόσο, αυτό συνεπάγεται και πολλούς κινδύνους.

Παραβίαση της ιδιωτικότητας

Τα τελευταία χρόνια, πολλοί οργανισμοί και άτομα έχουν υποστεί σημαντικές απώλειες, καθώς οι κυβερνοεγκληματίες έχουν χρησιμοποιήσει την Τεχνητή Νοημοσύνη για να δημιουργήσουν ψεύτικα βίντεο κλιπ που μιμούνται εικόνες και φωνές πραγματικών ανθρώπων. Ένα χαρακτηριστικό παράδειγμα αυτού είναι η απάτη Deepfake, η οποία περιλαμβάνει την εξαπάτηση του πραγματικού ατόμου ώστε να πιστέψει ότι είναι αληθινό.

Σύμφωνα με την Έκθεση για την Απάτη Ταυτότητας που δημοσιεύθηκε από την Sumsub στα τέλη Νοεμβρίου 2023, οι απάτες deepfake δεκαπλασιάστηκαν παγκοσμίως κατά τη διάρκεια των δύο ετών μεταξύ 2022 και 2023. Αυτή ήταν επίσης η περίοδος κατά την οποία οι εφαρμογές που δημιουργούνται από τεχνητή νοημοσύνη εκτοξεύτηκαν παγκοσμίως .

Η Status Labs σημειώνει ότι η τεχνολογία Deepfake έχει επηρεάσει σημαντικά τον πολιτισμό, την ιδιωτικότητα και την προσωπική φήμη. Μεγάλο μέρος των ειδήσεων και της προσοχής γύρω από το Deepfake έχει επικεντρωθεί στην πορνογραφία διασημοτήτων, το περιεχόμενο εκδίκησης, την παραπληροφόρηση, τα ψεύτικα νέα, τον εκβιασμό και τις απάτες. Για παράδειγμα, το 2019, μια αμερικανική εταιρεία ενέργειας υπέστη απάτη ύψους 243.000 δολαρίων από χάκερ που μιμούνταν τους ηγέτες της εταιρείας και τις φωνές τους, απαιτώντας από τους υπαλλήλους να μεταφέρουν χρήματα σε συνεργάτες.

Το Reuters ανέφερε ότι το 2023, περίπου 500.000 αρχεία βίντεο και ήχου Deepfake κοινοποιήθηκαν στα μέσα κοινωνικής δικτύωσης παγκοσμίως. Εκτός από τα Deepfakes που δημιουργήθηκαν για διασκέδαση, υπάρχουν επίσης απάτες που έχουν σχεδιαστεί από κακόβουλους παράγοντες για να παραπλανήσουν το κοινό. Ορισμένες πηγές αναφέρουν ότι το 2022, οι απάτες Deepfake παγκοσμίως προκάλεσαν ζημίες ύψους περίπου 11 εκατομμυρίων δολαρίων.

Πολλοί ειδικοί στον τομέα της τεχνολογίας έχουν προειδοποιήσει για τα μειονεκτήματα της Τεχνητής Νοημοσύνης, συμπεριλαμβανομένων ζητημάτων δικαιωμάτων πνευματικής ιδιοκτησίας και αυθεντικότητας, και περαιτέρω, για τις διαφορές πνευματικής ιδιοκτησίας μεταξύ «έργων» που δημιουργούνται από την Τεχνητή Νοημοσύνη. Για παράδειγμα, κάποιος μπορεί να χρησιμοποιήσει την Τεχνητή Νοημοσύνη για να ζωγραφίσει μια εικόνα σε ένα συγκεκριμένο θέμα και ένα άλλο άτομο μπορεί επίσης να χρησιμοποιήσει την Τεχνητή Νοημοσύνη για να κάνει το ίδιο, με αποτέλεσμα πίνακες με πολλές ομοιότητες.

Αυτό εύκολα οδηγεί σε διαφορές ιδιοκτησίας. Ωστόσο, μέχρι σήμερα, ο κόσμος δεν έχει ακόμη αποφασίσει σχετικά με την αναγνώριση πνευματικών δικαιωμάτων για περιεχόμενο που δημιουργείται από Τεχνητή Νοημοσύνη (αναγνώριση πνευματικών δικαιωμάτων για άτομα που αναθέτουν τη δημιουργία Τεχνητής Νοημοσύνης ή για εταιρείες που αναπτύσσουν εφαρμογές Τεχνητής Νοημοσύνης).

Μια εικόνα που δημιουργήθηκε από μια εφαρμογή τεχνητής νοημοσύνης.

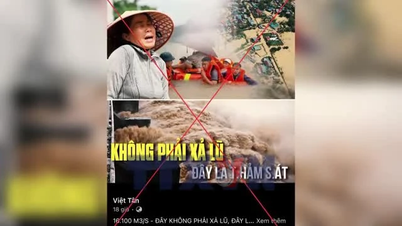

Είναι δύσκολο να διακρίνει κανείς μεταξύ γνήσιου και ψεύτικου.

Μπορεί, λοιπόν, το περιεχόμενο που δημιουργείται από την Τεχνητή Νοημοσύνη να παραβιάζει τα πνευματικά δικαιώματα; Τεχνολογικά, το περιεχόμενο που δημιουργείται από την Τεχνητή Νοημοσύνη συντίθεται από αλγόριθμους από δεδομένα στα οποία έχουν εκπαιδευτεί. Αυτές οι βάσεις δεδομένων συλλέγονται από προγραμματιστές εφαρμογών Τεχνητής Νοημοσύνης από διάφορες πηγές, κυρίως από την τεράστια βάση γνώσεων στο διαδίκτυο. Πολλά από αυτά τα έργα προστατεύονται ήδη από πνευματικά δικαιώματα στους κατόχους τους.

Στις 27 Δεκεμβρίου 2023, οι New York Times κατέθεσαν αγωγή κατά της OpenAI (μαζί με την ChatGPT) και της Microsoft, ισχυριζόμενες ότι εκατομμύρια άρθρα της είχαν χρησιμοποιηθεί για την εκπαίδευση chatbots τεχνητής νοημοσύνης και πλατφορμών τεχνητής νοημοσύνης από αυτές τις δύο εταιρείες. Τα αποδεικτικά στοιχεία που παρουσιάστηκαν περιελάμβαναν περιεχόμενο που δημιουργήθηκε από τα chatbots κατόπιν αιτήματος του χρήστη, το οποίο ήταν παρόμοιο ή πανομοιότυπο με το περιεχόμενο των άρθρων. Η εφημερίδα δεν μπορούσε να αγνοήσει το γεγονός ότι η πνευματική της ιδιοκτησία χρησιμοποιούνταν από αυτές τις εταιρείες για κέρδος.

Οι New York Times είναι η πρώτη μεγάλη αμερικανική εφημερίδα που καταθέτει αγωγή για παραβίαση πνευματικών δικαιωμάτων σχετικά με την Τεχνητή Νοημοσύνη. Είναι πιθανό και άλλες εφημερίδες να υποβάλουν μήνυση στο μέλλον, ειδικά μετά την επιτυχημένη υπόθεση των New York Times.

Προηγουμένως, η OpenAI είχε συνάψει συμφωνίες αδειοδότησης με το Associated Press τον Ιούλιο του 2023 και με την Axel Springer - τον γερμανικό εκδότη που κατέχει τα Politico και Business Insider - τον Δεκέμβριο του 2023.

Η ηθοποιός Σάρα Σίλβερμαν ενεπλάκη επίσης σε αρκετές αγωγές τον Ιούλιο του 2023, ισχυριζόμενη ότι η Meta και η OpenAI χρησιμοποίησαν τα απομνημονεύματά της ως εκπαιδευτικό υλικό για προγράμματα Τεχνητής Νοημοσύνης. Πολλοί συγγραφείς έχουν επίσης εκφράσει ανησυχία μετά από αποκαλύψεις ότι τα συστήματα Τεχνητής Νοημοσύνης έχουν απορροφήσει δεκάδες χιλιάδες βιβλία στις βάσεις δεδομένων τους, οδηγώντας σε αγωγές από συγγραφείς όπως ο Τζόναθαν Φράνζεν και ο Τζον Γκρίσαμ.

Εν τω μεταξύ, η Getty Images, μια εταιρεία παροχής φωτογραφικών υπηρεσιών, έχει επίσης μηνύσει μια εταιρεία τεχνητής νοημοσύνης για τη δημιουργία εικόνων με βάση γραπτά μηνύματα, φερόμενη μέσω μη εξουσιοδοτημένης χρήσης του υλικού εικόνας της εταιρείας που προστατεύεται από πνευματικά δικαιώματα.

Οι χρήστες ενδέχεται να αντιμετωπίσουν προβλήματα πνευματικών δικαιωμάτων όταν χρησιμοποιούν «απρόσεκτα» «έργα» που έχουν αναθέσει σε εργαλεία τεχνητής νοημοσύνης. Οι ειδικοί συμβουλεύουν πάντα τη χρήση εργαλείων τεχνητής νοημοσύνης μόνο για έρευνα, συλλογή δεδομένων και προτάσεις για σκοπούς αναφοράς.

Σε ένα άλλο ζήτημα, οι εφαρμογές τεχνητής νοημοσύνης μπερδεύουν τους χρήστες, δυσχεραίνοντας τη διάκριση μεταξύ γνήσιου και ψεύτικου περιεχομένου. Οι εκδότες και τα γραφεία σύνταξης ενδέχεται να μπερδευτούν όταν λαμβάνουν χειρόγραφα. Οι εκπαιδευτικοί αντιμετωπίζουν επίσης δυσκολίες στο να γνωρίζουν εάν η εργασία των μαθητών έχει χρησιμοποιήσει τεχνητή νοημοσύνη.

Η κοινότητα θα πρέπει πλέον να είναι πιο προσεκτική, επειδή είναι δύσκολο να διακρίνει κανείς μεταξύ πραγματικού και ψεύτικου περιεχομένου. Για παράδειγμα, θα είναι δύσκολο για τον μέσο άνθρωπο να εντοπίσει εάν μια φωτογραφία έχει παραποιηθεί ή υποστεί επεξεργασία από την Τεχνητή Νοημοσύνη.

Απαιτούνται νομικές ρυθμίσεις σχετικά με τη χρήση της Τεχνητής Νοημοσύνης.

Εν αναμονή της ανάπτυξης εργαλείων ικανών να ανιχνεύουν παρεμβολές από την Τεχνητή Νοημοσύνη, οι ρυθμιστικοί φορείς πρέπει να θεσπίσουν σαφείς και συγκεκριμένους νομικούς κανονισμούς σχετικά με τη χρήση αυτής της τεχνολογίας για τη δημιουργία πρωτότυπου περιεχομένου. Αυτοί οι κανονισμοί θα πρέπει να υποδεικνύουν με σαφήνεια στο κοινό ποιο περιεχόμενο ή έργα έχουν παραποιηθεί από την Τεχνητή Νοημοσύνη, για παράδειγμα, προσθέτοντας εξ ορισμού ένα υδατογράφημα σε εικόνες που έχουν υποβληθεί σε επεξεργασία από την Τεχνητή Νοημοσύνη.

[διαφήμιση_2]

Πηγή: https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[Φωτογραφία] Ο Πρωθυπουργός Φαμ Μινχ Τσινχ παρευρίσκεται στη Διάσκεψη για την Υλοποίηση των Καθηκόντων για το 2026 του Τομέα Βιομηχανίας και Εμπορίου](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

![[INFOGRAPHIC] Το Legion Go Gen 2 θέτει νέα πρότυπα για τα παιχνίδια.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/19/1766146888809_info-taycamgames-02-jpg.webp)

Σχόλιο (0)