Según el delegado Pham Trong Nghia, es necesario construir pronto un corredor legal sobre inteligencia artificial (IA) para que Vietnam no se convierta en un campo de pruebas para productos tecnológicos de alto riesgo.

"Debe existir una ley o resolución que estipule principios y mecanismos legales para la realización de pruebas controladas de la creación de entornos de prueba (para probar nuevas tecnologías y nuevos modelos de negocio cuando aún no se conoce la gestión) en cada industria y campo específico", dijo el Sr. Nghia al comentar sobre el programa propuesto de elaboración de leyes y ordenanzas la mañana del 23 de mayo.

Como secretario del Consejo Científico de la Fundación Nacional para el Desarrollo de la Ciencia y la Tecnología, el Sr. Nghia considera que el marco legal debe regular los derechos y obligaciones de los propietarios de dispositivos inteligentes como robots, vehículos autónomos y drones. Un sistema legal completo e integral es indispensable para que Vietnam no se quede rezagado en la cuarta revolución industrial, aproveche proactivamente las oportunidades y prevenga los riesgos.

El delegado Pham Trong Nghia interviene en el salón de la Asamblea Nacional la mañana del 23 de mayo. Foto: Prensa de la Asamblea Nacional

Según él, la resolución del Politburó de 2019 exige la mejora de las instituciones para facilitar la participación proactiva en la cuarta revolución industrial y el proceso nacional de transformación digital. El Politburó también solicitó la pronta promulgación de un marco institucional para la realización de pruebas controladas de las nuevas tecnologías, productos, servicios y modelos de negocio que surjan de la cuarta revolución industrial. En 2019, el Gobierno ordenó el desarrollo de un mecanismo de pruebas controladas para las actividades de tecnología financiera, pero aún no se ha promulgado.

El Sr. Nghia afirmó que, si bien no existe un marco legal global común, algunos países y regiones han promulgado regulaciones para crear un entorno propicio que permita encaminar la cuarta revolución industrial, promover la innovación y prevenir, controlar y limitar los riesgos. En el sector privado, conscientes del riesgo de que la IA se descontrole, desde el 22 de marzo, numerosas personas en todo el mundo se han sumado a una carta abierta en la que solicitan la suspensión, durante seis meses, del desarrollo de cualquier sistema más potente que GPT-4.

Uno de los objetivos de esta moratoria es permitir que los desarrolladores de IA y los responsables políticos establezcan rápidamente sistemas de gobernanza eficaces. "Hasta anoche, había 27.500 firmantes, entre ellos muchas personas con un profundo conocimiento e influencia global en el campo de la tecnología", dijo el Sr. Nghia.

El delegado Pham Trong Nghia interviene en el Parlamento la mañana del 23 de mayo. Vídeo: Televisión de la Asamblea Nacional

La delegada Nguyen Thi Kim Anh (miembro permanente del Comité de Ciencia, Tecnología y Medio Ambiente) afirmó que se prevé que la Ley de Ciencia y Tecnología se incluya en la agenda del Gobierno para el período 2022-2025. Sin embargo, muchas disposiciones de la ley de 2028 presentan deficiencias, como las relativas a su aplicación, los mecanismos de incentivos para el desarrollo y los fondos destinados al desarrollo científico y tecnológico para las empresas. Por consiguiente, sugirió que los organismos competentes consideren con prontitud la modificación de la Ley de Ciencia y Tecnología.

La inteligencia artificial (IA) es el «pensamiento» de las máquinas, mediante el cual los dispositivos imitan la forma natural de pensar de los humanos para resolver problemas. En la revolución industrial 4.0, la IA es uno de los factores clave.

El año pasado, OpenAI y otras empresas comenzaron a implementar herramientas que aprovechan el siguiente paso en el aprendizaje automático, llamado IA generativa. Estas herramientas se entrenan con billones de imágenes y texto de internet, lo que les permite generar contenido a partir de peticiones sencillas del usuario, escribir código y hablar como personas reales.

Desde entonces, se han desatado acalorados debates en el mundo tecnológico sobre la posibilidad de que la IA supere a los humanos y destruya a la humanidad. «La IA podría causar un daño significativo al mundo», declaró Sam Altman, CEO de OpenAI, durante una audiencia en el Congreso de Estados Unidos a mediados de mayo.

“Las grandes empresas tecnológicas compiten por desarrollar máquinas cada vez más inteligentes sin ningún tipo de supervisión”, afirmó Anthony Aguirre, director del Future of Life Institute (FLI), una organización fundada en 2014 para estudiar las amenazas existenciales a la sociedad.

Escrito por Tuan - Son Ha

Enlace de origen

![[Foto] Feria de Otoño 2025 y récords impresionantes](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

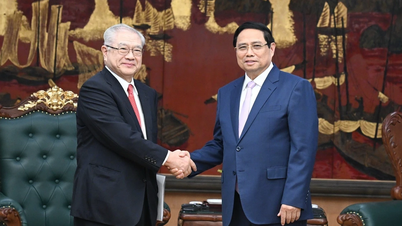

![[Foto] El primer ministro Pham Minh Chinh recibe al presidente de la Asociación de Amistad Japón-Vietnam en la región de Kansai.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

![[Foto] El secretario general To Lam recibe al embajador de Singapur, Jaya Ratnam](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

![[Foto] Lam Dong: Primer plano de un lago ilegal con un muro roto](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

Kommentar (0)