|

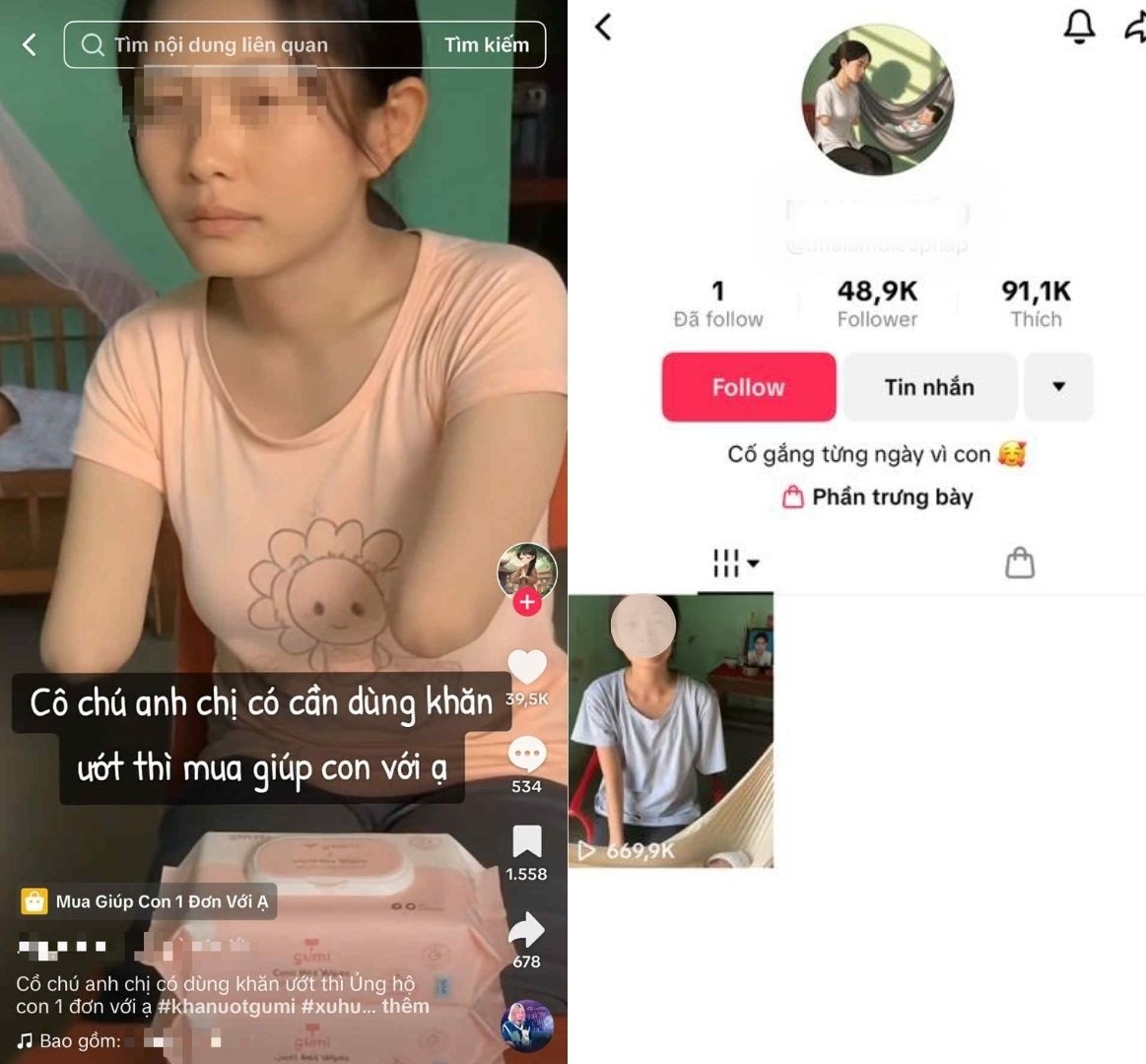

حساب کاربری با استفاده از هوش مصنوعی خود را به جای فروشنده جا میزند. عکس: تیک تاک . |

با ظهور مجموعهای از ابزارهای پیشرفته هوش مصنوعی در سالهای اخیر، ایجاد عکس و فیلم تنها با چند دستور بسیار سادهتر شده است. با این حال، توانایی کاربران اینترنت در تشخیص واقعی از جعلی با این پیشرفت همگام نبوده و توسط برخی افراد برای سودجویی مورد سوءاستفاده قرار گرفته است.

اخیراً، یک حساب کاربری تیک تاک در شبکههای اجتماعی در حال پخش شدن است و مجموعهای از ویدیوها را در مورد زنی منتشر میکند که هر دو دستش قطع شده و مجبور است برای حمایت از فرزندان خردسالش اجناسی را بفروشد. در این کلیپها، این شخص لباسهای سادهای پوشیده، با دلسوزی صحبت میکند و محصولاتی مانند دستمال کاغذی و مواد شوینده را معرفی میکند.

طبق این گزارش، این زن وضعیت مرگ زودهنگام شوهرش بر اثر تصادف و بزرگ کردن یک فرزند خردسال به تنهایی را به اشتراک گذاشت، اما داستان در تمام ویدیوها یکسان نبود. این حساب کاربری بیش از میلیونها بازدید و تعامل دریافت کرد و در عرض ۳ روز از ایجاد کانال، ۱۰۰۰۰۰ دنبالکننده به آن اضافه شد. بسیاری از مردم ابراز همدردی کردند، درخواست حمایت کردند و حتی برای کمک به او محصولات سفارش دادند.

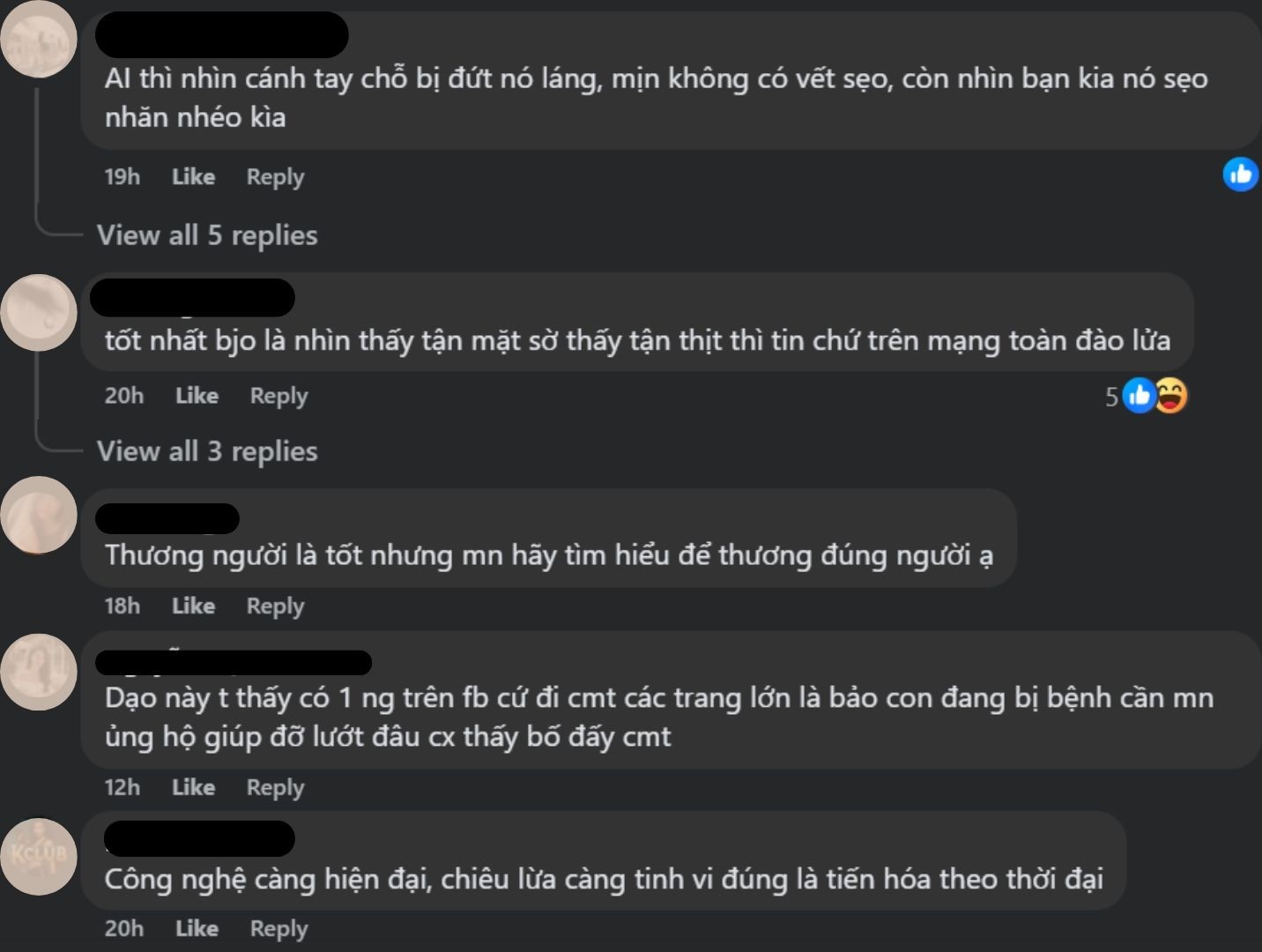

کاربران همچنان حسابهایی با محتوای مشابه را کشف میکنند. وجه مشترک این کانالها این است که صفحات شخصی تازه ایجاد شده هستند، هیچ سابقه تعامل واقعی ندارند و اغلب محتوای بیش از حد احساسی به اشتراک میگذارند.

|

این کانالها اغلب جدید هستند و مشخصات مشخصی ندارند. |

با این حال، پس از مدتی، کاربران اینترنتی متوجه چیزی غیرمعمول و نامنسجم در هر ویدیو شدند. به عنوان مثال، بازوی قطع شده زن بسیار صاف به نظر میرسید، رنگ دیوار خانه متفاوت بود، یا نوزاد به طور غیرمعمولی بیحرکت دراز کشیده بود. دلیل این امر این بود که همه کلیپها توسط هوش مصنوعی برای فریب دیگران ساخته شده بودند.

شایان ذکر است که نظرات هشدار دهنده یا افشاگرانه توسط صاحب حساب پنهان یا حذف شده است. بسیاری از مردم از اینکه فریب خوردهاند، احساس آزردگی کردند و همچنین از این رفتار که از همدردی مردم سود میبرد، خشمگین شدند.

علاوه بر این، این ویدیوهای جعلی بر صاحبان و سایر افراد دارای معلولیت که در همان پلتفرم امرار معاش میکنند نیز تأثیر میگذارد. خانم تران تی نگا (۳۶ ساله) در فو تو ، صاحب کانال نگا تیچ کوک، مجبور بود مدام بگوید که واقعاً دستش قطع شده است.

در پایان سال ۲۰۲۴، این فرد به میوکاردیت ویروسی حاد مبتلا شد و مجبور به قطع تمام اعضای بدنش گردید و زندگی جدیدی را با عشق خانوادهاش آغاز کرد. او در یک پخش زنده اخیر، از اینکه مورد تردید قرار گرفته و کلمات تندی دریافت کرده، ابراز ناراحتی کرد.

این کانالهای تازه ایجاد شده همچنین به سرعت تعداد زیادی دنبالکننده به دست آوردند که تمایز آنها را دشوارتر میکرد. حساب کاربری دیگری با محتوای مشابه به نام NLS تنها پس از یک ویدیو، نزدیک به ۵۰ هزار دنبالکننده پیدا کرد.

|

کاربران هنگام فریب خوردن، خشم و از دست دادن اعتماد خود را ابراز کردند. |

بنابراین، نمیتوان جامعه آنلاین را به خاطر از دست دادن تدریجی اعتماد به آنچه میبینند و در نتیجه عدم توجه به کسانی که واقعاً به کمک نیاز دارند، سرزنش کرد. در یکی از نظرات گفته شده بود که کسانی که از فناوری هوش مصنوعی برای سوءاستفاده از احساسات جامعه استفاده میکنند، باید محکوم شوند.

طرحهای کلاهبرداری سایبری به طور فزایندهای پیچیدهتر میشوند و افراد کمدرآمد یا سالمندان را هدف قرار میدهند. اکثر دارندگان حساب از تصاویر افرادی که از آسیبهای روحی، مانند بستری شدن در بیمارستان یا معلولیت رنج میبرند، استفاده میکنند، سپس سبدهای خرید را ضمیمه میکنند یا شماره حسابها را برای تماس با پشتیبانی میگذارند.

پیش از این، CNBC بیش از ۳۰ حساب اینستاگرام، یوتیوب و تیکتاک را کشف کرده بود که از هوش مصنوعی برای جعل هویت افراد مبتلا به سندرم داون استفاده میکردند. این افراد از داستانهای دلخراش برای جذب دنبالکننده و فراخوان جمعآوری کمکهای مالی استفاده میکردند، اما در واقع، این حسابها را به نام خود ثبت کرده بودند.

این حادثه هشدار میدهد که احتمال دارد توانایی هوش مصنوعی در بازتولید محتوای واقعگرایانه توسط افراد شرور مورد سوءاستفاده قرار گیرد. با پیشرفت سریع فناوری، کاربران باید آن را رواج دهند و همچنین به عزیزان خود کمک کنند تا قربانی کلاهبرداریهای آنلاین نشوند.

منبع: https://znews.vn/video-nghi-ai-gia-nguoi-khuet-tat-ban-hang-gay-buc-xuc-post1598306.html

نظر (0)