Il est temps pour chaque utilisateur de devenir un « bouclier numérique », en faisant preuve d'alerte, de vigilance et de responsabilité à chaque clic et à chaque partage.

Les avantages et les limites de l'IA

Jamais l'intelligence artificielle n'a été aussi présente dans notre quotidien. En quelques clics et avec une simple commande, nous pouvons créer des voix, des images et même des vidéos d'un réalisme saisissant. L'IA permet de gagner du temps, de réduire les coûts de production de contenu et d'inaugurer une ère de médias numériques flexibles.

Cependant, cette capacité même à « simuler la réalité de manière réaliste » s'est révélée être une arme à double tranchant. Récemment, les réseaux sociaux ont été inondés de vidéos créées grâce à la technologie deepfake, dans lesquelles les visages de responsables policiers et les images de policiers impliqués dans des affaires sensibles sont manipulés et déformés, avec des voix off, afin de tromper et de diviser l'opinion publique.

Ce genre d'images mises en scène est de plus en plus courant sur les réseaux sociaux.

Dans une vidéo TikTok devenue virale, des images d'un agent de la circulation en service étaient juxtaposées à des propos injurieux, accompagnées du hashtag « amendes pour la forme », insinuant que l'agent avait abusé de son pouvoir à des fins personnelles. De nombreux utilisateurs, notamment des jeunes, ont facilement cru à ce contenu, tant les images étaient réalistes et la synchronisation labiale parfaite, rendant la distinction entre le vrai et le faux extrêmement difficile.

Un jeune youtubeur de Dien Bien a été sanctionné pour avoir simplement voulu « faire étalage » de ses compétences en intelligence artificielle : amende administrative et excuses publiques forcées. Le 24 janvier après-midi, la police provinciale de Dien Bien a annoncé que le département de la cybersécurité et de la prévention de la cybercriminalité avait infligé une amende administrative de 7,5 millions de dongs à Tong Van T. (né en 2001, résidant dans le district de Muong Ang) pour avoir utilisé l'intelligence artificielle afin de créer une vidéo truquée contenant des propos déformés et insultants à l'encontre des agents de la police routière.

Le 7 janvier, T. a mis en ligne sur sa chaîne YouTube « Tuyen Vlog » une vidéo de plus de trois minutes au titre choquant : « En pleine rue, j’ai été poursuivie par la police routière. » Dans cette vidéo, les images et les situations étaient mises en scène grâce à une technologie d’intelligence artificielle, simulant une poursuite de citoyens par la police routière, et étaient agrémentées d’effets et de commentaires offensants et diffamatoires envers les forces de l’ordre.

En collaboration avec la police, T. a reconnu que l'intégralité du contenu de la vidéo était un montage réalisé à des fins de divertissement et pour démontrer sa maîtrise de l'intelligence artificielle. Outre l'amende, les autorités lui ont ordonné de retirer la fausse vidéo et de présenter publiquement ses excuses à la police routière sur sa chaîne YouTube personnelle.

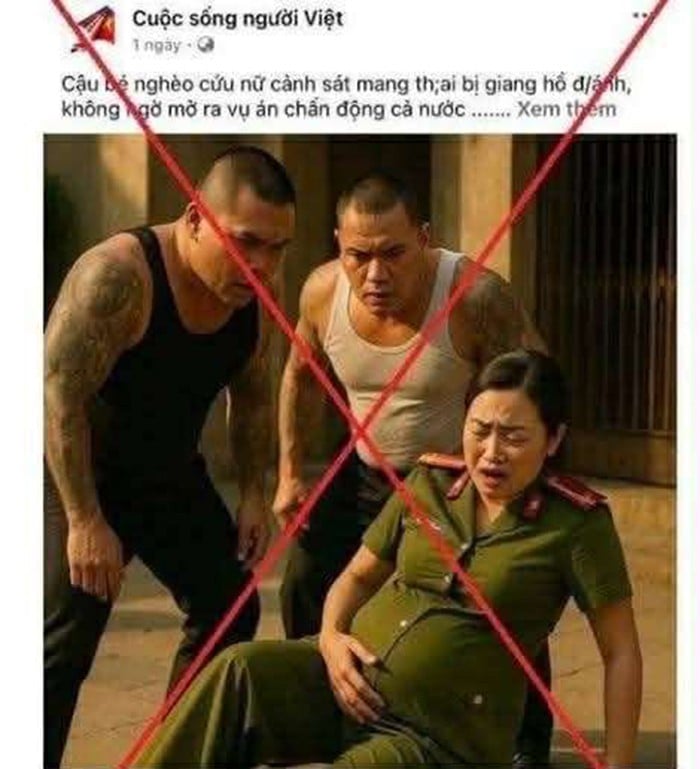

À l'ère de la révolution numérique , et notamment du développement rapide de l'intelligence artificielle, des forces hostiles et réactionnaires n'ont pas hésité à exploiter cet outil pour créer de fausses images et de faux récits visant à déformer et à ternir l'image de la Police populaire vietnamienne. Une photo circulant récemment sur les réseaux sociaux, montrant une femme enceinte en uniforme de police menacée par deux hommes à l'allure de gangsters, illustre parfaitement cette tactique.

L'image, créée à l'aide d'une intelligence artificielle, est récemment devenue virale sur les réseaux sociaux.

Au premier abord, on pourrait facilement confondre cette scène avec une scène réelle, accompagnée de titres sensationnalistes tels que : « Un jeune garçon sauve une policière enceinte agressée par des gangsters, révélant sans le savoir une affaire qui choque le pays tout entier… ». Or, il s’agit en réalité d’une mise en scène, probablement tirée d’un film ou d’une production de divertissement, ou pire encore, d’une image créée par une intelligence artificielle pour manipuler les émotions du spectateur, l’amenant à éprouver de la pitié et à douter de l’authenticité des forces de l’ordre.

Plus inquiétant encore, la diffusion de tels contenus nuit non seulement à la réputation et à l'image de la Police populaire, qui œuvre sans relâche pour garantir la sécurité et l'ordre public, mais constitue également une forme sophistiquée de guerre psychologique. Lorsque la confiance du peuple envers les autorités est érodée par des images trompeuses, les desseins inavoués des forces hostiles visant à diviser l'unité nationale se concrétisent peu à peu.

Par conséquent, chaque citoyen doit accroître sa vigilance, développer son esprit critique et sa capacité à identifier les fausses informations, et dénoncer et réfuter résolument les contenus mensongers, contribuant ainsi à protéger les fondements idéologiques et à maintenir la stabilité sociale face à la vague actuelle de désinformation sur Internet.

À Hô-Chi-Minh-Ville, une vidéo d'une minute environ est devenue virale de manière inattendue sur les réseaux sociaux. On y voit une personne en uniforme de police « contraindre » un suspect à avouer une infraction au code de la route dans un bureau. Dans la vidéo, la personne, vraisemblablement un policier, adopte une attitude agressive, criant constamment et utilisant même un langage grossier, ce qui a provoqué l'indignation générale.

Cependant, peu après la diffusion virale de la vidéo, la police d'Hô-Chi-Minh-Ville a rapidement mené une enquête et confirmé qu'il s'agissait d'un deepfake sophistiqué. Selon leurs conclusions, les visages apparaissant dans la vidéo avaient été extraits de l'enregistrement d'une réunion interne de la police, puis manipulés par des individus malveillants à l'aide de l'intelligence artificielle pour les superposer à une scène mise en scène, trompant ainsi les spectateurs et leur faisant croire à un événement réel.

En particulier, l'audio d'accompagnement comprend des voix menaçantes et insultantes qui ne sont en réalité pas les vraies paroles d'un quelconque officiel, mais plutôt des voix synthétisées par une IA, programmées et modifiées pour tromper les émotions du spectateur.

Cet incident illustre parfaitement l'utilisation de la technologie deepfake pour déformer et diffamer la Police populaire, une tactique de plus en plus employée par les forces réactionnaires et subversives dans le cyberespace. Surtout, si elles ne sont pas démasquées rapidement, ces contrefaçons peuvent avoir de graves conséquences : elles peuvent saper la confiance du public envers les forces de l'ordre, inciter à la résistance au sein de la communauté et faciliter la diffusion de fausses informations. Cet incident souligne l'urgence de renforcer les capacités de communication pour réfuter, détecter et combattre les fausses informations, et appelle chaque citoyen à la vigilance et à s'abstenir de partager ou de commenter hâtivement des contenus non vérifiés provenant de sources officielles.

Dans une autre affaire récente, concernant la gestion d'irrégularités dans un centre de contrôle technique automobile du Sud, des éléments hostiles ont diffusé une fausse vidéo d'un responsable de la police provinciale prenant la défense de fonctionnaires corrompus. Ce clip, diffusé sur Telegram et les réseaux sociaux avec le titre « soutenu par de puissantes forces », était en réalité un produit de l'intelligence artificielle et n'apparaissait dans aucune conférence de presse ni dans aucun document officiel.

Une tendance dangereuse se propage silencieusement sur Internet : des individus malveillants utilisent l’intelligence artificielle pour créer de fausses vidéos à des fins d’escroquerie et d’extorsion. Récemment, de nombreuses personnes en ont été victimes : leurs images, notamment celles de personnalités respectées comme des avocats, des médecins et des chefs d’entreprise, ont été superposées à des vidéos publicitaires proposant de « récupérer l’argent perdu lors d’escroqueries en ligne ».

Dans ces vidéos, l'intelligence artificielle est utilisée pour imiter la voix et le visage d'avocats, trompant ainsi les spectateurs et les incitant à divulguer facilement des informations personnelles ou à leur transférer de l'argent. Pire encore, certains auteurs de ces escroqueries utilisent la technologie deepfake pour incruster le visage des victimes sur des vidéos à caractère sexuel, puis les envoient à leurs conjoints ou collègues dans le but de les menacer ou de les contraindre à leur verser de l'argent en échange de leur silence.

Un incident choquant s'est produit en mars 2025 à Hanoï, lorsqu'une victime a été contrainte de transférer des dizaines de millions de dongs après avoir reçu une fausse vidéo à caractère sexuel la mettant en scène. Parallèlement, à Hô Chi Minh-Ville, une autre personne a été victime de chantage : on lui réclamait 2 milliards de dongs pour qu'elle ne diffuse pas une vidéo compromettante. Le ministère de la Sécurité publique a ouvert une enquête et a identifié plusieurs groupes criminels transnationaux, principalement originaires de Chine et d'Asie du Sud-Est, à l'origine de ces réseaux. Ces groupes utilisaient des cartes SIM jetables, des portefeuilles électroniques et les réseaux sociaux pour dissimuler leur identité.

Il ne s'agit plus d'une simple escroquerie, mais d'une forme de « guerre psychologique de pointe », exploitant profondément les peurs liées à l'honneur et aux relations sociales pour faire pression sur ses victimes. Sans une vigilance accrue et une capacité à identifier les informations et les comportements inhabituels, chacun peut devenir la proie de ces cybercriminels. Face à cette vague sophistiquée d'usurpation d'identité, chaque citoyen doit rester vigilant, s'abstenir absolument de divulguer des informations personnelles à la légère et être prêt à dénoncer les activités illégales, contribuant ainsi à la protection de sa propre sécurité et de celle de la communauté.

Un « bouclier numérique » de la communauté est nécessaire pour lutter contre la menace des deepfakes.

Selon le Département de la radiodiffusion, de la télévision et de l'information électronique (ministère de la Culture, des Sports et du Tourisme), en 2024, les plateformes numériques vietnamiennes ont dû supprimer plus de 4 000 vidéos contenant des informations fausses ou déformées, la plupart étant des productions réalisées à l'aide de technologies d'intelligence artificielle telles que les deepfakes et les clones vocaux. TikTok, plateforme très populaire auprès des jeunes, a été sommée de supprimer plus de 1 300 vidéos deepfake, principalement liées aux forces de l'ordre, au gouvernement et aux politiques sociales.

À l'ère du boom technologique, l'intelligence artificielle ouvre des perspectives révolutionnaires, mais elle engendre aussi des dangers sans précédent, notamment les deepfakes, ces contenus falsifiés qui portent atteinte à la réputation des institutions gouvernementales. Une enquête de l'Institut de recherche sur les médias MICRI révèle que 62 % des utilisateurs des réseaux sociaux vietnamiens sont incapables de distinguer le vrai du faux sans avertissement des médias traditionnels ou des autorités. Ce « fossé cognitif » est exploité sans scrupules par des forces malveillantes pour diffuser de la désinformation et perturber la psychologie sociale.

Tong Van T. au poste de police.

Selon le général de division, professeur agrégé et docteur en criminologie Do Canh Thin, l'utilisation de l'IA pour créer de fausses vidéos usurpant l'identité de dirigeants, modifier de fausses déclarations ou déformer les actions professionnelles des forces de l'ordre constitue une tactique nouvelle mais particulièrement dangereuse. « Les deepfakes ne sont pas un simple produit de divertissement, mais une forme moderne de guerre de l'information, capable de saper la confiance, de provoquer une instabilité sociale et très difficile à contrôler », a déclaré le général de division Do Canh Thin.

En réalité, les vidéos manipulées par l'IA sont loin d'être inoffensives ; elles ciblent souvent des sujets sensibles comme le traitement des infractions, les enquêtes criminelles et la lutte contre la corruption, engendrant confusion et méfiance du public envers les forces de l'ordre. Plus inquiétant encore, nombre de ces vidéos sont partagées sur des plateformes majeures telles que YouTube et TikTok, où elles cumulent des centaines de milliers de vues avant d'être supprimées, provoquant ainsi un effet domino négatif.

L’expert en médias numériques Hoang Minh met en garde : « Un simple partage ou un simple « j’aime » imprudent peut faire de vous un complice de fausses informations. Chaque internaute doit comprendre que ses actions dans l’espace numérique ont aussi des conséquences bien réelles. »

Dans ce contexte, il est plus que jamais nécessaire de construire un « bouclier numérique » au sein même de la communauté : vigilance, immunité informationnelle et sens des responsabilités envers l’environnement en ligne. La technologie peut être neutre, mais l’usage qu’en font les individus déterminera si l’IA deviendra un moteur de développement ou une force destructrice pour la confiance sociale. Préserver l’intégrité idéologique et l’image des forces de l’ordre, c’est protéger les fondements de la sécurité nationale – une tâche qui incombe non seulement aux autorités compétentes, mais à chaque citoyen à l’ère du numérique.

Source : https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Photo] Le Premier ministre Pham Minh Chinh préside un dialogue avec des entreprises japonaises.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/21/1774097547316_ndo_br_dsc-0448-jpg.webp)

Comment (0)