डीपसीक के शोधकर्ताओं ने V3.2-exp नामक एक नए प्रायोगिक मॉडल की घोषणा की है, जिसे लंबे संदर्भ संचालन में उपयोग किए जाने पर अनुमान की लागत को काफी कम करने के लिए डिज़ाइन किया गया है।

डीपसीक ने हगिंग फेस पर एक पोस्ट में इस मॉडल की घोषणा की, तथा गिटहब पर एक लिंक्ड अकादमिक पेपर भी पोस्ट किया।

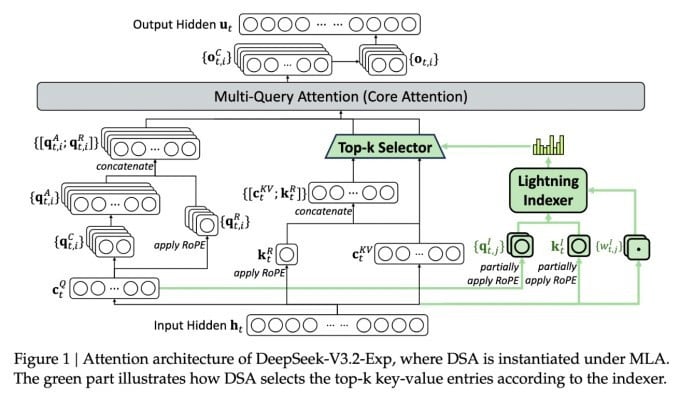

इस जटिल नए मॉडल की सबसे महत्वपूर्ण विशेषता डीपसीक स्पार्स अटेंशन है। मूलतः, यह सिस्टम संदर्भ विंडो से विशिष्ट अंशों को प्राथमिकता देने के लिए "लाइटनिंग इंडेक्सर" नामक एक मॉड्यूल का उपयोग करता है।

डीपसीक ने लागत प्रभावी अनुमान मॉडल की घोषणा की।

"फाइन-ग्रेन्ड टोकन सिलेक्शन सिस्टम" नामक एक अलग सिस्टम, उन स्निपेट से विशिष्ट टोकन चुनकर उन्हें मॉड्यूल की सीमित अटेंशन विंडो में लोड करता है। संयुक्त रूप से, ये स्पर्स अटेंशन मॉडल्स को अपेक्षाकृत कम सर्वर लोड के साथ संदर्भ के लंबे हिस्सों पर काम करने की अनुमति देते हैं।

दीर्घ-संदर्भ संचालनों के लिए, इस प्रणाली के लाभ महत्वपूर्ण हैं। डीपसीक के प्रारंभिक परीक्षण से पता चलता है कि दीर्घ-संदर्भ परिदृश्यों में एक साधारण अनुमान फ़ंक्शन (API) कॉल की लागत आधी तक कम की जा सकती है।

अधिक सुदृढ़ मूल्यांकन के लिए आगे परीक्षण की आवश्यकता है, लेकिन चूंकि मॉडल खुला है और हगिंग फेस पर स्वतंत्र रूप से उपलब्ध है, इसलिए तीसरे पक्ष के परीक्षणों द्वारा पेपर में किए गए दावों का मूल्यांकन करने में अधिक समय नहीं लगेगा।

अन्य एआई चैटबॉट मॉडलों के विपरीत, जो बहुत अधिक ऊर्जा की खपत करते हैं, डीपसीक प्रशिक्षण से लेकर संचालन तक की लागत को बचाने की दिशा में काम करता है।

डीपसीक का नया मॉडल हाल ही में प्राप्त सफलताओं की श्रृंखला में से एक है, जो अनुमान लागत की समस्या से निपटता है - मूलतः, पूर्व-प्रशिक्षित एआई मॉडल को चलाने की सर्वर लागत, न कि उसे प्रशिक्षित करने की लागत।

डीपसीक के मामले में, शोधकर्ता बुनियादी ट्रांसफार्मर आर्किटेक्चर को और अधिक कुशल बनाने के तरीकों की तलाश कर रहे थे - और उन्होंने पाया कि इसमें महत्वपूर्ण सुधार किए जाने की आवश्यकता है।

चीन स्थित डीपसीक, एआई के क्षेत्र में एक असामान्य नाम है, खासकर उन लोगों के लिए जो एआई अनुसंधान को अमेरिका और चीन के बीच प्रतिस्पर्धा के रूप में देखते हैं। इस कंपनी ने इस साल की शुरुआत में अपने आर1 मॉडल के साथ धूम मचा दी थी, जिसे मुख्य रूप से सुदृढीकरण सीखने का उपयोग करके प्रशिक्षित किया गया था और इसकी लागत अमेरिकी प्रतिस्पर्धियों की तुलना में बहुत कम थी।

हालाँकि, यह मॉडल एआई प्रशिक्षण में पूर्ण पैमाने पर क्रांति लाने में विफल रहा, जैसा कि कुछ लोगों ने भविष्यवाणी की थी, और कंपनी बाद के महीनों में धीरे-धीरे सुर्खियों से दूर हो गई।

नए "विरल ध्यान" दृष्टिकोण से R1 जितना आक्रोश पैदा होने की संभावना नहीं है - लेकिन यह अभी भी अमेरिकी सेवा प्रदाताओं को अनुमान लागत को कम रखने में मदद करने के लिए कुछ बहुत जरूरी तरकीबें सिखा सकता है।

https://techcrunch.com/2025/09/29/deepseek-releases-sparse-attention-model-that-cuts-api-costs-in-half/

स्रोत: https://khoahocdoisong.vn/deepseek-dao-tao-da-re-nay-con-co-ban-suy-luan-re-hon-post2149057353.html

![[फोटो] बिन्ह मिन्ह प्राइमरी स्कूल के छात्र पूर्णिमा उत्सव का आनंद लेते हुए, बचपन की खुशियाँ प्राप्त कर रहे हैं](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/3/8cf8abef22fe4471be400a818912cb85)

![[फोटो] प्रधानमंत्री फाम मिन्ह चीन्ह ने तूफान संख्या 10 के परिणामों से निपटने के लिए बैठक की अध्यक्षता की](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/3/544f420dcc844463898fcbef46247d16)

टिप्पणी (0)