Az elmúlt hónapokban a gyermekbiztonsági szakértők és kutatók arra figyelmeztettek, hogy a kreatív mesterséges intelligencia súlyosbíthatja az online bántalmazást.

Mark Zuckerberg, a Meta vezérigazgatója az amerikai szenátus igazságügyi bizottságának meghallgatásán beszél 2024. január 31-én, mesterséges intelligencia által generált képeket hordozó tömeg előtt. Fotó: Reuters

Az NCMEC még nem hozta nyilvánosságra a 2023-ban kapott gyermekbántalmazási tartalmakról szóló bejelentések teljes számát. 2022-ben azonban körülbelül 88,3 millió fájlról érkezett bejelentés a problémával kapcsolatban.

„Jelentéseket kapunk maguktól az innovatív mesterséges intelligencia cégektől, (online) platformoktól és a nyilvánosság tagjaitól” – mondta John Shehan, az NCMEC alelnöke.

A Meta, az X, a TikTok, a Snap és a Discord vezérigazgatói szerdán (január 31-én) tanúvallomást tettek az amerikai szenátus meghallgatásán az online platformokon a gyermekek biztonságáról. Az amerikai törvényhozók a közösségi média vállalatokat kérdezték a gyermekek „online ragadozóktól” való védelmére irányuló erőfeszítéseikről.

A Stanford Internet Observatory kutatói egy tavaly júniusi jelentésben azt írták, hogy a generatív mesterséges intelligenciát rosszindulatú szereplők használhatják arra, hogy hamis képeket készítsenek róluk, és ismételten ártsanak a valós életben élő gyermekeknek.

Fallon McNulty, az NCMEC CyberTipline igazgatója, amely az online gyermekkizsákmányolásról szóló bejelentéseket fogadja, azt mondta, hogy a mesterséges intelligencia által generált tartalom „egyre fotorealisztikusabbá” válik, ami megnehezíti annak megállapítását, hogy az áldozatok valódi emberek-e.

McNulty elmondta, hogy az OpenAI, a ChatGPT-t létrehozó cég, létrehozott egy folyamatot a jelentések NCMEC-nek történő benyújtására, és a szervezet tárgyalásokat folytat más mesterséges intelligencia alapú cégekkel.

Hoang Hai (a Reuters és az FT szerint)

[hirdetés_2]

Forrás

![[Fotó] Lam főtitkára fogadja Jaya Ratnam szingapúri nagykövetet](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

![[Fotó] Lam Dong: Illegális tó közeli képe, melynek fala beomlott](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

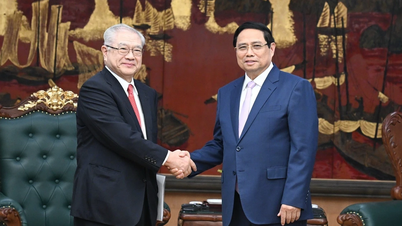

![[Fotó] Pham Minh Chinh miniszterelnök fogadja a Japán-Vietnam Baráti Társaság elnökét a Kansai régióban](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

![[Fotó] 2025-ös őszi vásár és lenyűgöző rekordok](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

Hozzászólás (0)