Serang dari setiap sudut.

Google telah meluncurkan produk kecerdasan buatan (AI) baru bernama "Gemini Nano Banana," yang bukan merupakan AI linguistik skala besar (LLM) yang mampu menulis dan bernalar, melainkan AI yang khusus dalam pengeditan foto... Banyak pengguna antusias dengan alat ini, tetapi alat ini juga membawa sejumlah kekurangan.

“Ini seperti ‘langkah mundur’ dalam teknologi AI dan batasan etika,” kata Nguyen Hong Phuc, Kepala Petugas Ilmiah Conductify AI, menyampaikan pendapat pribadinya. “Gemini Nano Banana memiliki kemampuan pengeditan gambar yang efektif. Tetapi penghapusan sensor oleh Google terhadap Gemini Nano Banana, yang melonggarkan batasan dan mekanisme pembatas, memungkinkan AI ini untuk menciptakan gambar yang sangat mirip dengan selebriti, gambar sugestif, gambar sensitif, dan lain sebagainya,” kata Phuc.

Menurut Bapak Nguyen Hong Phuc, kemampuan ini menjadikan Gemini Nano Banana sebagai alat untuk menciptakan gambar palsu yang sangat realistis, hingga para ahli AI pun tidak dapat membedakannya, yang menyebabkan risiko baru dalam penipuan dan keamanan siber, seperti membuat foto palsu dengan politisi terkenal untuk menyebarkan informasi palsu, dan bahkan individu menjadi sasaran manipulasi foto dan pencemaran nama baik yang dihasilkan AI di media sosial...

Selain itu, dengan puluhan alat pengeditan foto AI lainnya yang meramaikan internet, penipuan deepfake tidak menunjukkan tanda-tanda akan berhenti. Statistik dari organisasi keamanan menunjukkan bahwa teknologi deepfake menciptakan kampanye phishing yang menargetkan individu-individu penting, terutama para pemimpin bisnis. Pada tahun 2024, terdapat 140.000-150.000 kasus secara global, dengan 75% menargetkan CEO dan eksekutif senior... Deepfake dapat meningkatkan kerugian ekonomi global sebesar 32%, atau sekitar $40 miliar per tahun pada tahun 2027.

Baru-baru ini, perusahaan AI Anthropic mendeteksi dan menggagalkan kampanye serangan siber yang dilakukan oleh peretas asing, yang untuk pertama kalinya mencatat penggunaan AI untuk mengoordinasikan aktivitas serangan otomatis. Secara spesifik, para peretas menggunakan sistem AI untuk merencanakan, mengarahkan, dan melancarkan operasi intrusi – sebuah perkembangan yang "mengkhawatirkan" yang berisiko memperluas skala dan kecepatan kampanye serangan siber…

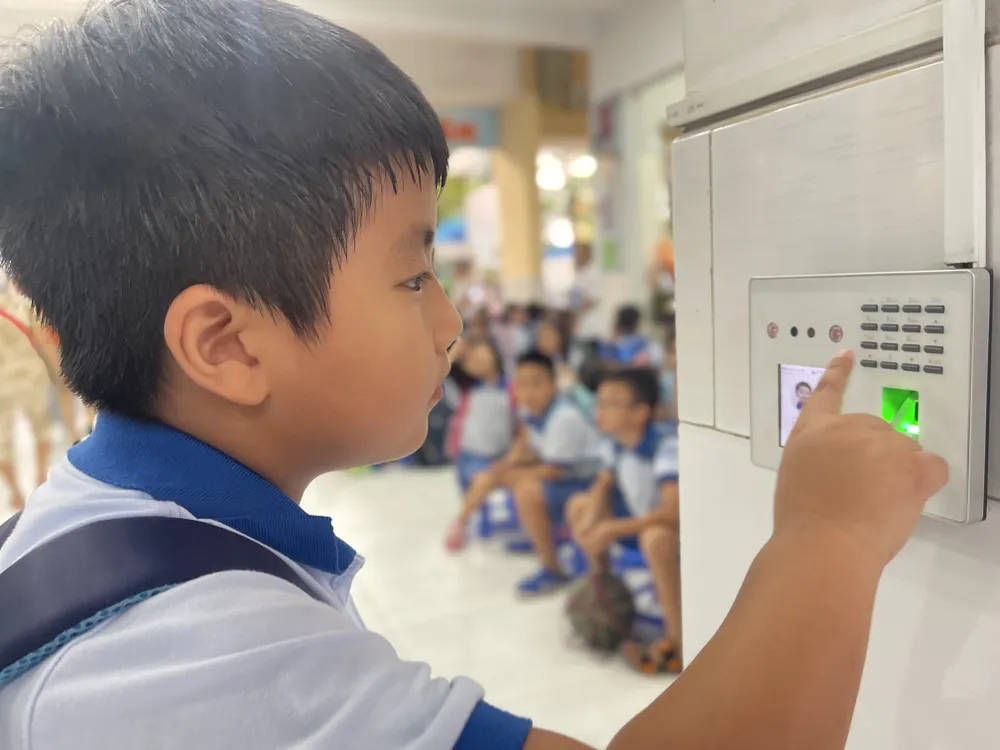

Bapak Ngo Minh Hieu, Direktur Organisasi Anti-Penipuan dari Asosiasi Keamanan Siber Nasional, menjelaskan bahwa alat yang terintegrasi dengan AI meningkatkan kecepatan penipuan sekitar 20 kali lipat dibandingkan dengan menggunakan manusia sungguhan. Penipu memberikan skenario penipuan kepada AI untuk dianalisis, dan sistem tersebut segera secara otomatis berkomunikasi dengan korban. Dari data awal, AI dapat memahami apa yang diinginkan korban dan berkomunikasi dengan mereka secara real-time. Taktik yang paling canggih adalah serangan "Man-in-the-Middle", di mana ketika pengguna melakukan otentikasi video (seperti merekam wajah mereka atau memberikan perintah), peretas ikut campur untuk mengganggu data yang ditransmisikan. Penjahat siber kemudian memasukkan video deepfake yang telah disiapkan sebelumnya, mengganti aliran data asli pengguna untuk melewati proses otentikasi. Dengan metode ini, sistem keamanan bank dan lembaga keuangan juga berisiko tertipu.

Manajemen data yang lebih baik

Seiring dengan semakin meluasnya penggunaan AI, risiko keamanan dan privasi juga meningkat secara signifikan. Data yang disimpan dan diproses di server jarak jauh akan menjadi target yang menarik bagi peretas dan penjahat siber. Menurut data dari Asosiasi Keamanan Siber Nasional, pada kuartal kedua tahun 2025 saja, jumlah serangan siber yang didukung AI meningkat sebesar 62%, menyebabkan kerugian global hingga $18 miliar...

Para ahli percaya bahwa perlindungan data sangat penting. Namun, pengumpulan dan penjualan data terus berlanjut secara terbuka di banyak platform "pasar gelap", dengan harga serendah $20 per bulan. Penjahat siber dapat menggunakan alat yang meniru model bahasa tetapi disesuaikan untuk tujuan kriminal. Alat-alat ini mampu menghasilkan malware dan bahkan melewati perangkat lunak antivirus.

Di Vietnam, Keputusan No. 13/2023/ND-CP (berlaku mulai 17 April 2023) mengatur perlindungan data pribadi. Selanjutnya, Undang-Undang Perlindungan Data Pribadi, yang diharapkan mulai berlaku pada 1 Januari 2026, akan membuka mekanisme hukum yang lebih kuat untuk mengatasi risiko kebocoran dan penyalahgunaan data pribadi. Namun, menurut Asosiasi Keamanan Siber Nasional, efektivitas penegakan hukum masih perlu diperkuat di tiga pilar: meningkatkan kesadaran publik, meningkatkan tanggung jawab perusahaan, dan meningkatkan kapasitas pemrosesan lembaga pengatur. Di luar langkah-langkah teknis, setiap individu perlu mengembangkan kemampuan untuk mengidentifikasi tanda-tanda yang tidak biasa dan mencurigakan serta secara proaktif melindungi diri dari interaksi digital yang berbahaya…

Kaspersky telah memperingatkan tentang eksploitasi Dark AI (istilah yang merujuk pada penggunaan model bahasa besar (LLM) yang beroperasi di luar kontrol keamanan standar, yang sering kali memungkinkan tindakan seperti phishing, manipulasi, serangan siber, atau penyalahgunaan data). Organisasi dan individu perlu bersiap menghadapi serangan siber yang semakin canggih dan sulit dideteksi karena meningkatnya Dark AI di kawasan Asia-Pasifik.

Sergey Lozhkin, Kepala Tim Riset dan Analisis Global (GReAT) untuk wilayah Timur Tengah, Turki, Afrika, dan Asia-Pasifik di Kaspersky, menyampaikan bahwa salah satu manifestasi penyalahgunaan AI saat ini adalah munculnya model Black Hat GPT. Ini adalah model AI yang secara khusus dikembangkan atau dimodifikasi untuk melayani tujuan yang tidak etis dan ilegal, seperti membuat malware, merancang email phishing yang lancar dan persuasif untuk serangan skala besar, membuat suara dan video deepfake, dan bahkan mendukung serangan simulasi.

Para ahli Kaspersky merekomendasikan agar individu dan bisnis menggunakan solusi keamanan generasi berikutnya untuk mendeteksi malware yang dihasilkan AI, sekaligus memprioritaskan perlindungan data. Bisnis harus menerapkan alat pemantauan waktu nyata untuk melacak eksploitasi kerentanan yang didorong oleh AI; memperkuat kontrol akses dan pelatihan karyawan untuk membatasi AI di zona gelap dan risiko kebocoran data; serta membangun pusat operasi keamanan siber untuk memantau ancaman dan merespons insiden dengan cepat.

Sumber: https://www.sggp.org.vn/bao-mat-du-lieu-thoi-ai-post824210.html

![[Foto] Sekretaris Jenderal dan Presiden To Lam memimpin sesi kerja dengan Komite Kebijakan dan Strategi Pusat mengenai pengembangan industri material.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/21/1779359935432_a3-bnd-3129-1412-jpg.webp)

Komentar (0)