Facebookの親会社は、Llama 4コレクションに2つの新モデルを発表しました。これらは、ウェブ上のMeta AIアシスタント、WhatsApp、Messenger、Instagramで現在使用されているものと同じモデルで、ユーザーがよりパーソナライズされたマルチメディア体験を実現するのに役立ちます。

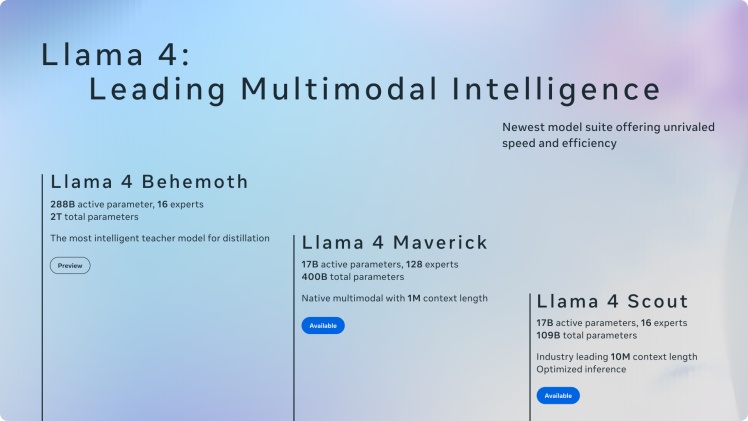

MetaまたはHugging Faceからダウンロード可能な2つの新しいモデル、「Llama 4 Scout」と「Llama 4 Maverick」です。Metaによると、CEOのマーク・ザッカーバーグ氏が「 世界最高性能のプラットフォームモデル」と呼ぶ巨大モデル「Llama 4 Behemoth」のトレーニングはまだ進行中とのことです。

Metaによると、Llama 4 Scoutのコンテキストウィンドウは最大1000万トークンで、これは現在最もトークン数が多いモデルであるGeminiの数倍に相当します。この数値はAIモデルのワーキングメモリを表しています。

Meta は、このモデルが「広く公開されている多数のベンチマークにおいて」Google の Gemma 3 や Gemini 2.0 Flash-Lite、Mistral 3.1 よりも優れていると説明しているが、それでも「単一の Nvidia H100 GPU で実行できる」という。

Llama 4 Maverickについても、同社はOpenAIのGPT-4oやGoogleのGemini 2.0 Flashと比較し、同様のパフォーマンスを主張しました。Maverickのプログラミングと推論タスクは、使用するパラメータがDeepSeek-V3の半分以下であるにもかかわらず、DeepSeek-V3に匹敵します。

|

Llama 4コレクションの新モデルのフィギュア。写真: Meta。 |

一方、Behemothは総計2兆個のパラメータのうち、2880億個のアクティブパラメータを誇ります。まだ正式リリースはされていませんが、Meta社はBehemothが「いくつかのSTEM指標において」競合相手(具体的にはGPT-4.5とClaude Sonnet 3.7)を上回る可能性を秘めていると述べています。

Metaは、DeepSeekの成功の要因となった「Mixture of Experts(MoE)」アーキテクチャへの移行を発表しました。このアプローチは、特定のタスクに必要なモデルの一部のみをアクティブ化することでリソースを節約します。製品計画の詳細は、4月29日のLlamaConカンファレンスで発表されます。

ライセンス制限に関する批判にもかかわらず、Metaは以前のモデルと同様に、Llama 4を「オープンソース」として引き続き提供しています。例えば、Llama 4のライセンスでは、月間アクティブユーザー数が7億人を超える商用組織は、モデルを使用する前にMetaから許可を得る必要があります。

2023 年の Open Source Initiative によれば、このような規制により「このモデルはもはやオープンソースとして分類されなくなった」とのことです。

出典: https://znews.vn/cha-de-facebook-ra-mo-hinh-ai-moi-post1543744.html

![[インフォグラフィックス] 国有経済の発展に関する政治局決議第79-NQ/TW号](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/01/10/1768038914679_chp_3-11-23.jpeg)

コメント (0)