|

アリババが発表した新技術「Qwen3」。写真:ロイター |

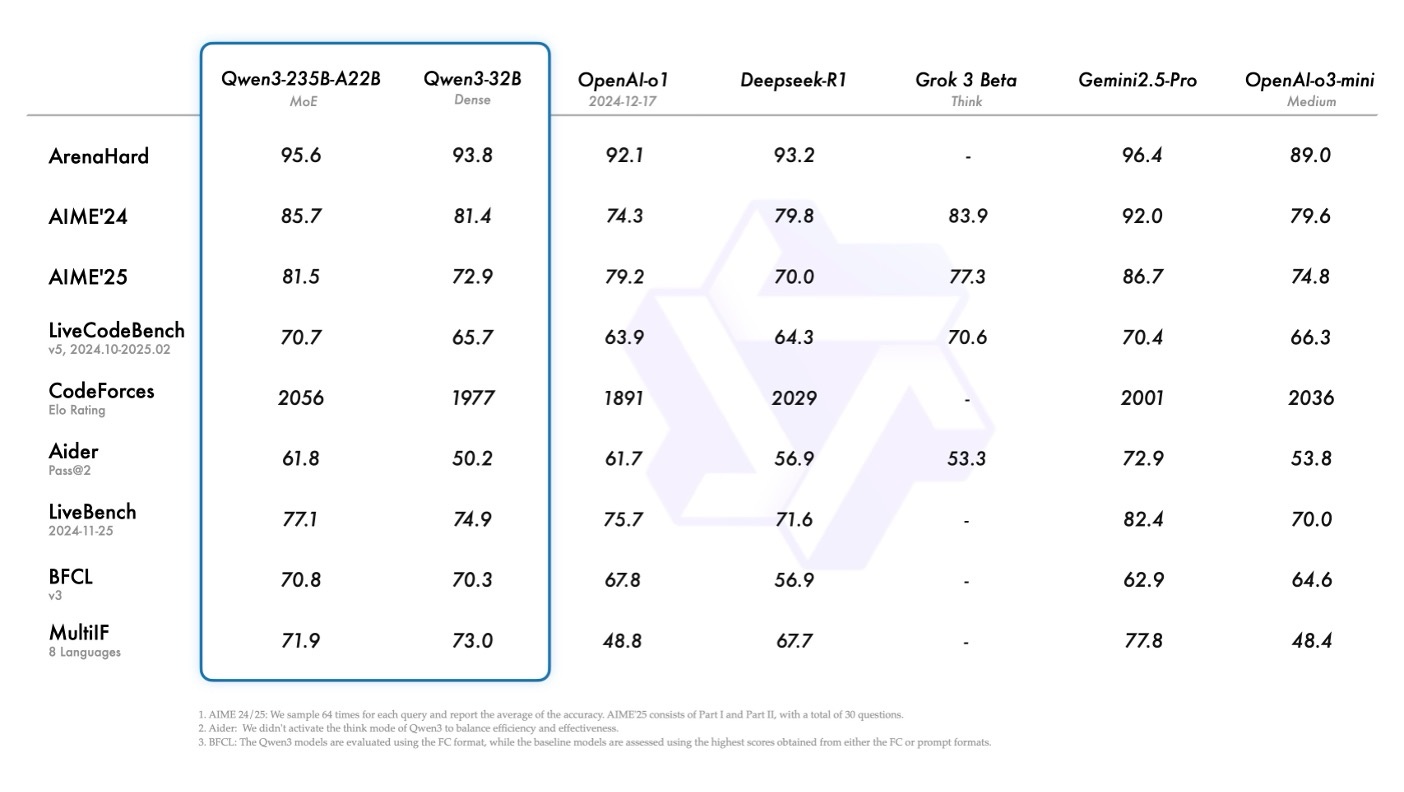

中国のテクノロジー大手アリババは4月28日、「Qwen3」と呼ばれるAIモデルシリーズを発表しました。同社は、このチャットボットはOpenAIやGoogleの最新モデルに匹敵、あるいは場合によっては凌駕する性能を発揮すると主張しています。

Qwen3は最大2,350億個のパラメータを有し、それぞれ約2,360億個と1,750億個のパラメータを持つDeepSeek-V2やOpenAI GPT-4と同等の性能を備えています。一連のモデルがリリースされ次第、ユーザーはAI開発プラットフォームHugging FaceとGitHubからオープンライセンスでダウンロードできるようになります。

同社によると、Qwen3コレクションにはハイブリッドモデルが含まれており、複雑な問題を解決するための柔軟な推論機能や、単純なリクエストへの迅速な対応が可能になる。この場合、推論機能によりモデルは情報の正確性を自己チェックできるが、レイテンシが高くなるというデメリットがある。

この設計により、ユーザーは特定のタスクごとに適切な予算を簡単に割り当てることができます。さらに、このモデルは世界中の多くの競合他社から学習します。

Qwen3は、DeepSeekに類似した「Mixture of Experts(MoE)」アーキテクチャを採用することで、学習コストのほんの一部で計算効率を最大化できます。これは、タスクを個々の部分に分割し、実行に必要な量のディープラーニングデータのみを推奨する手法です。

開発チームによると、Qwen3は最大119の言語をサポートし、約36兆トークン(27兆語に相当)のデータセットで学習されています。学習データは、教科書、質問と回答のセット、プログラミングコード、自己生成AIなど、様々なソースから取得されます。

これらの改善点に加え、その他多くの改善点により、チャットボットの機能は前身のQwen2と比較して大幅に向上しました。Techcrunchは、Qwen 3はOpenAIのo3やo4-miniといった最近のトップモデルを完全に凌駕するものではないものの、依然として印象的なパフォーマンスを示していると指摘しています。

|

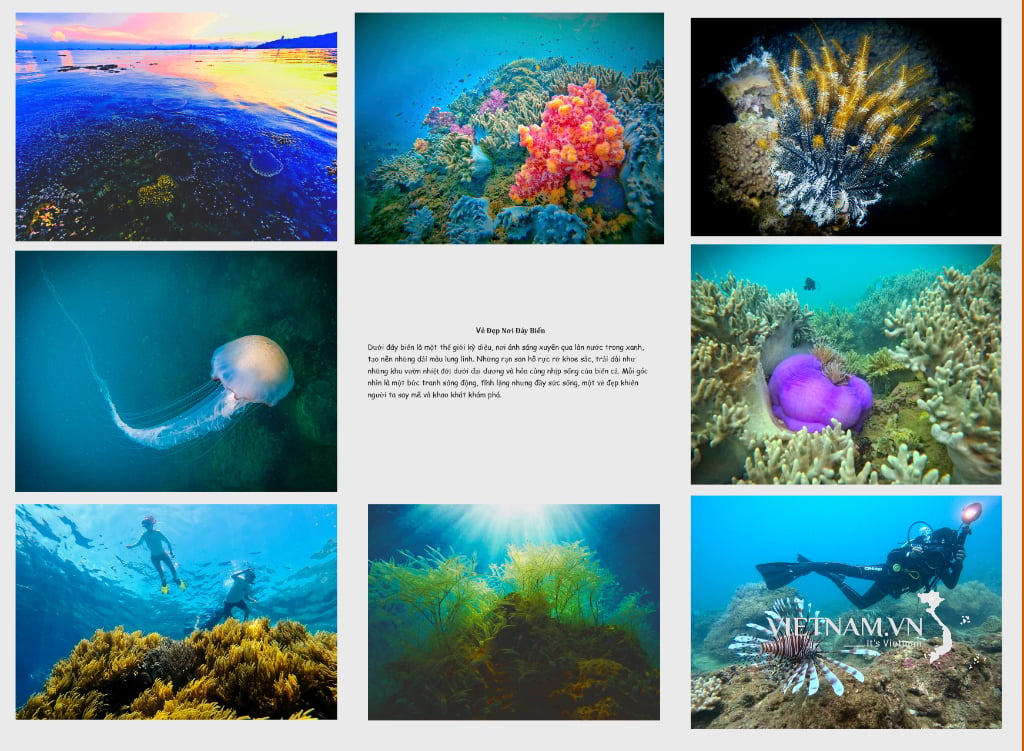

評価テストのスコアを比較する。写真: Qwen/X。 |

コレクション最大のモデルであるQwen-3-235B-A22Bは、人気のプログラミング競技プラットフォームであるCodeforcesにおいて、OpenAIのo3-miniとGoogleのGemini 2.5 Proに勝利しました。また、モデルの推論能力を測定するAIMEとBFCLの数学問題でもo3-miniを上回りました。

Qwen-3-235B-A22Bはまだ公式に公開されていません。一方、ユーザーはQwen3-32Bをダウンロードできます。このモデルは、LiveCodeBenchプログラミングテストを含む複数の評価でOpenAIのo1を上回りました。

アリババによると、Qwen3はツールの呼び出し、指示の遵守、そしてデータフォーマットの正確なコピーに優れているが、これらは他の多くのツールには欠けている。カーネギーメロン大学の研究によると、多くのAIは具体的な指示にもかかわらず、情報を捏造したりフォーマットを変更したりすることが分かっている。

上記のプラットフォームからのダウンロードに加え、Fireworks AIやHyperbolicなどのクラウドサービスプロバイダーを通じてQwen3を入手することもできます。これにより、大企業から中小企業、そして個人プログラマーまで、あらゆるユーザーが垣根を越えてアクセスし、実験を行うことができます。

Qwenのような中国のAIの出現により、米国の研究機関に対してより強力な技術の開発を求める圧力が高まり、米国の政策立案者は中国のチップへのアクセスに制限を課すようになった。

クラウドAIホスティング企業BasetenのCEO、Tuhin Srivastava氏は、Qwen3はオープンソースモデルがOpenAIのようなクローズドソースシステムに追いついているもう一つの例だと述べた。

Qwen3は、米国政府の規制にもかかわらず、中国国内で広く利用され続けることは間違いない。「これは、AnthropicやOpenAIといった既存のモデルに頼るだけでなく、中国のテクノロジー企業が独自のソフトウェアを開発できることを示しています」と彼は述べた。

出典: https://znews.vn/them-loat-ai-manh-me-tu-trung-quoc-post1549756.html

コメント (0)