트루픽의 CEO 제프리 맥그리거는 이번 사건이 빙산의 일각에 불과하다고 믿습니다. 그는 앞으로 소셜 미디어에 인공지능이 생성한 콘텐츠가 더욱 많이 등장할 것이며, 우리는 아직 그에 대비할 준비가 되어 있지 않다고 말합니다.

CNN에 따르면, 트루픽은 트루픽 렌즈를 통해 미디어 생성 시점에 진위 여부를 검증하는 기술을 제공함으로써 이 문제를 해결하고자 합니다. 이 데이터 수집 애플리케이션은 사용자에게 이미지 생성 날짜, 시간, 위치 및 사용된 기기를 알려주고, 디지털 서명을 적용하여 이미지가 자연적으로 생성된 것인지 인공지능(AI)이 생성한 것인지를 확인합니다.

펜타곤 폭발을 가장한 가짜 사진이 트위터에서 빠르게 확산되고 있다.

2015년에 설립되어 마이크로소프트의 지원을 받는 트루픽(Truepic)은 NGO , 미디어 회사, 심지어 보험 회사까지 다양한 분야에서 관심을 받고 있는데, 이들은 보험금 청구의 정당성을 검증할 방법을 찾고 있습니다.

맥그리거는 모든 것을 위조할 수 있고, 인공지능이 품질과 접근성 면에서 정점에 도달한 지금, 우리는 온라인상에서 무엇이 현실인지 더 이상 알 수 없다고 말했다.

트루픽(Truepic)과 같은 기술 기업들은 수년 동안 온라인 허위 정보 퇴치에 힘써 왔습니다. 하지만 사용자의 명령에 따라 이미지와 글을 생성할 수 있는 다양한 새로운 AI 도구들의 등장으로 이러한 노력은 더욱 시급해졌습니다. 올해 초, 프란치스코 교황이 발렌시아가 구명조끼를 입고 있는 모습과 도널드 트럼프 전 미국 대통령이 체포되는 모습이 담긴 가짜 이미지가 널리 퍼졌습니다. 이 두 사건은 수백만 명에게 AI의 잠재적 위험성에 대한 경각심을 불러일으켰습니다.

일부 의원들은 이제 기술 기업들이 AI가 생성한 콘텐츠에 라벨을 붙이는 방식으로 이 문제를 해결할 것을 촉구하고 있습니다. 베라 요우로바 유럽연합 집행위원회 부위원장은 구글, 메타, 마이크로소프트, 틱톡을 포함한 여러 기업들이 유럽연합의 허위 정보 퇴치 자발적 행동 강령에 참여했다고 밝혔습니다.

인공지능 생성 기능을 제품에 적용하는 기업들을 포함한 스타트업과 기술 대기업들이 이미지나 동영상이 인공지능을 이용해 생성되었는지 여부를 사람들이 판단할 수 있도록 돕는 표준과 솔루션을 개발하려는 움직임을 점점 더 보이고 있습니다.

하지만 인공지능 기술이 인간의 속도를 따라잡지 못할 정도로 빠르게 발전함에 따라 이러한 솔루션들이 문제를 완전히 해결할 수 있을지는 여전히 불확실합니다. Dal-E와 ChatGPT를 개발한 OpenAI조차도 인공지능이 생성한 글을 탐지하려는 자사의 노력이 완벽하지 않다고 인정했습니다.

솔루션을 개발하는 기업들은 이 문제를 해결하기 위해 두 가지 접근 방식을 취하고 있습니다. 첫 번째는 AI가 생성하여 온라인에 공유된 이미지를 식별하는 프로그램을 개발하는 것이고, 두 번째는 일종의 디지털 서명을 사용하여 이미지가 실제 이미지인지 AI 생성 이미지인지 표시하는 데 중점을 둡니다.

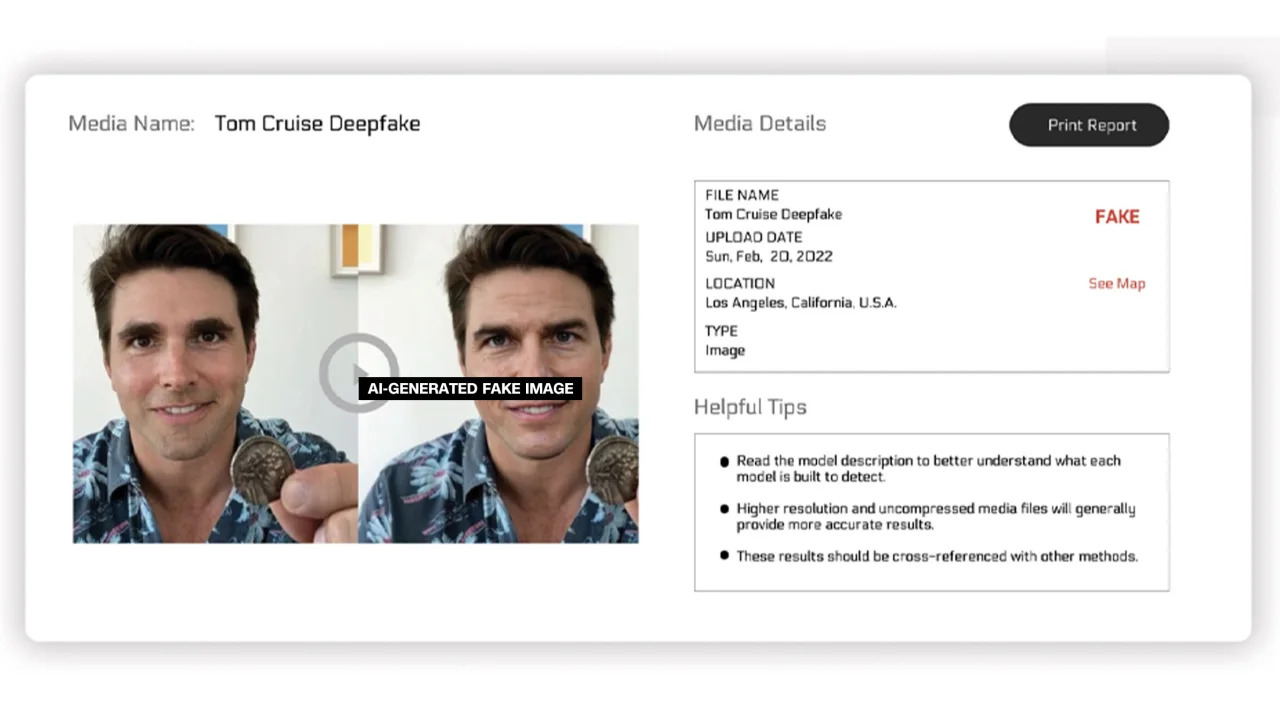

Reality Defender와 Hive Moderation은 첫 번째 접근 방식을 연구하고 있습니다. 이들의 플랫폼을 통해 사용자는 스캔할 이미지를 업로드하고, 이미지가 실제인지 AI가 생성한 것인지를 백분율로 나타내는 분석 결과를 받을 수 있습니다.

Reality Defender는 자사 고유의 콘텐츠 지문 인식 및 딥페이크 기술을 사용하여 AI로 생성된 비디오, 오디오 및 이미지를 탐지한다고 밝혔습니다. 회사에서 제공한 예시에서 Reality Defender는 톰 크루즈의 딥페이크 이미지를 보여주는데, 이미지 속 인물의 얼굴이 왜곡되어 있다는 이유로 53%의 "의심스러움" 등급을 받았습니다. 이는 조작된 사진에서 흔히 나타나는 현상입니다.

AI가 생성한 태그로 분류된 이미지.

이러한 서비스들은 무료 버전과 유료 버전을 모두 제공합니다. Hive Moderation은 이미지 1,000장당 1.5달러를 청구한다고 밝혔습니다. Realty Defender는 고객의 전문성 및 회사 지원 필요 여부 등 다양한 요인에 따라 가격이 달라질 수 있다고 설명합니다. Realty Defender의 CEO인 벤 콜먼은 AI 도구를 사용하면 누구나 가짜 이미지를 만들 수 있기 때문에 위험성이 매달 두 배씩 증가하고 있다고 말합니다.

여러 다른 회사들도 이미지가 실제인지 AI가 생성한 것인지 인증하기 위해 이미지에 일종의 스티커를 통합하는 작업을 진행하고 있습니다. 현재까지 이러한 노력은 주로 콘텐츠 진위 및 출처 인증 연합(C2PA)에 의해 주도되어 왔습니다.

C2PA는 디지털 미디어의 출처와 이력을 인증하는 기술 표준을 만들기 위해 2021년에 설립되었으며, 어도비의 콘텐츠 진위성 이니셔티브(CAI)와 마이크로소프트 및 BBC가 주도하는 프로젝트 오리진(Project Origin)을 통합하여 디지털 뉴스에서 허위 정보를 퇴치하는 데 중점을 두고 있습니다. C2PA에는 트루픽(Truepic), 인텔(Intel), 소니(Sony) 등의 기업도 참여하고 있습니다.

C2PA(콘텐츠 대 콘텐츠 접근) 원칙에 따라 CAI는 기업들이 이미지에 대한 정보를 담은 콘텐츠 자격 증명 또는 메타데이터를 생성할 수 있는 오픈 소스 도구를 제공할 예정입니다. CAI 웹사이트에 따르면, 이를 통해 콘텐츠 제작자는 이미지 제작 과정에 대한 세부 정보를 투명하게 공유할 수 있습니다. 최종 사용자는 이미지가 누구에 의해, 무엇을, 어떻게 수정되었는지에 대한 맥락을 파악하고, 이미지의 진위 여부를 직접 평가할 수 있습니다.

많은 기업들이 C2PA 표준과 CAI 도구를 자사 애플리케이션에 통합했습니다. 어도비의 파이어플라이(포토샵에 추가된 새로운 AI 이미지 생성 도구)는 콘텐츠 자격 증명 기능을 통해 C2PA 표준을 준수합니다. 마이크로소프트 또한 빙 이미지 크리에이터와 마이크로소프트 디자이너를 사용하여 생성된 이미지와 비디오에 향후 몇 달 안에 암호화된 서명이 포함될 것이라고 발표했습니다.

지난 5월, 구글은 사용자가 이미지가 구글에 처음 등장한 시점과 다른 곳에서도 볼 수 있는 위치를 확인할 수 있는 "이미지 정보" 기능을 발표했습니다. 또한, 구글은 인공지능(AI)으로 생성된 모든 이미지에 원본 파일에 마크업을 추가하여 다른 웹사이트나 플랫폼에서 해당 이미지를 발견할 경우 "맥락 정보"를 제공할 것이라고 밝혔습니다.

기술 기업들이 인공지능(AI) 생성 이미지와 디지털 미디어의 무결성에 대한 우려를 해소하기 위해 노력하는 가운데, 전문가들은 문제 해결을 위해서는 기업들이 서로 협력하고 정부와도 협력해야 한다고 강조합니다. 그럼에도 불구하고, 기술 기업들은 이러한 위험에도 불구하고 AI 개발 경쟁을 계속하고 있습니다.

[광고_2]

출처 링크

댓글 (0)