|

ຜູ້ໃຊ້ອິນເຕີເນັດໃຊ້ AI ເພື່ອສ້າງຮູບພາບຂອງຜູ້ຕ້ອງສົງໄສຄາດຕະກໍາ Charlie Kirk. ພາບ: CBC . |

ຫ້ອງການສືບສວນຂອງລັດຖະບານກາງສະຫະລັດ (FBI) ໄດ້ເປີດເຜີຍຮູບຖ່າຍ 2 ຮູບທີ່ສະແດງໃຫ້ເຫັນຜູ້ຕ້ອງສົງໄສທີ່ພົວພັນກັບການຍິງສັງຫານນັກເຄື່ອນໄຫວ Charlie Kirk. ເນື່ອງຈາກວ່າຮູບພາບແມ່ນຂ້ອນຂ້າງມົວ, ຊຸມຊົນອອນໄລນ໌ໄດ້ຕອບສະຫນອງຢ່າງໄວວາດ້ວຍ "ການປັບປຸງ" ຮຸ່ນຂອງຮູບພາບໂດຍໃຊ້ປັນຍາປະດິດ (AI).

ຮູບພາບເຫຼົ່ານີ້ເບິ່ງແຫຼມແລະຊັດເຈນກ່ວາຕົ້ນສະບັບ, ແຕ່ວ່າມັນເປັນພຽງແຕ່ຜະລິດຕະພັນຂອງການຄາດຄະເນ. AI ບໍ່ມີຄວາມສາມາດໃນການ " ຄົ້ນພົບ " ລາຍລະອຽດທີ່ເຊື່ອງໄວ້ໃນຮູບພາບທີ່ມົວ. ແທນທີ່ຈະ, ເຄື່ອງມືຄາດຄະເນ, ຕື່ມຂໍ້ມູນໃສ່ຊ່ອງຫວ່າງໂດຍອີງໃສ່ຂໍ້ມູນທີ່ຮຽນຮູ້, ເຊິ່ງສາມາດຫມາຍຄວາມວ່າການສ້າງລາຍລະອຽດທີ່ບໍ່ມີຢູ່ໃນຄວາມເປັນຈິງ.

|

ຮູບພາບທີ່ປັບປຸງ AI ຂອງຜູ້ຕ້ອງສົງໄສໃນການຍິງ Charlie Kirk, ແຕ່ບໍ່ມີສອງໃບຫນ້າຄືກັນ. ຮູບພາບ: Grok. |

ຮູບພາບທີ່ປັບປຸງຫຼາຍຮູບແບບໄດ້ຖືກເຜີຍແຜ່ພາຍໃຕ້ການຕອບສະໜອງຂອງ FBI. ບາງຮູບພາບອາດຈະຖືກສ້າງຂື້ນໂດຍໃຊ້ເຄື່ອງມື Grok ໃນ X, ໃນຂະນະທີ່ຄົນອື່ນເຊື່ອວ່າໄດ້ຖືກສ້າງຂື້ນໂດຍໃຊ້ເວທີເຊັ່ນ ChatGPT ແລະ Gemini. ຢ່າງໃດກໍຕາມ, ຄວາມຖືກຕ້ອງຂອງການສະແດງຜົນເຫຼົ່ານີ້ແຕກຕ່າງກັນຢ່າງຫຼວງຫຼາຍ. ບາງຮູບກໍ່ສະແດງໃຫ້ເຫັນເຖິງຄວາມບໍ່ຖືກຕ້ອງຢ່າງຈະແຈ້ງ, ເຊັ່ນ: ການປ່ຽນສີຂອງເສື້ອ ຫຼື ເຮັດໃຫ້ໜ້າຕົວລະຄອນມີລັກສະນະຕ່າງອອກໄປດ້ວຍຄາງທີ່ເກີນຈິງ.

ມັນເບິ່ງຄືວ່າຮູບພາບເຫຼົ່ານີ້ໄດ້ຖືກແບ່ງປັນດ້ວຍເຫດຜົນຂອງ "ຊ່ວຍ" ຊຸມຊົນເພື່ອກໍານົດຜູ້ຕ້ອງສົງໄສ. ແຕ່ໃນຄວາມເປັນຈິງ, ພວກເຂົາຍັງກາຍເປັນເຄື່ອງມືເພື່ອດຶງດູດຄວາມສົນໃຈ, ເພື່ອເພີ່ມຄວາມມັກແລະການແບ່ງປັນໃນເຄືອຂ່າຍສັງຄົມ.

ຜູ້ຊ່ຽວຊານເຕືອນວ່າມັນບໍ່ຫນ້າຈະເປັນໄປໄດ້ວ່າຮູບພາບ AI ເຫຼົ່ານີ້ຈະເປັນປະໂຫຍດຫຼາຍກ່ວາຕົ້ນສະບັບຂອງ FBI. ໃນຄວາມເປັນຈິງ, ໃນບາງກໍລະນີທີ່ຜ່ານມາ, ຮູບພາບທີ່ປັບປຸງ AI ໄດ້ຜະລິດຜົນການຂັດແຍ້ງ.

ຕົວຢ່າງ, ຮູບພາບທີ່ມີຄວາມລະອຽດຕໍ່າຂອງອະດີດປະທານາທິບໍດີ Barack Obama ໄດ້ຖືກ “ອັບເກຣດ” ໂດຍ AI ເພື່ອສະແດງໃຫ້ຄົນຜິວຂາວ. ໃນກໍລະນີອື່ນ, ຮູບພາບຂອງປະທານາທິບໍດີ Donald Trump ມີເນື້ອງອກທີ່ບໍ່ມີຢູ່ແລ້ວເພີ່ມໃສ່ຫົວຂອງລາວໂດຍ AI.

ຄວາມແຕກຕ່າງເຫຼົ່ານີ້ຊີ້ໃຫ້ເຫັນວ່າ AI ແມ່ນພຽງແຕ່ສະກັດຈາກຂໍ້ມູນທີ່ມີຢູ່ແລ້ວ, ແທນທີ່ຈະສ້າງສິ່ງທີ່ສູນເສຍໃນຮູບພາບທີ່ມົວຢ່າງຖືກຕ້ອງ. ໃນຂະນະທີ່ເຕັກໂນໂລຢີອາດຈະເປັນປະໂຫຍດໃນບາງສະພາບການ, ຮູບພາບທີ່ສ້າງໂດຍ AI ບໍ່ຄວນຖືວ່າເປັນຫຼັກຖານທີ່ແນ່ນອນໃນການສືບສວນຄະດີອາຍາ.

FBI ຕົວຂອງມັນເອງ, ໃນການປະກາດຂອງຕົນ, ພຽງແຕ່ເປີດເຜີຍຮູບຕົ້ນສະບັບແລະຮຽກຮ້ອງໃຫ້ປະຊາຊົນໃຫ້ຂໍ້ມູນຖ້າພວກເຂົາສາມາດລະບຸຕົວບຸກຄົນໃນຮູບ. ຢ່າງໃດກໍ່ຕາມ, ຄື້ນຂອງ "ຮູບພາບທີ່ປັບປຸງຕົນເອງ" ໃນເຄືອຂ່າຍສັງຄົມໄດ້ດຶງດູດຄວາມສົນໃຈຢ່າງໄວວາ, ສ້າງຄໍາຖາມກ່ຽວກັບຄວາມຮັບຜິດຊອບຂອງການນໍາໃຊ້ເຄື່ອງມື AI ໃນກໍລະນີທີ່ມີຄວາມອ່ອນໄຫວທີ່ກ່ຽວຂ້ອງກັບຄວາມປອດໄພແລະຊີວິດຂອງມະນຸດ.

ຍ້ອນວ່າປັນຍາປະດິດກາຍເປັນການນໍາໃຊ້ຢ່າງກວ້າງຂວາງ, ເຫດການນີ້ຊີ້ໃຫ້ເຫັນບັນຫາ: AI ສາມາດສ້າງຮູບພາບທີ່ມີລັກສະນະທີ່ແທ້ຈິງທີ່ພວກມັນຫຼອກລວງຕາ, ແຕ່ນັ້ນບໍ່ໄດ້ຫມາຍຄວາມວ່າພວກມັນມີຄວາມຫນ້າເຊື່ອຖື. ໂດຍສະເພາະໃນການຕິດຕາມທາງອາຍາ, ຂໍ້ມູນທີ່ບໍ່ຖືກຕ້ອງສາມາດນໍາໄປສູ່ຜົນສະທ້ອນທີ່ຮ້າຍແຮງ.

ທີ່ມາ: https://znews.vn/hinh-anh-nghi-pham-am-sat-charlie-kirk-bi-lam-gia-post1584664.html

![[Infographic] ຕົວເລກທີ່ໂດດເດັ່ນຫຼັງຈາກ 3 ເດືອນຂອງ "ການຈັດລະບຽບປະເທດ"](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/ce8bb72c722348e09e942d04f0dd9729)

![[ຮູບພາບ] ນັກສຶກສາໂຮງຮຽນປະຖົມບິ່ງມິງມ່ວນຊື່ນໃນວັນບຸນເຕັມດວງ, ໄດ້ຮັບຄວາມເບີກບານມ່ວນຊື່ນໃນໄວເດັກ.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/3/8cf8abef22fe4471be400a818912cb85)

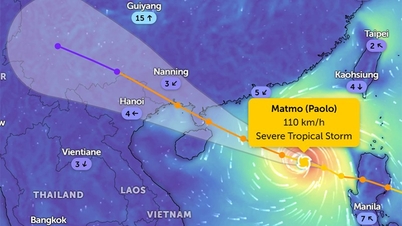

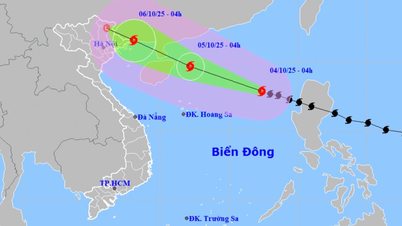

![[ຮູບພາບ] ທ່ານນາຍົກລັດຖະມົນຕີ ຟ້າມມິງຈິ້ງ ເປັນປະທານກອງປະຊຸມຜັນຂະຫຍາຍການແກ້ໄຂຜົນຮ້າຍຢ້ອນຫຼັງຈາກພະຍຸເລກ 10.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/3/544f420dcc844463898fcbef46247d16)

![[Infographic] ຕົວເລກທີ່ໂດດເດັ່ນຫຼັງຈາກ 3 ເດືອນຂອງ "ການຈັດລະບຽບປະເທດ"](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/4/ce8bb72c722348e09e942d04f0dd9729)

(0)