ດ້ວຍຈັງຫວະຄວາມກ້າວໜ້າຢ່າງວ່ອງໄວ, ປັນຍາປະດິດ (AI) ກຳລັງປະຕິວັດຫຼາຍຂົງເຂດ - ຕັ້ງແຕ່ການດູແລສຸຂະພາບ, ການສຶກສາ , ແລະ ທຸລະກິດ ຈົນເຖິງຊີວິດປະຈຳວັນ. ເຖິງຢ່າງໃດກໍ່ຕາມ, ຂໍ້ເສຍຂອງເທັກໂນໂລຢີນີ້ກໍ່ໃຫ້ເກີດສິ່ງທ້າທາຍທີ່ສຳຄັນຕໍ່ການຄຸ້ມຄອງ ແລະ ການຄວບຄຸມຂໍ້ມູນໃນໂລກໄຊເບີ.

ເຕັມໄປດ້ວຍຂ່າວປອມທີ່ຜະລິດໂດຍ AI.

ຂ່າວປອມທີ່ສ້າງຂຶ້ນໂດຍ AI ແມ່ນຖືກເຜີຍແຜ່ໃນເວທີສື່ສັງຄົມອອນໄລນ໌ ສ່ວນໃຫຍ່ແມ່ນເພື່ອໃຫ້ໄດ້ຮັບການເບິ່ງ, ການກົດໄລຄ໌ ແລະ ການມີສ່ວນຮ່ວມໃນການຂາຍອອນໄລນ໌ ຫຼື ເພື່ອຫາກຳໄລຈາກເວທີດັ່ງກ່າວ.

ຜູ້ທີ່ສ້າງຂ່າວປອມມັກຈະໃຊ້ປະໂຫຍດຈາກເຫດການປັດຈຸບັນທີ່ກຳລັງດຶງດູດຄວາມສົນໃຈຂອງປະຊາຊົນ. ຕົວຢ່າງ, ຫຼັງຈາກອຸບັດຕິເຫດຈະລາຈອນຮ້າຍແຮງໃນວັນທີ 17 ກັນຍາ ທີ່ຕະຫຼາດເຕິນລອງ, ບ້ານລາວບາວ, ແຂວງ ກວາງຈິ , ເຊິ່ງເຮັດໃຫ້ມີຜູ້ເສຍຊີວິດ 12 ຄົນ, ຮູບພາບທີ່ໂສກເສົ້າບາງຮູບໄດ້ປາກົດຢູ່ໃນສື່ສັງຄົມອອນລາຍ, ເຮັດໃຫ້ຜູ້ຊົມຫຼາຍຄົນຮ້ອງໄຫ້. ໂດຍລະບຸວ່າຮູບພາບເຫຼົ່ານີ້ຖືກສ້າງຂຶ້ນໂດຍ AI, ຕຳຫຼວດບ້ານລາວບາວໄດ້ອອກຄຳເຕືອນກ່ຽວກັບການເຜີຍແຜ່ຮູບພາບປອມທີ່ຫຼອກລວງເຫຼົ່ານີ້. ພຶດຕິກຳນີ້ບໍ່ພຽງແຕ່ເຜີຍແຜ່ຂໍ້ມູນທີ່ບໍ່ຖືກຕ້ອງເທົ່ານັ້ນ ແຕ່ຍັງເປັນອຸປະສັກຕໍ່ການສືບສວນອີກດ້ວຍ.

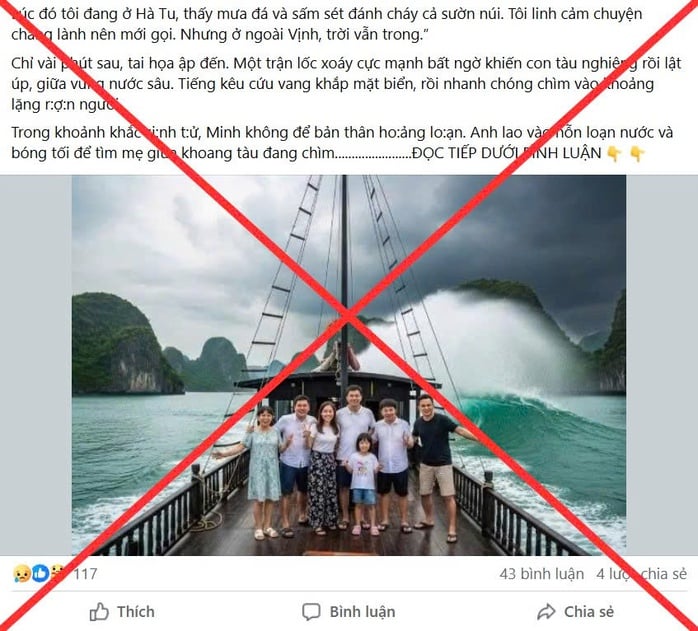

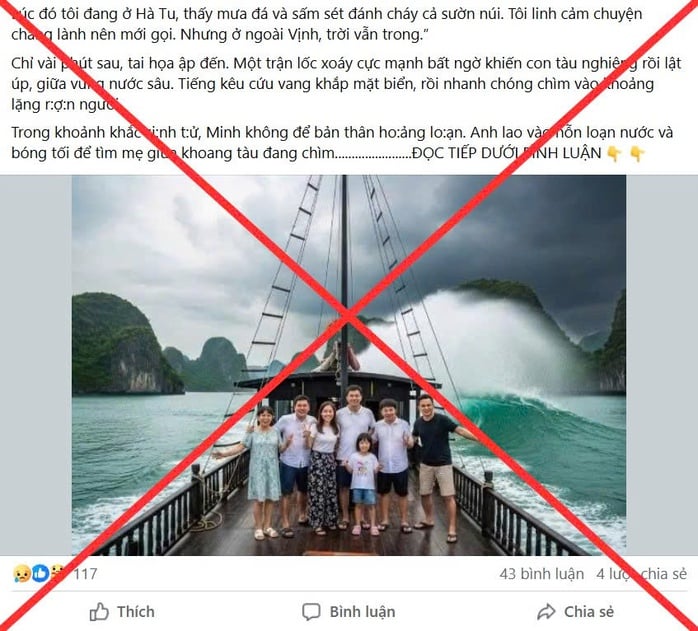

ໃນລັກສະນະດຽວກັນ, ໂດຍໄດ້ໃຊ້ປະໂຫຍດຈາກຄວາມສົນໃຈຂອງສາທາລະນະຊົນກ່ຽວກັບເຫດການເຮືອ ທ່ອງທ່ຽວ Green Bay 58 ຫຼົ້ມຢູ່ອ່າວຮ່າລອງ, ແຂວງກວາງນິງ ໃນວັນທີ 19 ກໍລະກົດ ເຊິ່ງເຮັດໃຫ້ມີຜູ້ເສຍຊີວິດຫຼາຍສິບຄົນ, ບັນຊີສື່ສັງຄົມຫຼາຍບັນຊີໄດ້ໂພສຮູບພາບ ແລະ ເລື່ອງລາວທີ່ເຕັມໄປດ້ວຍອາລົມກ່ຽວກັບຜູ້ເຄາະຮ້າຍ. ຢ່າງໃດກໍຕາມ, ສ່ວນໃຫຍ່ຂອງເນື້ອຫານີ້ແມ່ນປອມ, ສ້າງຂຶ້ນໂດຍໃຊ້ AI ເພື່ອຫຼອກລວງອາລົມ ແລະ ດຶງດູດການພົວພັນຂອງຜູ້ໃຊ້ສື່ສັງຄົມ. ສິ່ງທີ່ໜ້າສັງເກດແມ່ນການນຳໃຊ້ຮູບພາບປອມຢ່າງກວ້າງຂວາງດ້ວຍຄວາມເຫັນອົກເຫັນໃຈທີ່ເກີນຈິງສາມາດເຮັດໃຫ້ຄອບຄົວຂອງຜູ້ເຄາະຮ້າຍເຈັບປວດໄດ້ຕື່ມອີກ.

ດ້ວຍເທັກໂນໂລຢີ AI ທີ່ມີການປັບປຸງຢ່າງຕໍ່ເນື່ອງ, ມັນໃຊ້ເວລາພຽງແຕ່ສອງສາມນາທີ ແລະ ຄຳສັ່ງງ່າຍໆເພື່ອສ້າງວິດີໂອທີ່ມີເນື້ອຫາທີ່ໜ້າສົນໃຈ ແລະ ກົງກັບຄວາມຕັ້ງໃຈຂອງຜູ້ໃຊ້ຢ່າງສົມບູນ. ໃນບັນດາສິ່ງເຫຼົ່ານີ້, ແພລດຟອມ AI ລຸ້ນຕໍ່ໄປເຊັ່ນ KlingAI, Veo 3, ແລະ Sora ແມ່ນໄດ້ຮັບຄວາມນິຍົມຫຼາຍຈາກຜູ້ໃຊ້ທົ່ວໂລກ, ລວມທັງຫວຽດນາມ.

ນອກຈາກນັ້ນ, ເທັກໂນໂລຢີ deepfake - ເຊິ່ງເປັນການປະສົມປະສານຂອງການຮຽນຮູ້ເລິກ ແລະ ການປອມແປງ - ຍັງເປັນຄວາມກັງວົນອັນໃຫຍ່ຫຼວງໃນທົ່ວໂລກ ເພາະມັນສາມາດຖືກນໍາໃຊ້ເພື່ອສ້າງຮູບພາບ, ສຽງ ຫຼື ວິດີໂອທີ່ເບິ່ງຄືວ່າເປັນຈິງຫຼາຍຈົນຍາກທີ່ຈະກວດພົບວ່າເປັນຂອງປອມ. ດັ່ງນັ້ນ, ການຫຼອກລວງຫຼາຍຢ່າງທີ່ກ່ຽວຂ້ອງກັບເທັກໂນໂລຢີນີ້ໄດ້ເກີດຂຶ້ນທັງໃນຫວຽດນາມ ແລະ ທົ່ວໂລກ.

ພົນໂທ ຫງວຽນ ມິງ ຈິນ, ຮອງປະທານຖາວອນຂອງສະມາຄົມຄວາມປອດໄພທາງໄຊເບີແຫ່ງຊາດ, ໄດ້ສັງເກດເຫັນແນວໂນ້ມທີ່ເພີ່ມຂຶ້ນຂອງການລ່ວງລະເມີດ AI ເພື່ອຈຸດປະສົງທີ່ຜິດກົດໝາຍ. ໂດຍສະເພາະ, AI-as-a-Service (ເຄື່ອງມື ແລະ ແອັບພລິເຄຊັນທີ່ສະໜອງໃຫ້ໂດຍ AI) ກຳລັງຖືກນຳໃຊ້ໂດຍອາດຊະຍາກອນທາງໄຊເບີເພື່ອສ້າງມັນແວ, ສຽງປອມແປງ, ໃບໜ້າ ແລະ ຂໍ້ຄວາມ... ສຳລັບການສໍ້ໂກງ, ການໂຈມຕີທາງໄຊເບີ, ການບຸກລຸກລະບົບຂໍ້ມູນ, ແລະ ແມ່ນແຕ່ການທຳລາຍຄວາມປອດໄພ ແລະ ທຳລາຍຊື່ສຽງຂອງອົງກອນ, ທຸລະກິດ ແລະ ຜູ້ນຳ.

ອີງຕາມທ່ານ ເຈິ່ນ ຫງອກ ແອງ, ຜູ້ອຳນວຍການດ້ານເຕັກນິກຂອງບໍລິສັດ Hoa Binh Cyber Space Company Limited (CyPeace), ໜຶ່ງໃນຄວາມສ່ຽງສຳລັບຜູ້ໃຊ້ AI ແມ່ນທ່າແຮງທີ່ຈະໄດ້ຮັບຂໍ້ມູນທີ່ບໍ່ຖືກຕ້ອງທີ່ເກີດຈາກເຄື່ອງມືນັ້ນເອງ. ນອກຈາກນັ້ນ, ຍັງມີບັນຫາອື່ນໆອີກຫຼາຍຢ່າງເຊັ່ນ: ການຮົ່ວໄຫຼຂອງຂໍ້ມູນລັບ ແລະ ຂໍ້ມູນສ່ວນຕົວ.

ຮູບພາບປອມກຳລັງຖືກເຜີຍແຜ່ທາງອອນລາຍເພື່ອ "ເຮັດໃຫ້ຜູ້ຊົມຮ້ອງໄຫ້", ດັ່ງນັ້ນຈຶ່ງໄດ້ຮັບການກົດໄລຄ໌ ແລະ ເພີ່ມການໂຕ້ຕອບ (ພາບໜ້າຈໍ).

ການປັບປຸງຄວາມຮັບຜິດຊອບຂອງຜູ້ໃຊ້

ກ່ອນທີ່ຈະມີມາດຕະການທາງດ້ານເຕັກໂນໂລຊີ ແລະ ກົດໝາຍເພື່ອຄວບຄຸມການພັດທະນາ ແລະ ການນຳໃຊ້ AI ຢ່າງເຂັ້ມງວດ, ຜູ້ໃຊ້ຈຳເປັນຕ້ອງນຳໃຊ້ເຕັກໂນໂລຊີນີ້ຢ່າງມີຄວາມຮັບຜິດຊອບ.

ທ່ານ ຫວູ ຫງອກ ເຊີນ ຜູ້ຊ່ຽວຊານດ້ານຄວາມປອດໄພທາງໄຊເບີ, ຫົວໜ້າຄະນະກຳມະການເຕັກໂນໂລຊີຂອງສະມາຄົມຄວາມປອດໄພທາງໄຊເບີແຫ່ງຊາດ, ໄດ້ຊີ້ໃຫ້ເຫັນວ່າ ມະນຸດແມ່ນຜູ້ທີ່ຂູດຮີດ ແລະ ນຳໃຊ້ AI, ສະນັ້ນທັງດ້ານດີ ແລະ ດ້ານບໍ່ດີຂອງ AI ແມ່ນກ່ຽວຂ້ອງຢ່າງໃກ້ຊິດກັບມະນຸດ. ຖ້າຜູ້ໃຊ້ມີທັກສະ ແລະ ນຳໃຊ້ມັນເພື່ອຈຸດປະສົງທີ່ດີ, ເຕັກໂນໂລຊີຈະນຳໃຊ້ຈຸດແຂງຂອງມັນໃຫ້ເປັນປະໂຫຍດ. ໃນທາງກົງກັນຂ້າມ, ຖ້າຜູ້ໃຊ້ AI ຂາດຄວາມເຂົ້າໃຈ ຫຼື ນຳໃຊ້ມັນເພື່ອຈຸດປະສົງທີ່ຜິດກົດໝາຍ, ມັນສາມາດເຮັດໃຫ້ເກີດຜົນສະທ້ອນທີ່ຮ້າຍແຮງ. "ເພື່ອນຳໃຊ້ ແລະ ນຳໃຊ້ AI ຢ່າງມີປະສິດທິພາບ, ມັນຈຳເປັນຕ້ອງສຸມໃສ່ການສ້າງທີມງານ ແລະ ຂະບວນການຕ່າງໆ. AI ຈະຮັບຮູ້ຄຸນຄ່າຂອງມັນເມື່ອຢູ່ໃນມືຂອງຜູ້ທີ່ຮູ້ວິທີການເປັນແມ່ບົດໃນມັນ," ຜູ້ຊ່ຽວຊານດ້ານຄວາມປອດໄພທາງໄຊເບີກ່າວ.

ເນື່ອງຈາກອັນຕະລາຍຂອງເທັກໂນໂລຢີ deepfake - ເຄື່ອງມືຊັ້ນນໍາທີ່ອໍານວຍຄວາມສະດວກໃຫ້ແກ່ການສໍ້ໂກງທາງໄຊເບີໃນປະຈຸບັນ - ກະຊວງການເງິນໄດ້ເນັ້ນໜັກໃນລະຫວ່າງການຮ່າງກົດໝາຍວ່າດ້ວຍການລົງທຶນ ແລະ ທຸລະກິດວ່າ ທຸລະກິດເທັກໂນໂລຢີ deepfake ຈໍາເປັນຕ້ອງໄດ້ຮັບການຄວບຄຸມເປັນຂະແໜງທຸລະກິດທີ່ມີເງື່ອນໄຂເພື່ອປ້ອງກັນການໃຊ້ເທັກໂນໂລຢີໃນທາງທີ່ຜິດທີ່ເຮັດໃຫ້ເກີດການລົບກວນຂໍ້ມູນຂ່າວສານ ແລະ ການສໍ້ໂກງ. ອີງຕາມກະຊວງການເງິນ, ທຸລະກິດເທັກໂນໂລຢີ deepfake ໃນປະຈຸບັນແມ່ນໜຶ່ງໃນຂົງເຂດໃໝ່ທີ່ມີຄວາມສ່ຽງທີ່ສັບສົນຕໍ່ຄວາມປອດໄພ ແລະ ຄວາມເປັນລະບຽບຮຽບຮ້ອຍ, ແຕ່ມັນບໍ່ໄດ້ຖືກຄວບຄຸມເປັນຂະແໜງທຸລະກິດທີ່ມີເງື່ອນໄຂ.

ອີງຕາມທະນາຍຄວາມ Tran Anh Tuan (ສະມາຄົມທະນາຍຄວາມຮ່າໂນ້ຍ), ການໃຊ້ AI ເພື່ອສ້າງເນື້ອຫາໂດຍບໍ່ໄດ້ຮັບອະນຸຍາດ, ໂດຍສະເພາະເພື່ອສ້າງຂໍ້ມູນທີ່ບໍ່ຖືກຕ້ອງ, ປອມແປງ, ຫຼື ຫຼອກລວງ, ອາດຈະລະເມີດບົດບັນຍັດຂອງປະມວນກົດໝາຍແພ່ງ. ຜູ້ລະເມີດອາດຈະປະເຊີນກັບການລົງໂທດທາງການບໍລິຫານ ຫຼື ການຊົດເຊີຍຄ່າເສຍຫາຍ. ໃນກໍລະນີທີ່ກໍ່ໃຫ້ເກີດຜົນສະທ້ອນທີ່ຮ້າຍແຮງ, ອາດຈະມີການດຳເນີນຄະດີອາຍາ. "ຜູ້ໃຊ້ຕ້ອງລະມັດລະວັງເມື່ອເຂົ້າເຖິງ ແລະ ນຳໃຊ້ AI, ຫຼີກລ່ຽງການກະທຳໃດໆທີ່ນຳໃຊ້ AI ເພື່ອໃຫ້ໄດ້ມຸມມອງ ຫຼື ຄວາມມັກ; ພວກເຂົາຄວນເພີ່ມຄວາມຮັບຜິດຊອບສ່ວນຕົວ ແລະ ປະຕິບັດຕາມກົດໝາຍເມື່ອນຳໃຊ້ AI ແລະ ເຂົ້າຮ່ວມໃນສະພາບແວດລ້ອມອອນໄລນ໌," ທະນາຍຄວາມ Tuan ໃຫ້ຄຳແນະນຳ.

ພົນໂທ ຫງວຽນມິງຈິນ ໄດ້ເນັ້ນໜັກວ່າ ອົງປະກອບຫຼັກໃນການພັດທະນາ AI ແບບຍືນຍົງແມ່ນຊັບພະຍາກອນມະນຸດ. ຕັ້ງແຕ່ນັກຄົ້ນຄວ້າ, ວິສະວະກອນ, ຜູ້ຊ່ຽວຊານດ້ານຄວາມປອດໄພທາງໄຊເບີ ຈົນເຖິງຜູ້ຈັດການ ແລະ ຜູ້ໃຊ້, ທຸກຄົນຈຳເປັນຕ້ອງມີຄວາມຮູ້, ທັກສະ, ຈັນຍາບັນ ແລະ ຄວາມຮັບຮູ້ທາງດ້ານກົດໝາຍຢ່າງຄົບຖ້ວນ. ອີງຕາມທ່ານ, ນີ້ບໍ່ພຽງແຕ່ເປັນທີມງານທີ່ສ້າງ ແລະ ດຳເນີນງານລະບົບ AI ເທົ່ານັ້ນ ແຕ່ຍັງເປັນກຳລັງຫຼັກໃນການປ້ອງກັນ, ກວດພົບ ແລະ ຕໍ່ສູ້ກັບອາຊະຍາກຳເຕັກໂນໂລຊີສູງໃນໂລກໄຊເບີ.

ຫວຽດນາມຈະມີກົດໝາຍວ່າດ້ວຍປັນຍາປະດິດ.

ໃນກອງປະຊຸມວິທະຍາສາດແຫ່ງຊາດກ່ຽວກັບ AI ເມື່ອບໍ່ດົນມານີ້, ທ່ານ ຫງວຽນ ແມັງ ຮຸ່ງ ລັດຖະມົນຕີກະຊວງວິທະຍາສາດ ແລະ ເຕັກໂນໂລຊີ ໄດ້ກ່າວວ່າ AI ເປີດໂອກາດອັນໃຫຍ່ຫຼວງ ແຕ່ຍັງຍົກບັນຫາຫຼາຍຢ່າງກ່ຽວກັບຈັນຍາບັນ, ການຈ້າງງານ ແລະ ຄວາມໄວ້ວາງໃຈທາງສັງຄົມ. ດັ່ງນັ້ນ, ການພັດທະນາ AI ຕ້ອງວ່ອງໄວ, ປອດໄພ ແລະ ມີມະນຸດສະທຳ.

ຕາມທີ່ທ່ານລັດຖະມົນຕີ ຫງວຽນ ແມັງ ຮຸ່ງ, AI ບໍ່ໄດ້ທົດແທນມະນຸດ ແຕ່ຮັບໃຊ້ມະນຸດ, ເຮັດໜ້າທີ່ເປັນຜູ້ຊ່ວຍຂອງເຂົາເຈົ້າ. AI ເປັນເຄື່ອງມືທີ່ມີປະສິດທິພາບ, ແຕ່ມະນຸດເປັນຜູ້ຕັດສິນໃຈ; ດັ່ງນັ້ນ, AI ຄວນສະໜັບສະໜູນ, ບໍ່ແມ່ນທົດແທນ, ຄວາມຄິດ, ຄຸນຄ່າ ແລະ ຄວາມຮັບຜິດຊອບຂອງມະນຸດ. "ກະຊວງວິທະຍາສາດ ແລະ ເຕັກໂນໂລຊີຈະອອກລະຫັດຈັນຍາບັນແຫ່ງຊາດສຳລັບ AI ທີ່ສອດຄ່ອງກັບມາດຕະຖານສາກົນ ແຕ່ຖືກອອກແບບມາໃຫ້ເໝາະສົມກັບຄວາມເປັນຈິງຂອງຫວຽດນາມ, ແລະ ຍັງຈະພັດທະນາກົດໝາຍ AI ແລະ ຍຸດທະສາດ AI," ທ່ານລັດຖະມົນຕີ ຫງວຽນ ແມັງ ຮຸ່ງ ກ່າວ.

ແຫຼ່ງຂໍ້ມູນ: https://nld.com.vn/ngan-cong-nghe-vuot-ranh-gioi-dao-duc-196250923205638915.htm

![[ວິດີໂອ] ຈະເຮັດແນວໃດເມື່ອປ່ຽນໂທລະສັບຕັ້ງແຕ່ວັນທີ 15 ມິຖຸນາ 2026?](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/06/02/1780386426938_dt-jpg.webp)

(0)