Di bawah ialah pendapat dua pakar dari Universiti RMIT mengenai kesan berbahaya daripada deepfake dan cadangan penyelesaian untuk masalah ini:

|

| Dr. Jonathan Crellin (kiri) dan Dr. Nguyen Van Thang Long (kanan). (Sumber: Universiti RMIT) |

Penjenayah siber mengeksploitasi teknologi baharu dengan cara yang tidak dijangka

Dr. Jonathan Crellin, Ketua Keselamatan Maklumat, Fakulti Sains , Kejuruteraan dan Teknologi, Universiti RMIT :

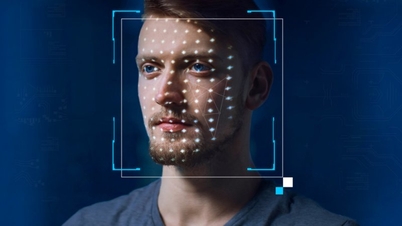

Deepfake ialah imej yang dihasilkan oleh mesin yang boleh menggabungkan imej atau video daripada pelbagai sumber, menghasilkan imej, video atau audio yang sangat realistik.

Deepfake bergantung pada teknik dalam AI yang dipanggil pembelajaran mesin, yang boleh menggantikan dan menyepadukan elemen seperti wajah seseorang ke dalam imej atau video lain.

Satu contoh penggunaan deepfake ialah menggabungkan kandungan lucah dengan foto Taylor Swift untuk mencipta imej palsu.

Untuk melakukan ini, dalang memerlukan beberapa imej supaya perisian itu dapat mempelajari tentang ekspresi wajah penyanyi wanita, kemudian menggabungkannya dengan kandungan lucah untuk mencipta gambar lucah sehingga menyebabkan imej penyanyi wanita itu tercemar.

Malah, dikhabarkan gambar-gambar ini dikeluarkan oleh kumpulan Telegram dan dicipta menggunakan alat Microsoft Designer dengan sokongan AI bersepadu.

Sesiapa sahaja boleh menjadi mangsa, kerana orang jahat hanya memerlukan gambar, video atau rakaman audio orang yang ditiru.

Berita palsu dalam pelbagai bentuk berpotensi digunakan untuk mencipta berita palsu, dan adalah selamat untuk mengatakan bahawa pilihan raya presiden AS yang akan datang akan dipenuhi dengan berita palsu tersebut.

Pada masa ini, penggubal undang-undang di seluruh dunia sedang mencari untuk menggubal undang-undang terhadap jenis imejan ini.

Beberapa pendekatan mula diterima pakai di Amerika Syarikat dari segi perundangan, seperti bergantung pada tindakan undang-undang sivil, atau undang-undang untuk menangani "penyebaran imej eksplisit seksual seseorang yang dihasilkan oleh AI tanpa persetujuan orang itu."

China juga memperkenalkan peraturan baharu yang akan membenarkan pendakwaan terhadap mereka yang menyebarkan imej yang dijana AI.

UK telah membuat perkongsian kandungan deepfake haram di bawah akta keselamatan dalam taliannya.

Bagaimana untuk mengesan atau mencegah ini?

Langkah pertama ialah mengurangkan bilangan foto, video atau rakaman audio yang anda miliki dalam talian. Pastikan anda hanya berkongsinya dengan orang yang anda kenali, bukan menyiarkannya secara meluas dalam talian. Sebaik sahaja sesuatu berada di internet, hampir mustahil untuk mengalih keluarnya.

Cara kedua ialah bersetuju dengan perkataan rahsia dengan keluarga anda untuk mengesahkan panggilan, mengurangkan risiko terjebak dalam perangkap panggilan palsu.

Imej, terutamanya video, boleh mempunyai ralat pelik (tampak berperingkat), jika anda melihat ralat ini maka terdapat kemungkinan besar imej atau bunyi tersebut telah dipalsukan.

Teknik lain yang boleh digunakan ialah mencari "imej terbalik" di Google atau enjin carian lain, untuk menentukan sumber imej asal.

Pengajaran terakhir ialah jangan percaya secara membuta tuli apa yang anda lihat, kamera (atau AI) boleh berbohong!

Deepfakes menimbulkan ancaman besar kepada selebriti dan ahli politik

Dr. Nguyen Van Thang Long, Pensyarah Kanan, Fakulti Komunikasi dan Reka Bentuk, Universiti RMIT :

Dengan penyebaran berita palsu daripada deepfakes, pasukan media selebriti dan ahli politik perlu mempunyai sumber yang tersedia untuk memantau dan bertindak balas dengan segera kepada berita palsu atau membetulkan berita palsu secara berterusan.

Jika deepfakes digabungkan secara sistematik dengan bentuk "PR kotor" yang teratur, tugas ini menjadi lebih sukar kerana percambahan maklumat yang bercanggah, dan berita palsu dan berita negatif akan sentiasa dikongsi lebih daripada berita positif.

Biasanya, apabila melihat berita yang dikongsi di rangkaian sosial, individu sering mempunyai tabiat mengesahkan maklumat melalui saluran media rasmi.

Dengan kandungan deepfake membanjiri media sosial, semakin sukar dan memakan masa untuk mengesahkan ketepatan berita arus perdana, memerlukan teknik penyelidikan dan pengesahan yang mendalam.

Semakin lama kita berlengah dalam mengesahkan berita dan sumber, semakin besar kemungkinan maklumat palsu, rekaan atau mengelirukan akan tersebar disebabkan kepantasan perkongsian dan ulasan di media sosial.

Ini memburukkan lagi masalah asas dan berpotensi membawa kepada pergolakan sosial, terutamanya jika kandungannya berkaitan dengan ucapan politik, agama, jantina, strategi perniagaan atau isu makroekonomi.

Dalam konteks proliferasi deepfake, strategi pengurusan risiko yang paling berkesan kekal untuk mengekalkan saluran komunikasi yang konsisten, melalui platform media sosial, laman web, atau pertemuan bersemuka yang popular, antara perniagaan, selebriti, ahli politik dan pemegang kepentingan utama seperti peminat, akhbar, komuniti dan pekerja.

|

Peningkatan penggunaan AI membawa manfaat dan masalah baharu yang tidak dijangka. Foto ilustrasi. (Sumber: Freepik) |

Dengan mengekalkan saluran komunikasi ini, menerima maklumat yang berkaitan dengan deepfakes menjadi lebih pantas, membolehkan pembetulan khabar angin yang tepat pada masanya dan berkesan, mendedahkan maklumat salah pada awalnya.

Walau bagaimanapun, syarikat, selebriti dan ahli politik perlu membangunkan pelan pengurusan krisis khusus untuk deepfake. Sebagai contoh, siapa yang melaporkan, melalui saluran media, kriteria untuk mengesahkan maklumat melalui bukti dan sumber yang bereputasi, mewujudkan garis masa untuk mengendalikan khabar angin, dan menggariskan strategi untuk memulihkan reputasi.

Dengan rancangan berkaedah yang disediakan dengan baik, menangani krisis deepfake akan menjadi lebih boleh dilaksanakan, meminimumkan akibat malang yang mungkin berlaku.

Sumber

![[Foto] Memotong bukit untuk memberi laluan kepada orang ramai melalui laluan 14E yang mengalami tanah runtuh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762599969318_ndo_br_thiet-ke-chua-co-ten-2025-11-08t154639923-png.webp)

![[Foto] "Kuburan kapal" di Teluk Xuan Dai](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762577162805_ndo_br_tb5-jpg.webp)

![[Video] Monumen Hue dibuka semula untuk mengalu-alukan pelawat](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

Komen (0)