DeepSeek, de meest veelbelovende Chinese startup van de afgelopen dagen, heeft twijfels doen rijzen over de bewering dat het met slechts 5 miljoen dollar een AI-systeem kan ontwikkelen dat vergelijkbaar is met dat van OpenAI.

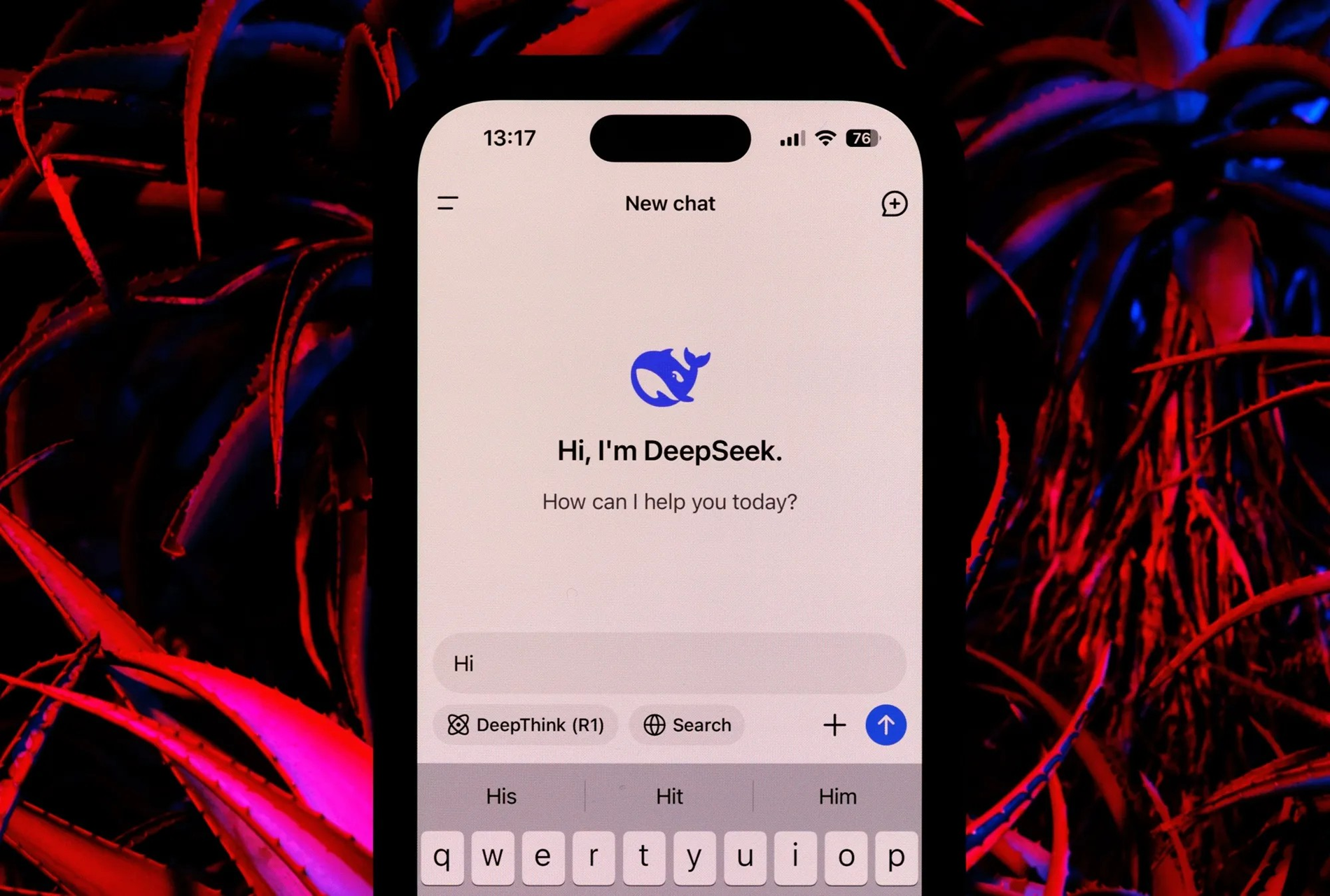

DeepSeek kreeg begin 2020, het Jaar van de Slang, uitgebreide media- en socialemedia-aandacht, wat aanzienlijke beroering op de wereldwijde aandelenmarkten veroorzaakte.

Een recent rapport van financieel adviesbureau Bernstein waarschuwt echter dat, ondanks indrukwekkende resultaten, de bewering dat er voor slechts 5 miljoen dollar een AI-systeem vergelijkbaar met dat van OpenAI is ontwikkeld, onjuist is.

Volgens Bernstein is de verklaring van DeepSeek misleidend en geeft deze geen volledig beeld.

"Wij geloven niet dat DeepSeek 'OpenAI heeft gecreëerd met 5 miljoen dollar'; de modellen zijn fantastisch, maar we denken niet dat het wonderen zijn; en de paniek van afgelopen weekend lijkt overdreven te zijn geweest," aldus het rapport.

DeepSeek ontwikkelt twee belangrijke AI-modellen: DeepSeek-V3 en DeepSeek R1. Het grootschalige V3-taalmodel maakt gebruik van de MOE-architectuur, waarbij kleinere modellen worden gecombineerd om hoge prestaties te bereiken met minder computerbronnen dan traditionele modellen.

Aan de andere kant heeft het V3-model 671 miljard parameters, waarvan er op elk gegeven moment 37 miljard actief zijn. Het bevat innovaties zoals MHLA om het geheugengebruik te verminderen en maakt gebruik van FP8 voor een hogere efficiëntie.

Voor het trainen van het V3-model was een cluster van 2048 Nvidia H800 GPU's nodig gedurende een periode van twee maanden, wat overeenkomt met 5,5 miljoen GPU-uren. Hoewel sommige schattingen de trainingskosten op ongeveer 5 miljoen dollar stellen, benadrukt Bernstein in zijn rapport dat dit bedrag alleen de computerbronnen dekt en geen rekening houdt met aanzienlijke kosten voor onderzoek, testen en andere ontwikkelingskosten.

Het DeepSeek R1-model bouwt voort op de basis van V3 door gebruik te maken van reinforcement learning (RL) en andere technieken om inferentiemogelijkheden te garanderen.

Het R1-model kan in redeneertaken concurreren met OpenAI-modellen. Bernstein wijst er echter op dat de ontwikkeling van R1 aanzienlijke middelen vergt, hoewel deze niet in het DeepSeek-rapport worden beschreven.

In een reactie op DeepSeek prees Bernstein de modellen als indrukwekkend. Zo presteert het V3-model bijvoorbeeld even goed of zelfs beter dan andere belangrijke taalmodellen in de taalkunde, programmering en wiskunde, terwijl het minder resources vereist.

Het V3-voorbereidingsproces vereiste slechts 2,7 miljoen GPU-uren, oftewel 9% van de rekenkracht van sommige andere topmodellen.

Bernstein concludeerde dat, hoewel de vooruitgang van DeepSeek opmerkelijk is, men op zijn hoede moet zijn voor overdreven beweringen. Het idee om met slechts 5 miljoen dollar een concurrent voor OpenAI te creëren, lijkt misplaatst.

(Volgens Times of India)

Bron: https://vietnamnet.vn/deepseek-khong-the-lam-ai-tuong-duong-openai-voi-5-trieu-usd-2367340.html

![[Foto] Premier Pham Minh Chinh leidt een bijeenkomst over de economische ontwikkeling van de particuliere sector.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F20%2F1766237501876_thiet-ke-chua-co-ten-40-png.webp&w=3840&q=75)

Reactie (0)