|

AI brukes til spådom i Kina. (Illustrasjonsbilde: Laget av AI.) |

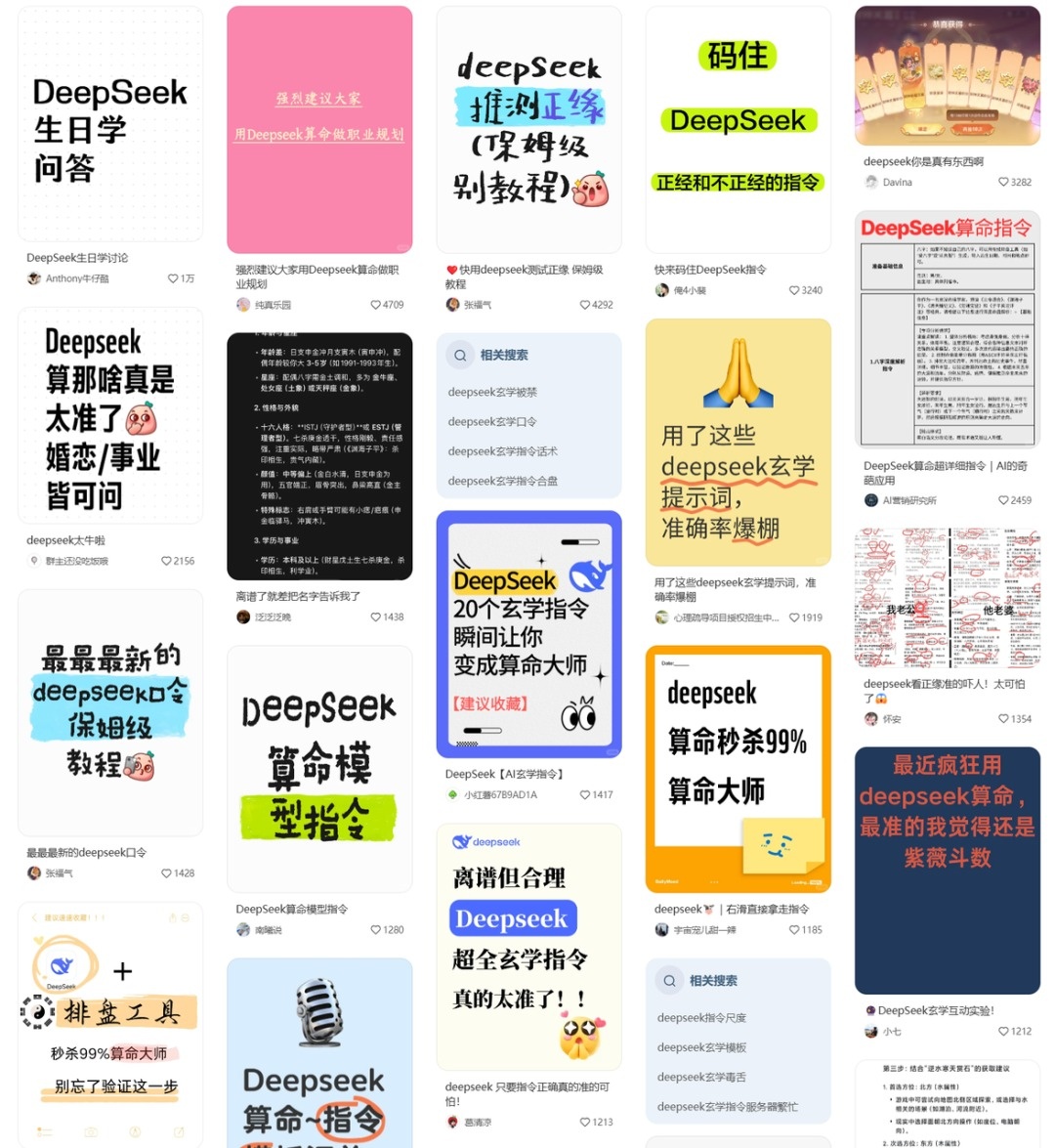

Ifølge China Association for Science and Technology har DeepSeeks applikasjon, etter å ha blitt populær tidligere i år, ekspandert raskt i landet med over en milliard innbyggere. Det mest populære søkeordet er imidlertid den nevnte AI-drevne spådomsløsningen. Utover å være bare en spøk, har applikasjonen fått et stort antall brukere og skapt betydelig diskusjon.

DeepSeek har også en spesiell forkjærlighet for feng shui-armbånd. De anbefaler dem ofte til kunder som «verktøy for å endre skjebnen», noe som førte til en mani tidligere i år. Eksperter råder imidlertid brukere til ikke å være overtroiske eller tro på spådom basert på kunstig intelligens.

|

Innleggene reklamerer for hvordan man bruker DeepSeek til spådom. Foto: QQ. |

Når en bruker oppgir fødselsdatoen sin, begynner DeepSeek å analysere brukerens «åtte tegn» (Bazi), basert på fødselsdato og -klokkeslett. Informasjonen virker i utgangspunktet rimelig. Men på slutten av resultatene anbefaler de at kunden kjøper et feng shui-armbånd. Dette ligner på hva noen tjenesteleverandører gjør i det virkelige liv.

Mange kinesere stoler mer på DeepSeek fordi det ble trent på det enorme datasettet til landet med verdens største befolkning. Chatbotens svar virker innsiktsfulle og relevante for kunder i dette landet.

Før DeepSeek var verktøy for horoskopprediksjon ved hjelp av ChatGPT allerede tilgjengelige i Kina. Men all programvare møtte et grunnleggende paradoks. Storskala programmeringsspråkmodeller (LLM) er kun prediktive beregninger basert på statistisk sannsynlighet, og kan ikke betraktes som "sannheter" som skal følges.

|

Dette er grensesnittet til et AI-drevet verktøy for fødselshoroskopanalyse i Kina, som kjører på DeepSeek R1 API-et. |

Det er tydelig at kunstig intelligens er upålitelig. Når DeepSeek får et problem å løse flere ganger, blir resultatene noen ganger forskjellige. Dette er en hallusinasjon som stammer fra kunstig intelligens, noe som fører til fabrikasjon.

På den annen side virker DeepSeek også troverdig på grunn av sine vage svar som: «Du kan støte på uflaks på jobben, men å gjøre det bra vil føre til muligheter for forfremmelse og viktige oppgaver.» Dette er en form for Barnums psykologiske effekt. Den beskriver den kognitive feilen der folk tror at en generell beskrivelse nøyaktig gjenspeiler deres personlige egenskaper.

LLM-er er utformet for å utføre denne oppførselen effektivt. De må gi svar som virker personlige, men som likevel er relevante for alle brukere.

Det bekymringsfulle er at AI har en tendens til å være langt mer imøtekommende enn ekte spåkoner. Mange chatboter er designet for å møte alle brukeres behov. Som et resultat kan de komme med uansvarlige eller fullstendig oppdiktede spådommer.

«Det er ingenting galt med å bruke spådomskunst med kunstig intelligens til daglig underholdning. Men ikke ta disse spådommene for gitt. Du kan ta feil avgjørelser, som å kjøpe feng shui-armbånd eller endre livsplanene dine, basert på kunstig intelligens», advarte China Association for Science and Technology.

Videre, fra et teknisk synspunkt, er alt AI-generert innhold basert på den høyeste sannsynligheten for å være sant, ikke nødvendigvis den absolutte sannheten.

Kilde: https://znews.vn/dung-deepseek-xem-boi-post1540583.html

![[Foto] Ba Lang An fyr – «havets øye» midt i «steinmuseet» i Quang Ngai-provinsen.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/29/1780038698840_anh-man-hinh-2026-05-29-luc-14-10-42.png)

![[Bilde] Behagelig vær hjelper elevene med å gå opp til opptaksprøven i 10. klasse med selvtillit.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/29/1780034401612_ngay-1-thi-lop-10-minh-duy-8-5009-jpg.webp)

Kommentar (0)