Etter at oppstartsbedriften OpenAI lanserte sin første AI-applikasjon, ChatGPT, sent i 2022, ble det utløst en bølge av utvikling av AI-applikasjoner, spesielt generativ AI, som ga mange fordeler til alle aspekter av livet. Dette medfører imidlertid også mange risikoer.

Krenkelse av privatlivets fred

I de senere årene har mange organisasjoner og enkeltpersoner lidd betydelige tap ettersom nettkriminelle har brukt AI til å lage falske videoklipp som etterligner bildene og stemmene til ekte mennesker. Et godt eksempel på dette er Deepfake-svindelen, som innebærer å lure den ekte personen til å tro at de er ekte.

Ifølge rapporten om identitetssvindel publisert av Sumsub i slutten av november 2023, økte deepfake-svindel globalt ti ganger i løpet av de to årene mellom 2022 og 2023. Dette var også perioden da AI-genererte applikasjoner eksploderte over hele verden .

Status Labs bemerker at Deepfake-teknologi har hatt betydelig innvirkning på kultur, personvern og personlig omdømme. Mye av nyhetene og oppmerksomheten rundt Deepfake har fokusert på kjendispornografi, hevninnhold, feilinformasjon, falske nyheter, utpressing og svindel. For eksempel ble et amerikansk energiselskap i 2019 svindlet for 243 000 dollar av hackere som utga seg for å være bedriftsledere og deres stemmer, og krevde at ansatte overførte penger til partnere.

Reuters rapporterte at omtrent 500 000 Deepfake-video- og lydfiler ble delt på sosiale medier over hele verden i 2023. I tillegg til Deepfakes som er laget for moro skyld, finnes det også svindelforsøk designet av ondsinnede aktører for å lure offentligheten. Noen kilder indikerer at Deepfake-svindelforsøk over hele verden forårsaket anslagsvis 11 millioner dollar i tap i 2022.

Mange teknologieksperter har advart om ulempene med AI, inkludert spørsmål om immaterielle rettigheter og autentisitet, og videre tvister om immaterielle rettigheter mellom «verk» skapt av AI. For eksempel kan noen bruke AI til å male et bilde om et bestemt emne, og en annen person kan også bruke AI til å gjøre det samme, noe som resulterer i malerier med mange likheter.

Dette fører lett til eierskapstvister. Verden har imidlertid ennå ikke bestemt seg for om opphavsrett skal anerkjennes for AI-generert innhold (anerkjennelse av opphavsrett for enkeltpersoner som bestiller AI-produksjon eller for selskaper som utvikler AI-applikasjoner).

Et bilde laget av en AI-applikasjon.

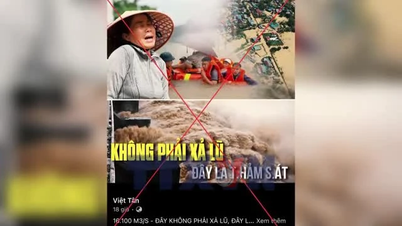

Det er vanskelig å skille mellom ekte og falskt.

Så, kan AI-generert innhold krenke opphavsretten? Teknologisk sett syntetiseres AI-generert innhold av algoritmer fra data de har blitt trent på. Disse databasene samles inn av AI-applikasjonsutviklere fra ulike kilder, hovedsakelig fra den enorme kunnskapsbasen på internett. Mange av disse verkene er allerede opphavsrettsbeskyttet av eierne sine.

27. desember 2023 anla The New York Times søksmål mot OpenAI (sammen med ChatGPT) og Microsoft, med påstand om at millioner av artiklene deres hadde blitt brukt til å trene AI-chatboter og AI-plattformer fra disse to selskapene. Bevisene som ble presentert inkluderte innhold generert av chatbotene på brukerforespørsel som var likt eller identisk med innholdet i artiklene. Avisen kunne ikke ignorere det faktum at deres immaterielle rettigheter ble brukt av disse selskapene til profitt.

New York Times er den første store amerikanske avisen som har anlagt et søksmål om opphavsrett knyttet til AI. Det er mulig at andre aviser også vil saksøke i fremtiden, spesielt etter New York Times' vellykkede sak.

Tidligere inngikk OpenAI lisensavtaler med Associated Press i juli 2023 og Axel Springer – det tyske utgiveren som eier Politico og Business Insider – i desember 2023.

Skuespillerinnen Sarah Silverman ble også involvert i flere søksmål i juli 2023, der hun påstod at Meta og OpenAI brukte memoarene hennes som opplæringsmateriell for AI-programmer. Mange forfattere har også uttrykt bekymring etter avsløringer om at AI-systemer har absorbert titusenvis av bøker i databasene sine, noe som har ført til søksmål fra forfattere som Jonathan Franzen og John Grisham.

I mellomtiden har Getty Images, et fototjenesteselskap, også saksøkt et AI-selskap for å ha laget bilder basert på tekstmeldinger, angivelig gjennom uautorisert bruk av selskapets opphavsrettsbeskyttede bildemateriale.

Brukere kan støte på problemer med opphavsretten når de «uforsiktig» bruker «verk» de har bestilt fra AI-verktøy. Eksperter anbefaler alltid å kun bruke AI-verktøy til forskning, datainnsamling og forslag til referanseformål.

I et annet tilfelle forvirrer AI-applikasjoner brukere ved å gjøre det vanskelig å skille mellom ekte og falskt innhold. Utgivere og redaksjoner kan bli forvirret når de mottar manuskripter. Lærere har også problemer med å vite om studentenes arbeid har brukt AI.

Samfunnet må nå være mer årvåkent fordi det er vanskelig å skille mellom ekte og falskt innhold. For eksempel vil det være vanskelig for gjennomsnittspersonen å oppdage om et bilde har blitt manipulert eller redigert av AI.

Det er behov for lovbestemmelser knyttet til bruk av kunstig intelligens.

Mens man venter på utviklingen av verktøy som kan oppdage AI-forstyrrelser, må reguleringsorganer etablere klare og spesifikke lovbestemmelser for bruk av denne teknologien til å lage originalt innhold. Disse forskriftene bør tydelig indikere for offentligheten hvilket innhold eller hvilke verk som har blitt manipulert av AI, for eksempel ved å som standard legge til et vannmerke på bilder som har blitt behandlet av AI.

[annonse_2]

Kilde: https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[Foto] Statsminister Pham Minh Chinh deltar på konferansen om implementering av oppgaver for 2026 innen industri og handel](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

Kommentar (0)