Nadszedł czas, aby każdy użytkownik stał się „cyfrową tarczą”, zachowując czujność, czujność i odpowiedzialność przy każdym kliknięciu i udostępnieniu.

Korzyści i cienka granica sztucznej inteligencji

Nigdy wcześniej sztuczna inteligencja nie była tak blisko codziennego życia. Wystarczy kilka kliknięć i krótkie polecenie, aby tworzyć głosy, obrazy, a nawet filmy o zdumiewającym realizmie. Sztuczna inteligencja oszczędza czas, obniża koszty produkcji treści i zapoczątkowuje erę elastycznych mediów cyfrowych.

Jednak ta właśnie zdolność do „realistycznego symulowania rzeczywistości” stała się bronią obosieczną. Ostatnio media społecznościowe zostały zalane filmami stworzonymi z wykorzystaniem technologii deepfake, w których twarze dowódców policji i wizerunki funkcjonariuszy organów ścigania w drażliwych sprawach są manipulowane i zniekształcane za pomocą narracji, aby wprowadzać w błąd i dzielić opinię publiczną.

Tego typu inscenizowane obrazy stają się coraz powszechniejsze w mediach społecznościowych.

W viralowym klipie na TikToku, zdjęcia policjanta drogowego na służbie zestawiono z obraźliwymi dialogami, którym towarzyszył hashtag „mandaty tylko na pokaz”, sugerując, że funkcjonariusz nadużył swojej władzy dla osobistych korzyści. Wielu użytkowników, zwłaszcza młodych, łatwo uwierzyło w ten materiał, ponieważ wizualizacje były bardzo realistyczne, a głos był wiernie odwzorowany z ruchem ust, co niezwykle utrudniało odróżnienie oryginału od podróbki.

Młody YouTuber z Dien Bien zapłacił za to grzywną administracyjną i przymusowymi publicznymi przeprosinami, po prostu za chęć „pochwalenia się” swoimi umiejętnościami w zakresie sztucznej inteligencji. Po południu 24 stycznia policja prowincji Dien Bien ogłosiła, że Departament Cyberbezpieczeństwa i Zapobiegania Przestępczości z Wykorzystaniem Zaawansowanych Technologii nałożył grzywnę administracyjną w wysokości 7,5 miliona VND na Tong Van T. (ur. 2001, zamieszkały w dystrykcie Muong Ang) za wykorzystanie sztucznej inteligencji do stworzenia sfabrykowanego filmu zawierającego zniekształcone i obraźliwe treści na temat funkcjonariuszy policji drogowej.

Dokładnie 7 stycznia T. zamieściła na swoim koncie w serwisie YouTube „Tuyen Vlog” ponad 3-minutowy film o szokującym tytule: „Kiedy byłam na mieście, ścigała mnie policja drogowa”. W klipie obrazy i sytuacje zostały zaaranżowane z wykorzystaniem technologii sztucznej inteligencji, symulując pościg policji drogowej za obywatelami, i wzbogacone efektami i komentarzami, które były obraźliwe i zniesławiające wobec funkcjonariuszy organów ścigania.

Współpracując z policją, T. przyznał, że cała treść klipu była sfabrykowanym produktem stworzonym w celach „rozrywkowych” i mającym na celu zademonstrowanie jego umiejętności posługiwania się sztuczną inteligencją. Oprócz grzywny, władze nakazały T. usunięcie fałszywego nagrania i publiczne przeprosiny dla policji drogowej na jego prywatnym kanale w serwisie YouTube.

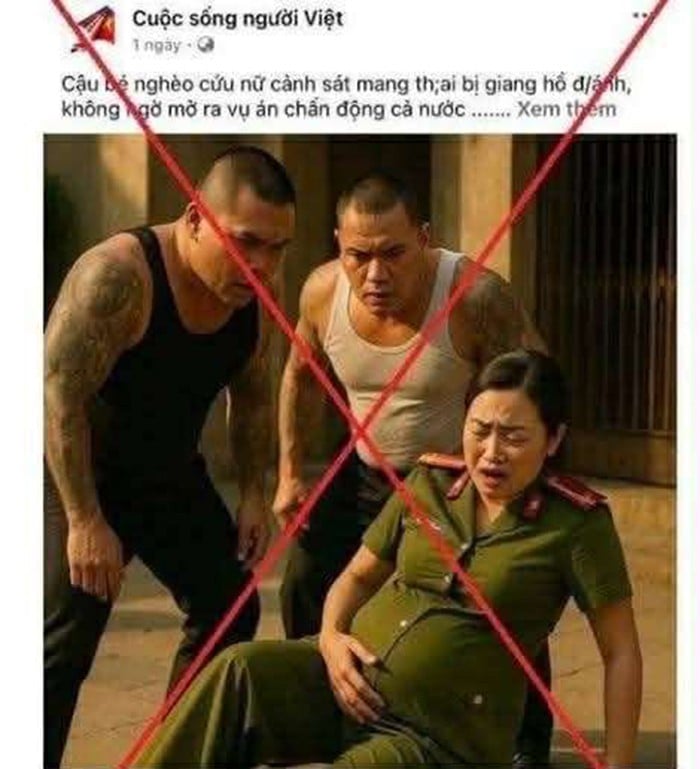

W dobie rewolucji cyfrowej , a zwłaszcza szybkiego rozwoju sztucznej inteligencji, wrogie i reakcyjne siły nie wahały się wykorzystywać tego narzędzia do tworzenia fałszywych obrazów i historii, mających na celu zniekształcenie i zszarganie wizerunku Wietnamskiej Policji Ludowej. Zdjęcie, które niedawno krążyło w mediach społecznościowych, przedstawiające ciężarną kobietę w mundurze policyjnym, której grożą dwaj mężczyźni o „gangsterskim” wyglądzie, jest wyraźnym dowodem na tę taktykę.

Obraz, stworzony przy użyciu sztucznej inteligencji, stał się ostatnio popularny w mediach społecznościowych.

Na pierwszy rzut oka widzowie mogliby łatwo pomylić to z prawdziwą sceną, której towarzyszą sensacyjne nagłówki w rodzaju: „Biedny chłopiec ratuje ciężarną policjantkę napadniętą przez gangsterów, nieświadomie odkrywając sprawę, która wstrząsa całym narodem…”. Jednak w rzeczywistości jest to jedynie wyreżyserowana scena, prawdopodobnie z filmu lub produktu rozrywkowego, a co gorsza, obraz stworzony przez sztuczną inteligencję, aby oszukać emocje czytelnika, wzbudzając w nim litość i wątpliwości co do autentyczności organów ścigania.

Co bardziej niepokojące, rozpowszechnianie takich treści nie tylko szkodzi reputacji i wizerunkowi Policji Ludowej, która dzień i noc pracuje na rzecz bezpieczeństwa i porządku społecznego, ale także stanowi wyrafinowaną formę wojny psychologicznej. Gdy zaufanie społeczeństwa do władz zostanie nadszarpnięte przez zwodnicze obrazy, ukryte motywy wrogich sił, dążących do podziału jedności narodowej, stopniowo się ujawnią.

Dlatego każdy obywatel powinien zwiększyć swoją czujność, rozwinąć umiejętność krytycznego myślenia i zdolność do identyfikowania fałszywych informacji, a także zdecydowanie potępiać i dementować fałszywe treści, przyczyniając się do ochrony fundamentów ideologicznych i utrzymania stabilności społecznej w obliczu obecnej fali szkodliwych informacji w Internecie.

W Ho Chi Minh City, prawie minutowy klip wideo niespodziewanie stał się viralem w mediach społecznościowych. Na nagraniu widać mężczyznę w policyjnym mundurze, który „zmusza” podejrzanego do przyznania się do wykroczenia drogowego w biurze. Na nagraniu mężczyzna, uważany za policjanta, zachowuje się agresywnie, nieustannie krzycząc, a nawet używając wulgarnego języka, co wywołuje oburzenie opinii publicznej.

Jednak wkrótce po tym, jak nagranie stało się viralem, policja w Ho Chi Minh City szybko przeprowadziła dochodzenie i potwierdziła, że jest to wyrafinowany deepfake. Według ustaleń policji, twarze na nagraniu zostały wyodrębnione z nagrania wewnętrznej konferencji policyjnej, a następnie zmanipulowane przez osoby o złych zamiarach za pomocą sztucznej inteligencji, aby nałożyć je na zaaranżowaną scenę, wmawiając widzom, że to prawdziwe wydarzenie.

W szczególności w towarzyszącym materiałowi dźwiękowym znajdują się groźne i obraźliwe głosy, które tak naprawdę nie są prawdziwymi słowami żadnego urzędnika, lecz zsyntetyzowanymi głosami sztucznej inteligencji, zaprogramowanymi i edytowanymi w celu oszukania emocji widza.

Ten incydent jest doskonałym przykładem wykorzystania technologii deepfake do zniekształcania i zniesławiania Policji Ludowej – taktyki coraz częściej wykorzystywanej przez siły reakcyjne i wywrotowe w cyberprzestrzeni. Co istotne, jeśli takie fałszywe materiały nie zostaną szybko ujawnione, mogą prowadzić do poważnych konsekwencji: podważenia zaufania społecznego do organów ścigania, wzniecenia oporu w społeczeństwie i ułatwienia rozpowszechniania fałszywych narracji. Stanowi to wyraźne ostrzeżenie o pilnej potrzebie wzmocnienia możliwości komunikacyjnych w celu obalania, wykrywania i zwalczania fałszywych informacji, a także apeluje do wszystkich obywateli o czujność i powstrzymanie się od pochopnego udostępniania lub komentowania niezweryfikowanych treści pochodzących z oficjalnych źródeł.

W innym niedawnym przypadku, dotyczącym postępowania w sprawie nieprawidłowości w punkcie kontroli pojazdów na południu kraju, wrogie siły rozpowszechniły fałszywe nagranie przedstawiające szefa policji prowincji broniącego skorumpowanych urzędników. Nagranie to, opublikowane na Telegramie i w mediach społecznościowych pod tytułem „wspierane przez potężne siły”, było w rzeczywistości dziełem sztucznej inteligencji i nie pojawiło się na żadnych konferencjach prasowych ani w oficjalnych dokumentach.

Niebezpieczny trend po cichu rozprzestrzenia się w sieci: cyberprzestępcy wykorzystują technologię sztucznej inteligencji do tworzenia fałszywych filmów w celu oszustw i wymuszeń. Ostatnio wiele osób padło ofiarą oszustw, gdy ich wizerunki, zwłaszcza wizerunki osób cieszących się szacunkiem społecznym, takich jak prawnicy, lekarze i biznesmeni, zostały nałożone na filmy reklamujące „odzyskiwanie pieniędzy utraconych w wyniku oszustw internetowych”.

W tych klipach sztuczna inteligencja naśladuje głos i twarz prawników, sprawiając, że widzowie uwierzą w oszustów i z łatwością podadzą im dane osobowe lub przeleją pieniądze. Co jeszcze bardziej niebezpieczne, niektórzy sprawcy wykorzystują technologię deepfake, aby nałożyć twarze ofiar na filmy erotyczne, a następnie przesłać je małżonkom lub współpracownikom z zamiarem zastraszenia lub zmuszenia ich do przelania pieniędzy w zamian za „zachowanie milczenia”.

Wstrząsający incydent miał miejsce w marcu 2025 roku, kiedy ofiara w Hanoi została poproszona o przelanie dziesiątek milionów dongów po otrzymaniu fałszywego filmu erotycznego z jej udziałem. Tymczasem w Ho Chi Minh City inna osoba została szantażowana kwotą 2 miliardów dongów, jeśli nie chciała, aby ten drażliwy film został rozpowszechniony. Ministerstwo Bezpieczeństwa Publicznego wszczęło dochodzenie, identyfikując kilka transnarodowych grup przestępczych, głównie z Chin i Azji Południowo-Wschodniej, stojących za tymi sieciami, wykorzystujących jednorazowe karty SIM, portfele elektroniczne i platformy mediów społecznościowych do ukrywania swojej tożsamości.

To już nie jest drobny przekręt, lecz forma „zaawansowanej technologicznie wojny psychologicznej”, głęboko wykorzystującej lęki o honor i relacje społeczne, by wywierać presję na ofiary. Bez wzmożonej czujności i umiejętności identyfikowania nietypowych informacji i zachowań, każdy może paść ofiarą tych zaawansowanych technologicznie przestępców. W obliczu tej wyrafinowanej fali podszywania się pod kogoś, każdy obywatel musi zachować czujność, bezwzględnie powstrzymać się od bezmyślnego udostępniania danych osobowych i być gotowym do sprzeciwiania się nielegalnym działaniom, przyczyniając się do ochrony własnego bezpieczeństwa i bezpieczeństwa społeczności.

Aby zwalczać zagrożenie ze strony deepfake’ów, potrzebna jest „cyfrowa tarcza” ze strony społeczności.

Według Departamentu Nadawania, Telewizji i Informacji Elektronicznej (Ministerstwo Kultury, Sportu i Turystyki), w 2024 roku platformy cyfrowe w Wietnamie musiały usunąć ponad 4000 filmów zawierających fałszywe i zniekształcone informacje, z których większość stanowiły produkty stworzone z wykorzystaniem technologii sztucznej inteligencji, takie jak deepfake i klony głosowe. Sam TikTok – platforma popularna wśród młodych ludzi – został poproszony o usunięcie ponad 1300 klipów deepfake, głównie dotyczących policji, rządu i polityki społecznej.

W dobie boomu technologicznego sztuczna inteligencja uwalnia przełomowy potencjał, ale niesie ze sobą również bezprecedensowe zagrożenia, zwłaszcza w postaci produktów deepfake zawierających zniekształcone treści, które podważają reputację agencji rządowych. Badanie przeprowadzone przez Instytut Badań Mediów MICRI pokazuje, że 62% użytkowników mediów społecznościowych w Wietnamie nie potrafi odróżnić prawdziwych informacji od fałszywych bez ostrzeżeń ze strony mediów głównego nurtu lub władz. To „luka poznawcza”, którą siły opętane wykorzystują do szerzenia dezinformacji i zakłócania psychologii społecznej.

Tong Van T. na komisariacie policji.

Według generała dywizji, profesora nadzwyczajnego i doktora Do Canh Thina, eksperta w dziedzinie kryminologii, wykorzystywanie sztucznej inteligencji do tworzenia fałszywych filmów podszywających się pod przywódców, edytowania fałszywych oświadczeń lub zniekształcania profesjonalnych działań policji to nowa, ale szczególnie niebezpieczna taktyka. „Deepfake to nie tylko produkt rozrywkowy, ale forma współczesnej wojny informacyjnej, która może podważyć zaufanie, wywołać niestabilność społeczną i jest bardzo trudna do kontrolowania” – stwierdził generał dywizji Do Canh Thin.

W rzeczywistości klipy zmanipulowane przez sztuczną inteligencję są dalekie od nieszkodliwych; często poruszają drażliwe tematy, takie jak radzenie sobie z naruszeniami, ściganie przestępstw i walka z korupcją, wywołując dezorientację społeczną i brak zaufania do organów ścigania. Co gorsza, wiele filmów jest udostępnianych na popularnych platformach, takich jak YouTube i TikTok, gromadząc setki tysięcy wyświetleń, zanim zostaną usunięte, co wywołuje negatywny efekt domina.

Ekspert ds. mediów cyfrowych Hoang Minh ostrzega: „Jedno nieostrożne udostępnienie lub polubienie może sprawić, że staniesz się współtwórcą fake newsów. Każdy użytkownik internetu musi zrozumieć, że działania w przestrzeni cyfrowej mają również realne konsekwencje”.

W tym kontekście bardziej niż kiedykolwiek potrzebne jest zbudowanie „cyfrowej tarczy” wewnątrz samej społeczności: czyli czujności, odporności informacyjnej i poczucia odpowiedzialności za środowisko online. Technologia może być neutralna, ale to, jak ludzie z niej korzystają, zadecyduje, czy sztuczna inteligencja stanie się siłą napędową rozwoju, czy też siłą destrukcyjną dla zaufania społecznego. Utrzymanie ideologicznej niezłomności i ochrona wizerunku policjanta to ochrona fundamentów bezpieczeństwa narodowego – zadanie nie tylko dla odpowiednich władz, ale dla każdego obywatela w erze cyfrowej.

Źródło: https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Zdjęcie] Premier Pham Minh Chinh przewodniczy dialogowi z japońskimi przedsiębiorstwami.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/21/1774097547316_ndo_br_dsc-0448-jpg.webp)

Komentarz (0)