W maju 2024 roku główne globalne firmy technologiczne wprowadziły na rynek nowe wersje sztucznej inteligencji (AI), takie jak OpenAI z GPT-4o i Google z Gemini 1.5 Pro, dodając wiele „superinteligentnych” funkcji optymalizujących doświadczenia użytkownika. Nie da się jednak zaprzeczyć, że technologia ta jest wykorzystywana przez cyberprzestępców w licznych oszustwach internetowych.

Ryzyko wzrasta.

Przemawiając na niedawnej konferencji, wiceminister informacji i komunikacji Pham Duc Long zwrócił uwagę na stale rosnącą liczbę cyberataków o coraz większym stopniu wyrafinowania i złożoności. W szczególności, dzięki wsparciu sztucznej inteligencji, zagrożenia dla użytkowników będą rosnąć wykładniczo. „Technologia sztucznej inteligencji jest wykorzystywana przez cyberprzestępców do łatwego tworzenia nowego złośliwego oprogramowania i zaawansowanych ataków phishingowych…” – ostrzegł wiceminister Pham Duc Long.

Według raportu Departamentu Bezpieczeństwa Informacji Ministerstwa Informacji i Komunikacji, zagrożenia cyberbezpieczeństwa związane ze sztuczną inteligencją spowodowały straty na całym świecie przekraczające 1 bilion dolarów, a sam Wietnam odpowiada za straty rzędu 8000–10 000 miliardów VND. Obecnie najczęstszym problemem jest wykorzystywanie sztucznej inteligencji do fałszowania głosów i twarzy w celach oszukańczych. Przewiduje się, że do 2025 roku liczba ataków na sekundę wyniesie około 3000, liczba próbek złośliwego oprogramowania na sekundę wyniesie 12, a liczba nowych luk/słabości – 70 dziennie.

Według pana Nguyena Huu Giapa, dyrektora BShield – firmy specjalizującej się w bezpieczeństwie aplikacji – tworzenie fałszywych obrazów i głosów nie jest już trudne dzięki rozwojowi sztucznej inteligencji. Przestępcy mogą z łatwością gromadzić dane użytkowników z publicznie dostępnych informacji publikowanych w mediach społecznościowych lub za pomocą taktyk, takich jak internetowe rozmowy kwalifikacyjne czy rozmowy telefoniczne, podszywając się pod „oficjalne agencje”. W symulacji przeprowadzonej przez BShield, z istniejącej już twarzy uzyskanej za pomocą połączenia wideo , przestępcy mogą przenieść ją na dowód osobisty, nałożyć na poruszające się ciało, aby oszukać narzędzie eKYC, a system zidentyfikuje ją jako prawdziwą osobę.

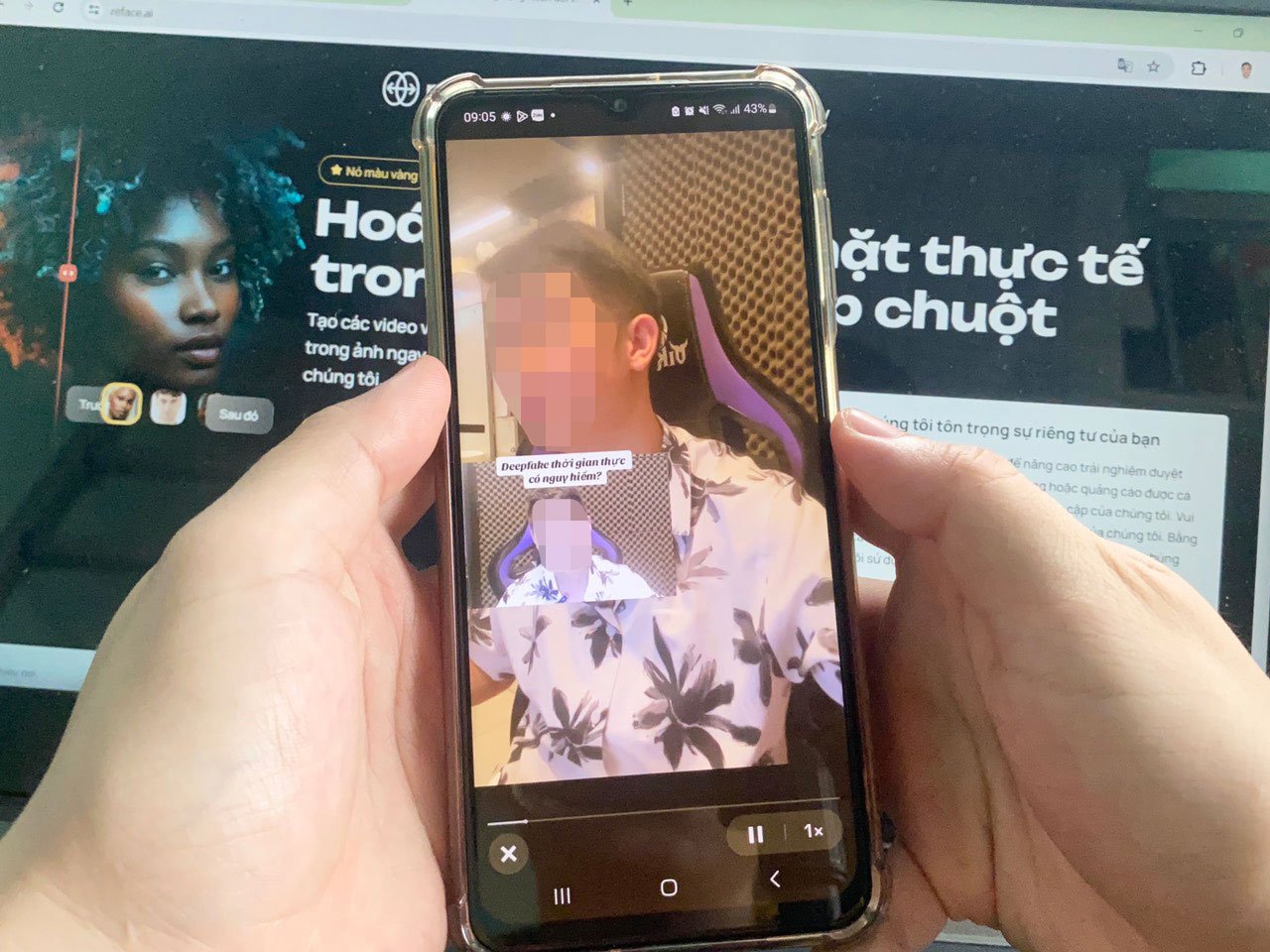

Oszukańcze praktyki wykorzystujące technologię deepfake stają się coraz bardziej powszechne i wyrafinowane. (Zdjęcie: LE TINH)

Z perspektywy użytkownika, pan Nguyen Thanh Trung, specjalista IT z Ho Chi Minh, obawia się, że cyberprzestępcy mogliby wykorzystać ChatGPT do tworzenia wiadomości phishingowych o treści i stylu pisania zbliżonym do prawdziwych wiadomości e-mail od banków lub renomowanych organizacji. Wiadomości te mogą zawierać złośliwe oprogramowanie, a jeśli użytkownicy na nie klikną, ich dane z pewnością zostaną skradzione, a ich majątek sprzeniewierzony. „Oprogramowanie oparte na sztucznej inteligencji stale się rozwija i potrafi tworzyć fałszywe filmy z twarzami i głosami, które są nawet w 95% podobne do prawdziwych osób, a gesty zmieniają się w czasie rzeczywistym, co znacznie utrudnia widzom ich wykrycie” – powiedział pan Trung.

szybko sfinalizować ramy prawne.

Aby zminimalizować ryzyko oszustw związanych z zaawansowanymi technologiami, ekspert ds. bezpieczeństwa Pham Dinh Thang radzi użytkownikom regularnie aktualizować swoją wiedzę na temat sztucznej inteligencji i unikać klikania w linki z nieznanych źródeł. Firmy powinny przeznaczyć budżety na bezpieczeństwo danych i obsługę systemów. Personel firmowy potrzebuje również dogłębnego szkolenia, aby identyfikować rzeczywiste luki w zabezpieczeniach swoich systemów i rozwijać swoje umiejętności rozpoznawania różnych rodzajów cyberataków.

Pan Ta Cong Son, Kierownik Działu Rozwoju Sztucznej Inteligencji (AI) w Projekcie Przeciwdziałania Oszustwom, stwierdził, że sztuczna inteligencja (AI) głęboko zakorzeniła się w życiu użytkowników oraz w działalności firm, agencji i organizacji dzięki niezwykle inteligentnym funkcjom wsparcia. Co istotne, obecna technologia AI jest bardzo przystępna i łatwa w użyciu, co ułatwia jej wykorzystywanie przez cyberprzestępców do celów oszustw. „Oszuści stale zmieniają metody ataków, dlatego użytkownicy muszą regularnie aktualizować swoje dane, aby wiedzieć, jak się chronić” – powiedział pan Son.

Według ekspertów, niedawno zmodernizowane modele GPT-4o i Gemini 1.5 Pro dowiodły, że inteligencja sztucznej inteligencji nie zna granic. Dlatego, oprócz zachęcania firm do opracowywania narzędzi i rozwiązań antyfraudowych opartych na sztucznej inteligencji, organy regulacyjne muszą szybko sfinalizować ramy prawne dla sztucznej inteligencji, aby dotrzymać kroku temu trendowi.

Podpułkownik Nguyen Anh Tuan, zastępca dyrektora Narodowego Centrum Danych Ludnościowych, uważa, że wkrótce należy wydać przepisy dotyczące etyki i odpowiedzialności krajowych i zagranicznych dostawców usług w zakresie rozwoju, produkcji, stosowania i użytkowania sztucznej inteligencji (AI). Jednocześnie potrzebne są szczegółowe przepisy dotyczące standardów technicznych dla systemów wykorzystujących, stosujących, łączących i świadczących usługi AI. „Musimy badać i wdrażać projekty AI, aby zwalczać zagrożenia związane z AI. Ponieważ AI jest tworzona przez ludzi i jest produktem wiedzy, będą istnieć warianty „dobrej AI” i „złej AI”, które mogą utrudniać rozwój sztucznej inteligencji poprzez samą AI” – zauważył podpułkownik Tuan.

Wyzwania cyberbezpieczeństwa

Podpułkownik Nguyen Anh Tuan przyznał, że sztuczna inteligencja stanowi wyzwanie dla cyberbezpieczeństwa. Zauważył, że złośliwe oprogramowanie oparte na sztucznej inteligencji może być instalowane w plikach dokumentów, umożliwiając użytkownikom infiltrację systemów po ich przesłaniu. Ponadto, wykorzystując wyspecjalizowane technologie sztucznej inteligencji, hakerzy mogą symulować systemy i wykorzystywać luki w zabezpieczeniach. Sztuczna inteligencja może tworzyć liczne aplikacje z fałszywymi obrazami i nazwami imitującymi aplikacje i strony internetowe Ministerstwa Bezpieczeństwa Publicznego, nakłaniając obywateli do pobierania, instalowania i podawania informacji, takich jak numery identyfikacyjne i hasła logowania. „Sztuczna inteligencja będzie również rozwijać hybrydowe złośliwe oprogramowanie, łącząc elementy z różnych rodzin złośliwego oprogramowania, z bardziej zaawansowanymi mechanizmami omijania zabezpieczeń i możliwością automatycznej modyfikacji kodu źródłowego” – ostrzegł podpułkownik Nguyen Anh Tuan.

Źródło: https://nld.com.vn/toi-pham-mang-co-them-bi-kip-tu-ai-196240601195415035.htm

![[Zdjęcie] Pierwszy Kongres Związku Zawodowego Naukowców i Technologów Wietnamu](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F24%2F1766552551054_ndo_tr_img-1801-jpg.webp&w=3840&q=75)

Komentarz (0)