SGGP

Após a Europa ter começado a elaborar e logo em seguida ter lançado a primeira lei mundial sobre inteligência artificial (IA), as quatro principais gigantes americanas da mineração de dados na internet acabaram de lançar um grupo chamado Frontier Model Forum.

|

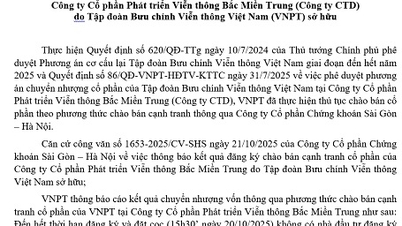

| O principal objetivo do Frontier Model Forum é promover a IA de forma responsável. Foto: THINKWITHNICHE |

As partes se aproximam.

O grupo, que inclui a Anthropic, o Google, a Microsoft e a OpenAI, proprietária do ChatGPT, afirmou que os principais objetivos do Frontier Model Forum são ajudar a reduzir os riscos representados pelas plataformas de IA e desenvolver padrões da indústria. O Frontier Model Forum criará um novo fórum com os seguintes objetivos principais: promover a pesquisa em segurança da IA para apoiar o desenvolvimento, mitigar riscos e padronizar avaliações e níveis de segurança; identificar as melhores práticas para o desenvolvimento e a implementação de modelos; ajudar o público a compreender a natureza, as capacidades, as limitações e os impactos da tecnologia; e colaborar com legisladores, acadêmicos, sociedade civil e empresas para compartilhar conhecimento sobre riscos e segurança.

Tradicionalmente, as gigantes da tecnologia resistem ao aumento da regulamentação, mas desta vez, o setor tecnológico mudou sua postura em relação às crescentes preocupações com os riscos que a IA representa. As empresas envolvidas na iniciativa Frontier Model Forum se comprometeram a compartilhar as melhores práticas entre si e a disponibilizar informações publicamente para governos e sociedade civil.

Especificamente, o Frontier Model Forum se concentrará em plataformas de aprendizado de máquina de grande escala, porém ainda incipientes, que levam a IA a novos níveis de sofisticação – o que também representa um fator de risco potencial. Além disso, o Frontier Model Forum também apoiará o desenvolvimento de aplicações que abordem grandes desafios sociais, como: mitigação e adaptação às mudanças climáticas, detecção e prevenção precoce do câncer e combate a ameaças cibernéticas.

Espaço para potencial destruição

O anúncio do Frontier Model Forum por empresas americanas surge poucos dias depois de senadores dos EUA terem alertado, em 25 de julho, sobre o risco de IA ser usada para ataques biológicos, durante uma audiência perante uma subcomissão do Comitê Judiciário do Senado dos EUA. Recentemente, sete grandes empresas de tecnologia, incluindo OpenAI, Alphabet e Meta, comprometeram-se voluntariamente com a Casa Branca a desenvolver um sistema para identificar todo o conteúdo criado por IA — texto, imagens, áudio e vídeo — a fim de garantir transparência aos usuários e, assim, tornar essa tecnologia mais segura.

Dario Amodei, CEO da AI Anthropic, observou que, embora a IA ainda não seja capaz de criar armas biológicas, ela representa um risco a médio prazo e constitui uma séria ameaça à segurança nacional dos EUA nos próximos dois ou três anos. Isso porque os indivíduos que realizam ataques com armas biológicas em larga escala não se limitam mais àqueles com conhecimento especializado no assunto.

O mundo enfrenta uma explosão de conteúdo criado por tecnologia de IA generativa. Dos EUA à Europa e à Ásia, os controles estão se tornando cada vez mais rigorosos. Segundo a CNN, a partir de setembro, o Senado dos EUA realizará uma série de nove workshops adicionais para que seus membros aprendam sobre como a IA pode afetar empregos, segurança nacional e propriedade intelectual. Antes dos EUA, caso um acordo seja alcançado, a União Europeia terá a primeira lei mundial sobre gestão de IA no próximo ano, com previsão de entrar em vigor em 2026.

Os benefícios que a IA traz para a sociedade são inegáveis, mas crescem os alertas sobre os riscos potenciais dessa nova tecnologia. Em junho, o Secretário-Geral da ONU, António Guterres, apoiou uma proposta de diversos executivos da área de IA para criar um órgão internacional de vigilância da IA, semelhante à Agência Internacional de Energia Atômica (AIEA).

De volta ao Frontier Model Forum, o presidente da Microsoft, Brad Smith, afirmou que a iniciativa é um passo importante para unir empresas de tecnologia na promoção do uso responsável da IA para o benefício de toda a humanidade. Da mesma forma, a vice-presidente de Assuntos Globais da OpenAI, Anna Makanju, disse que a tecnologia avançada de IA tem o potencial de trazer benefícios profundos para a sociedade, e isso requer supervisão e governança.

Fonte

Comentário (0)