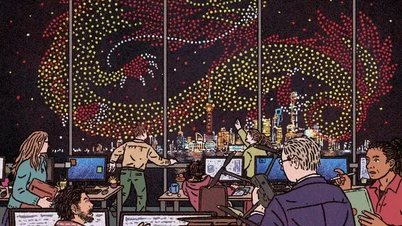

Locotenent-colonelul, doctor în criminolog, Dao Trung Hieu a declarat că dezvoltarea inteligenței artificiale (IA) a schimbat profund modul în care oamenii creează, primesc și verifică informații. Tehnologii precum deepfake-ul, vocile sintetice sau imaginile artificiale estompează cum nu s-a mai întâmplat niciodată linia dintre real și fals.

Conform statisticilor Europol (2024), aproximativ 90% din conținutul online de astăzi beneficiază de intervenții ale inteligenței artificiale la diferite niveluri, dintre care 15% prezintă semne de falsificare intenționată.

În Vietnam, Ministerul Securității Publice a înregistrat o serie de cazuri penale de utilizare a inteligenței artificiale pentru a se da drept rude, funcționari bancari sau agenții de stat în vederea însușirii de proprietăți, unele cazuri provocând pierderi de până la zeci de miliarde de dong.

Ceea ce este îngrijorător nu sunt doar pagubele materiale, ci și erodarea încrederii sociale, fundamentul tuturor relațiilor umane. Atunci când adevărul poate fi recreat, încrederea, care este fundamentul tuturor relațiilor sociale, a devenit prima țintă a atacului.

„Fenomenele menționate mai sus nu reprezintă doar o transformare a instrumentelor criminale, ci o remodelare a spațiului comportamentului criminal, cu caracteristici complet noi: intangibile, transfrontaliere, anonime și bazate pe auto-învățare”, a declarat colonelul superior Dao Trung Hieu.

Transformarea structurii comportamentului criminal în era inteligenței artificiale

Locotenent-colonelul Dao Trung Hieu a declarat că infracțiunile din era inteligenței artificiale nu mai sunt limitate de spațiul fizic. Actele criminale sunt comise prin intermediul modelelor de date, algoritmilor și sistemelor de generare automată, permițând indivizilor sau organizațiilor să falsifice autenticitatea tuturor tipurilor de informații.

Dacă în infracțiunile tradiționale, urmele fizice (dovezi, locurile crimei, martorii) reprezintă baza principală, atunci în infracțiunile de înaltă tehnologie, urmele digitale sunt cheia. IA îi ajută pe infractori să atingă două capacități periculoase: realitatea sintetică, care îl face pe destinatar să creadă în ceva ce nu există, și erodarea atribuirii, care face dificilă localizarea originii comportamentului.

Dintr-o perspectivă criminologică, este posibil să se observe o schimbare în structura celor patru elemente ale infracțiunii:

În primul rând, Subiectul nu mai este un singur individ, ci poate fi un sistem automat sau un grup de persoane care îl controlează de la distanță;

În al doilea rând, obiectul încălcat nu este doar proprietatea, onoarea sau datele, ci și încrederea socială - o valoare intangibilă, dar de o semnificație fundamentală;

În al treilea rând, mijloacele de comitere a infracțiunilor sunt programate, se autoînvață, sunt dificil de controlat și pot fi replicate la nesfârșit;

În al patrulea rând, consecințele sociale nu se opresc la pagubele economice , ci se extind la psihologie, moralitate și securitate națională.

„Astfel, inteligența artificială nu numai că sprijină oamenii în creativitate și producție, dar și restructurează comportamentul deviant, făcând din conceptul de «criminologie digitală» o nouă direcție de cercetare a științei criminalistice moderne”, a declarat dl Hieu.

Trecerea de la investigația tradițională la investigația în spațiul datelor

Dl. Hieu a afirmat că apariția infracțiunilor bazate pe inteligență artificială obligă agențiile de investigație să își inoveze modelele de lucru. În loc să investigheze ulterior, este necesar să se investigheze datele în paralel, colectând și analizând fluxul de informații pe măsură ce comportamentul are loc.

Se cercetează tehnici precum analiza urmelor prin inteligență artificială, care permit recuperarea caracteristicilor specifice ale fiecărui model generativ, similare „amprentelor digitale” din criminalistica digitală.

În Vietnam, unitățile profesionale ale Ministerului Securității Publice s-au coordonat cu întreprinderile de tehnologie pentru a construi o bază de date cu mostre de recunoaștere vocală, facială și video create de inteligența artificială.

Odată cu aceasta, este necesară și îmbunătățirea infrastructurii juridice. Este necesar să se adauge infracțiunea de „utilizare a inteligenței artificiale pentru comiterea de infracțiuni” în studiile de modificare a Codului Penal și, în același timp, trebuie să existe reglementări specifice privind responsabilitățile proprietarilor și operatorilor de sisteme de inteligență artificială.

Mai important este trecerea de la o mentalitate de „vânătoare a vinovatului” la una de „prevenție proactivă”. Într-o epocă în care un videoclip fals se poate răspândi mai repede decât un anunț oficial, capacitatea de a răspunde rapid și de a coordona toate părțile, inclusiv statul, întreprinderile și comunitatea, devine un factor cheie.

Imunitate digitală, „anticorpi” în era inteligenței artificiale

Un concept subliniat de locotenent-colonelul Dr. Dao Trung Hieu este „imunitatea digitală”, care reprezintă capacitatea societății de a se autoidentifica și de a reacționa la informațiile false. Pentru a construi imunitate digitală, potrivit acestuia, este necesară convergența a trei grupuri de soluții.

În primul rând, construirea unui coridor juridic flexibil și evolutiv, asigurând un echilibru între control și inovare. Legile nu ar trebui să „încadreze” IA, ci trebuie să fie flexibile pentru a se adapta la schimbările rapide ale tehnologiei, asigurând în același timp principiul dublei responsabilități - persoanele sau organizațiile care utilizează IA trebuie să fie responsabile pentru produsele pe care le creează.

În al doilea rând, stabilirea unui mecanism național de identificare a conținutului generat de inteligența artificială, prin standarde de autentificare a originii digitale (filigran AI, cod de proveniență). Platformele digitale ar trebui să fie obligate să eticheteze sau să verifice conținutul generat de inteligența artificială, ajutând utilizatorii să distingă între real și fals încă din etapa de recepție.

În al treilea rând, educația și rețelele sociale reprezintă o linie de apărare pe termen lung. Legile pot reglementa comportamentul, dar numai educația poate reglementa gradul de conștientizare. Integrarea cunoștințelor despre securitatea datelor, abilitățile de recunoaștere a știrilor false și etica tehnologiei în învățământul general și în programele universitare va crea o clasă de cetățeni cu „anticorpi digitali”, o fundație durabilă pentru o societate sigură.

Potrivit domnului Hieu, inteligența artificială nu este doar un progres tehnologic, ci și un test moral și juridic al umanității. Atunci când mașinile pot recrea adevărul, oamenii sunt obligați să învețe cum să protejeze singura credință care nu poate fi programată.

Vietnamul trebuie să preia proactiv inițiativa prin construirea unui cadru juridic flexibil, prin consolidarea cooperării public-private în prevenirea criminalității bazate pe inteligență artificială și prin promovarea educației privind imunitatea digitală în rândul populației.

„O societate sigură în era inteligenței artificiale nu este cea cu cele mai puternice firewall-uri, ci cea cu cei mai atenți cetățeni. Dacă datele sunt combustibilul erei digitale, atunci încrederea este motorul. Fără încredere, orice sistem se prăbușește, indiferent cât de avansată ar fi tehnologia”, a subliniat criminologul.

Pe 25 octombrie a avut loc la Hanoi ceremonia de semnare a Convenției Națiunilor Unite împotriva criminalității cibernetice, cu tema „Combaterea criminalității cibernetice - Împărtășirea responsabilității - Privire spre viitor”. Convenția de la Hanoi este considerată un pas important în construirea primului cadru juridic global pentru coordonarea eforturilor comune de răspuns la criminalitatea cibernetică. Aceasta este o piatră de hotar istorică nu numai pentru comunitatea internațională, ci afirmă și rolul și poziția Vietnamului pe arena internațională.

Sursă: https://khoahocdoisong.vn/cong-uoc-ha-noi-chuyen-gia-de-xuat-mien-dich-so-truoc-thach-thuc-ai-post2149063689.html

![[Foto] Comitetele de partid ale agențiilor centrale ale partidului prezintă pe scurt implementarea Rezoluției nr. 18-NQ/TW și direcția Congresului Partidului](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/27/1761545645968_ndo_br_1-jpg.webp)

![[Foto] Președintele Adunării Naționale, Tran Thanh Man, îl primește pe președintele Camerei Reprezentanților din Uzbekistan, Nuriddin Ismoilov](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/27/1761542647910_bnd-2610-jpg.webp)

Comentariu (0)