După ce startup-ul OpenAI a lansat prima sa aplicație de inteligență artificială, ChatGPT, la sfârșitul anului 2022, a fost declanșat un val de dezvoltare a aplicațiilor de inteligență artificială, în special a inteligenței artificiale generative, aducând numeroase beneficii în toate aspectele vieții. Cu toate acestea, acest lucru aduce și numeroase riscuri.

Încălcarea vieții private

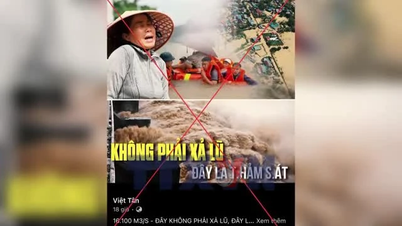

În ultimii ani, multe organizații și persoane fizice au suferit pierderi semnificative, deoarece infractorii cibernetici au folosit inteligența artificială pentru a crea videoclipuri false care imită imaginile și vocile unor persoane reale. Un exemplu excelent în acest sens este escrocheria Deepfake, care implică înșelarea persoanei reale, făcând-o să creadă că este reală.

Conform Raportului privind frauda de identitate publicat de Sumsub la sfârșitul lunii noiembrie 2023, escrocheriile de tip deepfake au crescut la nivel global de zece ori în cei doi ani dintre 2022 și 2023. Aceasta a fost, de asemenea, perioada în care aplicațiile generate de inteligența artificială au explodat la nivel mondial .

Status Labs notează că tehnologia Deepfake a avut un impact semnificativ asupra culturii, confidențialității și reputației personale. O mare parte din știrile și atenția din jurul Deepfake s-au concentrat pe pornografia celebrităților, conținutul de răzbunare, dezinformarea, știrile false, șantajul și escrocheriile. De exemplu, în 2019, o companie energetică din SUA a fost fraudată cu 243.000 de dolari de hackeri care s-au dat drept lideri ai companiei și le-au folosit vocile, cerându-le angajaților să transfere bani partenerilor.

Reuters a raportat că, în 2023, aproximativ 500.000 de fișiere video și audio Deepfake au fost distribuite pe rețelele de socializare din întreaga lume. Pe lângă Deepfake-urile create pentru distracție, există și escrocherii concepute de actori rău intenționați pentru a înșela publicul. Unele surse indică faptul că, în 2022, escrocheriile Deepfake la nivel mondial au cauzat pierderi estimate la 11 milioane de dolari.

Mulți experți în tehnologie au avertizat cu privire la dezavantajele inteligenței artificiale, inclusiv probleme legate de drepturile de proprietate intelectuală și autenticitate, precum și dispute privind proprietatea intelectuală între „operele” create de inteligență artificială. De exemplu, cineva ar putea folosi inteligența artificială pentru a picta un tablou pe un anumit subiect, iar o altă persoană ar putea folosi, de asemenea, inteligența artificială pentru a face același lucru, rezultând picturi cu multe asemănări.

Acest lucru duce cu ușurință la dispute privind proprietatea. Cu toate acestea, până în prezent, lumea nu a decis încă cu privire la recunoașterea drepturilor de autor pentru conținutul generat de inteligența artificială (recunoașterea drepturilor de autor pentru persoanele care comandă crearea de informații bazate pe inteligență artificială sau pentru companiile care dezvoltă aplicații bazate pe inteligență artificială).

O imagine creată de o aplicație de inteligență artificială.

E greu să faci distincția între autentic și fals.

Așadar, poate conținutul generat de inteligența artificială să încalce drepturile de autor? Din punct de vedere tehnologic, conținutul generat de inteligența artificială este sintetizat de algoritmi din datele pe care au fost antrenați. Aceste baze de date sunt colectate de dezvoltatorii de aplicații de inteligență artificială din diverse surse, în principal din vasta bază de cunoștințe de pe internet. Multe dintre aceste lucrări sunt deja protejate prin drepturi de autor ale proprietarilor lor.

Pe 27 decembrie 2023, The New York Times a intentat un proces împotriva OpenAI (împreună cu ChatGPT) și Microsoft, susținând că milioane dintre articolele sale au fost folosite pentru a antrena chatboți și platforme de inteligență artificială ale acestor două companii. Dovezile prezentate au inclus conținut generat de chatboți la cererea utilizatorilor, similar sau identic cu conținutul articolelor. Ziarul nu putea ignora faptul că proprietatea sa intelectuală era utilizată de aceste companii în scop lucrativ.

The New York Times este primul ziar american important care a intentat un proces pentru drepturile de autor legate de inteligența artificială. Este posibil ca și alte ziare să dea în judecată în viitor, mai ales după succesul procesului The New York Times.

Anterior, OpenAI a încheiat acorduri de licențiere cu Associated Press în iulie 2023 și cu Axel Springer – editura germană care deține Politico și Business Insider – în decembrie 2023.

Actrița Sarah Silverman a fost, de asemenea, implicată în mai multe procese în iulie 2023, susținând că Meta și OpenAI i-au folosit memoriile ca material de instruire pentru programele de inteligență artificială. Mulți scriitori și-au exprimat, de asemenea, îngrijorarea în urma dezvăluirilor conform cărora sistemele de inteligență artificială au absorbit zeci de mii de cărți în bazele lor de date, ceea ce a dus la procese intentate de autori precum Jonathan Franzen și John Grisham.

Între timp, Getty Images, o companie de servicii foto, a dat în judecată o companie de inteligență artificială pentru crearea de imagini bazate pe solicitări text, presupus prin utilizarea neautorizată a materialelor imagistice protejate prin drepturi de autor ale companiei.

Utilizatorii se pot confrunta cu probleme legate de drepturile de autor atunci când utilizează „în mod neglijent” „lucrări” pe care le-au comandat prin intermediul instrumentelor de inteligență artificială. Experții recomandă întotdeauna utilizarea instrumentelor de inteligență artificială doar pentru cercetare, colectare de date și sugestii în scop informativ.

Într-o altă ordine de idei, aplicațiile de inteligență artificială creează confuzie între utilizatori, îngreunând distincția dintre conținutul autentic și cel fals. Editorii și redacțiile pot fi nedumeriți atunci când primesc manuscrise. De asemenea, profesorii se confruntă cu dificultăți în a ști dacă lucrările elevilor au folosit inteligența artificială.

Comunitatea va trebui acum să fie mai vigilentă, deoarece este dificil să se facă distincția între conținutul real și cel fals. De exemplu, va fi dificil pentru o persoană obișnuită să detecteze dacă o fotografie a fost manipulată sau editată de inteligența artificială.

Sunt necesare reglementări legale privind utilizarea IA.

În așteptarea dezvoltării unor instrumente capabile să detecteze interferențele IA, organismele de reglementare trebuie să stabilească reglementări legale clare și specifice privind utilizarea acestei tehnologii pentru a crea conținut original. Aceste reglementări ar trebui să indice clar publicului ce conținut sau lucrări au fost manipulate de IA, de exemplu, prin adăugarea implicită a unui filigran la imaginile care au fost procesate de IA.

Sursă: https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[Foto] Prim-ministrul Pham Minh Chinh participă la Conferința privind implementarea sarcinilor pentru 2026 ale sectorului industriei și comerțului](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

Comentariu (0)