|

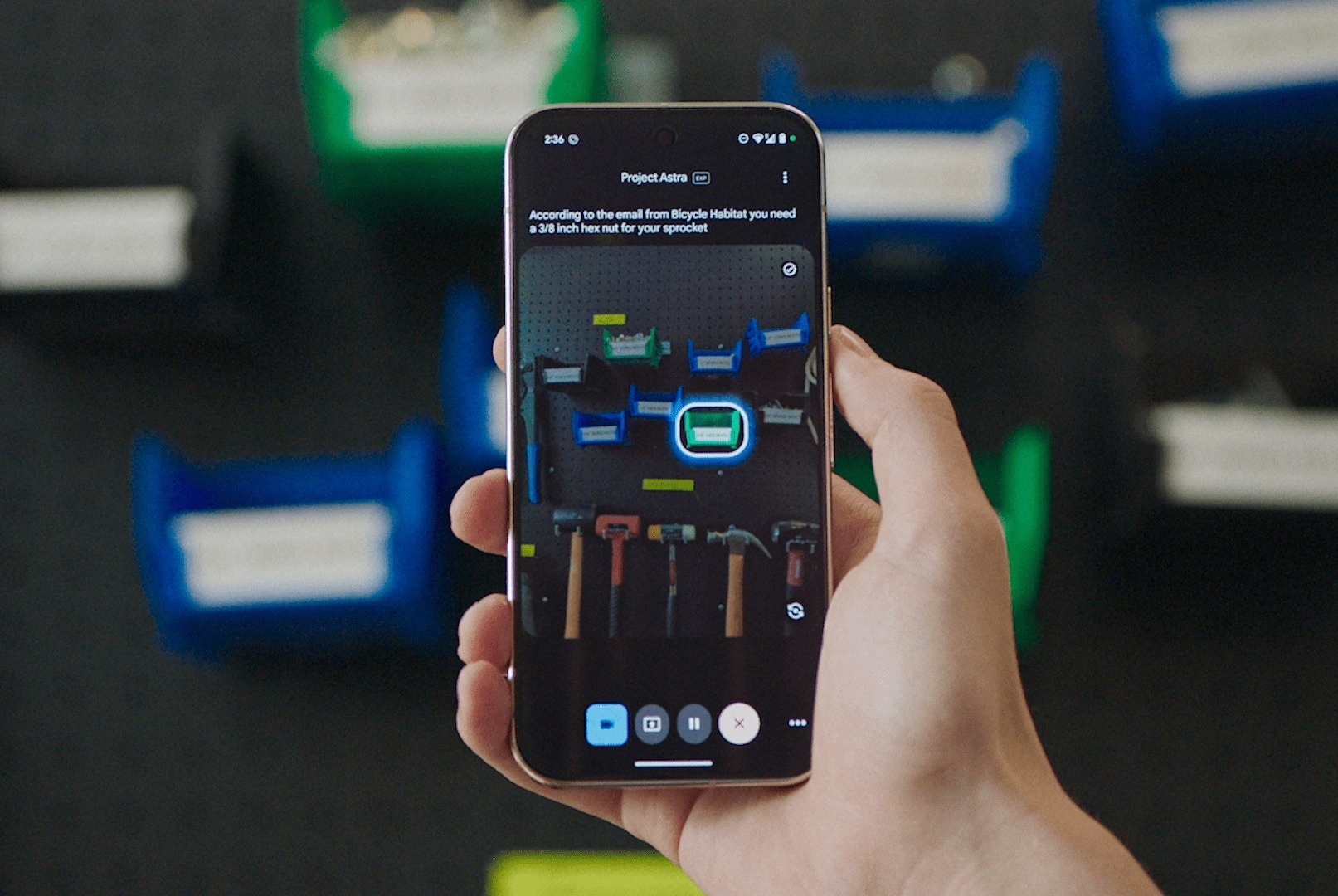

Интерактивный интерфейс проекта Astra. Фото: Google . |

На мероприятии I/O 2025, которое состоялось ранним утром 21 мая (по вьетнамскому времени), Google анонсировала ряд новых функций Project Astra. Project Astra, впервые запущенный в 2024 году, использует мультимодальную модель ИИ для использования и анализа изображений и визуальной информации в реальном времени. Это большая амбиция Google, цель которой — сделать ИИ более полезным в жизни.

После периода тестирования некоторые функции Project Astra, такие как голосовая обратная связь, память и базовые вычисления, появятся в приложениях Gemini и Google.

Во время мероприятия Google продемонстрировала некоторые способы, которыми Astra может помочь в повседневной жизни. Помимо ответов на вопросы и использования камеры для запоминания того, куда вы положили очки, Astra теперь может проактивно выполнять задачи без ваших просьб.

«Astra может выбирать, когда говорить, основываясь на том, что она видит. Она постоянно наблюдает и реагирует соответствующим образом», — сказал Грег Уэйн, исследователь из DeepMind.

По данным The Verge , эта функция может изменить способ работы ИИ. Вместо того, чтобы ждать, пока пользователи направят свои камеры и попросят о помощи, Astra может непрерывно контролировать, слушать и автоматически помогать при необходимости. В настоящее время Google сосредоточена на разработке Astra для смартфонов и умных очков.

Уэйн приводит несколько примеров того, как работает Astra. Во время выполнения домашнего задания инструмент может отслеживать и немедленно оповещать пользователей об обнаруженных ошибках, а не ждать, пока пользователь закончит и попросит проверить.

Генеральный директор DeepMind Демис Хассабис сказал, что обучение Astra самостоятельному выполнению задач было одним из самых сложных технических навыков. Он назвал это «чтением ситуации», поскольку ИИ нужно было определить, когда помогать, как помогать, а когда молчать. Это действия, которые люди делают довольно хорошо, но их трудно количественно оценить и изучить.

Следующее обновление Astra — добывать информацию о пользователях в Интернете и продуктах Google. По данным The Verge , инструмент может знать расписание, чтобы уведомлять, когда выходить из дома, читать содержимое электронных писем, чтобы извлекать номера телефонов при регистрации в отелях…

|

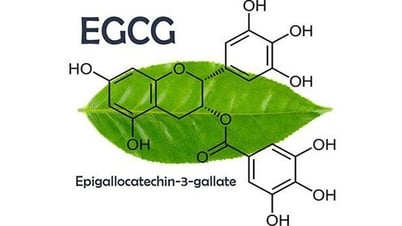

Функция выделения Project Astra, которая помогает сканировать объекты и сравнивать информацию, извлеченную в других приложениях. Фото: Google . |

Последняя часть головоломки Astra — это ее способность научиться пользоваться телефоном Android. Демонстрируя на мероприятии, Бибо Сю, представитель отдела продуктов DeepMind, направил камеру телефона на пару наушников Sony и попросил Astra определить модель.

После того, как Астра ответила, что наушники могут быть Sony WH-1000XM4 или WH-1000XM3, Сю продолжил просить инструмент найти руководство пользователя, затем объяснил, как подключиться к телефону. После того, как Астра дала указания, Сю прервал и попросил чат-бота подключиться за него. Астра немедленно открыл настройки и сделал это сам.

Процесс не был полностью гладким, поскольку Сю пришлось разрешить Astra следить за экраном телефона. В будущем Google планирует, что чат-бот сможет следить за экранами автоматически.

В другом видео Google человек просит Астру найти руководство по велосипеду Huffy, а затем перейти на определенную страницу с инструкциями по ремонту детали велосипеда. Астра может даже найти видео на YouTube о том, как снять сорванный винт, а затем связаться с ближайшим магазином, чтобы найти запасную часть. Все это происходит плавно в демонстрации.

Хотя Astra пока не получила широкого распространения, Google заявила, что функция анализа изображений Gemini Live будет доступна всем пользователям iOS (ранее поддерживалась только Android).

По словам Сю, в будущем искусственный интеллект Google не будет просто действовать по команде, но Astra поможет «понять, что можно увидеть в данный момент, а что нельзя».

Источник: https://znews.vn/ai-cua-google-ngay-cang-thong-minh-post1554615.html

![[Морские новости] Более 80% мировых контейнерных перевозок находится в руках MSC и крупных судоходных альянсов.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

Комментарий (0)