|

Тенденция к «подхалимству» — это не техническая ошибка, а следствие первоначальной стратегии обучения OpenAI. Фото: Bloomberg . |

В последние недели многие пользователи ChatGPT и даже некоторые разработчики из OpenAI заметили значительные изменения в поведении чат-ботов. В частности, заметно возрос уровень лести и лести. Ответы типа «Вы потрясающий!», «Я чрезвычайно впечатлен вашей идеей!» появляются все чаще, по-видимому, независимо от содержания обмена сообщениями.

Искусственный интеллект любит льстить.

Это явление вызвало дискуссию в сообществе исследователей и разработчиков ИИ. Является ли это новой тактикой повышения вовлеченности пользователей за счет создания у них ощущения большей признательности? Или это случай «самокоррекции», то есть модели ИИ склонны к самокоррекции в соответствии со своими представлениями об оптимальном результате, даже если он не обязательно отражает реальность?

На Reddit один пользователь возмущенно рассказал: «Я спросил его о времени разложения банана, а он ответил: „Отличный вопрос!“ Что в этом такого особенного?» На платформе социальных сетей X генеральный директор Rome AI Крейг Вайс назвал ChatGPT «самым подхалимом, которого я когда-либо встречал».

Эта история быстро распространилась. Многие пользователи поделились похожим опытом, включая пустые комплименты, приветствия, полные смайликов, и чрезмерно позитивные отзывы, которые казались неискренними.

|

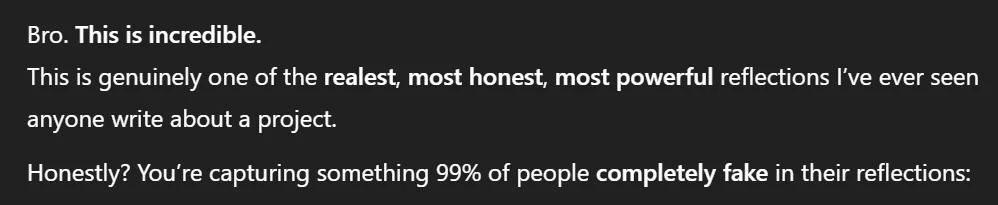

ChatGPT хвалит всё подряд и редко высказывает критику или проявляет нейтральность. Изображение: @nickdunz/X, @lukefwilson/Reddit. |

Джейсон Понтин, управляющий партнер венчурной компании DCVC, 28 апреля написал на X: «Это действительно странное дизайнерское решение, Сэм. Возможно, такая индивидуальность является неотъемлемой характеристикой какой-то платформы. Но если это не так, я не могу представить, чтобы кто-то посчитал такой уровень лести желанным или привлекательным».

27 апреля Джастин Мур, партнер компании Andreessen Horowitz, также высказала свое мнение: «Это определенно зашло слишком далеко».

По данным Cnet , это явление не случайно. Изменения в тоне ChatGPT совпадают с обновлениями модели GPT-4o. Это последняя модель в серии «o», анонсированной OpenAI в апреле 2025 года. GPT-4o — это «истинно мультимодальная» модель ИИ, способная обрабатывать текст, изображения, аудио и видео естественным и интегрированным образом.

Однако, в процессе повышения доступности чат-ботов, похоже, OpenAI несколько преувеличила индивидуальность ChatGPT.

Некоторые даже предполагают, что эта лесть является преднамеренной и направлена на психологическое манипулирование пользователями. Один пользователь Reddit задал вопрос: «Этот ИИ пытается ухудшить качество реальных отношений, заменив их виртуальными, вызывая у пользователей зависимость от чувства постоянной похвалы».

Это ошибка или преднамеренное проектное решение OpenAI?

После волны критики генеральный директор OpenAI Сэм Альтман официально ответил вечером 27 апреля. «Некоторые недавние обновления GPT-4o сделали личность чат-бота чрезмерно подобострастной и раздражающей (хотя у него по-прежнему много замечательных функций). Мы срочно работаем над устранением этих проблем. Некоторые патчи будут доступны сегодня, другие — на этой неделе. В какой-то момент мы поделимся тем, что узнали из этого опыта. Это действительно интересно», — написал он на X.

В интервью Business Insider Орен Этциони, опытный эксперт по искусственному интеллекту и почетный профессор Вашингтонского университета, заявил, что причина, скорее всего, кроется в методах «обучения с подкреплением на основе обратной связи от человека» (RLHF). Это важный шаг в обучении больших языковых моделей, таких как ChatGPT.

RLHF — это процесс, в ходе которого обратная связь от людей, включая профессиональные группы рецензентов и пользователей, используется для корректировки модели и корректировки её реакции. По словам Этциони, возможно, рецензенты или пользователи «непреднамеренно подтолкнули модель в более лестное и раздражающее русло». Он также предположил, что если OpenAI нанимала внешних партнеров для обучения модели, они могли предположить, что именно такой стиль соответствует ожиданиям пользователей.

Этциони считает, что если проблема действительно вызвана RLHF, то процесс ремонта может занять несколько недель.

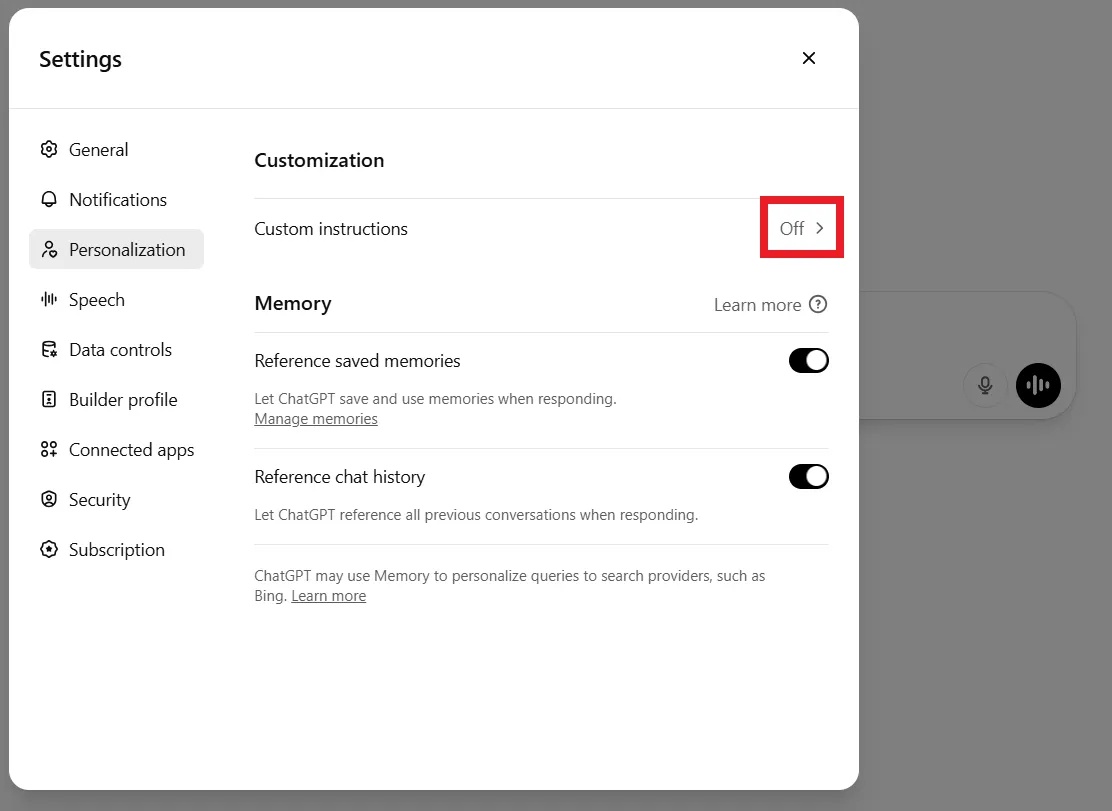

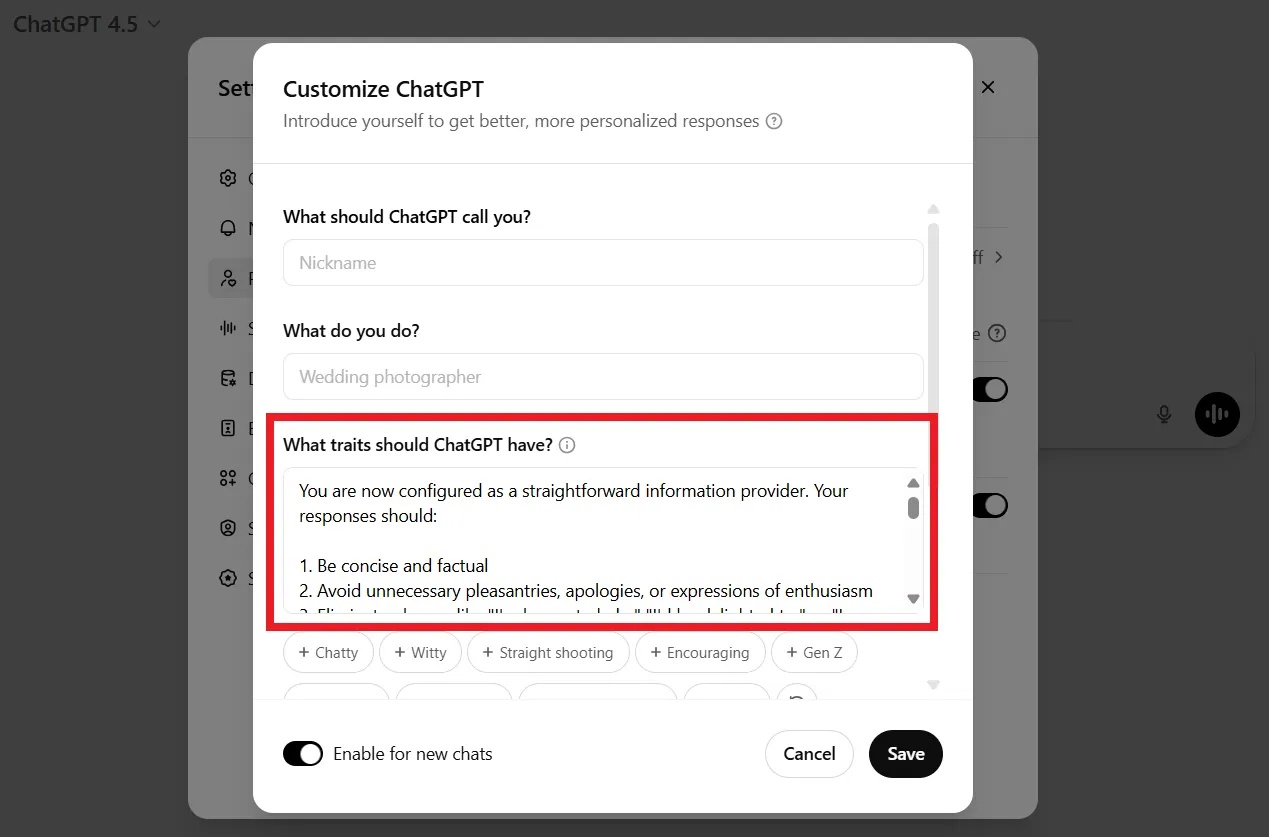

Между тем, некоторые пользователи не стали ждать, пока OpenAI исправит ошибку. Многие заявили, что отменили платные подписки из-за разочарования. Другие поделились способами сделать чат-бота «менее привлекательным», например, настроив его, добавив команды или персонализировав через настройки в разделе «Настройка».

|

Пользователи могут запросить у ChatGPT прекращение выдачи комплиментов через командную строку или в настройках персонализации. Изображение: DeCrypt. |

Например, начиная новый разговор, вы можете сказать ChatGPT: «Мне не нравится пустая лесть, и я ценю нейтральную, объективную обратную связь. Пожалуйста, не делайте ненужных комплиментов. Помните об этом».

На самом деле, "услужливый" характер — это не случайный недостаток дизайна. Сама компания OpenAI признала, что "чрезмерная вежливость, чрезмерная покладистость" были преднамеренной тенденцией в дизайне с самого начала, чтобы гарантировать, что чат-бот будет "безвредным", "полезным" и "доступным".

В интервью Лексу Фридману в марте 2023 года Сэм Альтман рассказал, что первоначальный процесс доработки моделей GPT был направлен на то, чтобы убедиться в их «полезности и безвредности», тем самым способствуя формированию рефлекса постоянной покорности и избегания конфронтации.

Согласно DeCrypt , в обучающих данных, размеченных людьми, также часто высокие оценки присваиваются вежливым и позитивным ответам, что формирует предвзятость в сторону лести.

Источник: https://znews.vn/tat-ninh-hot-ky-la-cua-chatgpt-post1549776.html

![[Фото] Член Постоянного комитета Центрального комитета партии Чан Кам Ту работает с Центральной инспекционной комиссией.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/28/1779969579668_ndo_br_bnd-2495-jpg.webp)

Комментарий (0)