(Dan Tri) – Mängden data som används för att träna artificiell intelligens är nästan uttömd, vilket tvingar forskare att använda AI för att träna varandra. Detta skulle kunna vara ett genombrott som kan hjälpa AI att överträffa mänsklig intelligens.

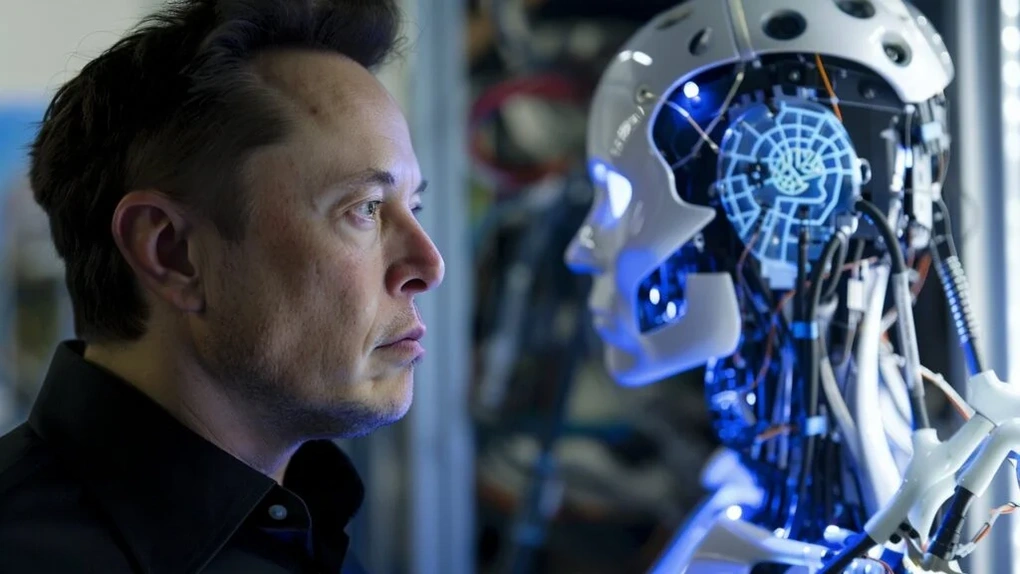

Elon Musk menar att nya sätt att utveckla AI kan vara farliga.

Teknikmiljardären Elon Musk, grundare av artificiell intelligens-företaget xAI, har just släppt chockerande information om processen för att träna och utbilda modeller för artificiell intelligens (AI).

”Vi har nu uttömt all mänsklig kunskap som behövs för att utbilda och träna AI. Detta har i princip hänt sedan förra året”, sa Elon Musk i en intervju som sändes live på sociala nätverket X den 9 januari.

AI-modeller som GPT-4, Gemini, Grok eller Llama... tränas baserat på stora mängder data som samlats in från internet, från vetenskapliga tidskrifter, publicerad forskning, användardata på sociala nätverk...

Elon Musk föreslår att man använder AI-data för att träna AI, men detta har många potentiella risker (Illustration: Getty).

Utvecklingstakten för AI-modeller är dock så snabb att mängden tillgänglig data inte längre räcker till för att träna och förbättra intelligensen hos dessa AI-modeller.

För att komma över detta problem har Elon Musk föreslagit en lösning, nämligen att övergå till att använda data som genereras av AI själv för att träna AI-modeller. Med andra ord kan AI träna sig själv och varandra utan att förlita sig på data som tillhandahålls av människor.

"Det enda sättet att lösa det här problemet är att komplettera den syntetiska data som genereras av själva AI-modellerna och använda denna data för att träna själva AI:n", delade Elon Musk.

AI-system som tränar sig själva baserat på syntetisk data som genereras av AI själv kommer att bidra till att spara utvecklingskostnader och minska beroendet av mänsklig data. Detta gör att många människor oroar sig för att AI kan träna sig själv att överträffa mänsklig intelligens, bortom mänsklighetens kontroll.

Experter på artificiell intelligens säger dock att användningen av syntetisk data som genereras av AI själv för att träna AI-modeller kan få dessa modeller att kollapsa, när den genererade datan saknar kreativitet, är partisk och inte är uppdaterad med den senaste informationen.

”När man använder syntetisk data för att träna AI-modeller försämras deras prestanda gradvis, och utdatan blir oinspirerande och partisk”, säger Andrew Duncan, chef för AI vid Alan Turing Institute i Storbritannien.

Högkvalitativ data anses vara en ovärderlig "resursgruva" som AI-utvecklingsföretag konkurrerar om. Men alla forskare är inte villiga att bidra med sitt forskningsarbete för att träna AI-modeller.

Google har lyckats skapa AI som tänker och agerar precis som människor.

Tänk dig att ha ett sätt att bestämma en persons personlighet, attityder och stil och sedan skapa en AI-kopia av den personen.

Detta är inte science fiction utan det underliggande målet med en banbrytande studie av forskare vid Stanford University och Google.

Med bara två timmars intervju kan Google skapa en AI som tänker och agerar precis som du (Foto: ZipRecruiter).

Forskare skapade en AI-kopia av fler än 1 000 deltagare med hjälp av information från intervjuer som bara varade i två timmar. Dessa AI:er kan härma mänskligt beteende.

De potentiella tillämpningarna av denna uppfinning är enorma. Beslutsfattare och företag skulle kunna använda denna AI-simulering för att förutsäga allmänhetens reaktioner på nya policyer eller produkter, istället för att enbart förlita sig på fokusgrupper eller upprepade opinionsundersökningar.

Forskare tror att tekniken kan hjälpa till att utforska sociala strukturer, testa interventioner och utveckla nyanserade teorier om mänskligt beteende.

Det finns dock också vissa risker, såsom etiska problem kring missbruk av AI-kloner. Illvilliga aktörer skulle kunna utnyttja denna AI för att manipulera den allmänna opinionen, utge sig för att vara individer eller simulera allmänna preferenser baserat på falsk syntetisk data.

Dessa farhågor har också länge varit föremål för oro om att spridningen av liknande AI-modeller kan få negativa konsekvenser för mänsklighetens framtid.

[annons_2]

Källa: https://dantri.com.vn/suc-manh-so/ai-sap-dat-duoc-buoc-dot-pha-moi-co-the-vuot-qua-tri-tue-con-nguoi-20250111132229246.htm

![[Foto] Premiärminister Pham Minh Chinh leder ett möte med regeringens ständiga kommitté för att undanröja hinder för projekt.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/06/1759768638313_dsc-9023-jpg.webp)

Kommentar (0)