Son aylarda çocuk güvenliği uzmanları ve araştırmacılar, yaratıcı yapay zekanın çevrimiçi istismarı daha da kötüleştirebileceği konusunda uyarıda bulundu.

Meta CEO'su Mark Zuckerberg, 31 Ocak 2024'te yapay zeka tarafından oluşturulmuş görseller taşıyan bir kalabalığın önünde ABD Senatosu Yargı Komitesi duruşmasında konuşuyor. Fotoğraf: Reuters

NCMEC, 2023 yılında aldığı tüm kaynaklardan çocuk istismarı içerikli bildirimlerin toplam sayısını henüz açıklamadı. Ancak 2022 yılında sorunla ilgili yaklaşık 88,3 milyon dosya bildirimi aldı.

NCMEC Başkan Yardımcısı John Shehan, "Yenilikçi yapay zeka şirketlerinden, (çevrimiçi) platformlardan ve halktan raporlar alıyoruz" dedi.

Meta, X, TikTok, Snap ve Discord'un CEO'ları, Çarşamba günü (31 Ocak) ABD Senatosu'nda çevrimiçi platformlarda çocuk güvenliğiyle ilgili bir duruşmada ifade verdi. ABD milletvekilleri, sosyal medya şirketlerine çocukları "çevrimiçi avcılardan" koruma çabaları hakkında soru sordu.

Stanford İnternet Gözlemevi'ndeki araştırmacılar, geçen Haziran ayında yayınladıkları raporda, kötü niyetli kişilerin yapay zekayı, gerçek hayattaki çocuklara tekrar tekrar zarar vermek için, onların sahte görüntülerini oluşturarak kullanabileceğini söyledi.

Çevrimiçi çocuk istismarı ihbarlarını alan NCMEC'in CyberTipline Direktörü Fallon McNulty, yapay zeka tarafından üretilen içeriklerin "gittikçe daha fotogerçekçi" hale geldiğini ve bu durumun kurbanların gerçek insanlar olup olmadığını belirlemeyi zorlaştırdığını söyledi.

McNulty, ChatGPT'yi oluşturan şirket olan OpenAI'nin, NCMEC'e rapor sunmak için bir süreç oluşturduğunu ve kuruluşun diğer yapay zeka şirketleriyle görüşmelerde bulunduğunu söyledi.

Hoang Hai (Reuters, FT'ye göre)

[reklam_2]

Kaynak

![[Fotoğraf] Genel Sekreter To Lam, Singapur Büyükelçisi Jaya Ratnam'ı kabul etti](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

![[Fotoğraf] Lam Dong: Duvarı kırık, yasadışı gölün yakın çekimi](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

![[Fotoğraf] 2025 Sonbahar Fuarı ve etkileyici rekorlar](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

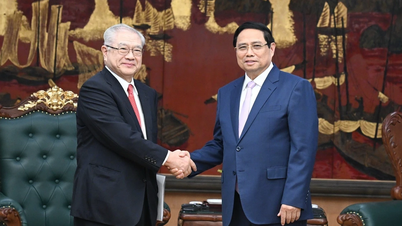

![[Fotoğraf] Başbakan Pham Minh Chinh, Kansai bölgesinde Japonya-Vietnam Dostluk Derneği Başkanı'nı kabul etti](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

Yorum (0)