دونوں کمپنیاں یو ایس اے آئی سیفٹی انسٹی ٹیوٹ کے ساتھ شراکت کریں گی، جو کہ نیشنل انسٹی ٹیوٹ آف اسٹینڈرڈز اینڈ ٹیکنالوجی (این آئی ایس ٹی) کی ایک اکائی ہے، جو کہ امریکی وفاقی ایجنسی ہے۔ اسے AI ٹیکنالوجی کے انتظام اور نگرانی میں ایک اہم قدم کے طور پر دیکھا جا رہا ہے، جو OpenAI کے ChatGPT کے آغاز کے بعد سے ایک بڑی تشویش کا باعث ہے۔

یو ایس اے آئی سیفٹی انسٹی ٹیوٹ کی ڈائریکٹر الزبتھ کیلی نے کہا، "یہ صرف شروعات ہے، لیکن AI کے مستقبل کو ذمہ داری سے سنبھالنے کی کوشش میں ایک اہم سنگ میل ہے۔"

معاہدے کے تحت، یو ایس اے آئی سیفٹی انسٹی ٹیوٹ دونوں کمپنیوں کو ان کے ماڈلز میں ممکنہ حفاظتی بہتری کے بارے میں فیڈ بیک فراہم کرے گا، عوام کے لیے ریلیز ہونے سے پہلے اور بعد میں۔ انسٹی ٹیوٹ اس عمل کے دوران UK AI سیفٹی انسٹی ٹیوٹ کے ساتھ بھی مل کر کام کرے گا۔

"امریکی AI سیفٹی انسٹی ٹیوٹ کے ساتھ شراکت داری وسیع پیمانے پر تعیناتی سے پہلے ہمارے ماڈلز کو سختی سے جانچنے کے لیے اپنی وسیع مہارت کا فائدہ اٹھاتی ہے۔ یہ ذمہ دار AI ترقی کو فروغ دیتے ہوئے خطرات کی شناخت اور ان کو کم کرنے کی ہماری صلاحیت کو بڑھاتا ہے،" جیک کلارک، شریک بانی اور انتھروپک کے پالیسی کے سربراہ نے کہا۔

یہ اقدام 2023 میں جاری کیے جانے والے وائٹ ہاؤس کے AI ایگزیکٹو آرڈر کو نافذ کرنے کی کوشش کا حصہ ہے، جس کا مقصد امریکہ میں AI ماڈلز کی تیزی سے تعیناتی کے لیے قانونی فریم ورک بنانا ہے۔

لیکن جب وفاقی حکومت رضاکارانہ انداز اپنا رہی ہے، امریکی ٹیک ہب کیلیفورنیا میں قانون سازوں نے 28 اگست کو ریاستی سطح کا اے آئی سیفٹی بل منظور کیا۔ بل پر، اگر گورنر کے دستخط ہوتے ہیں، تو یہ AI صنعت پر سخت ضابطے نافذ کر دے گا۔

اوپن اے آئی کے سی ای او سیم آلٹ مین نے ریاستی سطح کے بجائے قومی سطح پر AI کو ریگولیٹ کرنے کی حمایت کا اظہار کیا ہے، یہ دلیل دیتے ہوئے کہ اس سے AI کے میدان میں تحقیق اور اختراع میں رکاوٹ کے خطرے سے بچنے میں مدد ملے گی۔

سرکردہ ٹیک کمپنیوں اور امریکی حکومت کا یہ اقدام AI کے تیزی سے ابھرتے ہوئے میدان میں جدت طرازی اور حفاظت میں توازن پیدا کرنے کے رجحان کو ظاہر کرتا ہے۔

ماخذ: https://nhandan.vn/openai-va-anthropic-chia-se-moi-nhat-ai-voi-chinh-phu-my-post827601.html

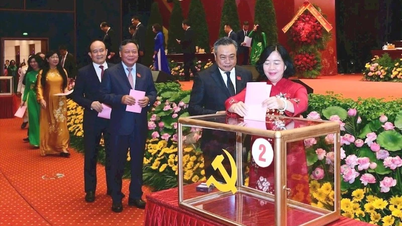

![[تصویر] جنرل سکریٹری ٹو لام نے 18 ویں ہنوئی پارٹی کانگریس میں شرکت کی، مدت 2025-2030](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/16/1760581023342_cover-0367-jpg.webp)

![[تصویر] نین ڈین اخبار نے "فادر لینڈ ان دی ہارٹ: دی کنسرٹ فلم" کا آغاز کیا۔](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/16/1760622132545_thiet-ke-chua-co-ten-36-png.webp)

![[ویڈیو] TripAdvisor Ninh Binh کے بہت سے مشہور پرکشش مقامات کا اعزاز دیتا ہے۔](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/16/1760574721908_vinh-danh-ninh-binh-7368-jpg.webp)

![[تصویر] نین ڈین اخبار نے "فادر لینڈ ان دی ہارٹ: دی کنسرٹ فلم" کا آغاز کیا۔](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/16/1760622132545_thiet-ke-chua-co-ten-36-png.webp)

تبصرہ (0)