مكالمات احتيالية بتقنية Deepfake: عملية احتيال جديدة ومتطورة للغاية

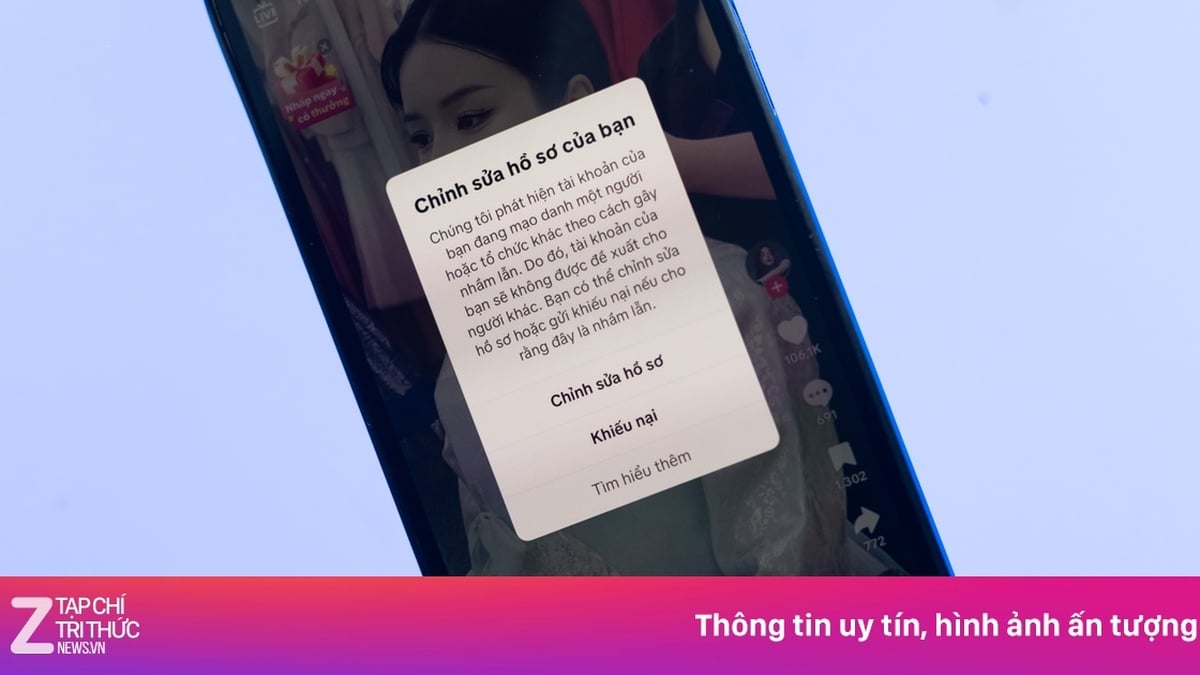

من الأمثلة النموذجية على ذلك السيدة ف.ت.م (٢٦ عامًا، لونغ بين، هانوي ) التي تلقت رسالة من قريب لها في الخارج يطلب منها تحويل ٧٥ مليون دونج إلى حساب معين. في ذلك الوقت، ظنت السيدة ف.ت.م أن هذا قريبها، لذا لم تتردد في تحويل المبلغ.

قالت السيدة VTM إنها عندما تلقت رسالة تطلب اقتراض المال من أحد أقاربها، اتصلت به بحرص للتحقق من الفيديو ، فوجدت الصورة لصديقتها بالفعل. وثقت بها السيدة VTM وحولت القرض. ولكن بعد فترة، رأت منشورًا على صفحة قريبها الشخصية يُعلن أن حسابها على فيسبوك قد تعرض للاختراق من قِبل محتال لطلب اقتراض المال من بعض الأصدقاء والأقارب. اتصلت السيدة VTM بقريبها واكتشفت أنها تعرضت للاحتيال.

أو حالة السيد ف.د.ك (42 عامًا، من مقاطعة نهوي، هانوي) الذي قال إنه تعرض للاحتيال بمبلغ 30 مليون دونج فيتنامي عبر مكالمة فيديو مزيفة. وتحديدًا، مؤخرًا، أرسل أحد أقاربه في الخارج رسالة نصية يطلب فيها اقتراض المال لأمر عاجل. بعد ذلك مباشرةً، تلقت السيدة تام مكالمة فيديو عبر تطبيق ماسنجر فيسبوك.

لم تدم المكالمة سوى ثوانٍ معدودة، لكنني رأيت وجه حبيبي وطريقة مخاطبته المألوفة، لكن المكالمة كانت متقطعة. ثم تلقيت رسالة تفيد بأن الإشارة ضعيفة، لذا لم أستطع مواصلة مكالمة الفيديو، فانتقلت إلى الرسائل النصية تسهيلًا عليّ. وثقت به وحولت المبلغ وفقًا للتعليمات، كما روى السيد VDC.

في تعليقه على هذه القضية، أشار خبير التكنولوجيا نغو مينه هيو، من المركز الوطني لمراقبة الأمن السيبراني (NCSC)، إلى أن تقنيات الذكاء الاصطناعي تُحدث فرقًا كبيرًا في حياة الناس. ومع ذلك، استغلّ المجرمون هذه التقنيات لإنشاء صورٍ تُنسخ الأصوات، بدءًا من اختراق حسابات فيسبوك وإنستغرام، مرورًا بدراسة الرسائل، ونماذج العناوين، وسجلّ المعاملات، وصولًا إلى إجراء مكالمات وهمية وسرقة أموال من أقارب وعائلة الحساب المُخترق، وصولًا إلى الاتصال بالضحية مباشرةً لخلق حالات طارئة تتطلب تحويلات مالية.

بعد الاستيلاء على حساب الضحية على فيسبوك، أرسل المحتال رسالة نصية للضحية لاقتراض المال، ثم اتصل بالضحية عبر مكالمة فيديو مزيف، وأغلق الهاتف لبضع ثوانٍ، ثم قال إنه فقد إشارة هاتفه... عند هذه النقطة، وثق به الضحية وحول الأموال لأن الطرف الآخر كان بحاجة ماسة إلى اقتراض المال،" علق خبير التكنولوجيا نجو مينه هيو.

قال السيد نجو توان آنه، رئيس مجلس الإدارة والرئيس التنفيذي لشركة سمارت سايبر سيكيوريتي المساهمة، إن الاحتيال الإلكتروني يُقسم حاليًا إلى طريقتين رئيسيتين: انتحال صفة جهات التحقيق والمحاكم، واستغلال "جشع" الناس للحصول على مكافآت طائلة وكسب المال بسهولة. مع هذين النوعين من الاحتيال، هناك العديد من السيناريوهات المختلفة، بما في ذلك السيناريو الذي يُنصح فيه المستخدمون بالتحقق من المعلومات عبر مكالمة فيديو. وقد ابتكر المحتالون هذه الطريقة "المحايدة" لخداع الضحايا.

كيف يعمل Deepfake؟

وبحسب شرطة مدينة هانوي، فإن Deepfake هي تقنية تستخدم الذكاء الاصطناعي لإنشاء منتجات تقنية الصوت والصورة والفيديو التي تزيف الأشياء الحقيقية بدقة عالية جدًا.

استنادًا إلى ملف صورة لوجه وصوت شخص حقيقي، يستخدم Deepfake خوارزميات لإعادة إنشاء الوجه والصوت بما يتوافق مع ملامح وتعبيرات وجه شخص آخر؛ ثم يُنتج فيديو يُحاكي تمامًا الشخص الحقيقي. عبر الإنترنت، يجمع الأشخاص صورًا وأصواتًا لمستخدمين على منصات التواصل الاجتماعي، مستخدمين تقنية Deepfake لإنشاء رسوم متحركة ومقاطع فيديو مزيفة لمستخدمين يتحدثون عبر الإنترنت بنفس الوجه ونبرة الصوت وطريقة التحدث.

يُنشئ المُستخدِم حساباتٍ وهمية على مواقع التواصل الاجتماعي بنفس معلومات وصور المستخدم، ويُصادق الضحية في قائمة أصدقائه، ويرسل رسائل لاقتراض المال بناءً على سيناريو مُسبق. في بعض الحالات، يخترق المُستخدِم حساب المستخدم على مواقع التواصل الاجتماعي لإرسال رسائل مباشرة إلى الضحايا في قائمة أصدقائه. ولكسب ثقة الضحية، يُحمّل المُستخدِم مقاطع فيديو مُزيفة موجودة إلى قناة مكالمة الفيديو، مما يُمكّن الضحية من التعرّف على صورة وصوت أحد معارفه، وتحويل الأموال بسرعة بناءً على طلبه.

أضافت شرطة مدينة هانوي أن تقنية التزييف العميق (Deepfake) تُمكّن من إنتاج مقاطع فيديو مزيفة بدقة عالية، مما يُصعّب التمييز بين الحقيقي والمزيف. ومع ذلك، غالبًا ما تحتوي مقاطع الفيديو التي يُنتجها الشخص المعني على محتوى عام، لا يتوافق تمامًا مع السياق الفعلي للتواصل مع الضحية، مما قد يُثير شكوك الضحية ويدفعه إلى كشفها. ولتغطية هذه العيوب، غالبًا ما يُنشئ الأشخاص المعنيون مقاطع فيديو ذات صوت يصعب سماعه وصور غير واضحة، تُشبه مكالمات الفيديو ذات الإشارات غير المستقرة التي تُجرى في مناطق ذات تغطية ضعيفة للهواتف المحمولة/الواي فاي. هذه عملية احتيال حديثة ومتطورة للغاية.

كيفية منع سرقة بيانات الوجه والصوت؟

وبحسب خبير التكنولوجيا نجو مينه هيو، فإن أفضل طريقة لتجنب Deepfake هي أن يحد المستخدمون من مشاركة الصور أو مقاطع الفيديو الشخصية عبر الإنترنت؛ وتأمين حسابات التواصل الاجتماعي والبريد الإلكتروني دائمًا بكلمات مرور عالية المستوى.

إذا قمت بمشاركة مقاطع فيديو أو مقاطع عبر الإنترنت، فيجب عليك تشويه صوتك واستبداله بصوت روبوت أو ذكاء اصطناعي لمنع الأشرار من معرفة صوتك الحقيقي.

إذا تم تزوير Deepfake، فيجب على المستخدمين إخطار الجميع على الفور والإبلاغ إلى السلطات على canhbao.ncsc.gov.vn أو الإبلاغ إلى مشروع chongluadao https://chongluadao.vn؛ في الوقت نفسه، من الضروري زيادة الوعي بالتعرف على الاحتيال في الفضاء الإلكتروني على: dauhieuluadao.com.

توصي شرطة مدينة هانوي المواطنين بتوخي الحذر عند تلقي أي رسائل أو مكالمات فيديو تتضمن استعارة أو إقراض أموال عبر تطبيقات التواصل الاجتماعي. يجب على المواطنين التزام الهدوء عند تلقي أي رسائل أو مكالمات فيديو تتضمن استعارة أو إقراض أموال عبر تطبيقات التواصل الاجتماعي، ثم الاتصال بأقاربهم مباشرةً للتحقق (لا تستخدموا تطبيقات التواصل الاجتماعي مثل زالو، ماسنجر، فايبر، تيليجرام، إلخ). في حال الاشتباه في انتحال أشخاص صفة أقارب على مواقع التواصل الاجتماعي بغرض الاحتيال أو الاستيلاء على ممتلكات، يجب على المواطنين الإبلاغ فورًا إلى أقرب مركز شرطة للحصول على الدعم في الوقت المناسب، ولمكافحتهم ومنعهم والتعامل معهم بصرامة وفقًا للقانون.

في معرض حديثه عن كيفية منع ومكافحة مكالمات الاحتيال، أشار السيد نغو توان آنه إلى ضرورة توخي الحذر وعدم النقر على روابط غريبة. في حال تحويل الأموال، هناك طريقة بسيطة وفعالة للتحقق: تحقق من تطبيق الخدمات المصرفية عبر الإنترنت الخاص بالبنك للتأكد من ظهور معلومات الأقارب والأصدقاء الصحيحة عند إدخال رقم الحساب قبل التحويل.

قال خبير التكنولوجيا نجو مينه هيو إن إحدى العلامات التي يمكن من خلالها التعرف على مكالمات Deepfake وتجنبها هي أن وجه الشخصية في الفيديو يفتقر إلى العاطفة ويكون "غير مبال" تمامًا عند التحدث، أو أن الوضع محرج أو غير طبيعي، أو أن اتجاه رأس وجسم الشخصية في الفيديو غير متسق مع بعضهما البعض.

وفقًا لشركات الأمن، يُعدّ التزييف العميق مزيجًا من "التعلم العميق" و"التزييف". التعلم العميق هو استخدام أساليب ذكاء اصطناعي متقدمة تُطبّق خوارزميات متعددة لتركيب خصائص متقدمة تدريجيًا من بيانات الإدخال. ومن ثم، تتمتع هذه التقنية بالقدرة على تركيب البيانات التي يُدخلها المستخدمون، مثل الوجوه البشرية والحركات الجسدية والأصوات، والتعلم منها. يُمكن التزييف العميق من ربط وجه شخص بآخر في مقطع فيديو بدقة عالية. |

نمط المكتب

[إعلان 2]

مصدر

![[أخبار الملاحة البحرية] أكثر من 80% من سعة شحن الحاويات العالمية في أيدي MSC وتحالفات الشحن الكبرى](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

تعليق (0)