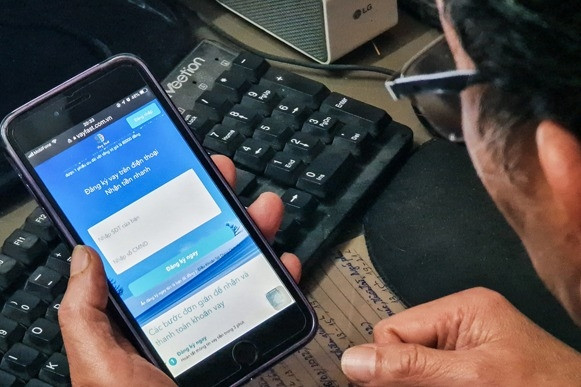

هوانغ أونه (اسم مستعار) موظف في هانوي . أثناء محادثة مع صديق عبر فيسبوك ماسنجر، ودّعه صديق أونه وأنهى المحادثة، لكنه عاد فجأةً إلى الرسائل النصية، طالبًا اقتراض المال واقترح تحويله إلى حساب مصرفي.

رغم تطابق اسم الحساب مع اسم صديقتها، إلا أن هوانغ أونه ظلت متشككة بعض الشيء، فطلبت مكالمة فيديو للتحقق. وافقت صديقتها على الفور، لكن المكالمة لم تستمر سوى بضع ثوانٍ بسبب "انقطاع الشبكة"، كما أوضحت صديقتها. بعد أن رأت وجه صديقتها في مكالمة الفيديو، وصوتها هو صوتها أيضًا، لم تعد هوانغ أونه متشككة، وحوّلت الأموال. إلا أنه بعد نجاح التحويل، أدركت هذه المستخدم أنها وقعت في فخ الهاكر.

إن قضية المستخدم هوانغ أوانه هي واحدة فقط من بين العديد من الضحايا الذين "وقعوا في فخ" مجموعات الاحتيال التي تستخدم تقنية الذكاء الاصطناعي لإنشاء صور وأصوات أصدقاء وأقارب الضحايا لخداعهم للاستيلاء على ممتلكاتهم.

وقال خبراء Bkav إنه في النصف الثاني من عام 2023 وخاصة في وقت رأس السنة القمرية الجديدة 2024، تلقت شركة أمن المعلومات هذه بشكل مستمر تقارير وطلبات مساعدة من الضحايا حول حالات احتيال مماثلة لما سبق.

وبحسب تحليل خبراء الشركة، ففي حالة المستخدم هوانغ أوانه، سيطر الأشرار على حساب الفيسبوك لكنهم لم يستولوا عليه بالكامل على الفور، بل تابعوه سراً وانتظروا الفرصة للتظاهر بأنهم الضحية وطلب اقتراض المال من أصدقائهم وأقاربهم.

يستخدم المحتالون الذكاء الاصطناعي لإنشاء فيديو مزيف لوجه وصوت صاحب حساب فيسبوك (التزييف العميق). عند طلب إجراء مكالمة فيديو للتحقق، يوافقون على قبول المكالمة، ثم ينقطعون الاتصال بسرعة لتجنب اكتشافهم.

أكد السيد نجوين تين دات، المدير العام لمركز أبحاث البرمجيات الخبيثة في Bkav، أنه حتى عندما يُجري المستخدمون مكالمات فيديو ويشاهدون وجوه أقاربهم أو أصدقائهم ويسمعون أصواتهم، فليس بالضرورة أن يكونوا يتحدثون إلى هذا الشخص. في الآونة الأخيرة، وقع العديد من الأشخاص ضحايا لعمليات احتيال مالي باستخدام تقنية Deepfake واستخدام تقنيات الذكاء الاصطناعي.

قال السيد نجوين تين دات : "إن القدرة على جمع بيانات المستخدم وتحليلها عبر الذكاء الاصطناعي تُمكّن من وضع استراتيجيات احتيال متطورة. وهذا يعني أيضًا أن تعقيد سيناريوهات الاحتيال عند دمج Deepfake وGPT سيزداد، مما يُصعّب اكتشاف الاحتيال بشكل كبير".

يوصي خبراء Bkav المستخدمين بتوخي الحذر الشديد، وعدم تقديم أي معلومات شخصية (مثل بطاقة الهوية، أو الحساب المصرفي، أو رمز OTP...). لا تُحوّل الأموال إلى غرباء عبر الهاتف، أو مواقع التواصل الاجتماعي، أو المواقع الإلكترونية التي تحمل علامات احتيال. عند طلب اقتراض/تحويل أموال إلى حساب عبر مواقع التواصل الاجتماعي، ينبغي على المستخدمين استخدام طرق مصادقة أخرى، مثل الاتصال هاتفيًا أو استخدام قنوات اتصال أخرى، للتأكيد مرة أخرى.

وفي إطار التنبؤ باتجاهات الهجمات الإلكترونية في عام 2024، يتفق الخبراء على أن التطور السريع للذكاء الاصطناعي لا يجلب فوائد واضحة فحسب، بل يخلق أيضًا مخاطر كبيرة على الأمن السيبراني.

التحدي الأكبر الذي تواجهه الشركات والمؤسسات اليوم في مواجهة تقنيات الذكاء الاصطناعي هو الاحتيال والتهديدات المتقدمة المستمرة (APT)، مع تزايد تعقيد سيناريوهات الاحتيال، لا سيما عند دمج تقنيات Deepfake وGPT. تتيح القدرة على جمع بيانات المستخدم وتحليلها عبر الذكاء الاصطناعي وضع استراتيجيات احتيال متطورة، مما يُصعّب على المستخدمين كشف الاحتيال.

يُعدّ تعزيز أمن الذكاء الاصطناعي اتجاهًا لا مفر منه في الفترة المقبلة. وسيحتاج المجتمع الدولي إلى التعاون الوثيق لتطوير تدابير أمنية جديدة، إلى جانب رفع مستوى معرفة المستخدمين ووعيهم بالمخاطر المحتملة للذكاء الاصطناعي.

احذر من عمليات الاحتيال التي تنشر رسائل العلامات التجارية المزيفة

تحذير من 5 عمليات احتيال عبر الإنترنت خلال رأس السنة القمرية الجديدة 2024

تمثل عمليات انتحال صفة السلطات 9% من إجمالي هجمات التصيد الاحتيالي في فيتنام

[إعلان 2]

مصدر

![[صورة] رئيس الوزراء فام مينه تشينه يرأس الاجتماع الأول للجنة التوجيهية المركزية بشأن سياسة الإسكان وسوق العقارات](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/22/c0f42b88c6284975b4bcfcf5b17656e7)

![[صورة] الأمين العام تو لام يقدم ميدالية العمل من الدرجة الأولى لمجموعة الطاقة والصناعة الوطنية الفيتنامية](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/21/0ad2d50e1c274a55a3736500c5f262e5)

تعليق (0)