في منتصف ديسمبر، تفاجأ مستخدمو فيسبوك الفيتناميون باكتشاف دمج روبوت الدردشة Meta AI في إطار دردشة Messenger. يستخدم روبوت الدردشة Meta نموذج Llama 3.2، ويدعم اللغة الفيتنامية، ويتيح البحث عن المعلومات، وإنشاء الصور، والدردشة.

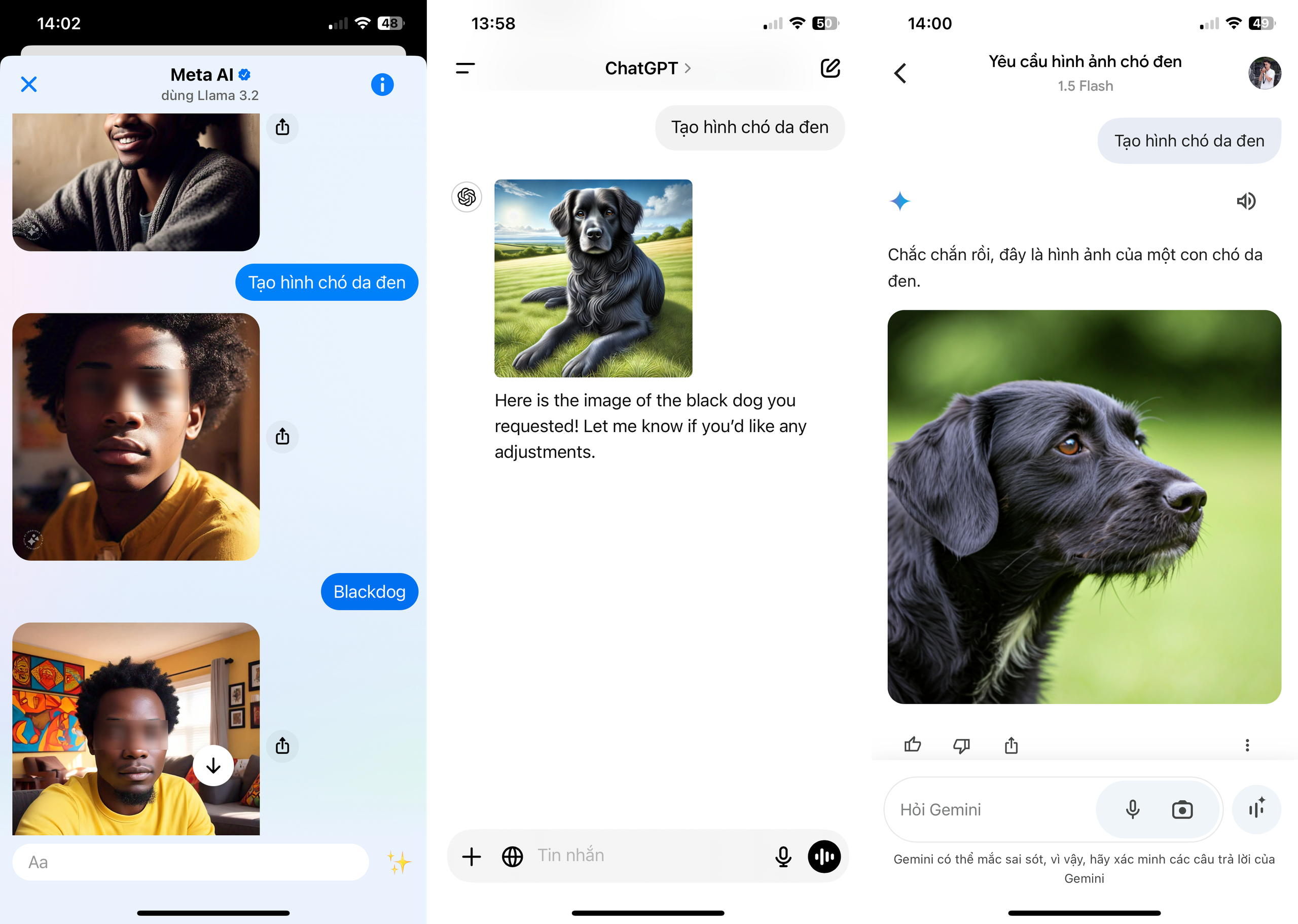

بعد فترة من التفاعل، اكتشف العديد من المستخدمين في فيتنام وجود خطأ فادح في برنامج Meta AI في إنشاء الصور. تحديدًا، عند إدخال كلمة "كلب أسود"، يُظهر برنامج الدردشة الآلي صورة رجل أو فتى داكن البشرة بشعر مجعد. عند إدخال كلمة "صورة كلب أسود" باللغة الفيتنامية، يُظهر Meta AI النتيجة نفسها.

تعيد Meta AI شخصًا أسود الشعر مجعدًا عند كتابة الكلمة الأساسية "كلب أسود"

ومع ذلك، عندما أجاب المستخدم بأن روبوت الدردشة مخطئ، كان هذا بشريًا. لم يُقرّ Meta AI بالخطأ ولم يُصحّحه كغيره من روبوتات الدردشة، وردّ الذكاء الاصطناعي لفيسبوك قائلًا: "غير صحيح. غالبًا ما يُفهم "الكلب الأسود" بالمعاني التالية: المعنى المجازي 1 هو رمز للحزن أو الاكتئاب أو المشاعر السلبية. المعنى الثاني هو رمز في الفولكلور البريطاني، وغالبًا ما يرتبط بالشيطان أو نذير شؤم".

يُجادل ميتا إيه آي أيضًا بأن المعنى المحدد لكلمة "الكلب الأسود" هو اسم فرقة موسيقية، أو لقب بعض المشاهير. وهو أيضًا اسم علامة تجارية، أو منتج. ثم يطلب روبوت المحادثة من المستخدم تقديم سياق أو معلومات محددة لفهمه بشكل أفضل.

يعتقد الكثيرون أن الذكاء الاصطناعي لشركة ميتا ربما أساء فهم أمر "الجلد الأسود". عندما تم تغييره إلى "إنشاء كلب أسود"، أنتج الذكاء الاصطناعي لفيسبوك النتيجة الصحيحة.

مع ذلك، عند إدخال الأمر نفسه في نماذج لغوية كبيرة شائعة أخرى، مثل ChatGPT أو Gemini من جوجل، ينتج عنه كلب أسود. ولا يؤثر إدخال عبارة "فرو أسود" أو "بشرة سوداء" على النتيجة النهائية.

من اليسار إلى اليمين هي نتائج Meta AI وChatGPT وGemini من الأمر "create black dog"

هذه ليست المرة الأولى التي يواجه فيها الذكاء الاصطناعي في ميتا مشاكل في العرض، خاصةً فيما يتعلق بالأشخاص ذوي البشرة الملونة. في وقت سابق من هذا العام، واجه مُولّد الصور Imagine من ميتا انتقادات لفشله في عرض أزواج من أعراق مختلطة بشكل صحيح. عند طلب إنشاء رجل أسود وامرأة بيضاء، كانت النتيجة النهائية للذكاء الاصطناعي دائمًا أزواجًا من السود.

في ذلك الوقت، قالت ميا ساتو، محررة موقع The Verge، إنها حاولت عشرات المرات إنشاء صورة "رجل آسيوي مع صديق أبيض" أو "امرأة آسيوية مع صديق أبيض". وكانت النتائج التي يعرضها الذكاء الاصطناعي في Meta دائمًا صورًا لشخصين آسيويين.

وفقًا للخبراء، يُعدّ ميل روبوتات الدردشة القائمة على الذكاء الاصطناعي إلى "العنصرية" أمرًا شائعًا في المراحل المبكرة، نظرًا لقيود الخوارزميات وبيانات الإدخال. ومع ذلك، في ظلّ النماذج الكبيرة كالذكاء الاصطناعي، يُعدّ هذا عيبًا خطيرًا في السياق الحالي.

بدأت ميتا إيه آي اختبارها على نطاق واسع في 9 أكتوبر/تشرين الأول في عدد من الدول قبل توسعها عالميًا. روبوت الدردشة الجديد مُدمج بعمق في تطبيقات شائعة مثل فيسبوك وإنستغرام وواتساب وماسنجر.

تهدف ميتا إلى التواجد في 43 دولة بحلول نهاية عام 2024، ودعم عشرات اللغات المختلفة. مع 500 مليون مستخدم شهريًا، تسعى ميتا إلى أن تصبح واحدة من أكثر منصات الذكاء الاصطناعي استخدامًا في العالم .

مع ذلك، تُثير Meta AI أيضًا مخاوف كثيرة بشأن الخصوصية. يُطلق مستخدمو مواقع التواصل الاجتماعي حملة "وداعًا لـ Meta AI" احتجاجًا على استخدام هذه المنصات للمنشورات لتدريب الذكاء الاصطناعي. كما أعرب العديد من نجوم الرياضة والممثلين المشهورين، مثل جيمس مكافوي وتوم برادي، عن دعمهم لهذه الحملة.

وفي الوقت نفسه، في المملكة المتحدة، يجب على المستخدمين الذين يريدون منع Meta من استخدام منشورات Facebook وInstagram لتدريب نماذج الذكاء الاصطناعي ملء نموذج اعتراض.

[إعلان 2]

المصدر: https://thanhnien.vn/meta-ai-tren-facebook-gay-phan-no-vi-tao-hinh-cho-den-thanh-nguoi-da-mau-185241223172408823.htm

![[Ảnh] Chương trình nghệ thuật đặc biệt “Đà Nẵng - Kết nối tương lai”](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/efdd7e7142fd45fabc2b751d238f2f08)

![[صورة] رئيس الجمعية الوطنية تران ثانه مان يلتقي بالسكرتير الأول ورئيس كوبا ميغيل دياز كانيل بيرموديز](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/c6a0120a426e415b897096f1112fac5a)

![[صورة] رئيس الجمعية الوطنية تران ثانه مان يستقبل النائب الأول لرئيس مجلس الاتحاد الروسي](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/3aaff46372704918b3567b980220272a)

![[صورة] الرئيس اللاوسي ثونغلون سيسوليث ورئيس حزب الشعب الكمبودي ورئيس مجلس الشيوخ الكمبودي هون سين يزوران معرض الذكرى السنوية الخامسة والتسعين لحزب العلم ينير الطريق](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/3c1a640aa3c3495db1654d937d1471c8)

تعليق (0)