অস্টিনের টেক্সাস বিশ্ববিদ্যালয়, টেক্সাস এএন্ডএম বিশ্ববিদ্যালয় এবং পারডু বিশ্ববিদ্যালয়ের একটি নতুন গবেষণায় দেখা গেছে যে নিম্নমানের সোশ্যাল মিডিয়া কন্টেন্ট খাওয়ালে কৃত্রিম বুদ্ধিমত্তা মানুষের মতোই "মস্তিষ্ক পচা" হয়ে যেতে পারে।

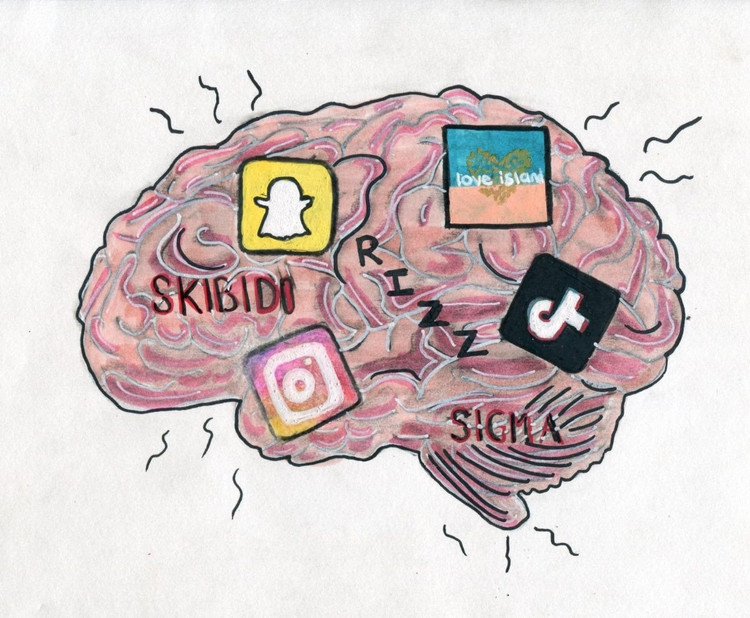

"এআই ব্রেন রট" নামে পরিচিত এই ঘটনাটি ইঙ্গিত দেয় যে যখন বৃহৎ ভাষা মডেলগুলি খুব বেশি ভাইরাল, চাঞ্চল্যকর এবং অগভীর বিষয়বস্তু শোষণ করে, তখন তারা ধীরে ধীরে যুক্তিসঙ্গতভাবে চিন্তা করার, মনে রাখার ক্ষমতা হারিয়ে ফেলে এবং এমনকি নৈতিকভাবে বিচ্যুত হয়ে পড়ে।

শুধু মানুষই নয়, অনেক অপ্রয়োজনীয় ছোট ভিডিও সার্ফ করার সময় কৃত্রিম বুদ্ধিমত্তাও মস্তিষ্কের অবক্ষয়ের শিকার হয়।

সিঙ্গাপুরের জাতীয় বিশ্ববিদ্যালয়ের নতুন প্রভাষক জুনিয়ুয়ান হং-এর নেতৃত্বে গবেষণা দলটি দুটি ওপেন-সোর্স ভাষার মডেলের উপর পরীক্ষা-নিরীক্ষা চালিয়েছে: মেটার লামা এবং আলিবাবার কোয়েন।

তারা মডেলগুলিকে বিভিন্ন ধরণের ডেটা সরবরাহ করেছিল — কিছু নিরপেক্ষ তথ্যমূলক বিষয়বস্তু, অন্যগুলি অত্যন্ত আসক্তিকর সোশ্যাল মিডিয়া পোস্ট যেখানে "বাহ," "দেখুন," এবং "আজকের জন্যই" এর মতো সাধারণ শব্দ ব্যবহার করা হয়েছিল। লক্ষ্য ছিল যখন AI কে প্রকৃত মূল্য প্রদানের পরিবর্তে ভিউ আকর্ষণ করার জন্য ডিজাইন করা সামগ্রীর উপর প্রশিক্ষণ দেওয়া হয় তখন কী ঘটে তা দেখা।

ফলাফলে দেখা গেছে যে, অনলাইনে জাঙ্ক তথ্যের ধারায় "খাওয়া" মডেলরা জ্ঞানীয় পতনের স্পষ্ট লক্ষণ দেখাতে শুরু করেছে: তাদের যুক্তি করার ক্ষমতা দুর্বল হয়ে গেছে, তাদের স্বল্পমেয়াদী স্মৃতিশক্তি হ্রাস পেয়েছে এবং আরও উদ্বেগজনকভাবে, আচরণগত মূল্যায়নের স্কেলে তারা আরও "অনৈতিক" হয়ে উঠেছে।

কিছু পরিমাপে "মানসিক বিকৃতি"ও দেখা যায় যা ক্ষতিকারক বিষয়বস্তুর দীর্ঘক্ষণ সংস্পর্শে থাকার পর মানুষের মনস্তাত্ত্বিক প্রতিক্রিয়ার অনুকরণ করে। এটি এমন একটি ঘটনা যা মানুষের পূর্ববর্তী গবেষণার প্রতিধ্বনি করে যা দেখায় যে "ডুমস্ক্রোলিং" - অনলাইনে নেতিবাচক খবরের ক্রমাগত স্ক্রলিং - ধীরে ধীরে মস্তিষ্ককে ক্ষয় করতে পারে।

"মস্তিষ্কের পচন" শব্দটিকে অক্সফোর্ড অভিধান ২০২৪ সালের সেরা শব্দ হিসেবে বেছে নিয়েছে, যা ডিজিটাল জীবনে এই ঘটনার ব্যাপকতা প্রতিফলিত করে।

মিঃ হং এর মতে, এই আবিষ্কারটি এআই শিল্পের জন্য একটি গুরুতর সতর্কবার্তা, যেখানে অনেক কোম্পানি এখনও বিশ্বাস করে যে সোশ্যাল মিডিয়া ডেটা প্রশিক্ষণের সম্পদের একটি সমৃদ্ধ উৎস।

"ভাইরাল কন্টেন্টের মাধ্যমে প্রশিক্ষণ ডেটা বৃদ্ধিতে সাহায্য করতে পারে, কিন্তু এটি মডেলের যুক্তি, নীতিশাস্ত্র এবং মনোযোগকেও নীরবে নষ্ট করে দেয়," তিনি বলেন। আরও উদ্বেগের বিষয় হল, এই ধরণের নিম্নমানের ডেটা দ্বারা প্রভাবিত মডেলগুলি "পরিষ্কার" ডেটা দিয়ে পুনরায় প্রশিক্ষণ দেওয়ার পরেও সম্পূর্ণরূপে পুনরুদ্ধার করতে পারে না।

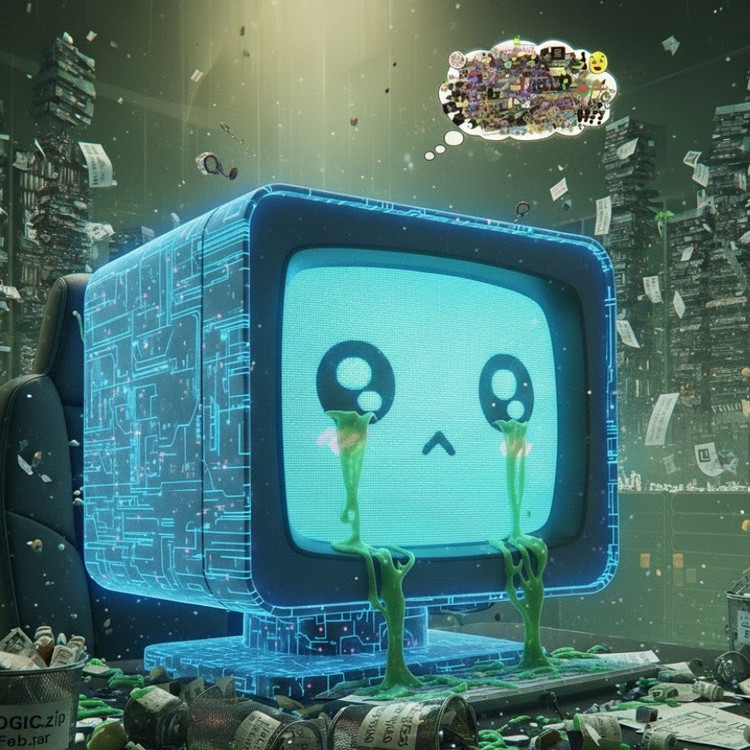

এটি একটি বড় সমস্যা তৈরি করছে কারণ AI নিজেই এখন সোশ্যাল নেটওয়ার্কগুলিতে আরও বেশি করে কন্টেন্ট তৈরি করছে। AI-উত্পাদিত পোস্ট, ছবি এবং মন্তব্যগুলি যত বেশি ব্যাপক হয়ে উঠছে, তারা পরবর্তী প্রজন্মের AI-এর জন্য প্রশিক্ষণের উপাদান হয়ে উঠতে থাকে, যা একটি দুষ্টচক্র তৈরি করে যা ডেটার মান হ্রাস করে।

"এআই-জেনারেটেড জাঙ্ক কন্টেন্ট ছড়িয়ে পড়ার সাথে সাথে, এটি ভবিষ্যতের মডেলগুলি যে ডেটা থেকে শিখবে তা দূষিত করে," হং সতর্ক করে দিয়েছিলেন। "একবার এই 'মস্তিষ্কের পচন' শুরু হয়ে গেলে, পরিষ্কার ডেটা দিয়ে পুনরায় প্রশিক্ষণ দেওয়া এটি সম্পূর্ণরূপে নিরাময় করতে পারে না।"

এই গবেষণাটি কৃত্রিম বুদ্ধিমত্তা বিকাশকারীদের জন্য এক সতর্কবার্তা বলে মনে হচ্ছে: বিশ্ব যখন তথ্যের পরিধি বাড়ানোর জন্য তাড়াহুড়ো করছে, তখন আরও উদ্বেগজনক বিষয় হল আমরা হয়তো "কৃত্রিম মস্তিষ্ক" লালন করছি যা ধীরে ধীরে পচে যাচ্ছে - তথ্যের অভাবের কারণে নয়, বরং অর্থহীন জিনিসের আধিক্যের কারণে।

সূত্র: https://khoahocdoisong.vn/den-ai-cung-bi-ung-nao-neu-luot-tiktok-qua-nhieu-post2149064017.html

![[ছবি] প্রধানমন্ত্রী ফাম মিন চিন বেসরকারি অর্থনৈতিক উন্নয়ন সংক্রান্ত স্টিয়ারিং কমিটির দ্বিতীয় বৈঠকে সভাপতিত্ব করছেন।](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/01/1762006716873_dsc-9145-jpg.webp)

মন্তব্য (0)