Πώς λειτουργούν οι ψεύτικες εικόνες τεχνητής νοημοσύνης;

Η Τεχνητή Νοημοσύνη είναι παντού στις μέρες μας – ακόμα και στον πόλεμο. Οι εφαρμογές τεχνητής νοημοσύνης έχουν βελτιωθεί τόσο πολύ φέτος που σχεδόν ο καθένας μπορεί να χρησιμοποιήσει γεννήτριες τεχνητής νοημοσύνης για να δημιουργήσει εικόνες που φαίνονται ρεαλιστικές, τουλάχιστον με την πρώτη ματιά.

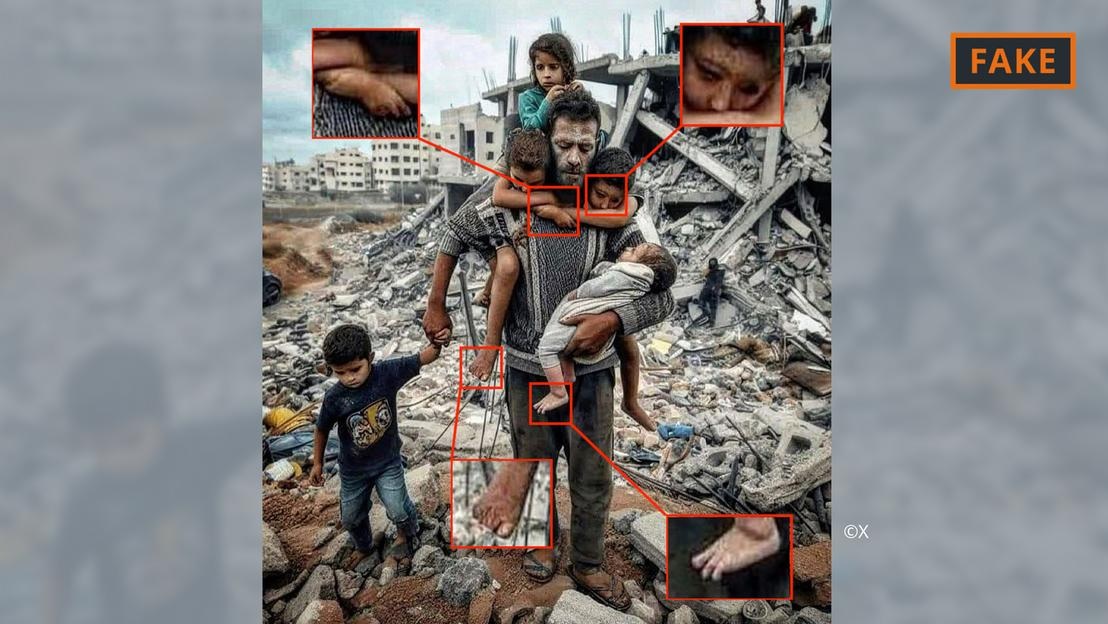

Μια ψεύτικη φωτογραφία του πολέμου στη Γάζα, δημιουργημένη από τεχνητή νοημοσύνη.

Οι χρήστες απλώς παρέχουν εργαλεία όπως το Midjourney ή το Dall-E με μερικές οδηγίες, συμπεριλαμβανομένων προδιαγραφών και πληροφοριών, για να το κάνουν αυτό. Τα εργαλεία τεχνητής νοημοσύνης στη συνέχεια μετατρέπουν τις οδηγίες κειμένου ή ακόμα και φωνητικών εντολών σε εικόνες.

Αυτή η διαδικασία δημιουργίας εικόνων βασίζεται σε αυτό που είναι γνωστό ως μηχανική μάθηση. Για παράδειγμα, εάν ένας δημιουργός ζητήσει να δείξει έναν 70χρονο άνδρα να κάνει ποδήλατο, θα αναζητήσει στη βάση δεδομένων του για να αντιστοιχίσει όρους με εικόνες.

Με βάση τις διαθέσιμες πληροφορίες, ο αλγόριθμος τεχνητής νοημοσύνης θα δημιουργήσει μια εικόνα του ηλικιωμένου ποδηλάτη. Με όλο και περισσότερα δεδομένα και τεχνικές ενημερώσεις, αυτά τα εργαλεία έχουν βελτιωθεί σημαντικά και μαθαίνουν συνεχώς.

Όλα αυτά εφαρμόζονται σε εικόνες που σχετίζονται με τη σύγκρουση στη Μέση Ανατολή. Σε μια σύγκρουση όπου «τα συναισθήματα είναι τόσο έντονα», η παραπληροφόρηση, συμπεριλαμβανομένης της διάδοσης μέσω εικόνων τεχνητής νοημοσύνης, έχει τεράστιο αντίκτυπο, λέει ο ειδικός στην τεχνητή νοημοσύνη, Χάνι Φαρίντ.

Ο Φαρίντ, καθηγητής ψηφιακής ανάλυσης στο Πανεπιστήμιο της Καλιφόρνια στο Μπέρκλεϊ, δήλωσε ότι οι σκληρές μάχες αποτελούν το ιδανικό έδαφος για τη δημιουργία και τη διάδοση ψεύτικου περιεχομένου, καθώς και για την τροφοδότηση συναισθημάτων.

Τύποι εικόνων τεχνητής νοημοσύνης του πολέμου Ισραήλ-Χαμάς

Εικόνες και βίντεο που δημιουργήθηκαν με τη βοήθεια της τεχνητής νοημοσύνης έχουν τροφοδοτήσει την παραπληροφόρηση σχετικά με τον πόλεμο στην Ουκρανία, και αυτό συνεχίζεται στον πόλεμο Ισραήλ-Χαμάς.

Σύμφωνα με τους ειδικούς, οι εικόνες τεχνητής νοημοσύνης που κυκλοφορούν στα μέσα κοινωνικής δικτύωσης σχετικά με τον πόλεμο συχνά εμπίπτουν σε δύο κατηγορίες. Η μία επικεντρώνεται στα βάσανα των ανθρώπων και προκαλεί συμπάθεια. Η άλλη είναι η ψεύτικη τεχνητή νοημοσύνη που υπερβάλλει στα γεγονότα, υποκινώντας έτσι συγκρούσεις και κλιμακώνοντας τη βία.

Ψεύτικη φωτογραφία πατέρα και παιδιού που δημιουργήθηκε από τεχνητή νοημοσύνη στα ερείπια στη Γάζα.

Για παράδειγμα, η πρώτη κατηγορία περιλαμβάνει την παραπάνω φωτογραφία ενός πατέρα και των πέντε παιδιών του μπροστά σε ένα σωρό από ερείπια. Κοινοποιήθηκε πολλές φορές στο X (πρώην Twitter) και στο Instagram και προβλήθηκε εκατοντάδες χιλιάδες φορές.

Αυτή η εικόνα έχει επισημανθεί από την κοινότητα, τουλάχιστον στο X, ως ψεύτικη. Μπορεί να αναγνωριστεί από διάφορα σφάλματα και ασυνέπειες που είναι κοινές στις εικόνες τεχνητής νοημοσύνης (δείτε την εικόνα παραπάνω).

Παρόμοιες ανωμαλίες μπορούν επίσης να παρατηρηθούν στην ψεύτικη εικόνα τεχνητής νοημοσύνης που έγινε viral στο X παρακάτω, η οποία υποτίθεται ότι δείχνει μια παλαιστινιακή οικογένεια να τρώει μαζί στα ερείπια.

Ψεύτικη φωτογραφία παλαιστινιακού πάρτι που δημιουργήθηκε από τεχνητή νοημοσύνη.

Εν τω μεταξύ, μια άλλη εικόνα που δείχνει στρατεύματα να κυματίζουν ισραηλινές σημαίες καθώς περνούν μέσα από έναν οικισμό γεμάτο με βομβαρδισμένα σπίτια εμπίπτει στη δεύτερη κατηγορία, η οποία έχει σχεδιαστεί για να υποκινήσει μίσος και βία.

Από πού προέρχονται τέτοιες εικόνες τεχνητής νοημοσύνης;

Οι περισσότερες εικόνες συγκρούσεων που δημιουργούνται από την Τεχνητή Νοημοσύνη δημοσιεύονται σε πλατφόρμες κοινωνικής δικτύωσης, αλλά είναι επίσης διαθέσιμες σε μια σειρά από άλλες πλατφόρμες και οργανισμούς, ακόμη και σε ορισμένους ειδησεογραφικούς ιστότοπους.

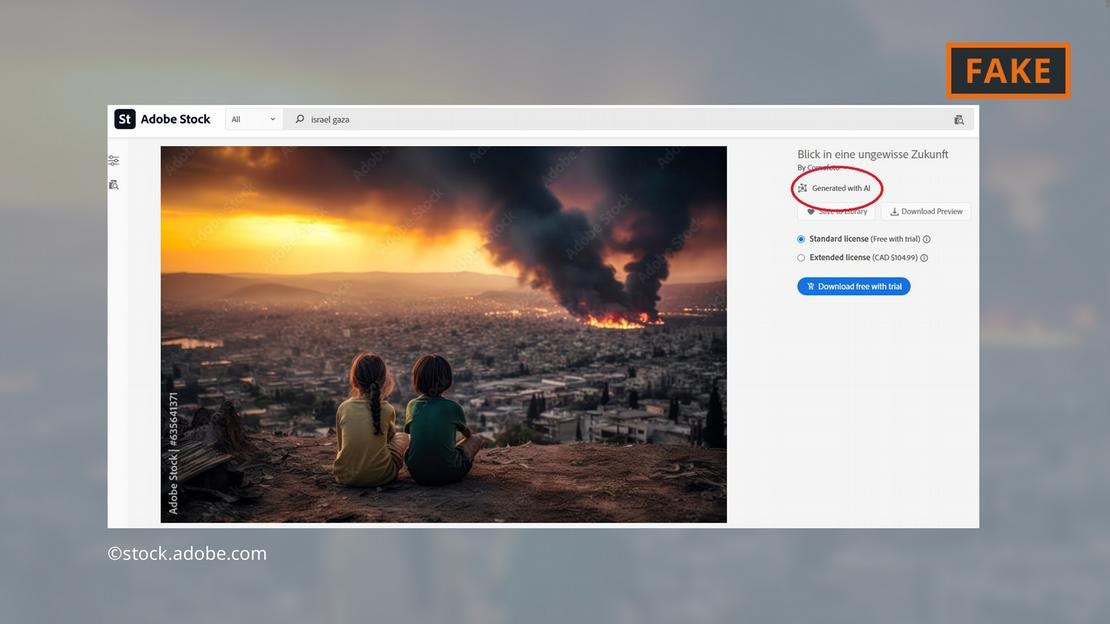

Η εταιρεία λογισμικού Adobe έχει γίνει πρωτοσέλιδο προσθέτοντας εικόνες που δημιουργούνται από τεχνητή νοημοσύνη στη συλλογή φωτογραφιών της μέχρι το τέλος του 2022. Θα επισημαίνονται ανάλογα στη βάση δεδομένων.

Η Adobe προσφέρει επίσης τώρα προς πώληση εικόνες τεχνητής νοημοσύνης από τον πόλεμο στη Μέση Ανατολή — όπως εκρήξεις, διαμαρτυρίες ανθρώπων ή σύννεφα καπνού πίσω από το Τζαμί Αλ-Άκσα.

Η Adobe προσφέρει εικόνες από τις μάχες στη Γάζα, οι οποίες έχουν δημιουργηθεί από τεχνητή νοημοσύνη.

Οι επικριτές το έχουν βρει αυτό ανησυχητικό, καθώς ορισμένοι ιστότοποι συνέχισαν να χρησιμοποιούν τις εικόνες χωρίς να τις χαρακτηρίζουν ως δημιουργημένες από τεχνητή νοημοσύνη. Η εν λόγω εικόνα, για παράδειγμα, εμφανίστηκε στη σελίδα "Newsbreak" χωρίς καμία ένδειξη ότι δημιουργήθηκε από τεχνητή νοημοσύνη.

Ακόμη και η Υπηρεσία Έρευνας του Ευρωπαϊκού Κοινοβουλίου, ο επιστημονικός βραχίονας του Ευρωπαϊκού Κοινοβουλίου, εικονογράφησε ένα διαδικτυακό κείμενο σχετικά με τη σύγκρουση στη Μέση Ανατολή με μια εικόνα τεχνητής νοημοσύνης από τη βάση δεδομένων της Adobe — χωρίς να την χαρακτηρίσει ως παραγόμενη από τεχνητή νοημοσύνη.

Το Ευρωπαϊκό Παρατηρητήριο Ψηφιακών Μέσων προτρέπει τους δημοσιογράφους και τους επαγγελματίες των μέσων ενημέρωσης να είναι εξαιρετικά προσεκτικοί όταν χρησιμοποιούν εικόνες τεχνητής νοημοσύνης, συμβουλεύοντας να μην τις χρησιμοποιούν, ειδικά όταν καλύπτουν πραγματικά γεγονότα, όπως ο πόλεμος στη Γάζα.

Πόσο επικίνδυνες είναι οι εικόνες με τεχνητή νοημοσύνη;

Το ιογενές περιεχόμενο και οι εικόνες τεχνητής νοημοσύνης είναι αναπόφευκτο να κάνουν τους χρήστες να αισθάνονται άβολα για οτιδήποτε συναντούν στο διαδίκτυο. «Αν φτάσουμε σε αυτόν τον κόσμο όπου οι εικόνες, ο ήχος και το βίντεο μπορούν να χειραγωγηθούν, όλα γίνονται ύποπτα», εξηγεί ο ερευνητής του UC Berkeley, Farid. «Έτσι, χάνετε την εμπιστοσύνη σας σε όλα, συμπεριλαμβανομένης της αλήθειας».

Αυτό ακριβώς συνέβη στην ακόλουθη περίπτωση: Μια εικόνα αυτού που πιστεύεται ότι είναι το απανθρακωμένο πτώμα ενός ισραηλινού μωρού κοινοποιήθηκε στα μέσα κοινωνικής δικτύωσης από τον Ισραηλινό πρωθυπουργό Μπενιαμίν Νετανιάχου και αρκετούς άλλους πολιτικούς.

Ένας αντι-ισραηλινός influencer, ο Jackson Hinkle, ισχυρίστηκε αργότερα ότι η εικόνα δημιουργήθηκε με τεχνητή νοημοσύνη. Η δήλωση του Hinkle προβλήθηκε περισσότερες από 20 εκατομμύρια φορές στα μέσα κοινωνικής δικτύωσης και οδήγησε σε έντονη συζήτηση στην πλατφόρμα.

Τελικά, πολυάριθμοι οργανισμοί και εργαλεία επαλήθευσης δήλωσαν ότι η εικόνα ήταν πραγματική και ο ισχυρισμός του Hinkle ψευδής. Ωστόσο, είναι σαφές ότι κανένα εργαλείο δεν μπορεί να βοηθήσει τους χρήστες να ανακτήσουν εύκολα την χαμένη τους εμπιστοσύνη!

Χοάνγκ Χάι (σύμφωνα με την DW)

[διαφήμιση_2]

Πηγή

Σχόλιο (0)