Ο τεχνολογικός γίγαντας OpenAI διαφημίζει το εργαλείο μετατροπής ομιλίας σε κείμενο, το Whisper, ως μια τεχνητή νοημοσύνη με «ανθρώπινη ακρίβεια και ανθεκτικότητα». Αλλά το Whisper είχε ένα σημαντικό ελάττωμα: Δημιουργούσε κείμενο και προτάσεις που ήταν εντελώς ψευδείς.

Μερικά από τα κείμενα που δημιουργούνται από την τεχνητή νοημοσύνη – που ονομάζονται «παραισθήσεις» – μπορεί να περιλαμβάνουν ρατσιστικά σχόλια, βίαιη γλώσσα, ακόμη και φανταστικές ιατρικές θεραπείες – Φωτογραφία: AP

Μερικά από τα κείμενα που δημιουργούνται από την τεχνητή νοημοσύνη είναι τα λεγόμενα «παραισθησιογόνα», λένε οι ειδικοί, σύμφωνα με το AP, συμπεριλαμβανομένων ρατσιστικών σχολίων, βίαιης γλώσσας, ακόμη και φανταστικών ιατρικών θεραπειών.

Υψηλό ποσοστό «ψευδαισθήσεων» σε κείμενα που δημιουργούνται από τεχνητή νοημοσύνη

Οι ειδικοί ανησυχούν ιδιαίτερα επειδή το Whisper χρησιμοποιείται ευρέως σε πολλούς κλάδους σε όλο τον κόσμο για τη μετάφραση και μεταγραφή συνεντεύξεων, τη δημιουργία κειμένου σε δημοφιλείς τεχνολογίες καταναλωτών και τη δημιουργία υπότιτλων για βίντεο.

Ακόμα πιο ανησυχητικό είναι ότι πολλά ιατρικά κέντρα χρησιμοποιούν το Whisper για τη μεταφορά συμβουλών μεταξύ γιατρών και ασθενών, αν και το OpenAI έχει προειδοποιήσει ότι το εργαλείο δεν πρέπει να χρησιμοποιείται σε περιοχές «υψηλού κινδύνου».

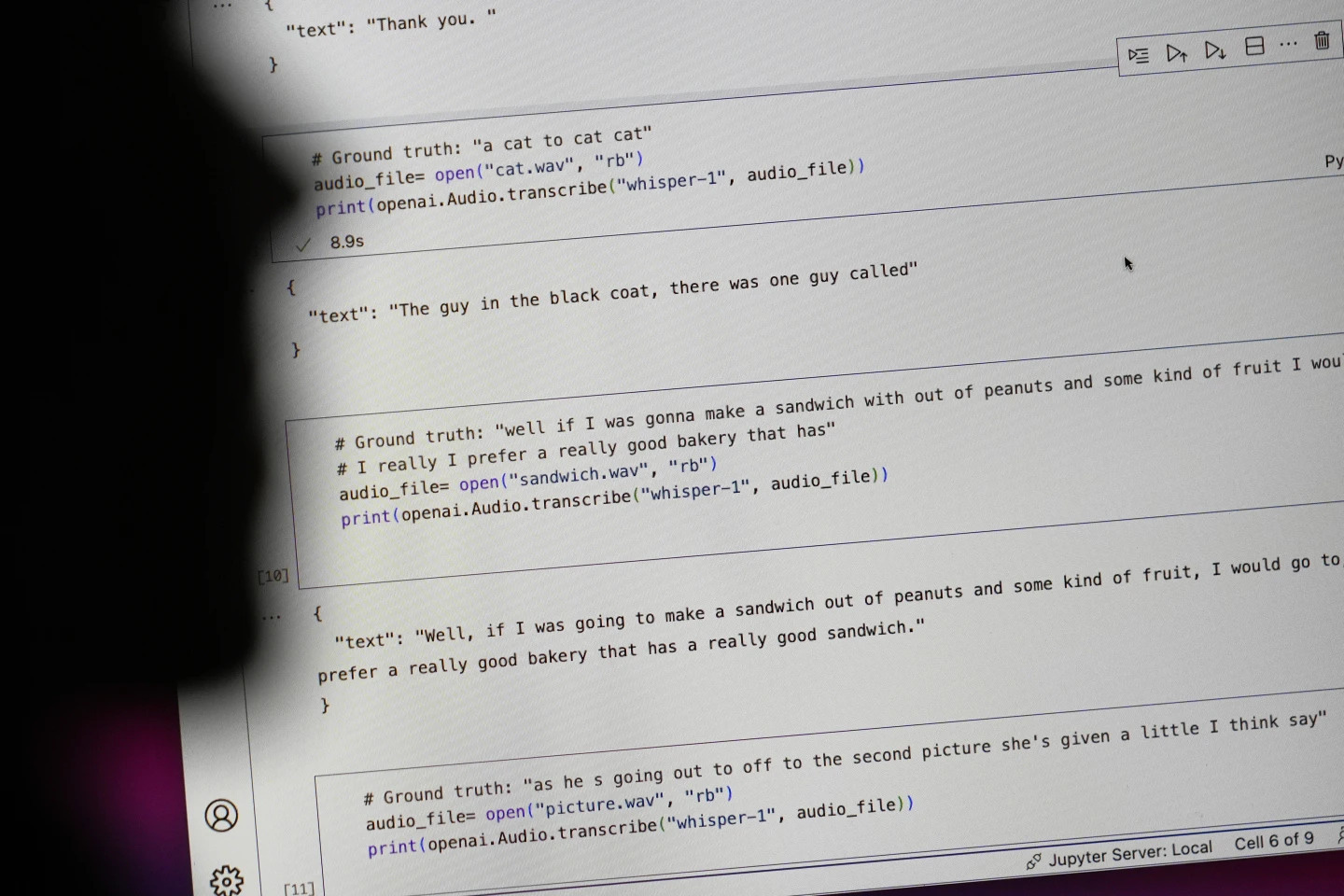

Η πλήρης έκταση του προβλήματος είναι δύσκολο να προσδιοριστεί, αλλά οι ερευνητές και οι μηχανικοί λένε ότι συναντούν τακτικά «παραισθήσεις» Whisper στην εργασία τους.

Ένας ερευνητής στο Πανεπιστήμιο του Μίσιγκαν δήλωσε ότι βρήκε «παραισθήσεις» σε οκτώ από τις δέκα ηχητικές μεταγραφές που εξέτασε. Ένας μηχανικός υπολογιστών βρήκε «παραισθήσεις» σε περίπου τις μισές από τις μεταγραφές περισσότερων από 100 ωρών ήχου που ανέλυσε. Ένας άλλος προγραμματιστής είπε ότι βρήκε «παραισθήσεις» σε σχεδόν όλες τις 26.000 ηχογραφήσεις που δημιούργησε χρησιμοποιώντας το Whisper.

Το πρόβλημα παραμένει ακόμη και με σύντομα, ευκρινώς ηχογραφημένα ηχητικά δείγματα. Μια πρόσφατη μελέτη από επιστήμονες υπολογιστών βρήκε 187 «ψευδαισθήσεις» σε περισσότερα από 13.000 καθαρά ηχητικά αποσπάσματα που εξέτασαν. Αυτή η τάση θα οδηγούσε σε δεκάδες χιλιάδες ψευδείς μεταγραφές σε εκατομμύρια ηχογραφήσεις, ανέφεραν οι ερευνητές.

Τέτοια λάθη μπορούν να έχουν «πολύ σοβαρές συνέπειες», ειδικά σε νοσοκομειακά περιβάλλοντα, σύμφωνα με την Αλόντρα Νέλσον, η οποία ηγήθηκε του Γραφείου Επιστήμης και Τεχνολογίας του Λευκού Οίκου κατά την κυβέρνηση Μπάιντεν μέχρι πέρυσι.

«Κανείς δεν θέλει μια λανθασμένη διάγνωση», δήλωσε ο Νέλσον, ο οποίος τώρα είναι καθηγητής στο Ινστιτούτο Προηγμένων Σπουδών στο Πρίνστον του Νιου Τζέρσεϊ. «Πρέπει να υπάρχει υψηλότερο πρότυπο».

Το Whisper χρησιμοποιείται επίσης για τη δημιουργία λεζάντων για κωφούς και βαρήκοους—έναν πληθυσμό που διατρέχει ιδιαίτερο κίνδυνο λανθασμένων μεταφράσεων. Αυτό συμβαίνει επειδή οι κωφοί και βαρήκοοι δεν έχουν τρόπο να εντοπίσουν κατασκευασμένα αποσπάσματα «κρυμμένα σε όλα τα άλλα κείμενα», λέει ο Christian Vogler, κωφός και διευθυντής του Προγράμματος Προσβασιμότητας Τεχνολογίας στο Πανεπιστήμιο Gallaudet.

Το OpenAI καλείται να λύσει το πρόβλημα

Η επικράτηση τέτοιων «παραισθήσεων» έχει οδηγήσει ειδικούς, υποστηρικτές και πρώην υπαλλήλους της OpenAI να καλέσουν την ομοσπονδιακή κυβέρνηση να εξετάσει το ενδεχόμενο κανονισμών για την Τεχνητή Νοημοσύνη. Τουλάχιστον, η OpenAI πρέπει να αντιμετωπίσει αυτό το ελάττωμα.

«Αυτό το πρόβλημα είναι επιλύσιμο εάν η εταιρεία είναι πρόθυμη να το δώσει προτεραιότητα», δήλωσε ο William Saunders, ερευνητής μηχανικός στο Σαν Φρανσίσκο, ο οποίος έφυγε από την OpenAI τον Φεβρουάριο λόγω ανησυχιών σχετικά με την κατεύθυνση της εταιρείας.

«Θα ήταν πρόβλημα αν το θέσετε σε κυκλοφορία και οι άνθρωποι νιώσουν τόσο σίγουροι για τις δυνατότητές του που θα το ενσωματώσουν σε όλα αυτά τα άλλα συστήματα». Ένας εκπρόσωπος της OpenAI δήλωσε ότι η εταιρεία εργάζεται συνεχώς για τρόπους μετριασμού των «ψευδαισθήσεων» και εκτιμά τα ευρήματα των ερευνητών, προσθέτοντας ότι η OpenAI ενσωματώνει τα σχόλια στις ενημερώσεις μοντέλων.

Ενώ οι περισσότεροι προγραμματιστές υποθέτουν ότι τα εργαλεία μετατροπής κειμένου σε ομιλία μπορούν να κάνουν τυπογραφικά λάθη ή άλλα λάθη, οι μηχανικοί και οι ερευνητές λένε ότι δεν έχουν ξαναδεί ένα εργαλείο μετατροπής κειμένου σε ομιλία με τεχνητή νοημοσύνη που να «παραισθάνεται» τόσο πολύ όσο το Whisper.

Βραβείο Νόμπελ Φυσικής 2024: Οι άνθρωποι που έθεσαν τα θεμέλια της Τεχνητής Νοημοσύνης

Βραβείο Νόμπελ Φυσικής 2024: Οι άνθρωποι που έθεσαν τα θεμέλια της Τεχνητής Νοημοσύνης[διαφήμιση_2]

Πηγή: https://tuoitre.vn/cong-cu-ai-chuyen-loi-noi-thanh-van-ban-cua-openai-bi-phat-hien-bia-chuyen-20241031144507089.htm

![[INFOGRAPHIC] Πορτρέτο του νεοεκλεγέντα Προέδρου του Καμερούν σε ηλικία 92 ετών](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/08/1762560057791_info-tongthong-cameroon-anh-thumb-jpg.webp)

![[Βίντεο] Τα μνημεία του Χουέ ανοίγουν ξανά για να υποδεχτούν τους επισκέπτες](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

Σχόλιο (0)