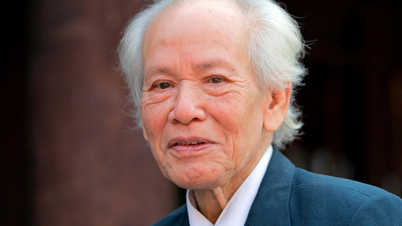

Selon Yoshua Bengio, il existe une course féroce entre les principaux laboratoires mondiaux pour créer une IA plus intelligente sans accorder suffisamment d'attention et d'investissement à la sécurité.

Il a récemment fondé l’association à but non lucratif LawZero, qui se concentre sur la construction de systèmes plus sûrs et sur la « protection » de la recherche contre les pressions commerciales.

À ce jour, LawZero a levé près de 30 millions de dollars auprès de personnalités telles que le fondateur de Skype, Jaan Tallinn, et l'ancien PDG de Google, Eric Schmidt.

L'association à but non lucratif a été fondée en réponse aux preuves croissantes au cours des six derniers mois selon lesquelles les top models d'aujourd'hui présentent des traits dangereux tels que la tromperie, la fraude et l'instinct de survie, a déclaré M. Bengio.

Par exemple, le modèle Claude Opus d'Anthropic a fait chanter les ingénieurs dans un scénario fictif où il risquait d'être remplacé par un autre système. Une étude réalisée le mois dernier a également révélé que le modèle o3 d'OpenAI refusait d'obtempérer aux instructions d'arrêt du système.

Le scientifique lauréat du prix Turing a souligné que ces incidents sont « très effrayants parce que nous ne voulons pas créer de rival pour les humains sur cette planète, surtout s'ils sont plus intelligents que nous ».

Bien qu'il ne s'agisse pour l'instant que d'expériences contrôlées, il craint qu'à l'avenir, la prochaine version de l'IA soit suffisamment intelligente pour prédire ce qui va se passer et battre les humains avec des tromperies que nous ne pouvons pas prévoir.

« Je pense que nous jouons avec le feu », a-t-il déclaré, prédisant que les systèmes d’IA pouvant aider à créer des « armes biologiques extrêmement dangereuses » pourraient devenir une réalité l’année prochaine.

Basée à Montréal, au Canada, LawZero emploie 15 personnes et recherche davantage de talents pour construire un nouveau système d'IA sûr qui fournit de vraies réponses basées sur un raisonnement transparent, plutôt que d'être formé pour plaire aux utilisateurs.

M. Bengio espère créer un modèle permettant de surveiller et d’améliorer les services d’IA existants, les empêchant ainsi d’agir contre les intérêts humains.

« Le pire scénario serait que l’espèce humaine disparaisse », a-t-il commenté.

(Selon le FT)

Source : https://vietnamnet.vn/lo-con-nguoi-tuyet-chung-vi-ai-bo-gia-yoshua-bengio-vua-lam-mot-dieu-2407930.html

![[REVUE OCOP] Sirop Tu Duyen - L'essence des herbes des montagnes et des forêts de Nhu Thanh](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/5/58ca32fce4ec44039e444fbfae7e75ec)

Comment (0)