Après le lancement par la startup OpenAI de sa première application d'IA, ChatGPT, fin 2022, une vague de développement d'applications d'IA, notamment d'IA générative, s'est déclenchée, apportant de nombreux avantages à tous les aspects de la vie. Cependant, cela comporte également de nombreux risques.

Atteinte à la vie privée

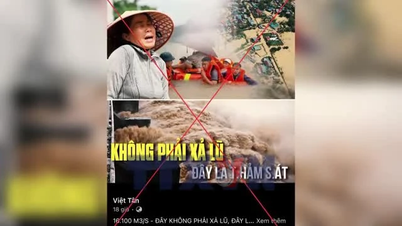

Ces dernières années, de nombreuses organisations et personnes ont subi des pertes considérables, victimes de cybercriminels ayant utilisé l'IA pour créer de fausses vidéos imitant l'image et la voix de personnes réelles. L'escroquerie Deepfake, qui consiste à tromper la victime en lui faisant croire qu'elle est réelle, en est un exemple flagrant.

Selon le rapport sur la fraude d'identité publié par Sumsub fin novembre 2023, les escroqueries par deepfake ont décuplé dans le monde entier au cours des deux années comprises entre 2022 et 2023. C'est également durant cette période que les applications générées par l'IA ont connu une explosion mondiale .

Status Labs souligne que la technologie Deepfake a un impact considérable sur la culture, la vie privée et la réputation personnelle. L'actualité et l'attention médiatique autour des Deepfakes se concentrent principalement sur la pornographie de célébrités, les contenus à visée vengeresse, la désinformation, les fausses nouvelles, le chantage et les escroqueries. Par exemple, en 2019, une entreprise énergétique américaine a été victime d'une fraude de 243 000 $ : des pirates informatiques se sont fait passer pour les dirigeants de l'entreprise et ont imité leurs voix, exigeant des employés qu'ils transfèrent de l'argent à des partenaires.

Reuters a rapporté qu'en 2023, environ 500 000 fichiers vidéo et audio truqués (deepfakes) ont été partagés sur les réseaux sociaux à travers le monde. Outre les deepfakes créés à des fins ludiques, il existe également des escroqueries conçues par des personnes malveillantes pour tromper le public. Certaines sources indiquent qu'en 2022, les escroqueries liées aux deepfakes ont causé des pertes estimées à 11 millions de dollars à l'échelle mondiale.

De nombreux experts en technologies ont mis en garde contre les inconvénients de l'IA, notamment les problèmes de droits de propriété intellectuelle et d'authenticité, ainsi que les litiges en matière de propriété intellectuelle entre les « œuvres » créées par l'IA. Par exemple, une personne pourrait utiliser l'IA pour peindre un tableau sur un sujet donné, et une autre personne pourrait également utiliser l'IA pour réaliser la même œuvre, ce qui donnerait lieu à des tableaux présentant de nombreuses similitudes.

Cela peut facilement engendrer des litiges en matière de propriété intellectuelle. Or, à ce jour, la communauté internationale n'a pas encore tranché sur la question de la reconnaissance du droit d'auteur pour les contenus générés par l'IA (qu'il s'agisse des droits d'auteur accordés aux particuliers commanditaires de créations par l'IA ou aux entreprises développant des applications d'IA).

Image créée par une application d'IA.

Il est difficile de faire la différence entre le vrai et le faux.

Le contenu généré par l'IA peut-il enfreindre le droit d'auteur ? Techniquement, ce contenu est synthétisé par des algorithmes à partir de données sur lesquelles ils ont été entraînés. Ces bases de données sont collectées par les développeurs d'applications d'IA auprès de diverses sources, principalement l'immense base de connaissances disponible sur Internet. Nombre de ces œuvres sont déjà protégées par le droit d'auteur.

Le 27 décembre 2023, le New York Times a porté plainte contre OpenAI (via ChatGPT) et Microsoft, les accusant d'avoir utilisé des millions de ses articles pour entraîner des chatbots et des plateformes d'intelligence artificielle développés par ces deux entreprises. Parmi les preuves présentées figuraient des contenus générés par les chatbots à la demande des utilisateurs, similaires ou identiques à ceux des articles. Le journal ne pouvait ignorer que sa propriété intellectuelle était exploitée à des fins lucratives par ces sociétés.

Le New York Times est le premier grand quotidien américain à intenter une action en justice pour violation de droits d'auteur liée à l'intelligence artificielle. Il est possible que d'autres journaux fassent de même à l'avenir, notamment après le succès du New York Times dans cette affaire.

Auparavant, OpenAI avait conclu des accords de licence avec Associated Press en juillet 2023 et avec Axel Springer – l’éditeur allemand propriétaire de Politico et Business Insider – en décembre 2023.

L'actrice Sarah Silverman a également été impliquée dans plusieurs procès en juillet 2023, accusant Meta et OpenAI d'avoir utilisé ses mémoires comme matériel d'entraînement pour leurs programmes d'intelligence artificielle. De nombreux écrivains ont également exprimé leur inquiétude suite aux révélations selon lesquelles les systèmes d'IA ont intégré des dizaines de milliers de livres dans leurs bases de données, ce qui a conduit à des poursuites judiciaires de la part d'auteurs tels que Jonathan Franzen et John Grisham.

Parallèlement, Getty Images, une société de services photographiques, a également intenté un procès à une société d'intelligence artificielle pour avoir créé des images à partir de consignes textuelles, prétendument en utilisant sans autorisation le matériel photographique protégé par le droit d'auteur de la société.

Les utilisateurs peuvent rencontrer des problèmes de droits d'auteur s'ils utilisent de manière imprudente des « œuvres » qu'ils ont commandées à l'aide d'outils d'IA. Les experts recommandent systématiquement d'utiliser ces outils uniquement à des fins de recherche, de collecte de données et de suggestions de référence.

Par ailleurs, les applications d'IA peuvent induire les utilisateurs en erreur en rendant difficile la distinction entre contenu authentique et contenu contrefait. Les éditeurs et les rédactions peuvent être déconcertés à la réception de manuscrits. Les enseignants ont également du mal à savoir si les travaux de leurs élèves ont eu recours à l'IA.

La communauté devra désormais redoubler de vigilance, car il est difficile de distinguer le vrai du faux. Par exemple, il sera difficile pour le commun des mortels de détecter si une photo a été manipulée ou retouchée par une intelligence artificielle.

Une réglementation juridique est nécessaire concernant l'utilisation de l'IA.

En attendant la mise au point d'outils capables de détecter les interventions de l'IA, les organismes de réglementation doivent établir un cadre juridique clair et précis concernant l'utilisation de cette technologie pour la création de contenus originaux. Ce cadre devrait indiquer clairement au public quels contenus ou œuvres ont été manipulés par l'IA, par exemple en apposant systématiquement un filigrane sur les images traitées par IA.

Source : https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[Photo] Le Premier ministre Pham Minh Chinh participe à la Conférence sur la mise en œuvre des objectifs du secteur de l'industrie et du commerce pour 2026](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

![[INFOGRAPHIE] Legion Go Gen 2 établit une nouvelle norme pour le jeu vidéo.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/19/1766146888809_info-taycamgames-02-jpg.webp)

Comment (0)