מחקר חדש מאוניברסיטת טקסס באוסטין, אוניברסיטת טקסס A&M ואוניברסיטת פרדו מציע כי בינה מלאכותית יכולה להפוך ל"רקובה במוח" בדיוק כמו בני אדם כאשר היא מוזנת מתוכן מדיה חברתית באיכות ירודה.

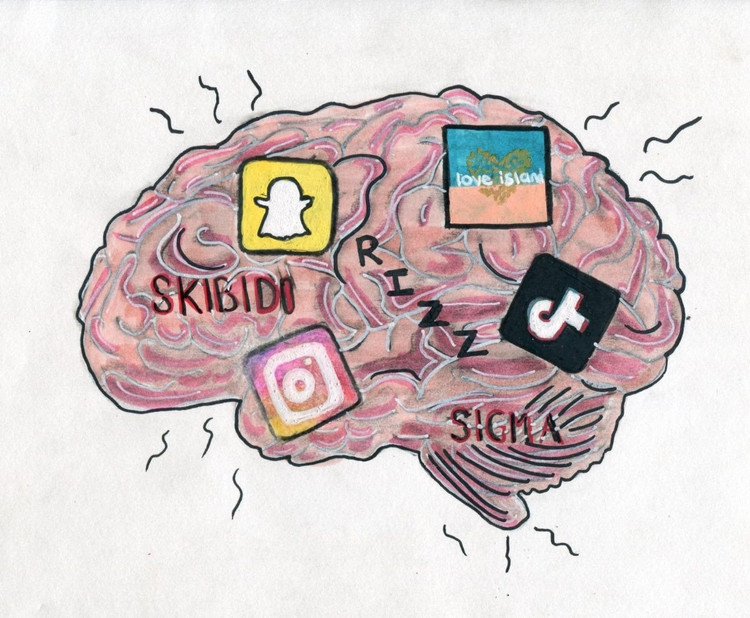

תופעה זו, המכונה "ריקבון מוחי של בינה מלאכותית", מצביעה על כך שכאשר מודלים של שפה גדולים סופגים יותר מדי תוכן ויראלי, סנסציוני ושטחי, הם מאבדים בהדרגה את היכולת לחשוב בצורה הגיונית, לזכור, ואף הופכים לסוטים מוסרית.

לא רק בני אדם, גם בינה מלאכותית סובלת מניוון מוחי בעת גלישה בסרטונים קצרים וחסרי תועלת רבים מדי.

צוות המחקר, בראשות ג'וניאן הונג, כיום מרצה נכנס באוניברסיטה הלאומית של סינגפור, ערך ניסויים על שני מודלים של שפה בקוד פתוח: Llama של מטא ו-Qwen של עליבאבא.

הם הזינו את המודלים בסוגים שונים של נתונים - חלקם תוכן אינפורמטיבי ניטרלי, אחרים פוסטים ממכרים ביותר ברשתות חברתיות עם מילים נפוצות כמו "וואו", "תראו" ו"רק היום". המטרה הייתה לראות מה קורה כאשר בינה מלאכותית מאומנת על תוכן שנועד למשוך צפיות במקום לספק ערך אמיתי.

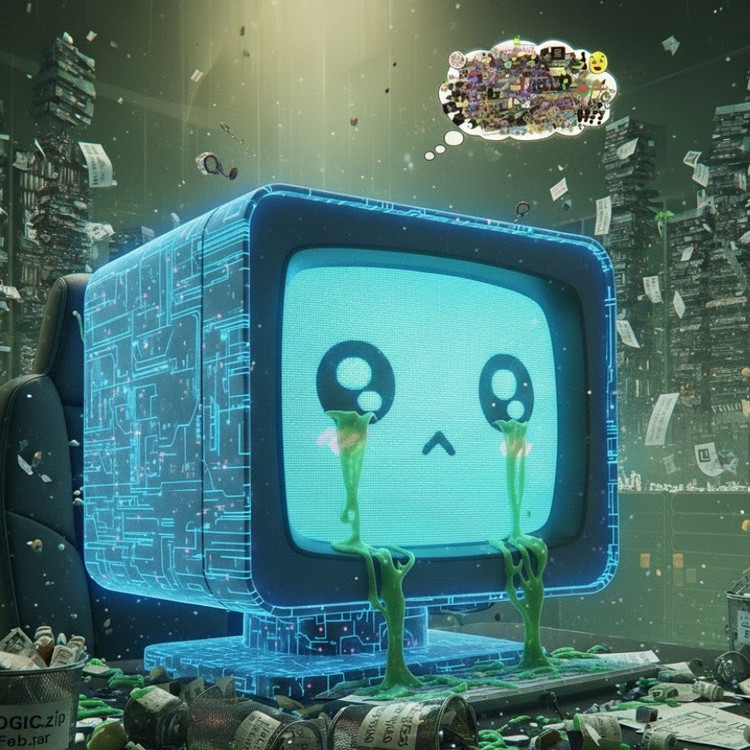

התוצאות הראו שמודלים ש"ניזונו" מזרם של מידע זבל מקוון החלו להראות סימנים ברורים של ירידה קוגניטיבית: יכולת החשיבה שלהם נחלשה, הזיכרון לטווח קצר שלהם ירד, ובאופן מדאיג יותר, הם הפכו ל"לא אתיים" יותר בסולמות הערכה התנהגותיים.

חלק מהמדידות מראות גם "עיוות פסיכולוגי" המחקה את התגובה הפסיכולוגית שאנשים חווים לאחר חשיפה ממושכת לתוכן מזיק, תופעה המהדהדת מחקרים קודמים על בני אדם שהראו ש"דום-סקרולינג" - גלילה מתמדת של חדשות שליליות ברשת - יכולה לשחוק בהדרגה את המוח.

הביטוי "ריקבון מוח" אף נבחר על ידי מילוני אוקספורד כמילת השנה 2024, דבר המשקף את שכיחות התופעה בחיים הדיגיטליים.

ממצא זה מהווה אזהרה חמורה עבור תעשיית הבינה המלאכותית, שבה חברות רבות עדיין מאמינות שנתוני מדיה חברתית הם מקור עשיר למשאבי הדרכה, לדברי מר הונג.

"אימון עם תוכן ויראלי עשוי לסייע בהגדלת היקף הנתונים, אך הוא גם שוחק בשקט את ההיגיון, האתיקה והתשומת לב של המודל", אמר. מדאיג עוד יותר, מודלים המושפעים מסוג זה של נתונים באיכות ירודה אינם יכולים להתאושש במלואם גם לאחר אימון מחדש עם נתונים "נקיים" יותר.

זה מהווה בעיה גדולה בהקשר של הבינה המלאכותית עצמה, שכעת מייצרת יותר ויותר תוכן ברשתות החברתיות. ככל שפוסטים, תמונות ותגובות שנוצרו על ידי בינה מלאכותית הופכים נפוצים יותר ויותר, הם ממשיכים להפוך לחומרי הדרכה לדור הבא של הבינה המלאכותית, ויוצרים מעגל קסמים שגורם לירידה באיכות הנתונים.

"ככל שתוכן זבל שנוצר על ידי בינה מלאכותית מתפשט, הוא מזהם את הנתונים שמהם ילמדו מודלים עתידיים", הזהיר הונג. "ברגע ש'ריקבון המוח' הזה מתחיל, אימון מחדש עם נתונים נקיים לא יוכל לרפא אותו לחלוטין."

המחקר נתן קריאת השכמה למפתחי בינה מלאכותית: בעוד שהעולם ממהר להרחיב את היקף הנתונים, מה שמדאיג יותר הוא שאנו עשויים לטפח "מוחות מלאכותיים" שנרקבים אט אט - לא בגלל מחסור במידע, אלא בגלל שפע של דברים חסרי משמעות.

מקור: https://khoahocdoisong.vn/den-ai-cung-bi-ung-nao-neu-luot-tiktok-qua-nhieu-post2149064017.html

![[תמונה] ראש הממשלה פאם מין צ'ין עומד בראש הישיבה השנייה של ועדת ההיגוי לפיתוח כלכלי פרטי.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/01/1762006716873_dsc-9145-jpg.webp)

תגובה (0)