לאחר שהסטארט-אפ OpenAI השיק את אפליקציית הבינה המלאכותית הראשונה שלו, ChatGPT, בסוף 2022, הופעל גל של פיתוח אפליקציות בינה מלאכותית, ובמיוחד בינה מלאכותית גנרטיבית, שהביא יתרונות רבים לכל תחומי החיים. עם זאת, הדבר טומן בחובו גם סיכונים רבים.

פגיעה בפרטיות

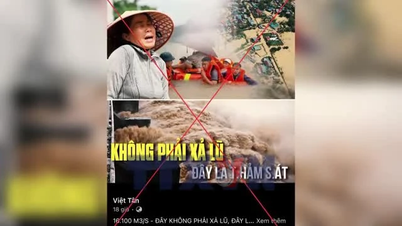

בשנים האחרונות, ארגונים ואנשים פרטיים רבים ספגו הפסדים משמעותיים לאחר שפושעי סייבר השתמשו בבינה מלאכותית כדי ליצור סרטוני וידאו מזויפים המחקים את התמונות והקולות של אנשים אמיתיים. דוגמה בולטת לכך היא הונאת Deepfake, הכוללת הטעיה של אדם אמיתי ולגרום לו להאמין שהוא אמיתי.

על פי דוח הונאות הזהות שפורסם על ידי Sumsub בסוף נובמבר 2023, הונאות דיפפייק ברחבי העולם גדלו פי עשרה בשנתיים שבין 2022 ל-2023. זו הייתה גם התקופה שבה יישומים שנוצרו על ידי בינה מלאכותית התפוצצו ברחבי העולם .

סטטוס לאבס מציינת כי טכנולוגיית דיפפייק השפיעה באופן משמעותי על התרבות, הפרטיות והמוניטין האישי. חלק ניכר מהחדשות ותשומת הלב סביב דיפפייק התמקד בפורנוגרפיה של ידוענים, תוכן נקמה, מידע שגוי, חדשות כוזבות, סחיטה והונאות. לדוגמה, בשנת 2019, חברת אנרגיה אמריקאית הונאה בסכום של 243,000 דולר על ידי האקרים שהתחזו למנהיגי החברה ולקולם, ודרשו מעובדים להעביר כסף לשותפים.

רויטרס דיווחה כי בשנת 2023, כ-500,000 קבצי וידאו ואודיו מסוג Deepfake שותפו ברשתות החברתיות ברחבי העולם. מלבד Deepfakes שנוצרו להנאה, ישנן גם הונאות שנועדו על ידי גורמים זדוניים כדי להונות את הציבור. מקורות מסוימים מצביעים על כך שבשנת 2022, הונאות Deepfake ברחבי העולם גרמו להפסדים של כ-11 מיליון דולר.

מומחי טכנולוגיה רבים הזהירו מפני חסרונותיה של בינה מלאכותית, כולל סוגיות של זכויות קניין רוחני ואותנטיות, ויתרה מכך, סכסוכי קניין רוחני בין "יצירות" שנוצרו על ידי בינה מלאכותית. לדוגמה, מישהו עשוי להשתמש בבינה מלאכותית כדי לצייר תמונה על נושא מסוים, ואדם אחר עשוי גם הוא להשתמש בבינה מלאכותית כדי לעשות את אותו הדבר, וכתוצאה מכך נוצרות ציורים בעלי קווי דמיון רבים.

זה מוביל בקלות לסכסוכי בעלות. עם זאת, עד היום, העולם טרם החליט על הכרה בזכויות יוצרים עבור תוכן שנוצר על ידי בינה מלאכותית (הכרה בזכויות יוצרים עבור אנשים פרטיים המזמינים יצירה של תוכן באמצעות בינה מלאכותית או עבור חברות המפתחות יישומי בינה מלאכותית).

תמונה שנוצרה על ידי אפליקציית בינה מלאכותית.

קשה להבחין בין אמיתי למזויף.

אז, האם תוכן שנוצר על ידי בינה מלאכותית יכול להפר זכויות יוצרים? מבחינה טכנולוגית, תוכן שנוצר על ידי בינה מלאכותית מסונתז על ידי אלגוריתמים מנתונים עליהם הם אומנו. מאגרי מידע אלה נאספים על ידי מפתחי יישומי בינה מלאכותית ממקורות שונים, בעיקר מבסיס הידע העצום באינטרנט. רבות מהיצירות הללו כבר מוגנות בזכויות יוצרים לבעליהן.

ב-27 בדצמבר 2023, הגיש הניו יורק טיימס תביעה נגד OpenAI (יחד עם ChatGPT) ומיקרוסופט, בטענה כי מיליוני מאמרים שלו שימשו לאימון צ'אטבוטים מבוססי בינה מלאכותית ופלטפורמות בינה מלאכותית משתי חברות אלו. הראיות שהוצגו כללו תוכן שנוצר על ידי הצ'אטבוטים לבקשת המשתמש, שהיה דומה או זהה לתוכן המאמרים. העיתון לא יכול היה להתעלם מהעובדה שקניינו הרוחני שימש את חברות אלו למטרות רווח.

הניו יורק טיימס הוא העיתון האמריקאי הגדול הראשון שהגיש תביעה בגין זכויות יוצרים הקשורה לבינה מלאכותית. ייתכן שעיתונים אחרים יתבעו גם הם בעתיד, במיוחד לאחר הצלחת התביעה של הניו יורק טיימס.

בעבר, OpenAI הגיעה להסכמי רישוי עם Associated Press ביולי 2023 ועם Axel Springer - המו"ל הגרמני שבבעלותו Politico ו-Business Insider - בדצמבר 2023.

השחקנית שרה סילברמן הייתה מעורבת גם במספר תביעות משפטיות ביולי 2023, בטענה כי Meta ו-OpenAI השתמשו בספר הזיכרונות שלה כחומר הדרכה לתוכניות בינה מלאכותית. סופרים רבים הביעו גם דאגה בעקבות גילויים לפיהם מערכות בינה מלאכותית קלטו עשרות אלפי ספרים למאגרי המידע שלהן, מה שהוביל לתביעות משפטיות מצד סופרים כמו ג'ונתן פרנזן וג'ון גרישם.

בינתיים, חברת Getty Images, חברה המציעה שירותי צילום, תבעה גם חברת בינה מלאכותית על יצירת תמונות המבוססות על הנחיות טקסט, לכאורה באמצעות שימוש בלתי מורשה בחומר תמונה המוגן בזכויות יוצרים של החברה.

משתמשים עלולים להיתקל בבעיות זכויות יוצרים כאשר הם משתמשים "ברשלנות" ב"יצירות" שהזמינו מכלי בינה מלאכותית. מומחים תמיד ממליצים להשתמש בכלי בינה מלאכותית רק למחקר, איסוף נתונים והצעות למטרות עיון.

בנושא נוסף, יישומי בינה מלאכותית מבלבלים משתמשים בכך שהם מקשיים על ההבחנה בין תוכן אמיתי למזויף. מו"לים וחדרי חדשות עשויים להיות מבולבלים כאשר הם מקבלים כתבי יד. מורים גם מתמודדים עם קשיים בידיעה האם עבודתם של תלמידים השתמשה בבינה מלאכותית.

כעת הקהילה תצטרך להיות ערנית יותר משום שקשה להבחין בין תוכן אמיתי לתוכן מזויף. לדוגמה, יהיה קשה לאדם הממוצע לזהות אם תמונה עברה מניפולציה או עריכה על ידי בינה מלאכותית.

יש צורך בתקנות משפטיות בנוגע לשימוש בבינה מלאכותית.

בזמן ההמתנה לפיתוח כלים המסוגלים לזהות הפרעות של בינה מלאכותית, גופי רגולציה צריכים לקבוע תקנות משפטיות ברורות וספציפיות בנוגע לשימוש בטכנולוגיה זו ליצירת תוכן מקורי. תקנות אלו צריכות לציין בבירור לציבור אילו תוכן או יצירות עברו מניפולציה על ידי בינה מלאכותית, למשל, הוספת סימן מים כברירת מחדל לתמונות שעובדו על ידי בינה מלאכותית.

[מודעה_2]

מקור: https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[תמונה] ראש הממשלה פאם מין צ'ין משתתף בוועידה בנושא יישום משימות לשנת 2026 של מגזר התעשייה והמסחר](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

![[אינפוגרפיקה] Legion Go Gen 2 קובע סטנדרט חדש לגיימינג.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/19/1766146888809_info-taycamgames-02-jpg.webp)

תגובה (0)