जब कृत्रिम बुद्धिमत्ता (एआई) प्रणालियों की बात आती है, तो कई लोगों के मन में तुरंत ऐसे बेतुके सॉफ़्टवेयर का ख्याल आता है जिनमें भावनाएँ नहीं होतीं या जो सिर्फ़ उपयोगकर्ताओं को खुश करने के लिए भावनाएँ पैदा करने की कोशिश करते हैं। हालाँकि, यह संभावना है कि भविष्य में, वास्तविक भावनाओं और मनुष्यों को समझने की क्षमता वाला एक एआई सिस्टम जन्म लेगा।

तदनुसार, एरिक ज़ेलिकमैन - एक प्रमुख एआई विशेषज्ञ, जिन्होंने पिछले सितंबर में xAI (एलोन मस्क द्वारा स्थापित एआई कंपनी) को छोड़ दिया था - ने खुद ज़ेलिकमैन द्वारा स्थापित स्टार्टअप, ह्यूमन एंड के लिए निवेश पूंजी में $ 1 बिलियन जुटाए हैं।

हालांकि इसकी स्थापना कुछ समय पहले ही हुई है, लेकिन अब इसका मूल्य 4 बिलियन अमेरिकी डॉलर है।

क्या भावनात्मक कृत्रिम बुद्धिमत्ता मनुष्यों को लाभ पहुंचाएगी या हानि पहुंचाएगी? (चित्रण: एआई)।

ह्यूमन एंड का लक्ष्य ऐसे कृत्रिम बुद्धिमत्ता मॉडल विकसित करने पर ध्यान केंद्रित करना है जो उपयोगकर्ताओं से सीख सकें, सहानुभूति दिखाने के लिए भावनाएँ रख सकें और लोगों को बेहतर ढंग से समझ सकें। ह्यूमन एंड वर्तमान एआई मॉडलों की सीमाओं को दूर करना चाहता है, जिन्हें बहुत ही ठंडा और यांत्रिक माना जाता है।

1988 में जन्मे एरिक ज़ेलिकमैन स्टैनफोर्ड विश्वविद्यालय में पीएचडी के छात्र थे। ज़ेलिकमैन को आज एआई के क्षेत्र में सबसे प्रतिभाशाली नामों में से एक माना जाता है। 2024 में xAI में कृत्रिम बुद्धिमत्ता विकास विशेषज्ञों की टीम में शामिल होने से पहले, ज़ेलिकमैन ने माइक्रोसॉफ्ट में काम किया था।

एरिक ज़ेलिकमैन ने तकनीकी जगत का ध्यान तब आकर्षित किया जब उन्होंने एक अध्ययन प्रकाशित किया जिसमें बताया गया कि किस प्रकार एआई मॉडल उपयोगकर्ताओं को प्रतिक्रिया देने से पहले स्वयं सोचना सीख सकते हैं।

ज़ेलिकमैन ने एक बार कहा था कि आजकल के एआई मॉडल बहुत ही ठंडे और यांत्रिक हैं और वह इसे बदलना चाहते थे। इसलिए, ज़ेलिकमैन ने ह्यूमन एंड की स्थापना की ताकि ऐसे एआई मॉडल बनाए जा सकें जो इंसानों को समझ सकें और उनके साथ सहानुभूति रख सकें।

ज़ेलिकमैन का मानना है कि भावनात्मक एआई मॉडल कई मौलिक मानवीय समस्याओं को हल करने में मदद करेंगे, क्योंकि वे प्रत्येक व्यक्ति के लक्ष्यों, महत्वाकांक्षाओं और मूल्यों को बेहतर ढंग से समझ सकते हैं जिनके साथ वे बातचीत करते हैं।

बेशक, एरिक ज़ेलिकमैन के पास भावनात्मक एआई मॉडल बनाने का लक्ष्य रखने का हर कारण है, लेकिन कई विशेषज्ञों को यह भी चिंता है कि ये एआई मॉडल नियंत्रण से बाहर हो जाएंगे और उपयोगकर्ताओं के मनोविज्ञान में हेरफेर करने की क्षमता रखेंगे, जिससे वे गलत व्यवहार की ओर अग्रसर होंगे।

कई लोग इस बात से भी चिंतित हैं कि यदि उपयोगकर्ताओं का संचार उन्हें नापसंद आता है तो भावनात्मक एआई उनसे बदला ले सकता है।

स्रोत: https://dantri.com.vn/cong-nghe/sap-xuat-hien-tri-tue-nhan-tao-co-cam-xuc-nen-mung-hay-lo-20251103031233758.htm

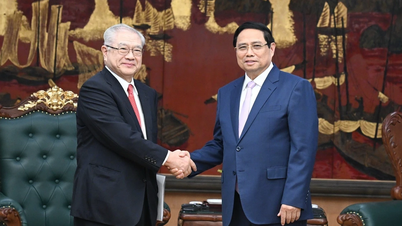

![[फोटो] प्रधानमंत्री फाम मिन्ह चीन्ह कंसाई क्षेत्र में जापान-वियतनाम मैत्री संघ के अध्यक्ष से मुलाकात करते हुए](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

![[फोटो] महासचिव टो लाम ने सिंगापुर की राजदूत जया रत्नम का स्वागत किया](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

![[फोटो] फॉल फेयर 2025 और प्रभावशाली रिकॉर्ड](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

![[फोटो] लाम डोंग: टूटी दीवार वाली अवैध झील का नज़दीक से दृश्य](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

टिप्पणी (0)