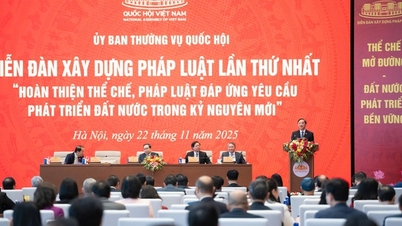

प्रतिनिधि डोंग नोक बा के अनुसार, कृत्रिम बुद्धिमत्ता (एआई) पर कानून का प्रवर्तन एकीकृत और समकालिक कानूनी आधार बनाने में योगदान देगा, जिससे विकास को बढ़ावा मिलेगा और एआई के अनुसंधान, विकास और उपयोग में प्रभावी जोखिम प्रबंधन सुनिश्चित होगा, तथा डिजिटल युग में सामाजिक -आर्थिक विकास की आवश्यकताओं को पूरा किया जा सकेगा।

प्रतिनिधि ने कहा कि मसौदा तैयार करने वाली एजेंसी बहुत सक्रिय और ज़िम्मेदार रही है, और उसने मसौदा कानून को पूरा करने के लिए समीक्षा एजेंसी और संबंधित एजेंसियों की कई राय का अध्ययन और आत्मसात किया है। प्रतिनिधि ने नए मसौदे में समाहित और संशोधित की गई कई सामग्रियों की बहुत सराहना की।

साथ ही, समीक्षा और समायोजन जारी रखने की सिफारिश की जाती है, विशेष रूप से संबंधित कानूनों जैसे कि नागरिक संहिता, उत्पाद और माल की गुणवत्ता पर कानून, बौद्धिक संपदा पर कानून, उच्च प्रौद्योगिकी पर कानून, मानकों और तकनीकी विनियमों पर कानून के साथ संगतता और समन्वय सुनिश्चित करना; नई विधायी सोच और विधायी तकनीकों को सुनिश्चित करना।

इसके अलावा, डिप्टी डोंग नोक बा ने भी कुछ विशिष्ट सिफारिशें कीं।

कृत्रिम बुद्धिमत्ता पर मसौदा कानून (अनुच्छेद 7 से 11) एआई प्रणालियों के जोखिम प्रबंधन को चार स्तरों में वर्गीकृत करता है: कम जोखिम, मध्यम जोखिम, उच्च जोखिम और अस्वीकार्य जोखिम।

डिप्टी बा ने कहा कि, एआई की प्रकृति को देखते हुए, यदि एआई प्रणाली को एक प्रकार का उत्पाद या वस्तु माना जाता है, तो मसौदा कानून के प्रावधान अनुचित और असंगत हैं, और उत्पाद और माल की गुणवत्ता पर कानून के प्रावधानों के अनुरूप नहीं हैं (उत्पादों और वस्तुओं को 3 समूहों में विभाजित करना: कम जोखिम, मध्यम जोखिम और उच्च जोखिम)।

इसलिए, यह अनुशंसा की जाती है कि मसौदा तैयार करने वाली एजेंसी एआई प्रणालियों पर सावधानीपूर्वक शोध करे और उन्हें वर्गीकृत करे, जो कार्यान्वयन को सुविधाजनक बनाने के लिए उत्पाद और माल की गुणवत्ता (3 जोखिम स्तर) पर कानून के अनुरूप हो।

" अस्वीकार्य जोखिम" वाली एआई प्रणाली के मामले में, इसे एक निषिद्ध गतिविधि के रूप में देखा जाना चाहिए, और मसौदा कानून में इसे विशेष रूप से निषेध के रूप में विनियमित किया जाना चाहिए। पूर्णता और कठोरता सुनिश्चित करने के लिए एआई के अनुसंधान, विकास और उपयोग में अन्य निषिद्ध कृत्यों (उदाहरण के लिए: राष्ट्रीय सुरक्षा का उल्लंघन करने के लिए एआई का उपयोग करना, बायोमेट्रिक डेटा के आधार पर भेदभाव करने के लिए एआई का उपयोग करना, आदि) को जोड़ना आवश्यक है" - डिप्टी बा ने प्रस्ताव दिया।

एआई प्रणालियों से होने वाले नुकसान के लिए मुआवजे की जिम्मेदारी के बारे में, आर्टिफिशियल इंटेलिजेंस पर मसौदा कानून के अनुच्छेद 30 के खंड 3 के बिंदु ए में कहा गया है: "उच्च जोखिम वाली एआई प्रणालियों के लिए: एआई प्रणालियों के प्रबंधन और उपयोग में उल्लंघन से होने वाली क्षति के मामले में, उल्लंघन करने वाले संगठन या व्यक्ति को नागरिक कानून के प्रावधानों के अनुसार नुकसान की भरपाई करनी होगी"।

नागरिक संहिता के अनुच्छेद 601 के खंड 1 के अनुसार, अत्यधिक खतरे के स्रोतों में मोटर वाहन, विद्युत पारेषण प्रणालियां, चालू औद्योगिक संयंत्र, हथियार, विस्फोटक, ज्वलनशील पदार्थ, विषाक्त पदार्थ, रेडियोधर्मी पदार्थ, जंगली जानवर और कानून द्वारा निर्धारित अत्यधिक खतरे के अन्य स्रोत शामिल हैं।

डिप्टी डोंग न्गोक बा के अनुसार, नागरिक संहिता उच्च जोखिम के स्रोत से होने वाले नुकसान के लिए मुआवजे और अन्य मामलों के बीच, विशेष रूप से मुआवजे के दायित्व के निर्धारण में दोष कारक के संबंध में, अंतर करती है। उपरोक्त अनुच्छेद 30 के खंड 3, बिंदु a में कृत्रिम बुद्धिमत्ता पर मसौदा कानून के प्रावधानों के साथ, यह स्पष्ट नहीं है कि "उच्च जोखिम वाली एआई प्रणाली" "उच्च जोखिम का स्रोत" है या नहीं। वहीं, तकनीकी और प्रौद्योगिकीय प्रकृति के संदर्भ में, एक उच्च जोखिम वाली एआई प्रणाली उच्च जोखिम के स्रोत की प्रकृति रखती है।

इसलिए, प्रतिनिधि ने उच्च जोखिम वाली एआई प्रणालियों को अत्यधिक खतरे के स्रोत के रूप में परिभाषित करने की दिशा में आर्टिफिशियल इंटेलिजेंस पर मसौदा कानून के अनुच्छेद 30 के खंड 3, बिंदु ए के प्रावधानों का अध्ययन और संशोधन करने का प्रस्ताव रखा, ताकि नागरिक संहिता के प्रावधानों के अनुसार एआई प्रणालियों द्वारा होने वाले नुकसान के लिए मुआवजे के दायित्व पर नियमों को लागू करने का आधार मिल सके।

सोच और विधायी तकनीकों में नवाचार के संबंध में, डिप्टी बा ने एक समीक्षा का प्रस्ताव रखा ताकि यह सुनिश्चित किया जा सके कि आर्टिफिशियल इंटेलिजेंस पर कानून सरकार के अधिकार क्षेत्र के अंतर्गत आने वाले मुद्दों को विनियमित न करे। विशेष रूप से, अध्याय VI (निरीक्षण, जाँच और उल्लंघनों से निपटना) में, विशिष्ट निरीक्षणों को विनियमित न करने पर विचार करें, बल्कि उन्हें सरकार पर छोड़ दें ताकि वह अपने अधिकार के अनुसार उन्हें विनियमित कर सके। अध्याय VII (एआई का राज्य प्रबंधन) की समीक्षा करें, और मंत्रालयों की राज्य प्रबंधन ज़िम्मेदारियों जैसे सरकारी अधिकार क्षेत्र के अंतर्गत आने वाले नियमों को हटा दें... अध्याय VI को अध्याय VII में विलय करने का प्रस्ताव रखें, क्योंकि निरीक्षण, जाँच और उल्लंघनों से निपटना अनिवार्य रूप से एआई के राज्य प्रबंधन की विशिष्ट विषयवस्तु हैं।

जिया लाई प्रांत के राष्ट्रीय असेंबली प्रतिनिधिमंडल के उप प्रमुख सियु हुआंग ने अध्याय 5 में एआई गतिविधियों में नैतिकता और जिम्मेदारी पर विनियमों में रुचि व्यक्त की।

प्रतिनिधि हुआंग के अनुसार, वर्तमान में, कई एआई मॉडल लेखक की सहमति के बिना इंटरनेट से डेटा, कलाकृतियाँ और रचनात्मक सामग्री एकत्र करके प्रशिक्षित किए जाते हैं, और लेखक को क्षतिपूर्ति देने की कोई व्यवस्था नहीं है। इससे सामग्री निर्माताओं के बौद्धिक संपदा अधिकारों के उल्लंघन का संभावित जोखिम पैदा होता है।

इसलिए, प्रतिनिधि ने सुझाव दिया कि मसौदा तैयार करने वाली एजेंसी अध्याय 5 में एक ऐसा नियम जोड़ने पर विचार करे जिसके तहत एआई सिस्टम डेवलपर्स के पास एक स्पष्ट अनुमति तंत्र होना चाहिए, जिससे सामग्री स्वामियों को एआई प्रशिक्षण उद्देश्यों के लिए उनके काम का उपयोग करने पर सहमति या इनकार करने का विकल्प मिल सके। साथ ही, शोध में लेखकों के लिए एक मुआवज़ा या लाभ-साझाकरण तंत्र का निर्माण किया जाना चाहिए, जब उनके काम का उपयोग एआई मॉडल प्रशिक्षण में किया जाता है।

चर्चा में भाग लेते हुए, डिप्टी गुयेन वान कैन्ह (जिया लाइ प्रांत के नेशनल असेंबली प्रतिनिधिमंडल के सदस्य) ने "एआई" उत्पादों का उपयोग करते समय चिंतित उपभोक्ता के दृष्टिकोण से मुद्दा उठाया, यदि नियंत्रण से परे कोई घटना होती है, जिससे नुकसान होता है, तो मुआवजे के लिए कौन जिम्मेदार होगा।

डिप्टी कैन्ह के अनुसार, आर्टिफिशियल इंटेलिजेंस पर मसौदा कानून "एआई तकनीक का उपयोग करने वाले उत्पादों" शब्द की व्याख्या नहीं करता है। उपभोक्ता केवल उत्पाद के बारे में जानते हैं, लेकिन केवल शोधकर्ता और वैज्ञानिक ही जानते हैं कि एआई तकनीक क्या है।

डिप्टी कैन्ह ने एआई को एक इनपुट उत्पाद, एक साधन-उपकरण, एक अर्ध-तैयार उत्पाद या एक तैयार उत्पाद के रूप में स्पष्ट रूप से अलग करने का प्रस्ताव रखा। इसके बाद, आपूर्तिकर्ता की ज़िम्मेदारी पर विशिष्ट नियमन होंगे।

"उदाहरण के लिए, एआई केवल उत्पाद में ही एकीकृत होता है। जब कोई क्षति होती है, तो उस उत्पाद के विक्रेता को पूरी ज़िम्मेदारी लेनी चाहिए और एआई पर दोष नहीं मढ़ना चाहिए, क्योंकि एआई बनाने वाली कंपनी इसे मुझे बेचती है, मेरा उस पर कोई नियंत्रण नहीं है," डिप्टी कैन्ह ने विश्लेषण किया।

स्रोत: https://baogialai.com.vn/viec-ban-hanh-luat-tri-tue-nhan-tao-la-van-de-cap-bach-post573129.html

टिप्पणी (0)