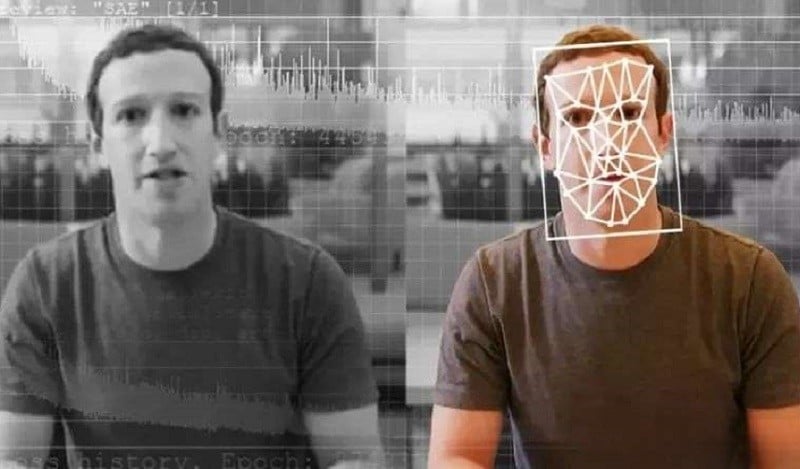

Deepfake adalah teknologi kecerdasan buatan yang memungkinkan pembuatan video , gambar, dan audio palsu dengan tingkat realisme yang tinggi. Oleh karena itu, Anda perlu memahami cara mengenali video Deepfake untuk menghindari penipuan dan mengidentifikasi informasi yang salah.

Periksa gerakan wajah

Salah satu tanda video palsu yang paling mudah dikenali adalah gerakan mata yang tidak alami dan kurangnya kedipan. Teknologi deepfake masih memiliki keterbatasan; teknologi ini tidak dapat sepenuhnya mensimulasikan kedipan alami manusia atau mereproduksi gerakan mata secara akurat.

|

| Periksa gerakan wajah untuk mengidentifikasi video Deepfake palsu. |

Selain itu, Anda dapat mengidentifikasi video Deepfake palsu melalui ekspresi wajah yang tidak sesuai dengan konten, warna kulit, rambut, dan gigi yang tidak menyerupai kenyataan, atau munculnya pencahayaan aneh karena penggunaan kecerdasan buatan untuk rekonstruksi.

Kualitas suara

Anda dapat mengidentifikasi video palsu yang dibuat dengan teknologi Deepfake melalui suara, karena teknologi ini seringkali lebih berfokus pada pembuatan ulang gambar dan video. Perhatikan gerakan mulut saat orang dalam video berbicara, untuk memeriksa apakah suara tersebut sesuai dengan gambar.

|

| Periksa kualitas suara. |

Postur penelepon

Saat ini, teknologi Deepfake belum dapat mereplikasi gerakan dan postur manusia secara sempurna; terkadang penelepon dalam video akan tampak dalam pose yang "aneh" atau tidak wajar. Misalnya, mereka mungkin terlihat canggung, atau orientasi kepala dan tubuh mereka mungkin tidak konsisten dalam video.

Dengan perkembangan pesat kecerdasan buatan, tidak sulit untuk membuat video deepfake untuk meniru orang lain dan melakukan penipuan, karena hal itu mengeksploitasi rasa takut dan kurangnya pengetahuan pengguna. Oleh karena itu, pengguna perlu membekali diri dengan pengetahuan dasar untuk mencegah penipuan ini dan tidak boleh mempercayai panggilan, pesan, atau email dengan konten yang mencurigakan. Jika Anda mendeteksi tanda-tanda penipuan, Anda harus segera menghubungi pihak berwenang untuk memverifikasi informasi tersebut dan melaporkannya ke kantor polisi terdekat.

Sumber

![[Foto] Sekretaris Jenderal dan Presiden To Lam memimpin rapat persiapan peninjauan satu tahun berjalannya sistem pemerintahan tiga tingkat.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/06/02/1780391821195_a1-bnd-4595-9717-jpg.webp)

Komentar (0)