CEO Truepic, Jeffrey McGregor, percaya bahwa insiden ini hanyalah puncak gunung es. Dia mengatakan bahwa lebih banyak konten yang dihasilkan AI akan muncul di media sosial, dan kita belum siap untuk itu.

Menurut CNN, Truepic bertujuan untuk mengatasi masalah ini dengan menyediakan teknologi yang memverifikasi keaslian media pada saat pembuatan melalui Truepic Lens. Aplikasi pengumpulan data ini akan memberi tahu pengguna tanggal, waktu, lokasi, dan perangkat yang digunakan untuk membuat gambar, serta menerapkan tanda tangan digital untuk memverifikasi apakah gambar tersebut alami atau dihasilkan oleh AI.

Sebuah foto palsu ledakan Pentagon menjadi viral di Twitter.

Truepic, sebuah perusahaan yang didukung Microsoft dan didirikan pada tahun 2015, menarik minat dari berbagai LSM dan perusahaan media, bahkan perusahaan asuransi, yang mencari cara untuk memvalidasi klaim sebagai sah.

McGregor menyatakan bahwa ketika segala sesuatu dapat dipalsukan, ketika kecerdasan buatan telah mencapai puncaknya dalam hal kualitas dan aksesibilitas, kita tidak lagi tahu apa itu realitas ketika kita berada di dunia maya.

Perusahaan teknologi seperti Truepic telah berupaya memerangi disinformasi daring selama bertahun-tahun. Namun, munculnya berbagai alat AI baru yang mampu menghasilkan gambar dan karya tulis sesuai perintah pengguna telah menambah urgensi masalah ini. Awal tahun ini, gambar palsu Paus Fransiskus mengenakan rompi pelampung Balenciaga dan mantan Presiden AS Donald Trump yang ditangkap tersebar luas. Kedua insiden tersebut membuat jutaan orang khawatir tentang potensi bahaya AI.

Beberapa anggota parlemen kini menyerukan perusahaan teknologi untuk mengatasi masalah ini dengan memberi label pada konten yang dihasilkan AI. Wakil Presiden Komisi Eropa Vera Jourova mengatakan perusahaan-perusahaan termasuk Google, Meta, Microsoft, dan TikTok telah bergabung dengan Kode Praktik Sukarela Uni Eropa tentang memerangi disinformasi.

Semakin banyak perusahaan rintisan dan raksasa teknologi, termasuk beberapa yang menerapkan generasi AI dalam produk mereka, berupaya menerapkan standar dan solusi untuk membantu orang menentukan apakah suatu gambar atau video dibuat menggunakan AI.

Namun, seiring kemajuan teknologi AI yang lebih cepat daripada kemampuan manusia untuk mengimbanginya, masih belum jelas apakah solusi-solusi ini dapat secara definitif menyelesaikan masalah tersebut. Bahkan OpenAI, perusahaan di balik Dal-E dan ChatGPT, telah mengakui bahwa upaya mereka sendiri untuk membantu mendeteksi tulisan yang dihasilkan AI masih belum sempurna.

Perusahaan yang mengembangkan solusi mengambil dua pendekatan untuk mengatasi masalah ini. Pendekatan pertama bergantung pada pengembangan program untuk mengidentifikasi gambar yang dihasilkan AI setelah diproduksi dan dibagikan secara online. Pendekatan lainnya berfokus pada penandaan gambar sebagai asli atau dihasilkan AI menggunakan semacam tanda tangan digital.

Reality Defender dan Hive Moderation sedang meneliti pendekatan pertama. Dengan platform mereka, pengguna dapat mengunggah gambar untuk dipindai dan kemudian menerima analisis yang menunjukkan persentase apakah gambar tersebut asli atau dihasilkan oleh AI.

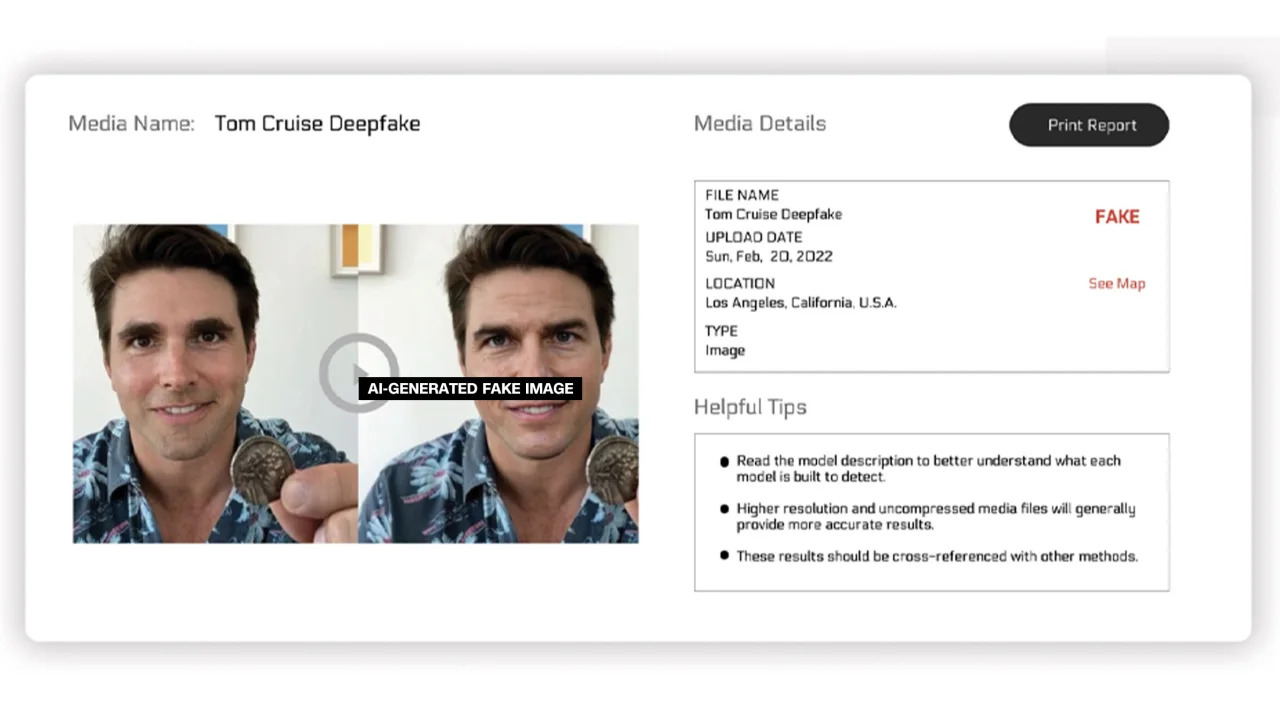

Reality Defender menyatakan bahwa perusahaan tersebut menggunakan teknologi sidik jari konten dan deepfake milik mereka sendiri untuk mendeteksi video, audio, dan gambar yang dihasilkan oleh AI. Dalam contoh yang diberikan oleh perusahaan, Reality Defender menunjukkan gambar deepfake Tom Cruise, yang memiliki peringkat "mencurigakan" sebesar 53% karena orang dalam gambar tersebut memiliki wajah yang terdistorsi, hal yang umum terjadi pada foto yang dimanipulasi.

Gambar yang diberi label dengan tag yang dihasilkan oleh AI.

Layanan-layanan ini menawarkan versi gratis dan berbayar. Hive Moderation mengatakan mereka mengenakan biaya $1,50 per 1.000 gambar. Realty Defender mengatakan harga mereka dapat bervariasi berdasarkan berbagai faktor, termasuk apakah klien membutuhkan keahlian dan dukungan perusahaan. CEO Reality Defender, Ben Colman, mengatakan risiko meningkat dua kali lipat setiap bulan karena siapa pun dapat membuat gambar palsu menggunakan alat AI.

Beberapa perusahaan lain sedang berupaya mengintegrasikan jenis stiker ke dalam gambar untuk memastikan apakah gambar tersebut asli atau dihasilkan oleh AI. Sejauh ini, upaya ini sebagian besar didorong oleh Koalisi untuk Otentisitas dan Sumber Konten (C2PA).

C2PA didirikan pada tahun 2021 untuk menciptakan standar teknis guna mensertifikasi asal dan riwayat media digital, menggabungkan Content Authenticity Initiative (CAI) dari Adobe dan Project Origin, yang dipimpin oleh Microsoft dan BBC, dengan tujuan untuk fokus memerangi disinformasi dalam berita digital. Perusahaan lain yang berpartisipasi dalam C2PA termasuk Truepic, Intel, dan Sony.

Berdasarkan prinsip C2PA, CAI akan menyediakan alat sumber terbuka bagi perusahaan untuk membuat kredensial konten atau metadata yang berisi informasi tentang gambar. Menurut situs web CAI, ini memungkinkan pembuat gambar untuk secara transparan berbagi detail tentang bagaimana mereka membuat gambar. Dengan cara ini, pengguna akhir dapat mengakses konteks seputar siapa, apa, dan bagaimana gambar tersebut diubah – dan kemudian menilai keaslian gambar tersebut sendiri.

Banyak perusahaan telah mengintegrasikan standar C2PA dan alat CAI ke dalam aplikasi mereka. Adobe Firefly—alat pembuatan gambar AI baru yang ditambahkan ke Photoshop—mematuhi standar C2PA melalui fitur Content Credentials-nya. Microsoft juga mengumumkan bahwa gambar dan video yang dibuat menggunakan Bing Image Creator dan Microsoft Designer akan membawa tanda tangan terenkripsi dalam beberapa bulan mendatang.

Pada bulan Mei, Google mengumumkan fitur "Tentang Gambar Ini", yang memungkinkan pengguna untuk melihat kapan sebuah gambar pertama kali muncul di Google dan di mana gambar tersebut mungkin terlihat. Raksasa pencarian itu juga mengumumkan bahwa semua gambar yang dihasilkan AI oleh Google akan membawa markup dalam file aslinya untuk "menambahkan konteks" jika gambar tersebut ditemukan di situs web atau platform lain.

Sementara perusahaan teknologi berupaya mengatasi kekhawatiran tentang citra yang dihasilkan AI dan integritas media digital, para ahli di bidang ini menekankan bahwa bisnis perlu berkolaborasi satu sama lain dan dengan pemerintah untuk menyelesaikan masalah tersebut. Meskipun demikian, perusahaan teknologi masih berlomba-lomba mengembangkan AI terlepas dari risikonya.

Tautan sumber

![[Foto] Perdana Menteri Pham Minh Chinh memimpin rapat tentang pengembangan ekonomi sektor swasta.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F20%2F1766237501876_thiet-ke-chua-co-ten-40-png.webp&w=3840&q=75)

Komentar (0)