サイバーセキュリティ局は最近、 動画や画像の改ざんを伴うハイテク詐欺が継続的に発生していることについて警告を発した。

そのため、当局は、サイバー犯罪者が国民の公開されている画像や動画を悪用して編集、操作し、偽の動画で国民を脅迫する状況について、国民に広く警告を発している。

人物の声や画像を非常に正確に再現できるディープフェイク技術を使用することで、犯罪者はオンライン会議でリーダーになりすましたり、ビデオや通話を作成して金融詐欺を働いたりすることができます。

さらに、こうした詐欺は緊急性、恐怖、権力といった心理的要因を悪用することが多く、被害者は主張の信憑性を徹底的に検証することなく性急に行動してしまいます。

ディープフェイクは金融投資詐欺に限りません。もう一つの例は恋愛詐欺です。ディープフェイクを使って架空のキャラクターを作成し、ビデオ通話で被害者とやり取りさせます。詐欺師は被害者の信頼を得た後、緊急事態の解決、旅費、ローンなどのために金銭を要求します。

このような状況を踏まえ、サイバーセキュリティ局は、ソーシャルメディア上の著名人による投資アドバイスには注意すること、身に覚えのないメッセージやメール、電話には用心すること、動画では不自然な表情を注意深く観察することなどを呼びかけている。

また、悪意のある人物に画像や動画、音声録音などの個人情報を盗まれないように、ソーシャルメディアへの個人情報を含むコンテンツの投稿を制限し、アカウントをプライベートモードに設定して個人情報を保護する必要があります。

ベトナムサイバー詐欺対策プロジェクト(Chongluadao.vn)の共同設立者で、サイバーセキュリティ専門家のゴ・ミン・ヒュー氏は、ダイ・ドアン・ケット紙の記者に対し、AIによるディープフェイク技術を用いてビデオ通話を偽装し、詐欺行為を行うことは依然として複雑な問題だと述べた。詐欺師たちは、被害者の信用性を高めるためにこの技術を悪用している。

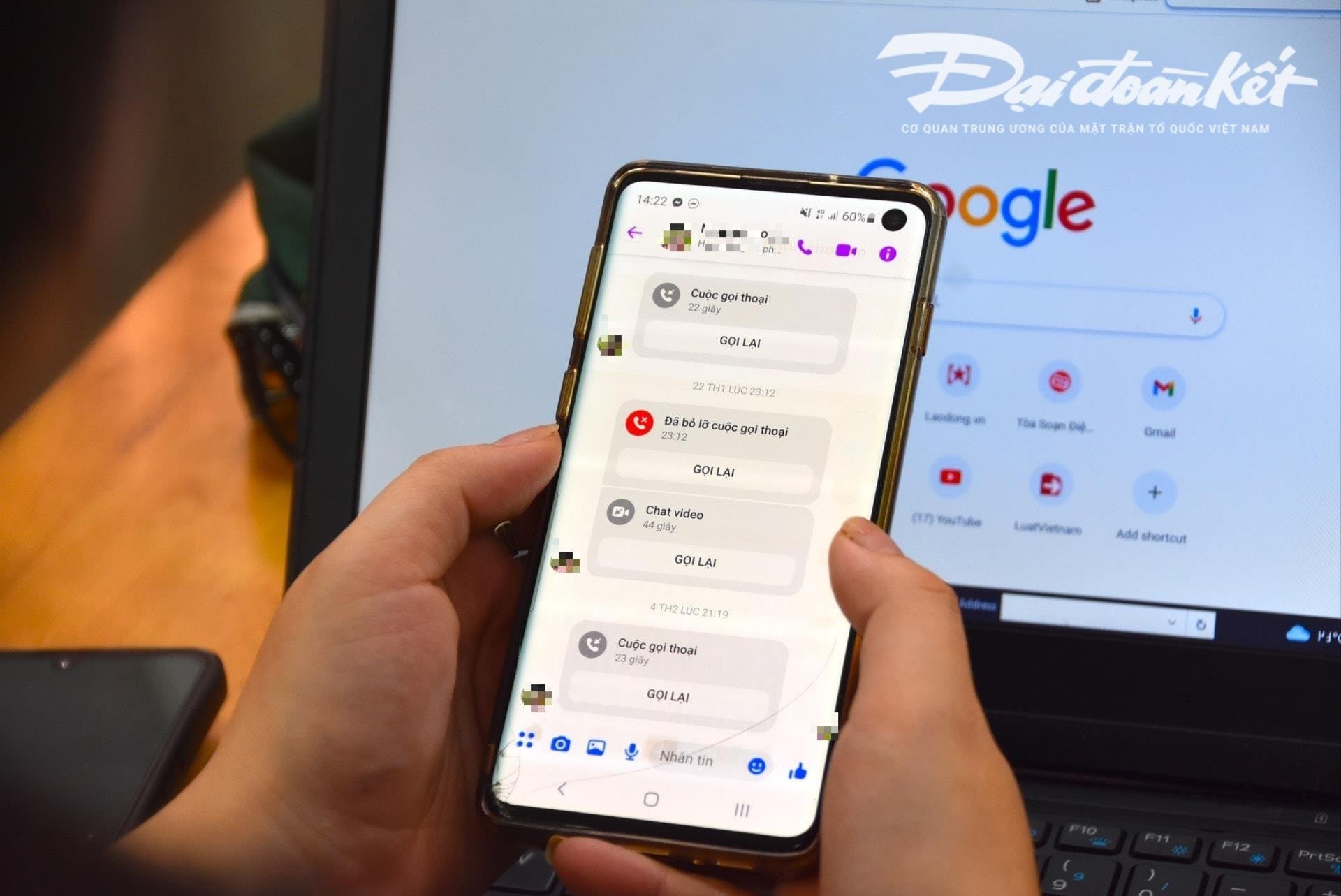

具体的には、犯人は事前に「盗んだ」画像や動画を使って被害者に積極的にビデオ通話をかけ、その後、技術的に操作して音声を歪めたり、画像の不具合を偽装したりして、被害者の信頼を得ようとします。

通常、こうした通話は非常に短く、数秒しか続きません。その後、詐欺師はインターネット接続が不安定であるとか、外出中であるといった言い訳をして、被害者に要求に応じるよう求めます。

専門家は、近い将来、オンライン詐欺におけるAIの利用が大幅に増加する可能性があると警告しています。そのため、特に疑わしいメッセージ、ビデオ通話、リンクを受け取った場合は、積極的に警戒と注意を喚起する必要があります。

この専門家の分析によると、現在のディープフェイク人工知能(AI)アルゴリズムでは、発信者が左を向いたり、右を向いたり、立ち上がったりすると、リアルタイムの通話を処理できないとのことだ...

こうした電話を受ける際に特に注意すべき脆弱性の一つは、歯です。現在、AIアルゴリズムはなりすましの対象となる人物の歯を正確に再現することができません。

ディープフェイク技術が使用される場合、相手の口を開けた画像には歯が映らない場合もあれば、3列、あるいは4列の歯が映っている場合もあります。そのため、ディープフェイク技術を用いた偽の通話において、歯の特徴は最も容易に認識できる要素となります。

詐欺に遭わないためには、「ゆっくり」行動し、要求にすぐに応じないことが必須です。ソーシャルメディアでメッセージや電話を受けた場合は、家族に直接連絡して本人確認を行い、少なくとも30秒待つか、直接会って確認するようにしてください。

誰かがソーシャル メディア上で親戚になりすまして詐欺や窃盗を行っている疑いがある場合は、直ちに最寄りの警察署に通報し、迅速な支援と対応を受ける必要があります。

[広告2]

出典: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

コメント (0)