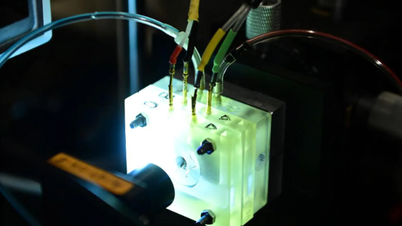

Dark AI ដំណើរការក្រៅបទដ្ឋានសុវត្ថិភាព ដែលជារឿយៗអនុញ្ញាតឱ្យមានអាកប្បកិរិយាដូចជាការក្លែងបន្លំ ឧបាយកល ការវាយប្រហារតាមអ៊ីនធឺណិត ឬការជីកយករ៉ែទិន្នន័យដោយមិនមានការត្រួតពិនិត្យយ៉ាងជិតស្និទ្ធ។

"តួអង្គអាក្រក់ក៏កំពុងប្រើប្រាស់ AI ដើម្បីបង្កើនសមត្ថភាពវាយប្រហាររបស់ពួកគេផងដែរ។ ការរំលោភបំពានទូទៅបំផុតនៃ AI នាពេលបច្ចុប្បន្ននេះគឺការលេចចេញនូវគំរូ Black Hat GPT ។ ទាំងនេះគឺជាគំរូ AI ដែលត្រូវបានបង្កើតឡើងជាពិសេស ឬសម្របខ្លួនដើម្បីបម្រើគោលបំណងខុសច្បាប់ដូចជា ការបង្កើតមេរោគ ពង្រាងអ៊ីមែលបន្លំ បង្កើតជាសំឡេង និងវីដេអូក្លែងបន្លំយ៉ាងជ្រៅ..." លោក Sergey Lozhkin ប្រធានក្រុមស្រាវជ្រាវ និងវិភាគពិភពលោកនៅអាស៊ីប៉ាស៊ីហ្វិក ចោទប្រកាន់នៅមជ្ឈិមបូព៌ា និង ប៉ាស៊ីហ្វិក (GReAT) Kaspersky ។

Black Hat GPTs អាចមានជាគំរូ AI ឯកជន ឬពាក់កណ្តាលឯកជនពេញលេញ។ ឧទាហរណ៍គួរឱ្យកត់សម្គាល់មួយចំនួនរួមមាន WormGPT, DarkBard, FraudGPT, និង Xanthorox... ទាំងអស់ត្រូវបានរចនាឡើងសម្រាប់ឧក្រិដ្ឋកម្មតាមអ៊ីនធឺណិត ការក្លែងបន្លំ និងស្វ័យប្រវត្តិកម្មព្យាបាទ។

លោក Lozhkin បានបង្ហាញថា អ្នកជំនាញ Kaspersky ឥឡូវនេះកំពុងកត់ត្រានិន្នាការដ៏គួរឱ្យព្រួយបារម្ភមួយបន្ថែមទៀត ដោយក្រុមវាយប្រហារតាមអ៊ីនធឺណិតដែលគាំទ្រដោយរដ្ឋ ឬ រដ្ឋាភិបាល បានចាប់ផ្តើមប្រើប្រាស់គំរូភាសាធំ (LLMs) នៅក្នុងយុទ្ធនាការវាយប្រហាររបស់ពួកគេ។

"OpenAI ថ្មីៗនេះបានប្រកាសថាវាបានបង្អាក់យុទ្ធនាការឥទ្ធិពលសម្ងាត់ជាង 20 និងការវាយប្រហារតាមអ៊ីនធឺណិតដែលកំពុងកេងប្រវ័ញ្ចឧបករណ៍ AI របស់ខ្លួន។ យើងនឹងឃើញអ្នកវាយប្រហារកាន់តែទំនើបប្រើប្រាស់អាវុធ AI ដែលបង្កការគំរាមកំហែងទាំងនៅក្នុងប្រព័ន្ធអេកូសាធារណៈ និងឯកជន។ នេះគឺជានិន្នាការគួរឱ្យព្រួយបារម្ភដែលអង្គការទាំងអស់ត្រូវរៀបចំសម្រាប់" Lozhkin បាននិយាយថា។

យោងតាមរបាយការណ៍របស់ OpenAI បានឱ្យដឹងថា តួអង្គព្យាបាទបានចាប់ផ្តើមទាញយកសមត្ថភាពនៃគំរូសិក្សាម៉ាស៊ីនធំ (LLMs) ដើម្បីបញ្ឆោតជនរងគ្រោះ និងឆ្លងកាត់ស្រទាប់សុវត្ថិភាពធម្មតា នេះបើយោងតាមរបាយការណ៍របស់ OpenAI ។ ពួកគេអាចបង្កើតសារក្លែងក្លាយដែលគួរឱ្យជឿ ផ្ញើសារទៅជនរងគ្រោះជាដុំៗ និងបង្កើតខ្លឹមសារជាច្រើនភាសា។

ដើម្បីពង្រឹងការការពារប្រឆាំងនឹងការគំរាមកំហែង AI ងងឹត អ្នកជំនាញ Kaspersky ណែនាំ៖ ការប្រើប្រាស់ដំណោះស្រាយសុវត្ថិភាពជំនាន់ក្រោយដូចជា Kaspersky Next ដើម្បីស្វែងរកមេរោគដែលបង្កើតដោយ AI និងគ្រប់គ្រងហានិភ័យនៅក្នុងសង្វាក់ផ្គត់ផ្គង់។ ការប្រើប្រាស់ឧបករណ៍ស៊ើបការណ៍គំរាមកំហែងតាមពេលវេលាជាក់ស្តែង ដើម្បីតាមដានការកេងប្រវ័ញ្ចដែលជំរុញដោយ AI ។ ការពង្រឹងការគ្រប់គ្រងការចូលប្រើ និងការបណ្តុះបណ្តាលបុគ្គលិកដើម្បីកំណត់ Shadow AI និងហានិភ័យនៃការលេចធ្លាយទិន្នន័យ។ ការបង្កើតមជ្ឈមណ្ឌលប្រតិបត្តិការសន្តិសុខ (SOC) ដើម្បីតាមដានការគំរាមកំហែង និងឆ្លើយតបយ៉ាងឆាប់រហ័សចំពោះឧប្បត្តិហេតុ។

ប្រភព៖ https://www.sggp.org.vn/kaspersky-canh-bao-toi-pham-mang-dung-dark-ai-tan-cong-post808493.html

![[រូបថត] ព្រឹកថ្ងៃទី ១ តុលា ទីក្រុងហាណូយ៖ ទឹកជំនន់អូសបន្លាយ ប្រជាជននាំគ្នាទៅធ្វើការ](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/1/189be28938e3493fa26b2938efa2059e)

![[រូបថត] ប្រធានរដ្ឋ Luong Cuong ទទួលជួបប្រធានរដ្ឋសភាគុយបា Esteban Lazo Hernandez](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/4d38932911c24f6ea1936252bd5427fa)

![[រូបថត] ទេសភាពនៃស្ពានស្នាក់នៅដោយខ្សែកាប ដែលជាឧបសគ្គចុងក្រោយនៃផ្លូវល្បឿនលឿន Ben Luc-Long Thanh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/391fdf21025541d6b2f092e49a17243f)

![[Infographics] រូបភាពសេដ្ឋកិច្ចខេត្តអានយ៉ាងក្នុងដំណាក់កាល ២០២០-២០២៥](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/1/093e29084648496c82a22536f5384c21)

Kommentar (0)