3월 12일, 구글은 스마트폰과 고성능 워크스테이션에서 모두 실행 가능한 3세대 오픈소스 AI 모델인 Gemma 3를 출시했습니다.

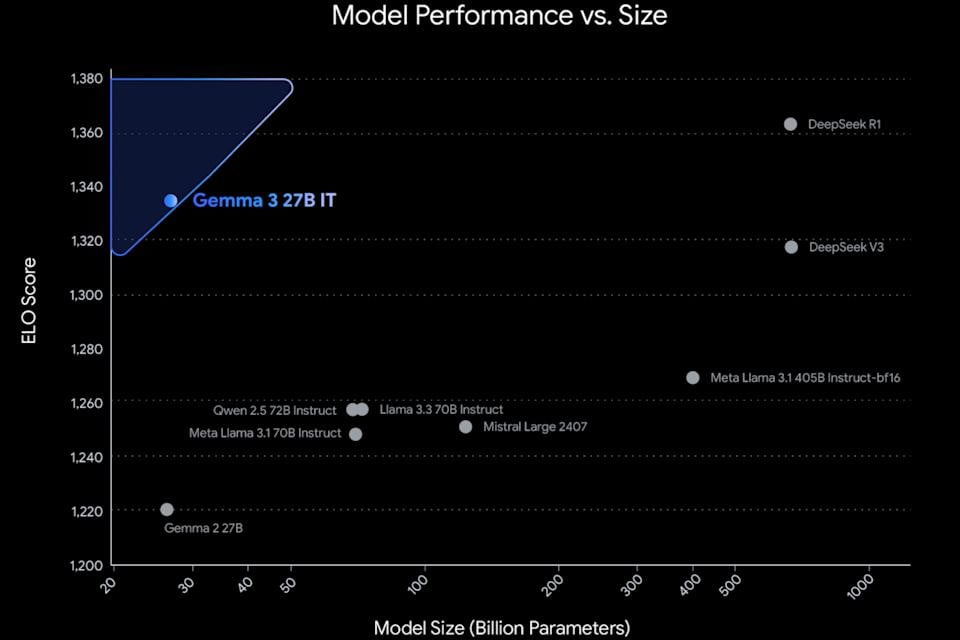

Gemma 3는 10억, 40억, 120억, 270억 개의 매개변수를 가진 네 가지 버전으로 제공됩니다. Google에 따르면, Gemma 3는 대규모 컴퓨터 클러스터 없이 단일 GPU 또는 TPU에서 실행할 수 있는 세계 최고의 단일 속도 모델입니다.

이론상, 이를 통해 Gemma 3는 Pixel 휴대폰의 Tensor Processing Unit(TPU)에서 직접 실행될 수 있는데, 이는 Gemini Nano 모델이 모바일 기기에서 로컬로 실행되는 방식과 유사합니다.

Gemini AI 모델군과 비교했을 때 Gemma 3의 가장 큰 장점은 오픈 소스라는 점입니다. 덕분에 개발자는 모바일 앱과 데스크톱 소프트웨어에서 필요에 따라 쉽게 사용자 정의, 패키징 및 배포할 수 있습니다. 또한 Gemma는 140개 이상의 언어를 지원하며, 그중 35개는 이미 교육 패키지로 제공됩니다.

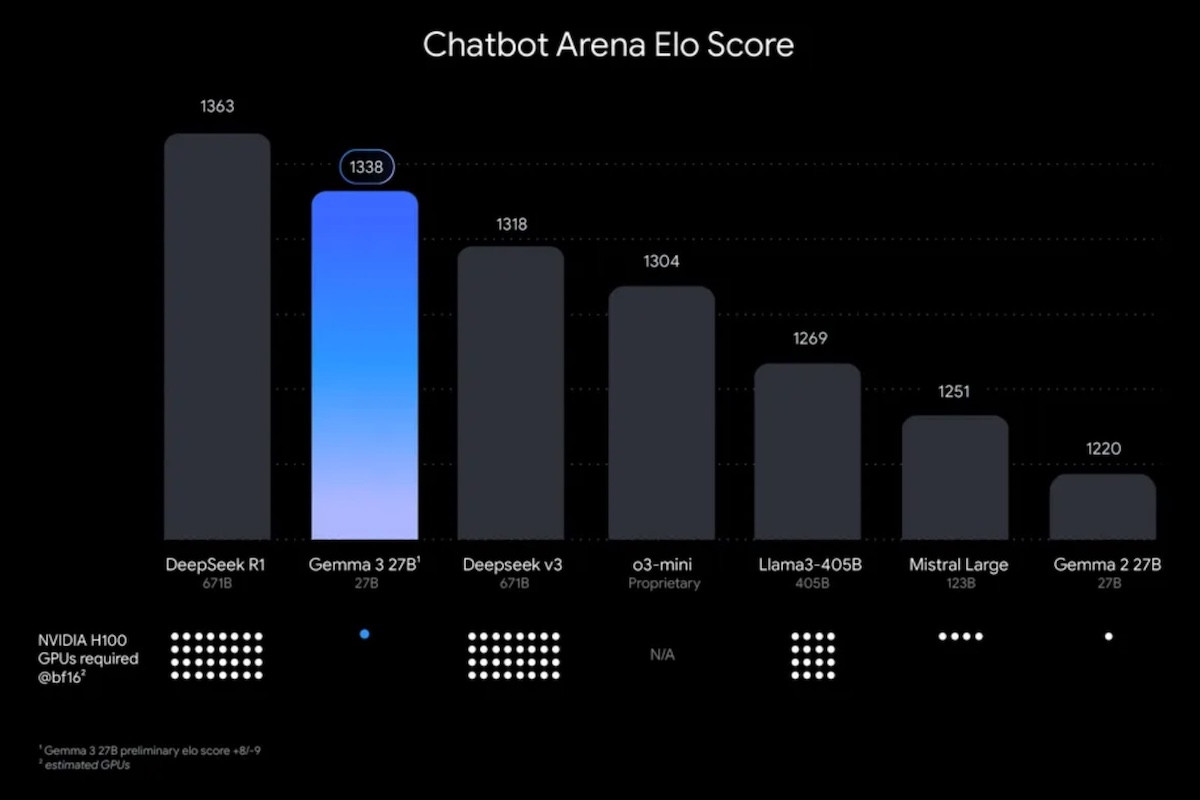

최신 Gemini 2.0 모델과 마찬가지로 Gemma 3는 텍스트, 이미지, 비디오를 처리할 수 있습니다. 성능 측면에서 Gemma 3는 DeepSeek V3, OpenAI o3-mini, Meta의 Llama-405B 변형을 포함한 다른 많은 인기 오픈소스 AI 모델보다 높은 평가를 받고 있습니다.

200페이지 분량의 책에 해당하는 맥락

Gemma 3는 최대 128,000개의 토큰으로 구성된 컨텍스트 윈도우를 지원하는데, 이는 200페이지 분량의 책에 담긴 데이터 양과 같습니다. 이에 비해 Gemini 2.0 Flash Lite 모델은 최대 100만 개의 토큰으로 구성된 컨텍스트 윈도우를 지원합니다.

Gemma 3는 외부 데이터 세트와 상호 작용하고 자동화된 에이전트 역할을 할 수 있습니다. 이는 Gemini가 Gmail이나 Docs와 같은 플랫폼에서 원활하게 작업을 지원하는 방식과 유사합니다.

Google의 최신 오픈소스 AI 모델은 로컬 또는 Vertex AI와 같은 Google 클라우드 서비스를 통해 배포할 수 있습니다. Gemma 3는 이제 Google AI Studio뿐만 아니라 Hugging Face, Ollama, Kaggle과 같은 타사 플랫폼에서도 사용할 수 있습니다.

구글의 3세대 오픈소스 모델은 기업들이 대규모 언어 모델(LLM)과 소규모 언어 모델(SLM)을 동시에 개발하는 업계 추세의 일환입니다. 구글의 경쟁사인 마이크로소프트 또한 자사의 오픈소스 소규모 언어 모델인 Phi 제품군을 통해 유사한 전략을 추진하고 있습니다.

Gemma와 Phi와 같은 소규모 언어 모델은 리소스 효율성이 뛰어나 스마트폰과 같은 기기에서 실행하기에 이상적입니다. 또한, 지연 시간이 짧아 모바일 애플리케이션에 특히 적합합니다.

[광고_2]

출처: https://vietnamnet.vn/google-ra-mat-gemma-3-mo-hinh-ai-ma-nguon-mo-voi-hieu-suat-vuot-troi-2380097.html

![[사진] 팜민친 총리, 베트남 우정통신그룹 창립 80주년 기념 행사 참석](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/6/39a89e5461774c2ca64c006d227c6a4e)

![[사진] 토람 총서기, 베트남 인민군 참모부 창설 80주년 기념 행사 참석](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/6/126697ab3e904fd68a2a510323659767)

![[사진] 베트남 인민군 참모총장 창설 80주년](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/6/49153e2a2ffc43b7b5b5396399b0c471)

![[사진] 프렌고개 기슭 침수지역에서 밤새 인명 구조](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/6/19095b01eb844de98c406cc135b2f96c)

![[사진] 많은 사람들이 사랑하는 호 삼촌과 총비서들을 직접 경험했습니다.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/6/2f4d9a1c1ef14be3933dbef3cd5403f6)

![[개최 예정] 워크숍: 일시금 세금 폐지에 대한 기업 가계의 우려 해결](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/9/7/5627bb2d0c3349f2bf26accd8ca6dbc2)

댓글 (0)